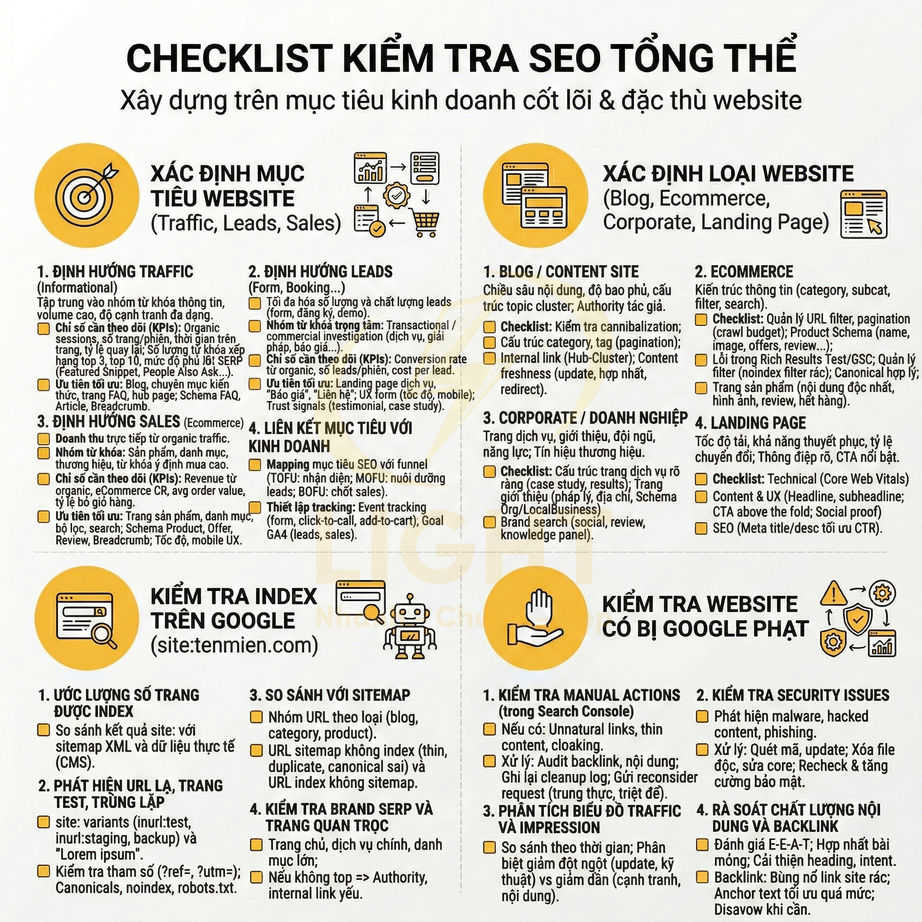

Cách kiểm tra website chuẩn SEO từng bước cho người mới

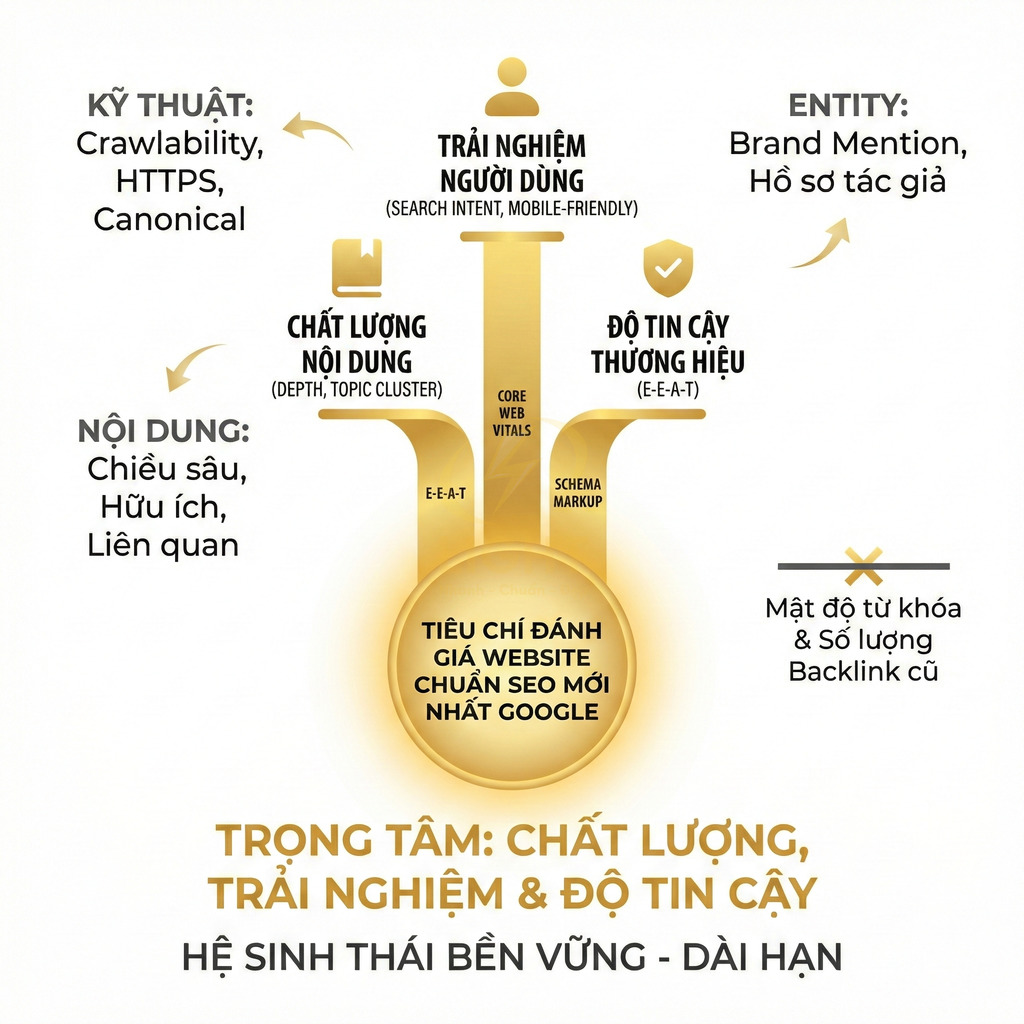

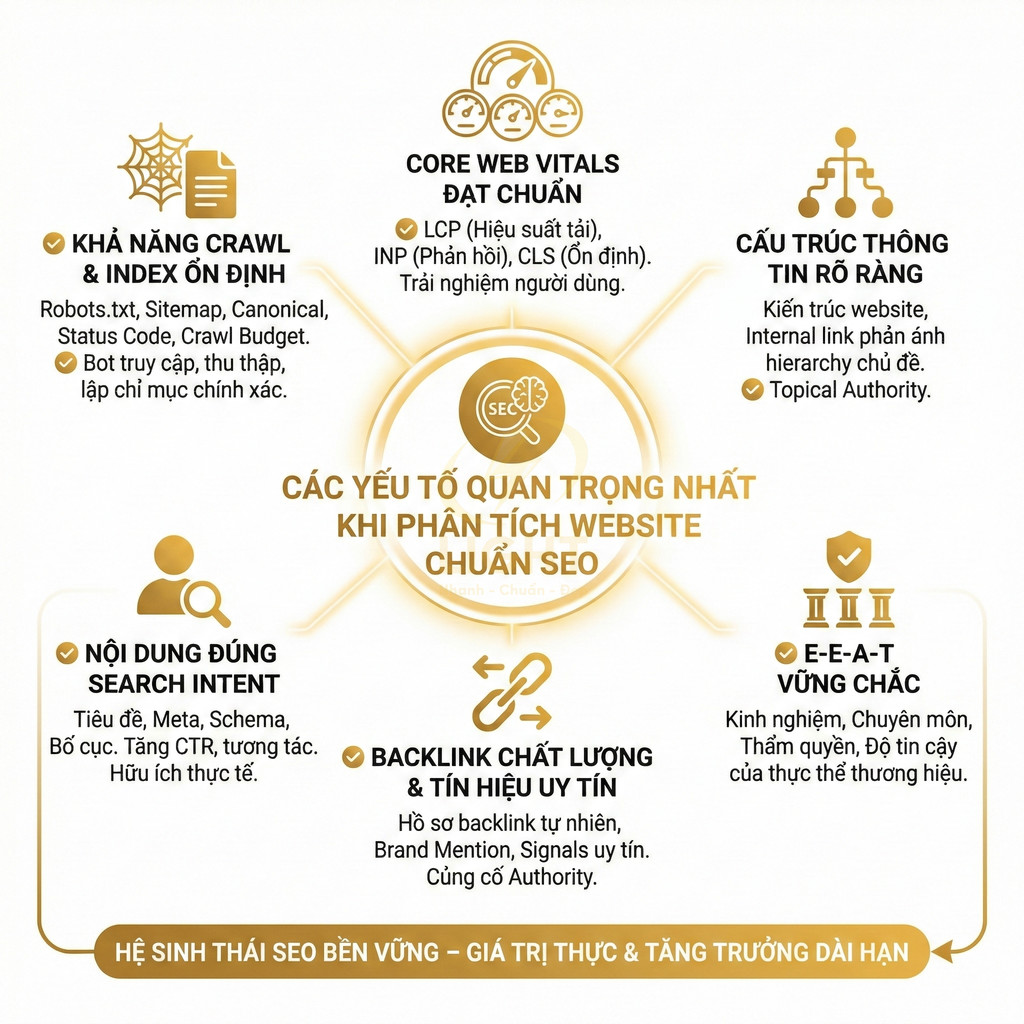

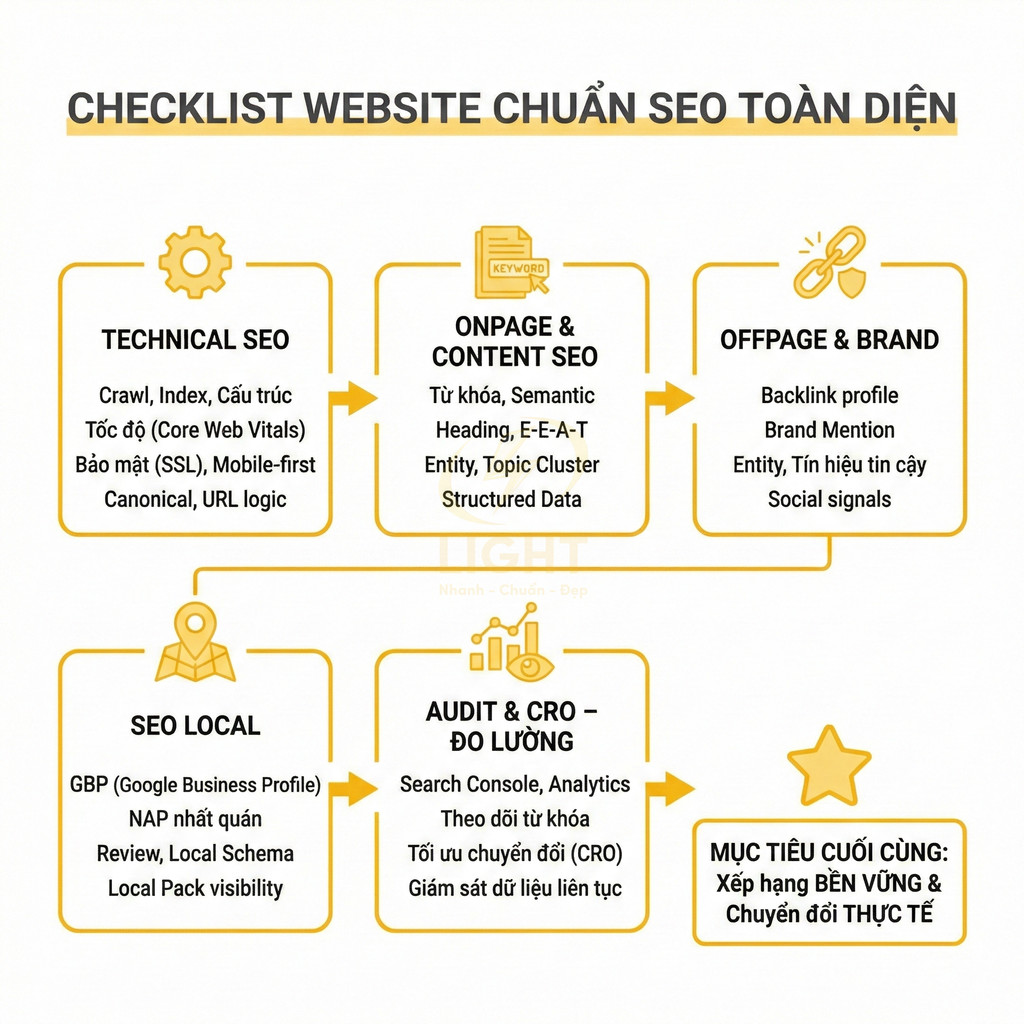

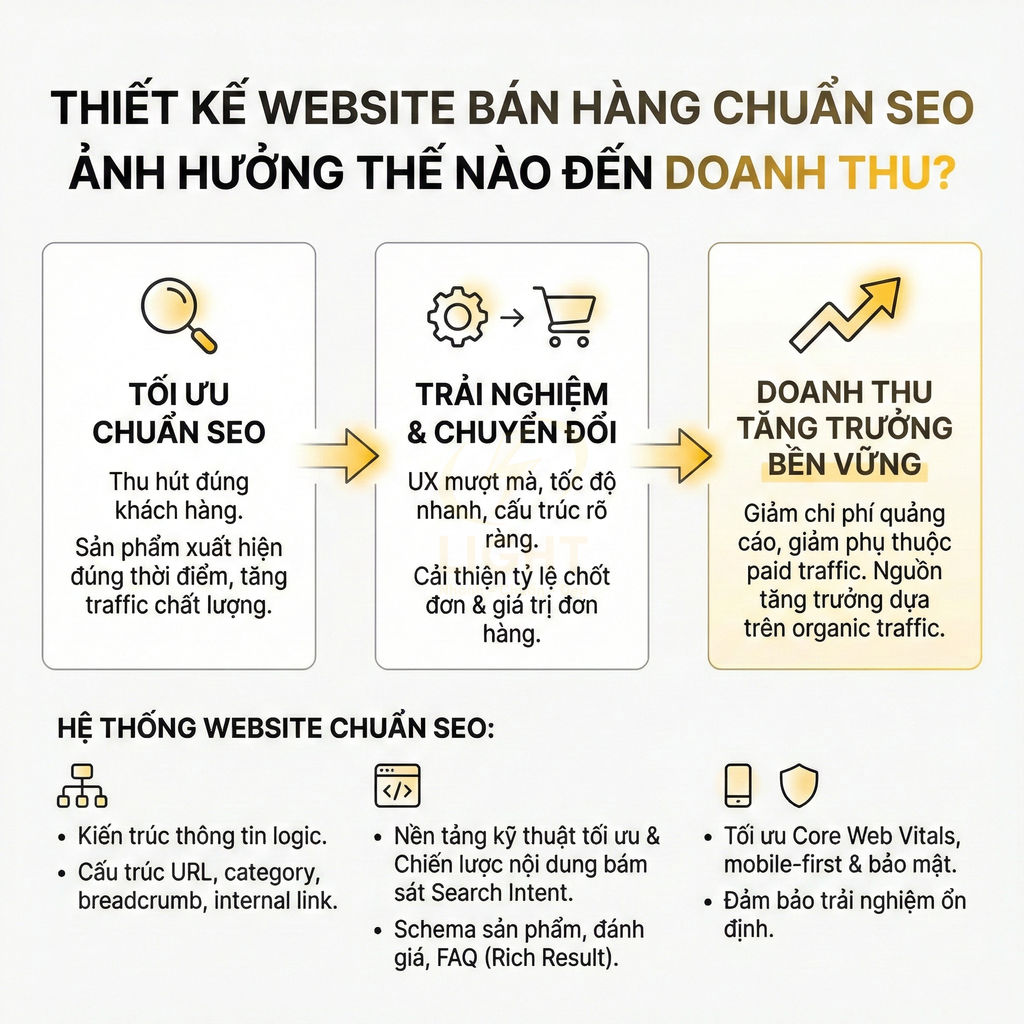

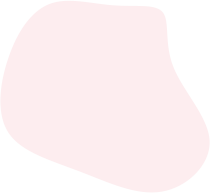

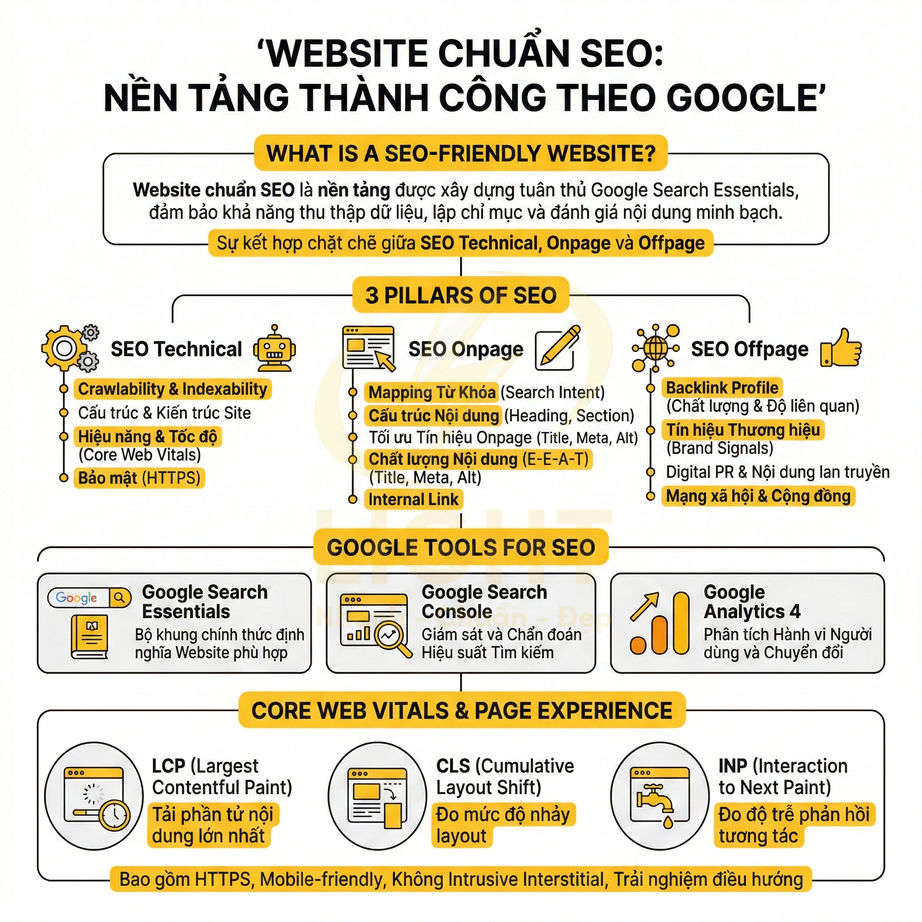

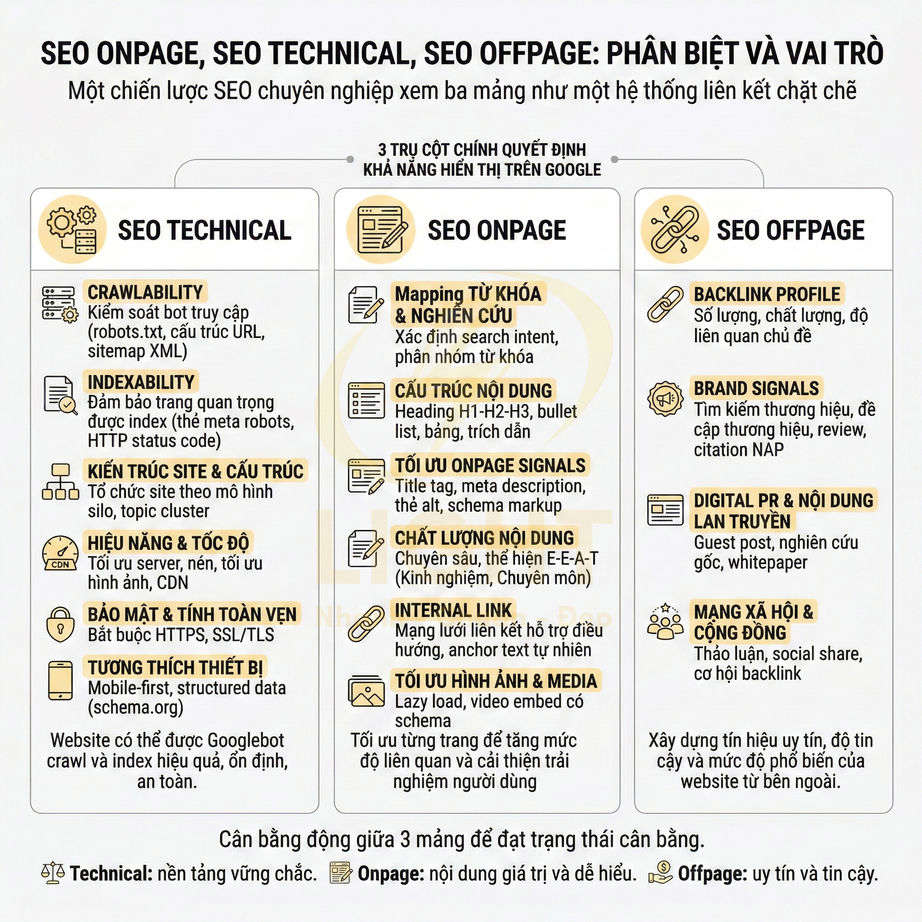

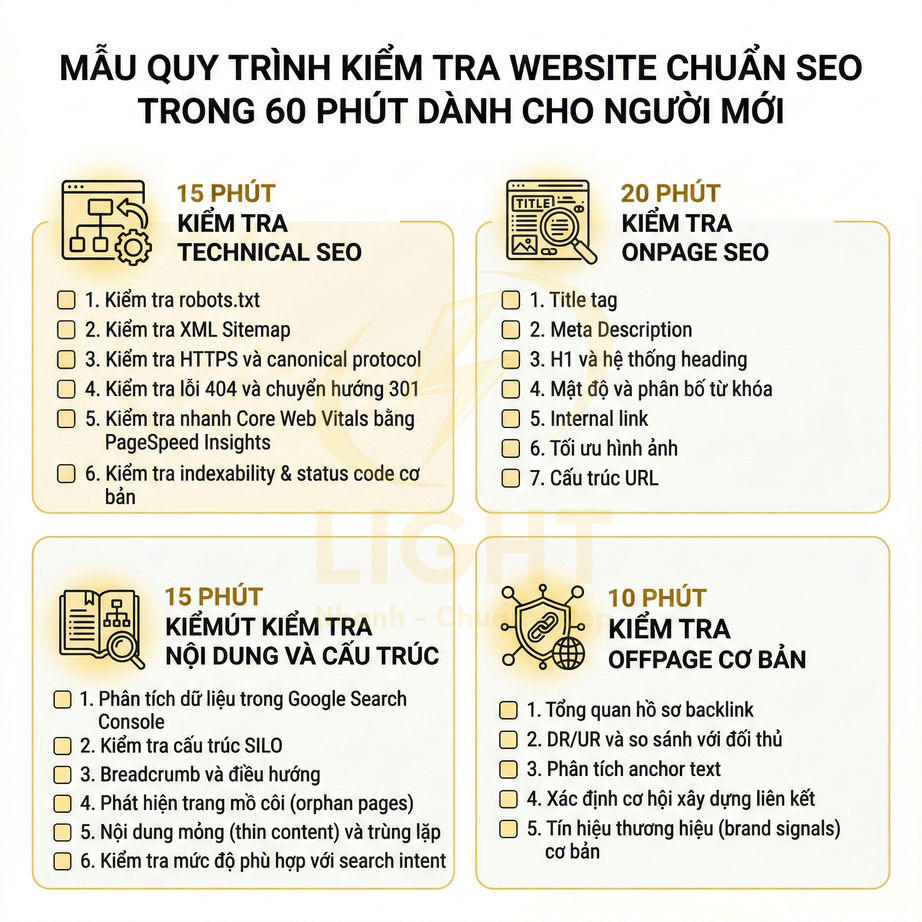

Một website được kiểm tra chuẩn SEO không chỉ dừng ở việc xem vài thẻ meta hay mật độ từ khóa, mà là đánh giá toàn diện từ nền tảng kỹ thuật, cấu trúc thông tin, nội dung, đến độ uy tín bên ngoài. Quy trình bài bản bắt đầu từ Technical SEO: đảm bảo khả năng crawl – index thông suốt, chuẩn hóa robots.txt, sitemap, status code, canonical, HTTPS, Core Web Vitals và mobile-first. Khi nền móng vững chắc, bước tiếp theo là SEO Onpage với hệ thống title, meta description, heading, URL, internal link và tối ưu search intent theo hướng semantic, bao phủ chủ đề thay vì nhồi nhét từ khóa.

Song song, kiến trúc website cần được tổ chức theo SILO hoặc Topic Cluster để tăng topical authority, hạn chế trùng lặp và cannibalization. Nội dung phải đạt chuẩn E-E-A-T, tránh thin content, duplicate và đảm bảo mỗi trang phục vụ một mục tiêu rõ ràng trong hành trình người dùng. Ở tầng ngoài, phân tích backlink, hồ sơ anchor text và tín hiệu thương hiệu giúp củng cố độ tin cậy. Toàn bộ quá trình được đo lường liên tục bằng Search Console, Analytics và các công cụ audit kỹ thuật để phát hiện lỗi index, cải thiện CTR và tối ưu trải nghiệm. Khi mọi lớp kỹ thuật, nội dung và uy tín vận hành đồng bộ, website mới thực sự đạt chuẩn SEO bền vững.

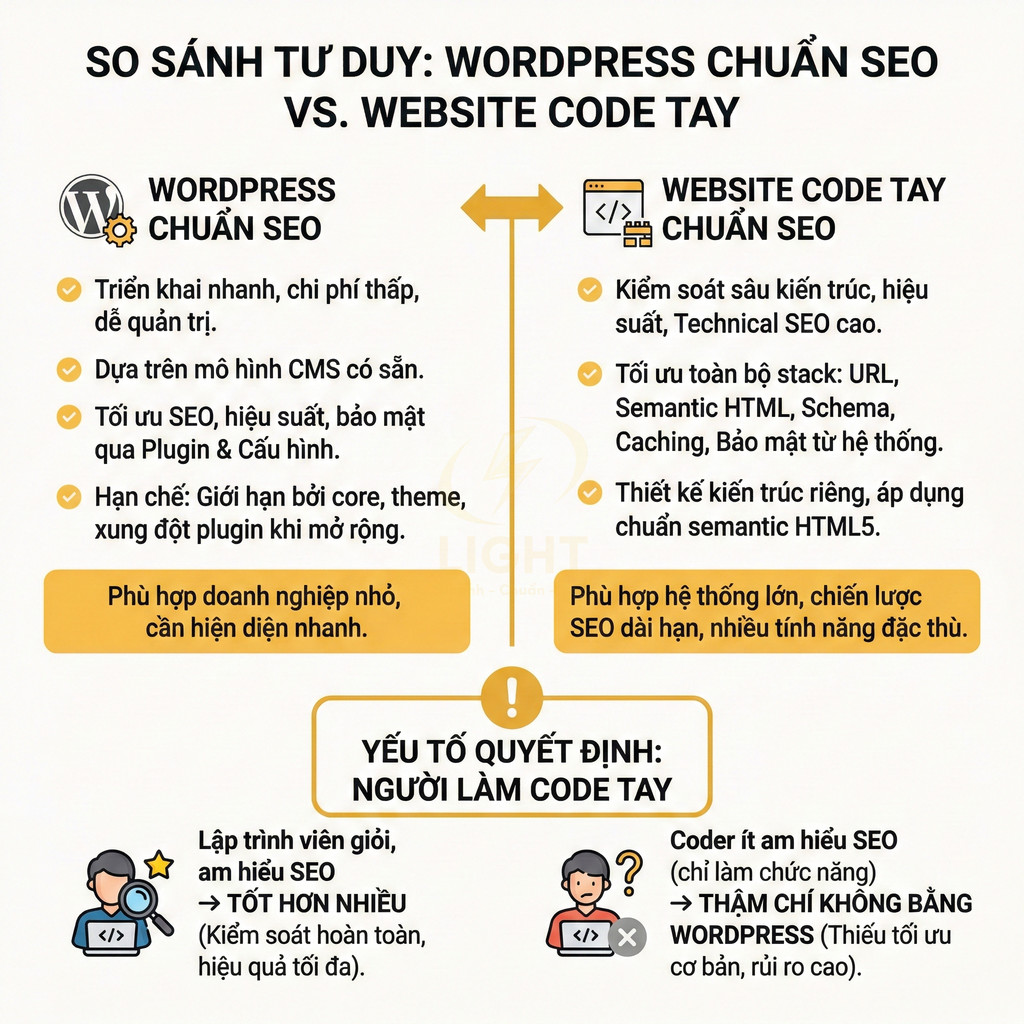

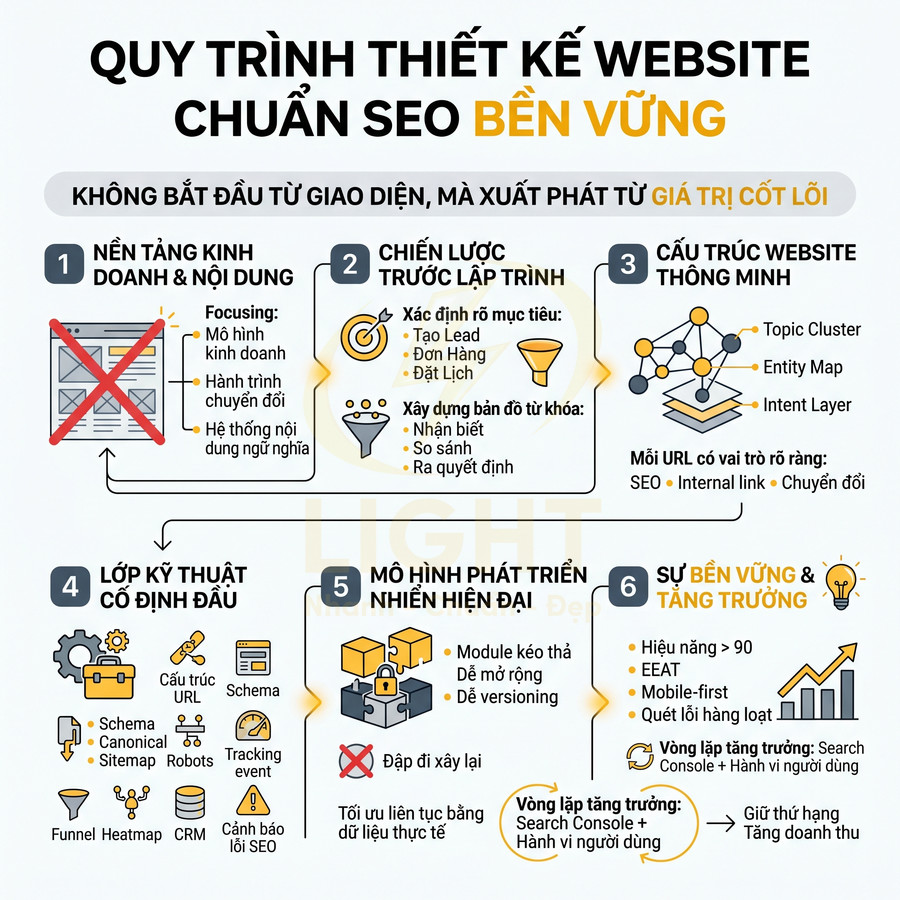

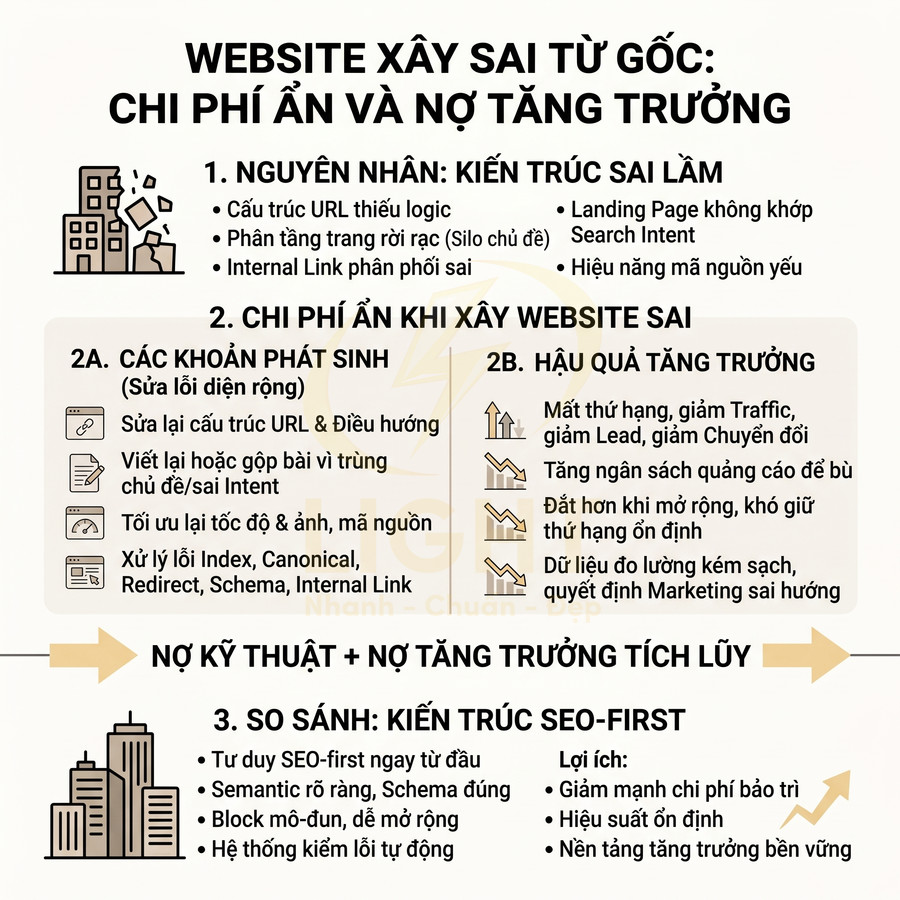

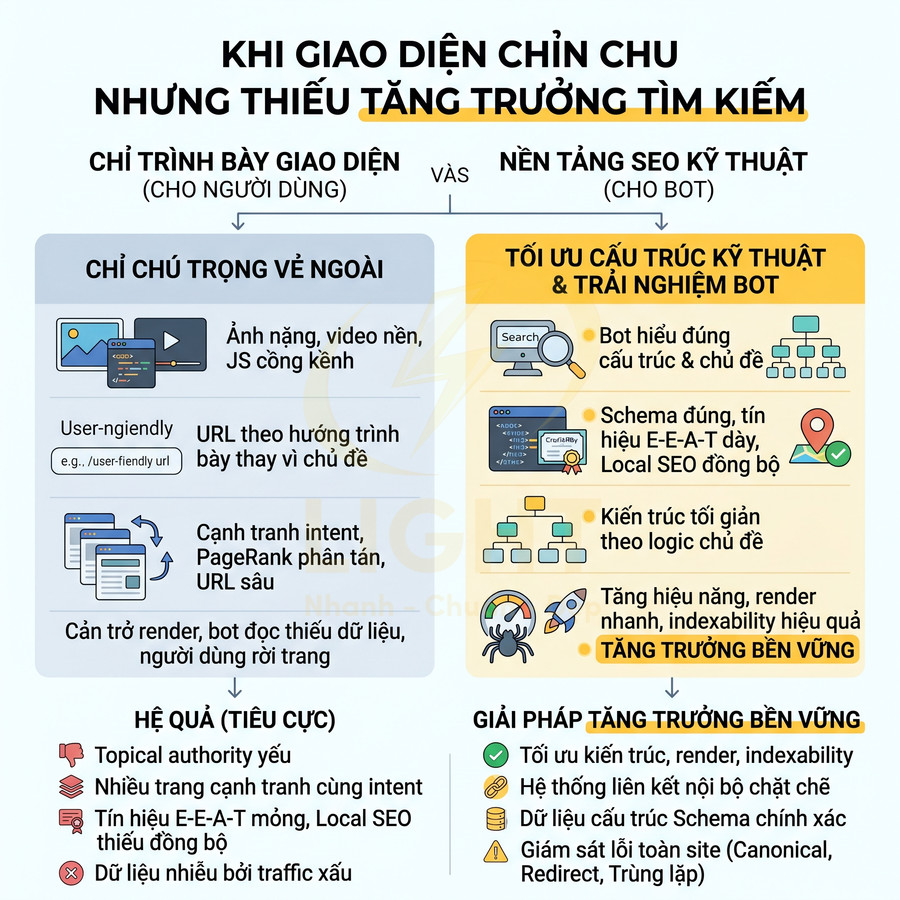

Nhiều lỗi SEO xuất phát từ nền tảng kỹ thuật ngay từ giai đoạn xây dựng ban đầu. Nếu cấu trúc URL, hệ thống heading, dữ liệu schema hay tốc độ tải trang không được chuẩn hóa từ đầu, quá trình tối ưu sau này sẽ phức tạp hơn. Vì vậy việc xây dựng đúng ngay từ thiết kế website chuẩn SEO giúp giảm đáng kể các vấn đề technical.

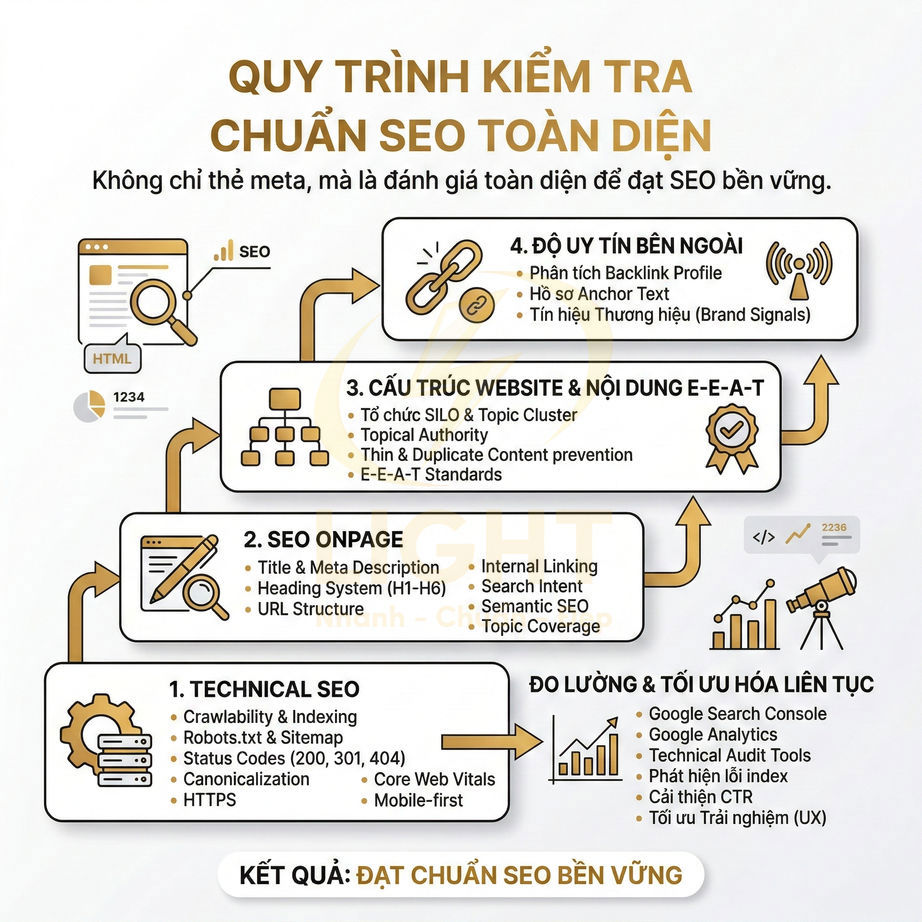

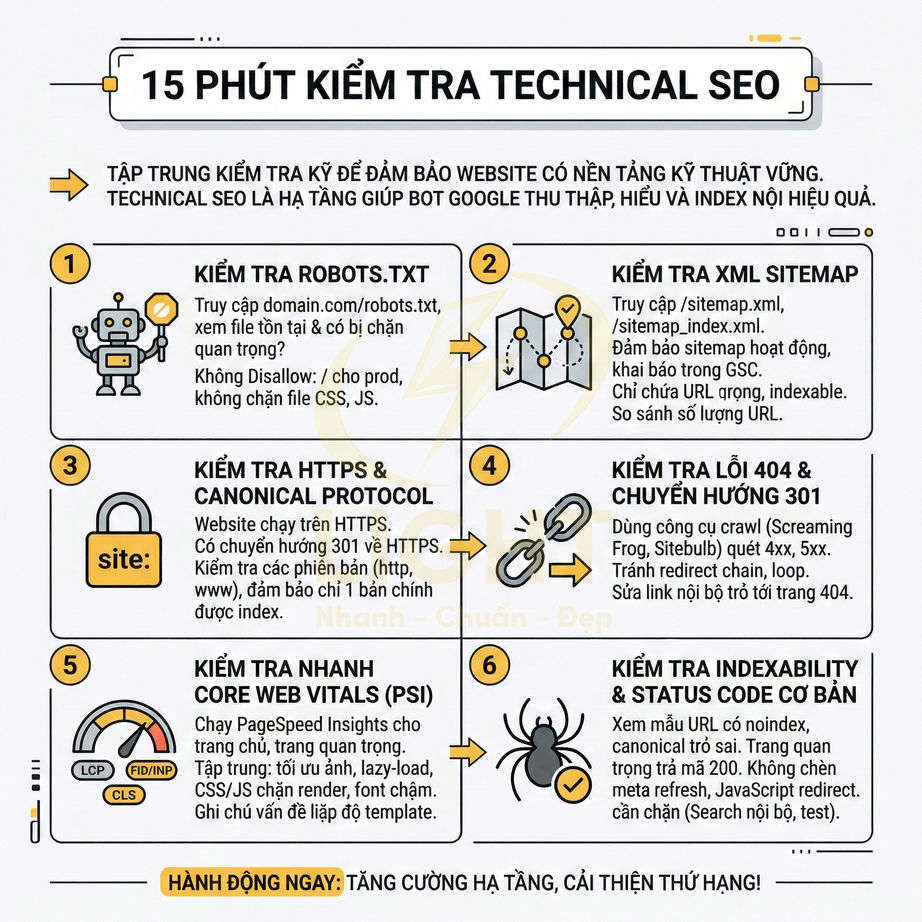

Bước 1: Kiểm tra Technical SEO

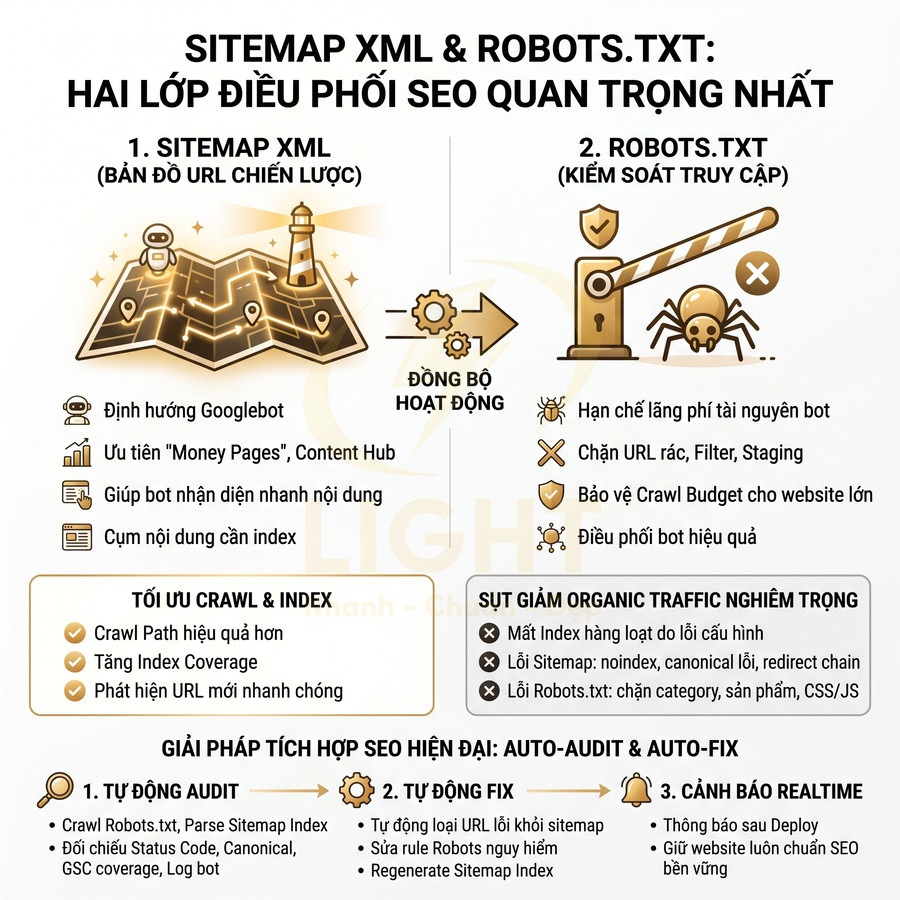

Technical SEO là nền tảng quyết định website có được công cụ tìm kiếm truy cập, hiểu và xếp hạng đúng hay không. Bước đầu tiên cần tập trung vào crawlability, indexability và cấu trúc URL chuẩn, đảm bảo bot có thể khám phá toàn bộ hệ thống nội dung mà không gặp rào cản kỹ thuật. Song song đó là kiểm soát redirect, canonical, sitemap và trạng thái HTTP để tránh lãng phí crawl budget. Yếu tố HTTPS, tốc độ tải trang theo Core Web Vitals và khả năng hiển thị mobile-first cũng đóng vai trò then chốt trong đánh giá chất lượng tổng thể. Khi hạ tầng kỹ thuật vững chắc, mọi nỗ lực về nội dung và tối ưu onpage mới phát huy tối đa hiệu quả.

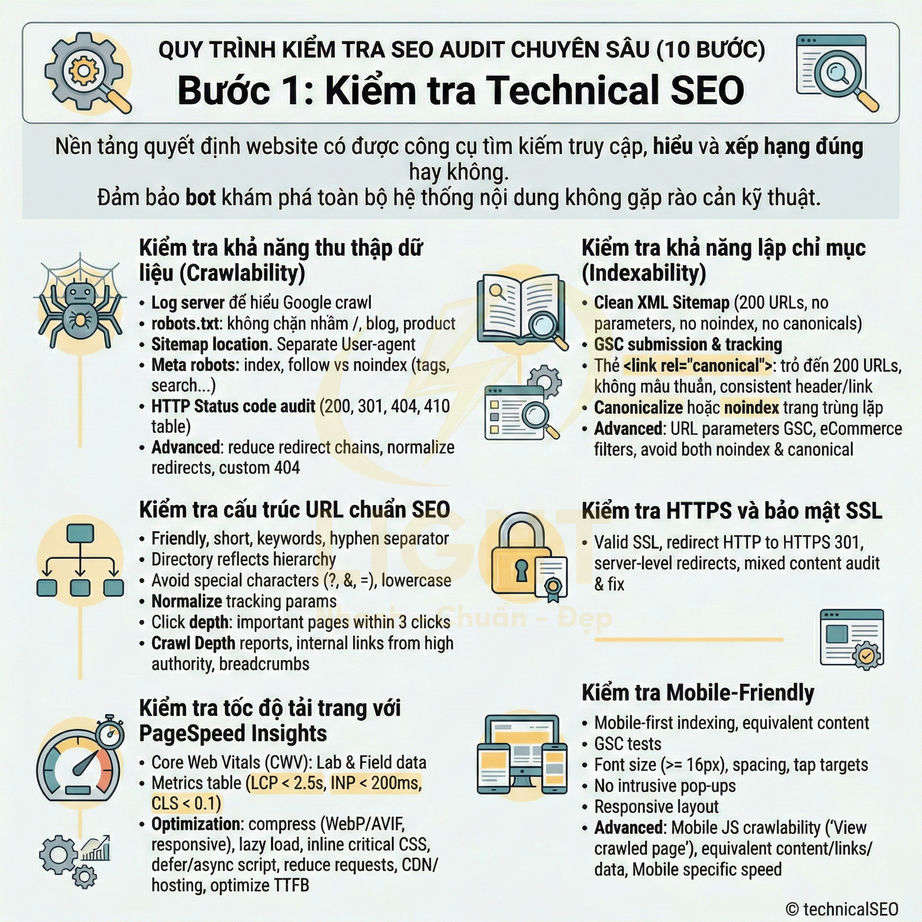

Kiểm tra khả năng thu thập dữ liệu (Crawlability)

Khả năng crawl quyết định việc Googlebot có thể truy cập, đọc và khám phá toàn bộ hệ thống URL trên website hay không. Ở mức chuyên sâu, cần đánh giá cả cấu hình cho bot, cấu trúc liên kết nội bộ lẫn log server để hiểu cách Google thực sự thu thập dữ liệu. Khả năng crawl hiệu quả phụ thuộc lớn vào cấu trúc website ngay từ đầu. Khi hệ thống URL, điều hướng và phân tầng nội dung được xây dựng logic trong quá trình thiết kế website, bot tìm kiếm có thể dễ dàng khám phá toàn bộ trang, giảm tình trạng bỏ sót nội dung quan trọng trong quá trình thu thập dữ liệu.

Các nghiên cứu học thuật về crawler cho thấy cấu trúc liên kết nội bộ có ảnh hưởng trực tiếp đến khả năng khám phá nội dung của công cụ tìm kiếm. Trong nghiên cứu kinh điển của Sergey Brin và Lawrence Page tại Stanford University, cấu trúc web được mô hình hóa như một đồ thị liên kết, trong đó bot tìm kiếm khám phá trang thông qua các cạnh (hyperlink). Các trang không có liên kết nội bộ thường bị bỏ sót trong quá trình crawl, đặc biệt khi không có backlink bên ngoài. Nghiên cứu này cho thấy website có cấu trúc liên kết rõ ràng giúp crawler tìm thấy nhiều URL hơn và cải thiện khả năng lập chỉ mục (Brin & Page, 1998, The Anatomy of a Large-Scale Hypertextual Web Search Engine).

Bước đầu tiên là kiểm tra file robots.txt bằng cách truy cập tenmien.com/robots.txt. Ngoài việc đảm bảo không chặn nhầm thư mục quan trọng như /, /blog/, /product/, cần chú ý thêm:

- Phân tách rõ User-agent cho Googlebot, AdsBot, các bot khác nếu có quy tắc riêng.

- Hạn chế dùng Disallow: / ở môi trường production; nếu cần chặn tạm thời, nên có checklist để gỡ sau khi triển khai.

- Sử dụng Allow thông minh cho các thư mục con trong một thư mục bị Disallow (ví dụ chặn /wp-admin/ nhưng cho phép /wp-admin/admin-ajax.php).

- Đảm bảo đường dẫn Sitemap được khai báo trong robots.txt để hỗ trợ bot khám phá URL nhanh hơn.

Với thẻ meta robots, ngoài index, follow và noindex, ở mức kỹ thuật cần hiểu thêm các giá trị như noarchive, nosnippet, noimageindex vì chúng ảnh hưởng đến cách trang xuất hiện trên SERP. Trang cần xếp hạng nên dùng index, follow, chỉ dùng noindex cho trang tag, search nội bộ, trang cảm ơn, trang test A/B, hoặc các trang thin content không mang giá trị SEO. Tránh gắn noindex nhầm trên template chung (header, layout) vì có thể tác động hàng loạt.

Tiếp theo, rà soát HTTP status code bằng Screaming Frog hoặc Ahrefs Site Audit, kết hợp log server để xem tần suất Googlebot truy cập từng loại mã. Tập trung vào mã 200 (trang hoạt động), 301 (chuyển hướng vĩnh viễn), 404 (không tìm thấy) và 410 (đã xóa vĩnh viễn) để tránh lãng phí crawl budget và làm sạch cấu trúc index.

| Mã trạng thái | Ý nghĩa | Hành động SEO khuyến nghị |

|---|---|---|

| 200 | Trang hoạt động bình thường | Giữ nguyên, tối ưu nội dung |

| 301 | Chuyển hướng vĩnh viễn | Dùng cho URL cũ sang URL mới chuẩn |

| 404 | Không tìm thấy trang | Chuyển hướng 301 hoặc tạo nội dung mới phù hợp |

| 410 | Trang bị xóa vĩnh viễn | Dùng khi chắc chắn không cần trang đó nữa |

Ở mức nâng cao, cần:

- Giảm chuỗi chuyển hướng (redirect chain) và tránh vòng lặp 301, vì làm chậm crawl và giảm tín hiệu PageRank.

- Chuẩn hóa redirect: tất cả biến thể (http/https, www/non-www, có/không slash cuối) phải hội tụ về một phiên bản duy nhất.

- Thiết kế trang 404 tùy chỉnh có internal link đến danh mục chính, bài viết nổi bật để giữ người dùng và dẫn bot đến các URL quan trọng.

- Dùng 410 cho các URL spam, nội dung lỗi thời không muốn giữ lại, giúp Google bỏ index nhanh hơn.

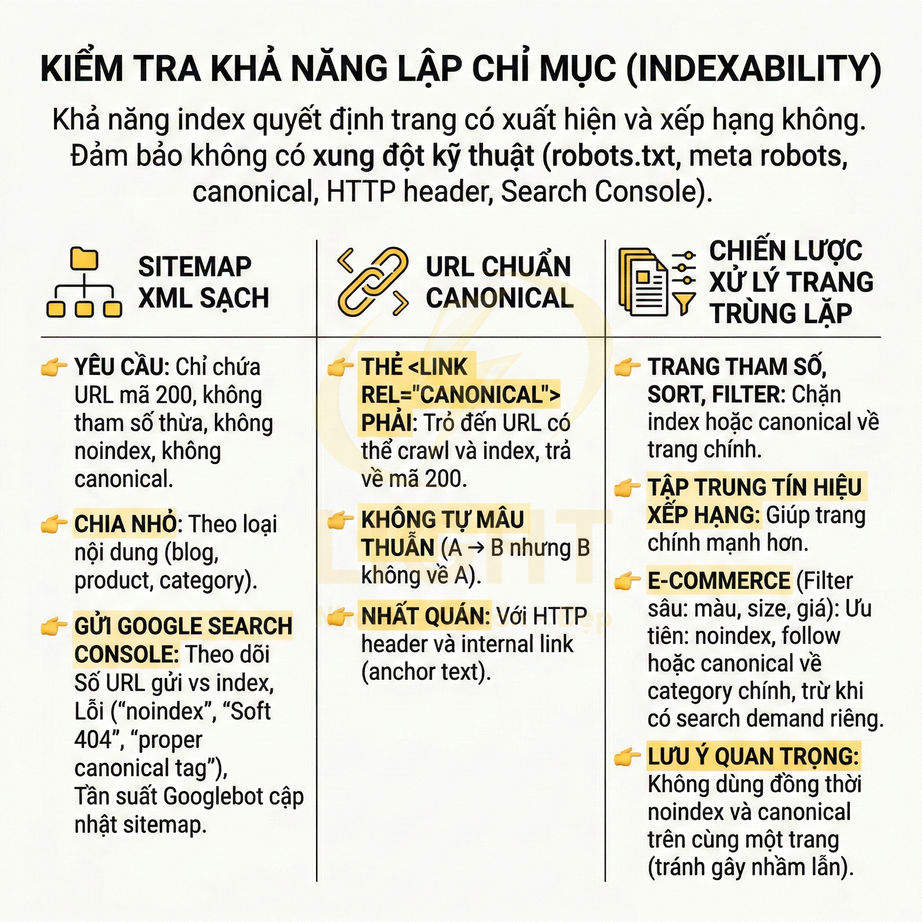

Kiểm tra khả năng lập chỉ mục (Indexability)

Khả năng index quyết định việc trang có xuất hiện trong kết quả tìm kiếm và nhận được tín hiệu xếp hạng hay không. Ở góc độ kỹ thuật, cần đảm bảo không có xung đột giữa robots.txt, meta robots, canonical, HTTP header và cấu hình trong Search Console.

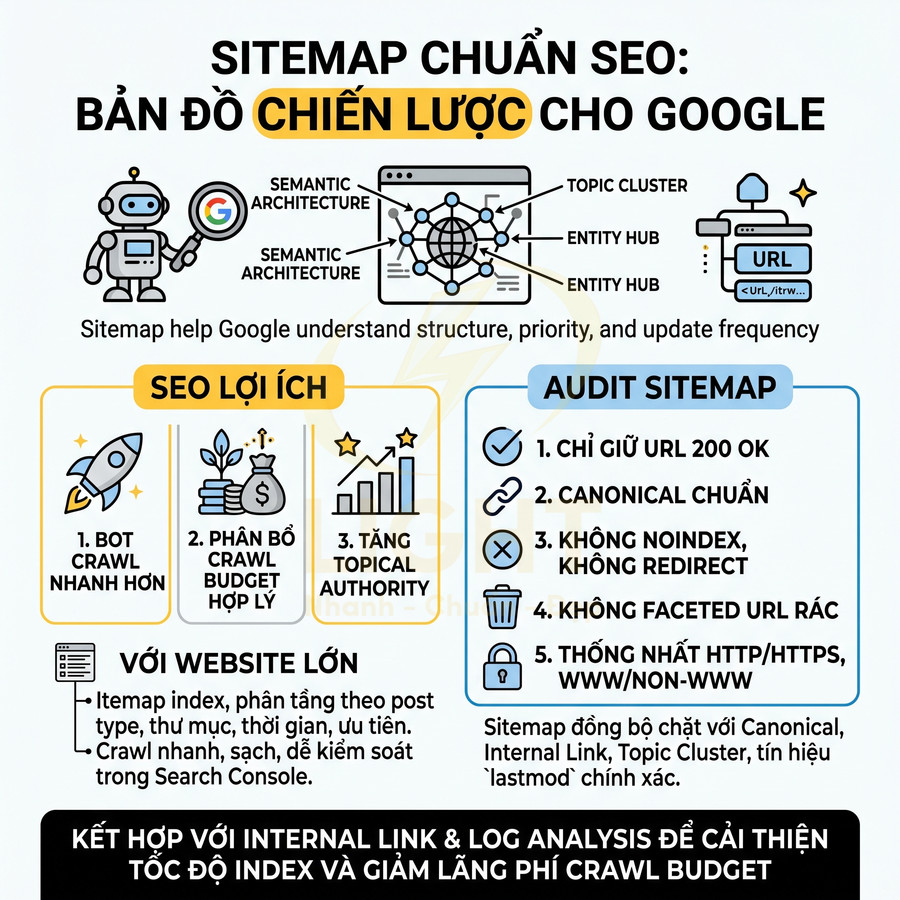

Trước tiên cần có Sitemap XML sạch, chỉ chứa URL trả về mã 200, không chứa tham số thừa, không chứa URL noindex, không chứa URL bị canonical sang trang khác. Sitemap nên được chia nhỏ theo loại nội dung (blog, product, category) nếu website lớn để dễ theo dõi. Gửi sitemap trong Google Search Console và theo dõi:

- Số URL gửi đi so với số URL được index.

- Lỗi “Submitted URL marked ‘noindex’”, “Submitted URL seems to be a Soft 404”, “Alternate page with proper canonical tag”.

- Tần suất Googlebot cập nhật sitemap (dựa trên log server hoặc thời gian “Last read” trong Search Console).

Tiếp theo, kiểm tra URL chuẩn canonical để tránh trùng lặp. Thẻ <link rel="canonical"> phải:

- Trỏ đến URL có thể crawl và index, trả về mã 200.

- Không tự mâu thuẫn (canonical A → B nhưng B lại canonical về A hoặc về C).

- Nhất quán với canonical trong HTTP header (nếu có) và với internal link (anchor nên trỏ về URL canonical).

Với trang trùng lặp (phiên bản có tham số, sort, filter), nên chặn index hoặc canonical về trang chính, giúp tập trung tín hiệu xếp hạng và tránh phân tán sức mạnh. Một số chiến lược nâng cao:

- Dùng tham số URL trong Search Console (nếu còn khả dụng) để báo cho Google cách xử lý filter, sort.

- Đối với eCommerce, các trang filter sâu (màu, size, giá) thường nên noindex, follow hoặc canonical về category chính, trừ khi có search demand riêng.

- Tránh dùng đồng thời noindex và canonical trỏ sang URL khác trên cùng một trang, vì có thể gây tín hiệu lẫn lộn; ưu tiên một chiến lược rõ ràng.

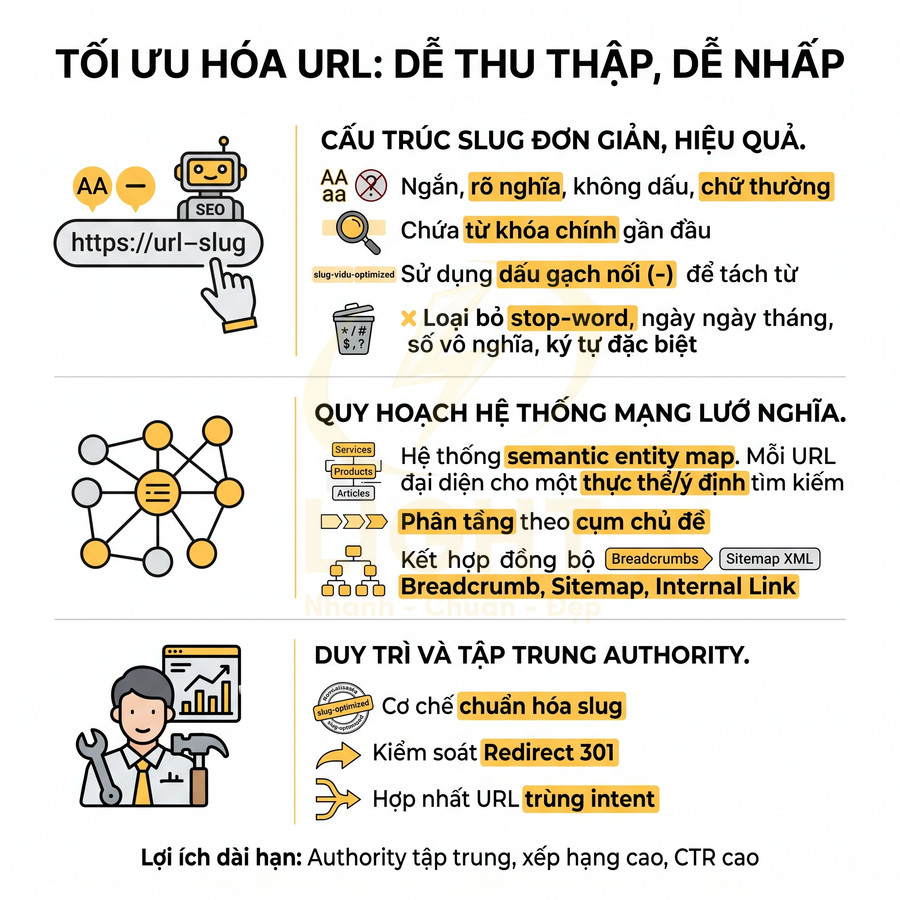

Kiểm tra cấu trúc URL chuẩn SEO

Cấu trúc URL ảnh hưởng trực tiếp đến khả năng hiểu nội dung của Google, khả năng phân cụm chủ đề (topical clustering) và trải nghiệm người dùng. Một URL chuẩn SEO cần URL thân thiện, ngắn gọn, chứa từ khóa chính, dùng dấu gạch ngang “-” để phân tách từ. Ở mức chuyên sâu, còn cần xem xét:

- Giữ cấu trúc thư mục phản ánh rõ hierarchy nội dung (ví dụ: /blog/seo-audit/ thay vì /b123/).

- Hạn chế thay đổi URL sau khi đã index; nếu bắt buộc, phải có kế hoạch redirect 301 và cập nhật internal link.

- Chuẩn hóa chữ thường (lowercase) để tránh trùng lặp URL do phân biệt hoa/thường.

Tránh ký tự đặc biệt như “?”, “&”, “=”, chuỗi tham số dài gây khó hiểu, trừ khi bắt buộc cho chức năng filter hoặc tracking. Với các tham số tracking (utm_source, v.v.), nên:

- Không đưa vào sitemap.

- Không dùng làm internal link chính.

- Có thể cấu hình để Google bỏ qua hoặc xử lý như bản trùng lặp.

Bên cạnh đó, kiểm soát độ sâu click (click depth), ưu tiên để trang quan trọng nằm trong phạm vi 3 lần click từ trang chủ, hỗ trợ cả crawl lẫn phân bổ PageRank nội bộ. Ở cấp độ kỹ thuật, có thể:

- Dùng crawl tool để xuất báo cáo “Crawl Depth” và xác định các URL quan trọng đang ở depth > 3.

- Tăng internal link từ trang có authority cao (trang chủ, category lớn, bài pillar) đến các trang sâu.

- Sử dụng breadcrumb, menu phụ, liên kết trong nội dung (contextual link) để rút ngắn đường đi của bot.

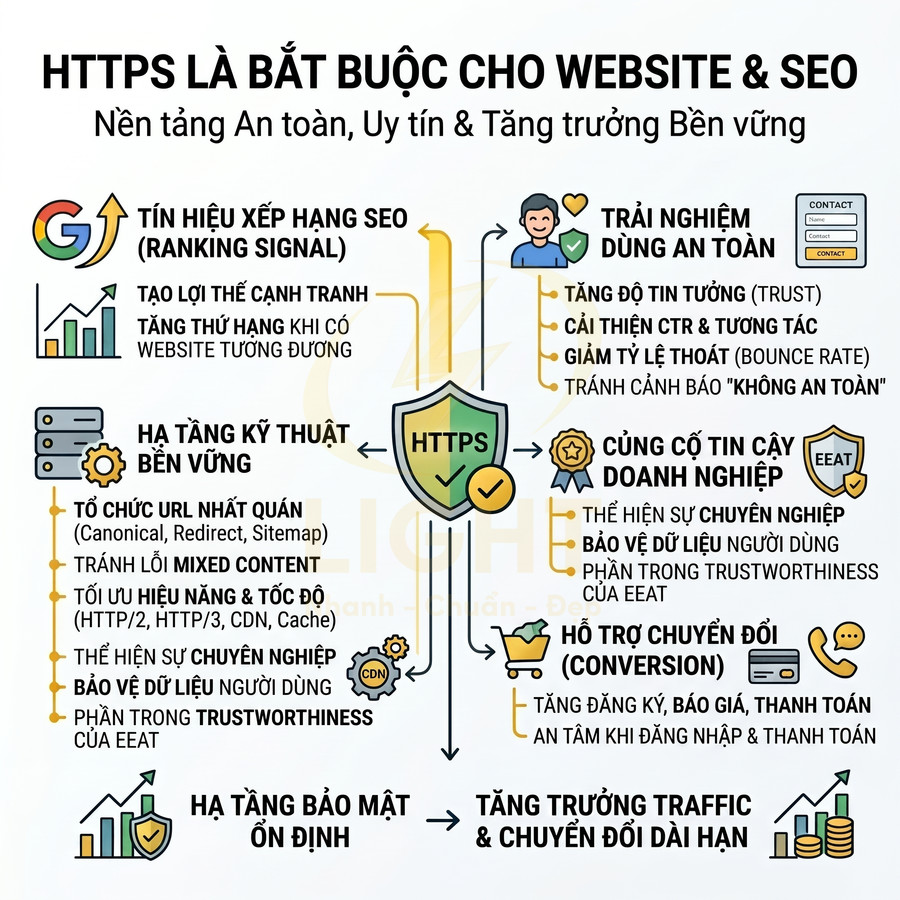

Kiểm tra HTTPS và bảo mật SSL

HTTPS là tín hiệu xếp hạng và là yêu cầu tối thiểu cho website hiện đại, đồng thời ảnh hưởng trực tiếp đến niềm tin người dùng. Cần đảm bảo website sử dụng SSL hợp lệ, không báo “Not Secure” trên trình duyệt, chứng chỉ không hết hạn và được cài đúng cho tất cả subdomain cần thiết.

Kiểm tra xem tất cả URL HTTP đã được chuyển hướng 301 sang HTTPS, tránh tình trạng nội dung trùng lặp giữa hai phiên bản. Ở mức chuyên sâu, cần:

- Thiết lập redirect ở tầng server (Apache, Nginx, IIS) thay vì chỉ dựa vào plugin.

- Đảm bảo canonical, hreflang, sitemap, internal link đều dùng phiên bản HTTPS.

- Kiểm tra HSTS (HTTP Strict Transport Security) nếu phù hợp để buộc trình duyệt luôn dùng HTTPS.

Đồng thời rà soát mixed content (tài nguyên HTTP trên trang HTTPS) vì có thể gây lỗi hiển thị và ảnh hưởng đến Page Experience. Các bước xử lý:

- Dùng DevTools hoặc crawl tool để liệt kê toàn bộ resource HTTP (ảnh, script, CSS, font).

- Cập nhật đường dẫn tuyệt đối HTTP sang HTTPS hoặc dùng đường dẫn tương đối giao thức (//domain.com/file.js) nếu phù hợp.

- Kiểm tra lại trên nhiều trình duyệt để đảm bảo không còn cảnh báo bảo mật.

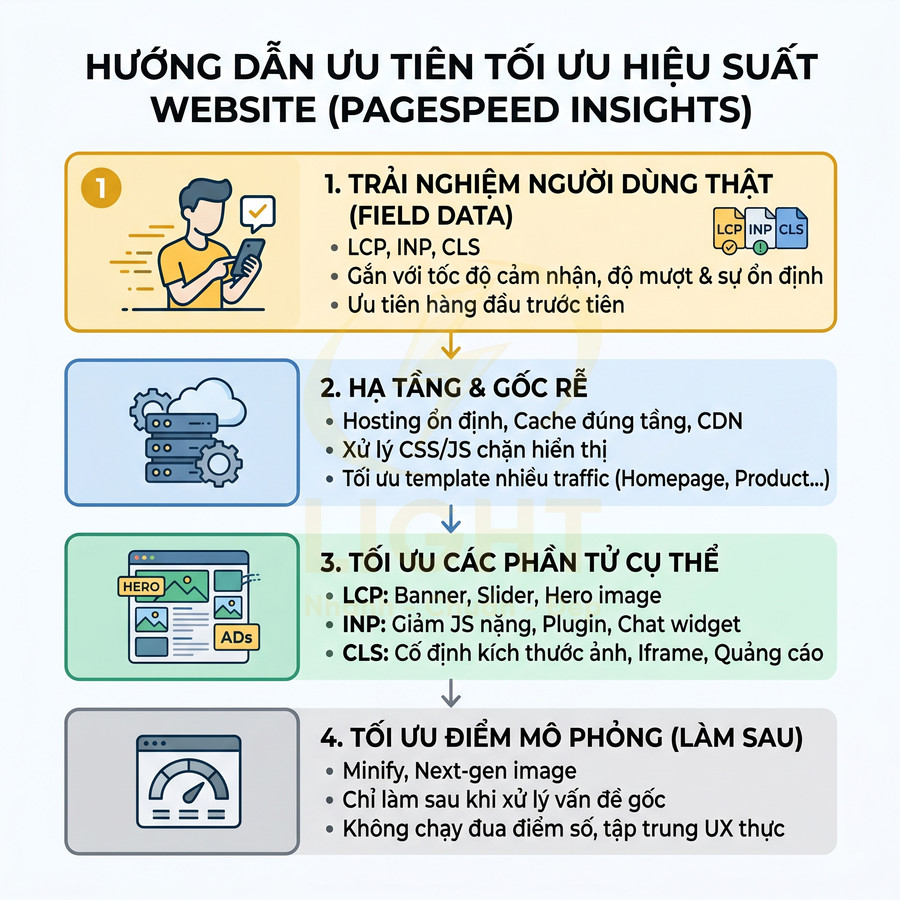

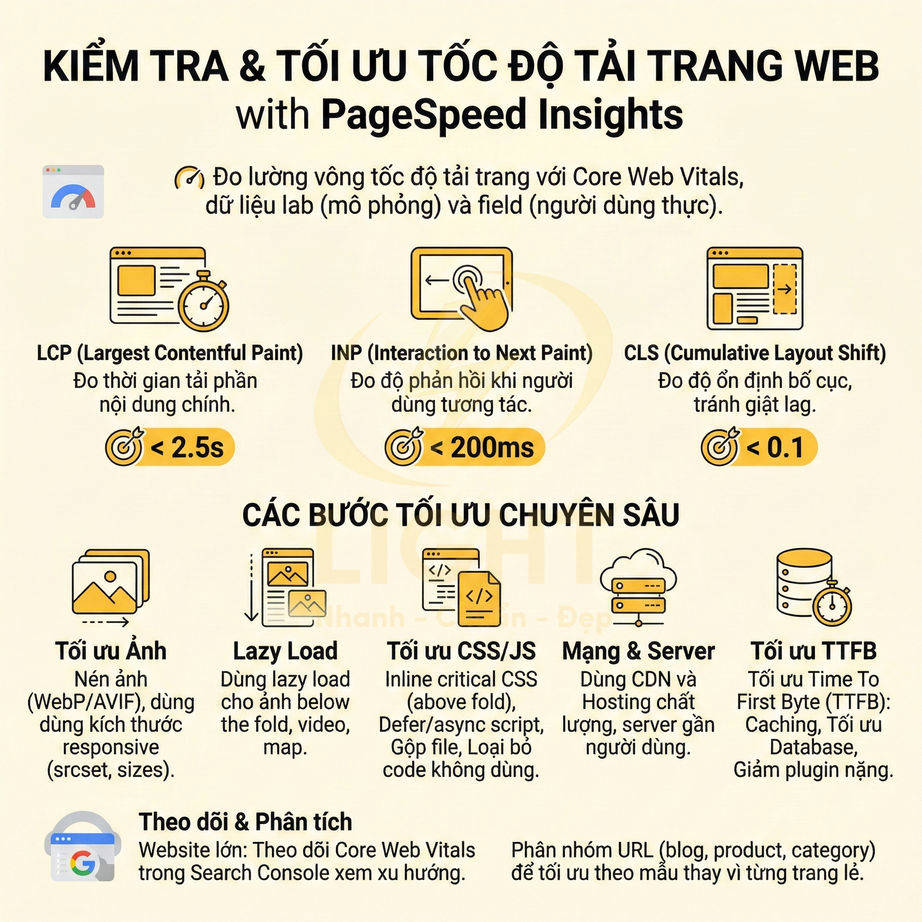

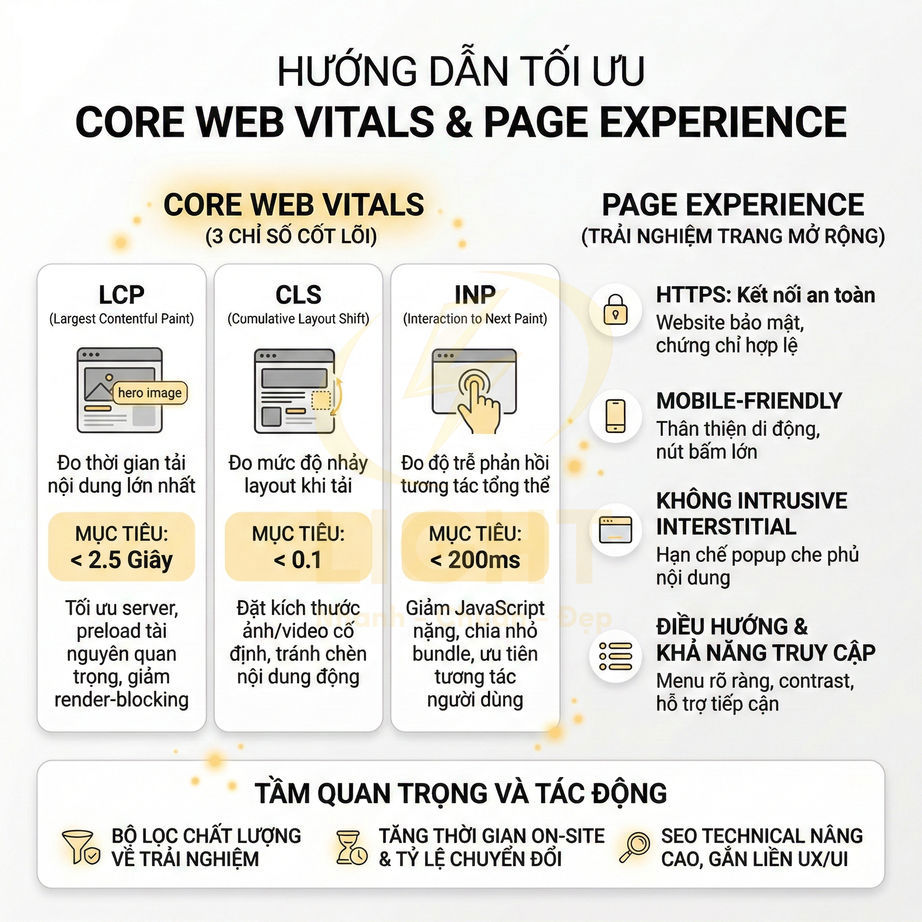

Kiểm tra tốc độ tải trang với PageSpeed Insights

Tốc độ tải trang được đo bằng bộ chỉ số Core Web Vitals, kết hợp dữ liệu lab (mô phỏng) và field (người dùng thực). Trong PageSpeed Insights, chú ý ba chỉ số: LCP (Largest Contentful Paint) đo thời gian tải phần nội dung chính, nên < 2.5s; INP (Interaction to Next Paint) đo độ phản hồi khi người dùng tương tác, nên < 200ms; CLS (Cumulative Layout Shift) đo độ ổn định bố cục, nên < 0.1.

Để tối ưu chuyên sâu, có thể áp dụng:

- Nén ảnh bằng WebP/AVIF, dùng kích thước responsive (srcset, sizes) để tránh tải ảnh quá lớn trên mobile.

- Dùng lazy load cho ảnh dưới màn hình đầu tiên (below the fold) và iframe (video, map).

- Tối ưu CSS/JS:

- Inline critical CSS cho phần trên màn hình đầu tiên.

- Defer hoặc async các script không quan trọng.

- Giảm số lượng request bằng cách gộp file, loại bỏ CSS/JS không dùng.

- Dùng CDN và hosting chất lượng, ưu tiên server gần khu vực người dùng mục tiêu.

- Tối ưu TTFB (Time To First Byte) bằng caching, tối ưu database, giảm plugin nặng.

Đối với website lớn, nên theo dõi Core Web Vitals trong Search Console để xem xu hướng theo thời gian và phân nhóm URL (template blog, product, category) để tối ưu theo mẫu thay vì từng trang lẻ.

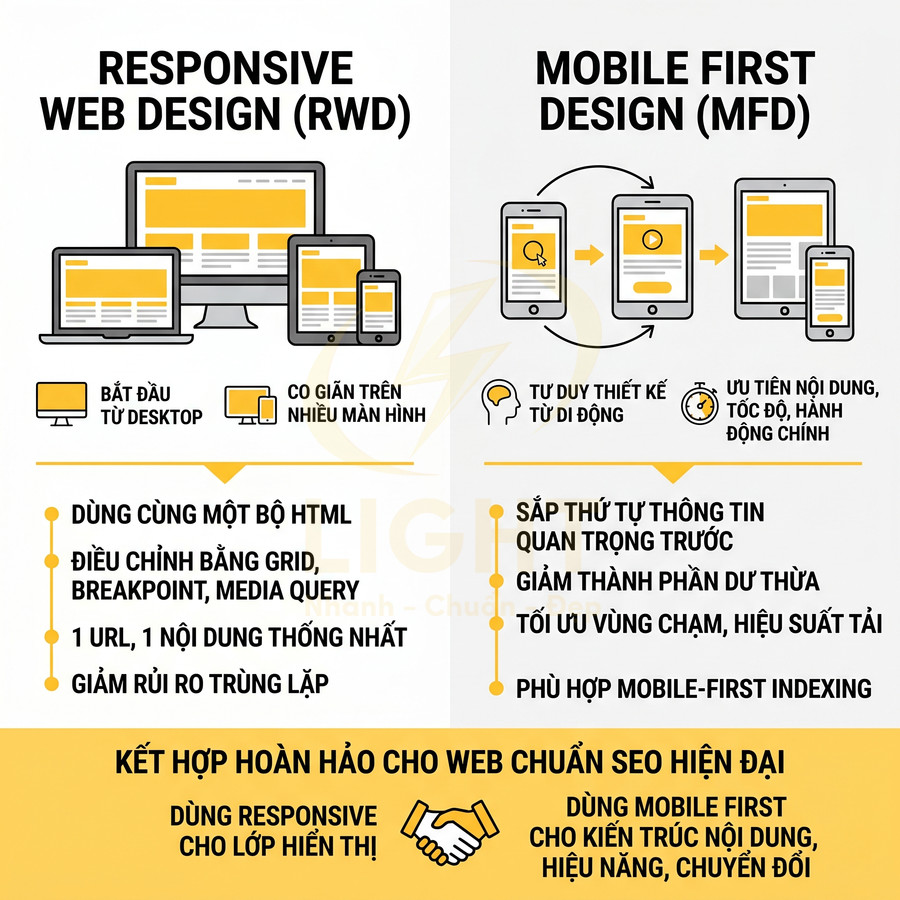

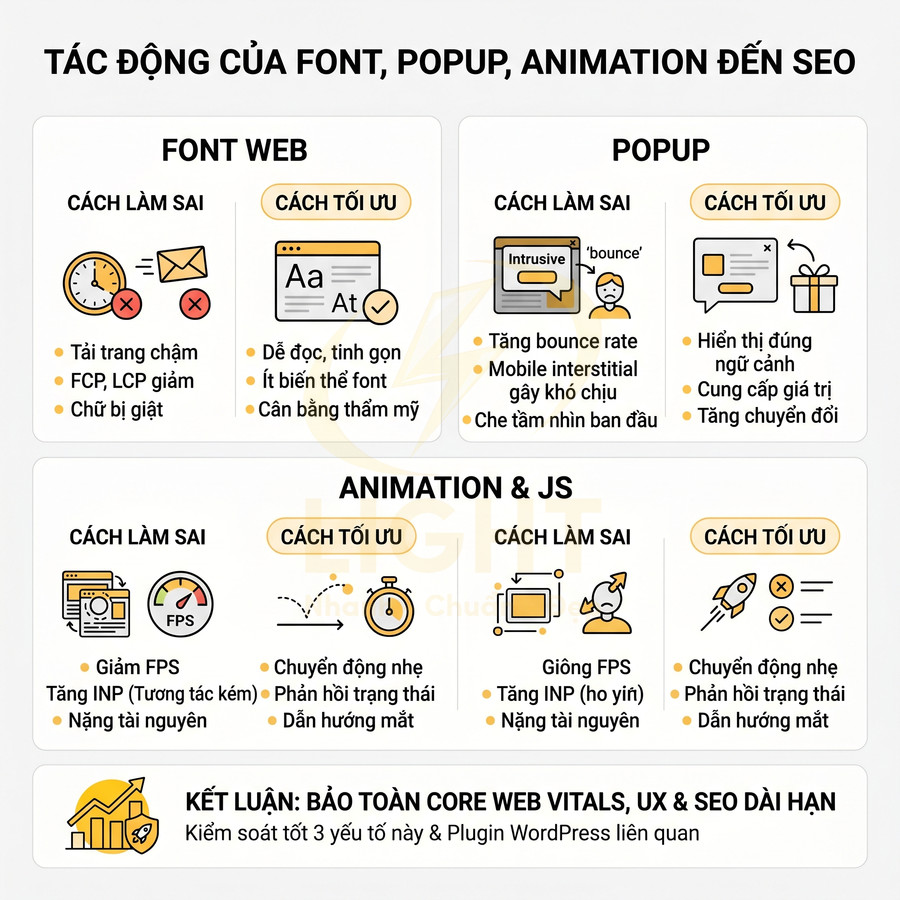

Kiểm tra Mobile-Friendly

Google ưu tiên mobile-first indexing, nên website phải hiển thị tốt trên thiết bị di động và nội dung trên mobile phải tương đương desktop. Dùng công cụ Mobile-Friendly Test hoặc báo cáo Page Experience trong Search Console để kiểm tra, đồng thời test thực tế trên nhiều kích thước màn hình.

Cần đảm bảo:

- Font đủ lớn (thường >= 16px), line-height thoáng để dễ đọc.

- Khoảng cách giữa các nút bấm hợp lý, kích thước tap target đủ lớn để tránh bấm nhầm.

- Không dùng pop-up che toàn màn hình, đặc biệt là intrusive interstitial ngay khi vào trang; nếu cần, nên dùng banner nhỏ, xuất hiện trễ.

- Bố cục responsive, không có nội dung bị tràn hoặc phải zoom ngang để đọc.

- Menu mobile (hamburger, off-canvas) rõ ràng, dễ thao tác, không ẩn quá sâu các trang quan trọng.

Ở mức chuyên sâu, cần kiểm tra thêm:

- Khả năng crawl và render JavaScript trên mobile: dùng chế độ “View crawled page” trong Search Console để xem Googlebot Smartphone nhìn thấy gì.

- Đảm bảo nội dung chính, internal link, structured data trên mobile không bị cắt bớt so với desktop.

- Kiểm tra tốc độ riêng cho mobile vì kết nối di động thường chậm hơn, ảnh hưởng mạnh đến LCP và INP.

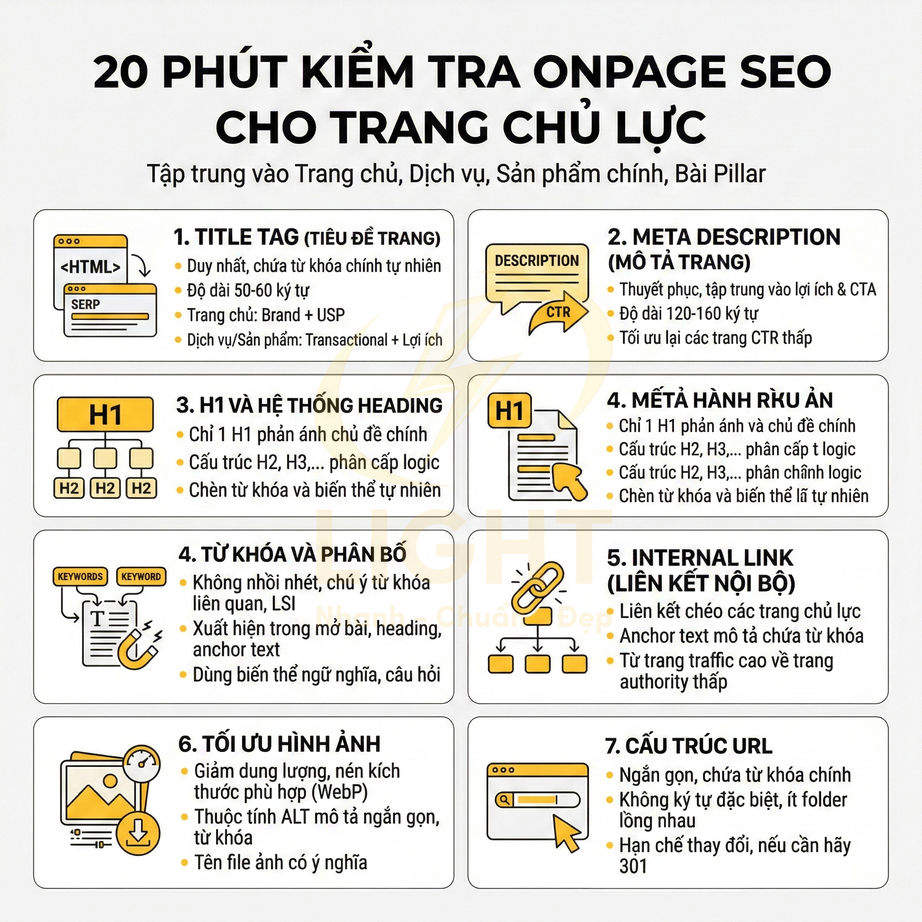

Bước 2: Kiểm tra SEO Onpage từng trang

Kiểm tra SEO Onpage từng trang là bước chuẩn hóa lớp tín hiệu giúp công cụ tìm kiếm hiểu đúng chủ đề, mức độ liên quan và giá trị nội dung. Từ Title, Meta Description, cấu trúc Heading đến tối ưu từ khóa theo Search Intent, mỗi yếu tố đều góp phần định hình khả năng hiển thị và CTR trên SERP. Song song đó, internal link, hình ảnh chuẩn SEO và đánh giá theo tiêu chuẩn EEAT quyết định độ tin cậy, chiều sâu chuyên môn và hiệu suất crawl. Một quy trình audit chặt chẽ không chỉ phát hiện lỗi kỹ thuật mà còn tối ưu cấu trúc ngữ nghĩa, giảm cannibalization và củng cố nền tảng xếp hạng bền vững.

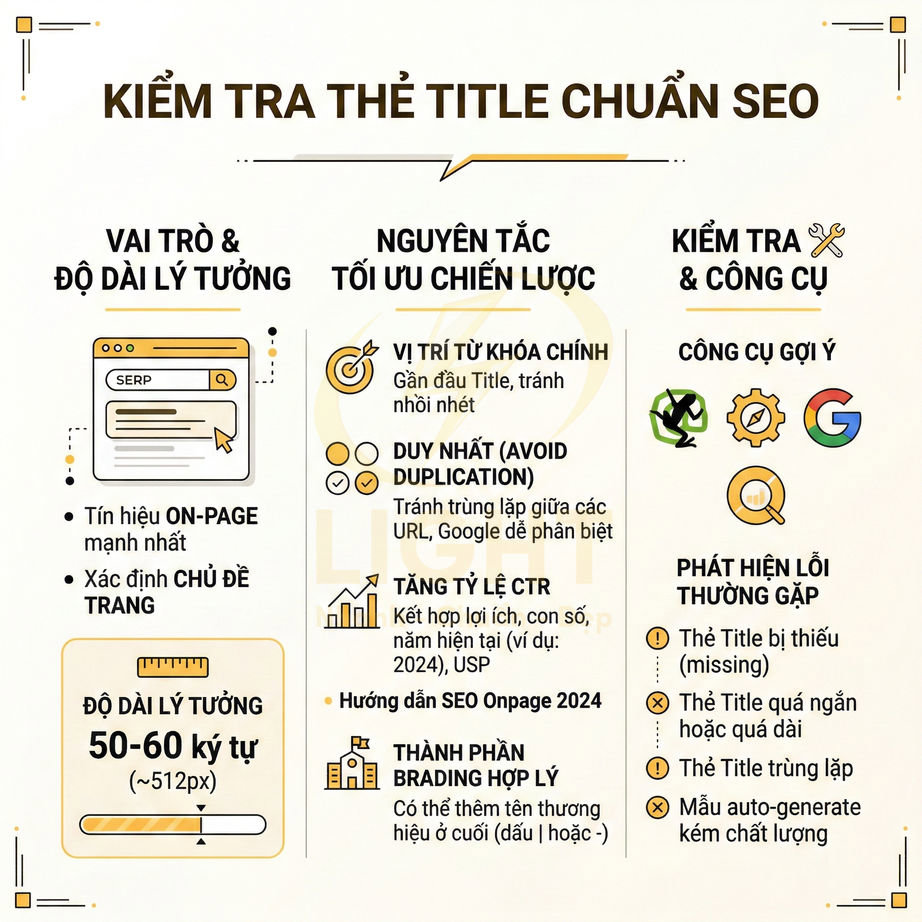

Kiểm tra thẻ Title chuẩn SEO

Thẻ Title là tín hiệu onpage mạnh nhất giúp công cụ tìm kiếm xác định chủ đề chính của trang và cũng là yếu tố đầu tiên người dùng nhìn thấy trên SERP. Ngoài độ dài lý tưởng khoảng 50–60 ký tự (tương ứng khoảng 512px trên desktop), cần chú ý thêm các khía cạnh kỹ thuật và chiến lược sau:

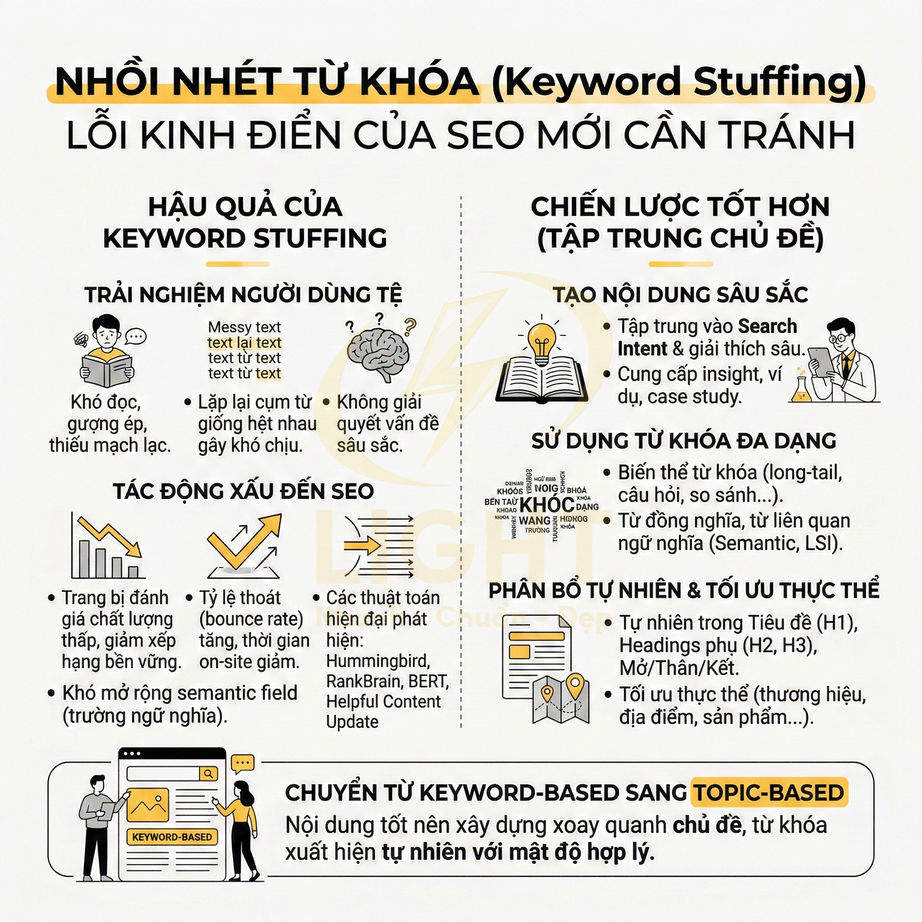

- Vị trí từ khóa chính: Đặt từ khóa chính càng gần đầu Title càng tốt để tăng mức độ liên quan và khả năng được bôi đậm trên SERP. Tuy nhiên, tránh nhồi nhét từ khóa lặp lại nhiều lần.

- Tránh trùng lặp Title: Mỗi URL phải có Title duy nhất. Trùng lặp Title ở quy mô lớn có thể khiến Google khó phân biệt trang nào quan trọng hơn, dẫn đến hiện tượng “cannibalization” hoặc chọn sai trang để hiển thị.

- Thêm yếu tố thu hút CTR: Kết hợp lợi ích rõ ràng (benefit-driven), con số, năm hiện tại, hoặc yếu tố độc đáo (USP) để tăng tỉ lệ nhấp. Ví dụ: “Hướng dẫn SEO Onpage chi tiết 2024 cho website mới”.

- Tránh sử dụng toàn chữ in hoa hoặc ký tự đặc biệt quá nhiều vì có thể bị xem là spam và làm giảm trải nghiệm người dùng.

- Branding hợp lý: Với các trang quan trọng (homepage, landing chính), có thể thêm tên thương hiệu ở cuối Title, ngăn cách bằng “|” hoặc “-”, nhưng không nên để brand chiếm quá nhiều ký tự.

Khi kiểm tra, nên sử dụng các công cụ như Screaming Frog, Ahrefs Site Audit hoặc GSC để phát hiện:

- Title bị thiếu (missing)

- Title quá ngắn hoặc quá dài

- Title trùng lặp giữa nhiều URL

- Title chứa các mẫu auto-generate kém chất lượng (ví dụ: “Trang chủ”, “Sản phẩm”, “Bài viết mới” không có ngữ cảnh)

Kiểm tra Meta Description

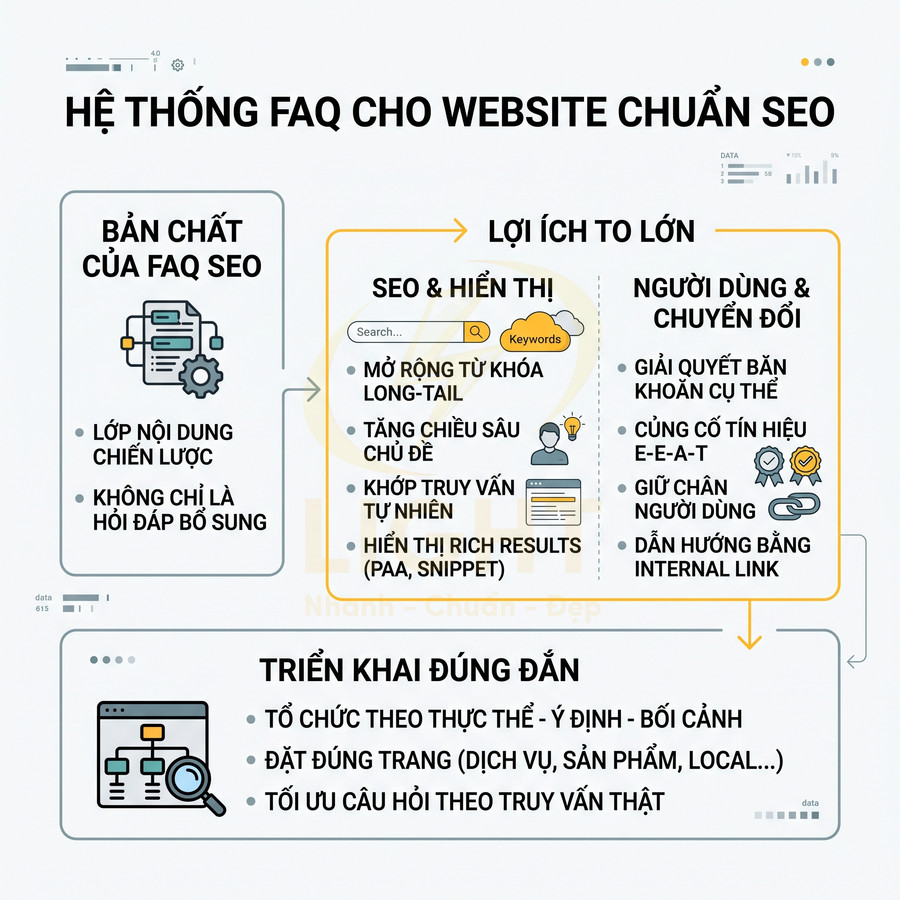

Meta Description là đoạn mô tả tóm tắt nội dung trang, tuy không phải là yếu tố xếp hạng trực tiếp nhưng ảnh hưởng mạnh đến CTR và gián tiếp tác động đến hiệu suất SEO. Khi tối ưu, cần chú ý:

- Độ dài hiển thị: Khoảng 120–155 ký tự trên desktop, có thể ngắn hơn trên mobile. Nếu quá dài, Google sẽ cắt và thêm “...”, làm giảm tính thuyết phục.

- Chứa từ khóa chính và từ khóa phụ một cách tự nhiên. Khi truy vấn khớp, Google thường bôi đậm các từ khóa trong Description, giúp tăng khả năng thu hút ánh nhìn.

- Mô tả đúng nội dung trang: Không “clickbait” hoặc hứa hẹn những nội dung không tồn tại trong trang, vì sẽ làm tăng bounce rate và giảm mức độ tin cậy.

- Có CTA rõ ràng như “Tìm hiểu chi tiết”, “Xem bảng so sánh”, “Nhận checklist miễn phí”… để định hướng hành động tiếp theo của người dùng.

- Tránh trùng lặp mô tả cho nhiều trang, đặc biệt với các trang danh mục, tag, filter. Mỗi trang nên có mô tả riêng phản ánh đúng mục đích và nội dung.

Khi audit, cần kiểm tra thêm:

- Các trang không có Meta Description, khiến Google tự động tạo snippet (thường kém tối ưu).

- Các trang có Description nhưng không liên quan đến truy vấn mục tiêu hoặc không còn phù hợp với nội dung đã cập nhật.

- Các trang có Description nhồi nhét từ khóa, lặp lại cụm từ giống hệt nhiều lần, dễ bị đánh giá là spam.

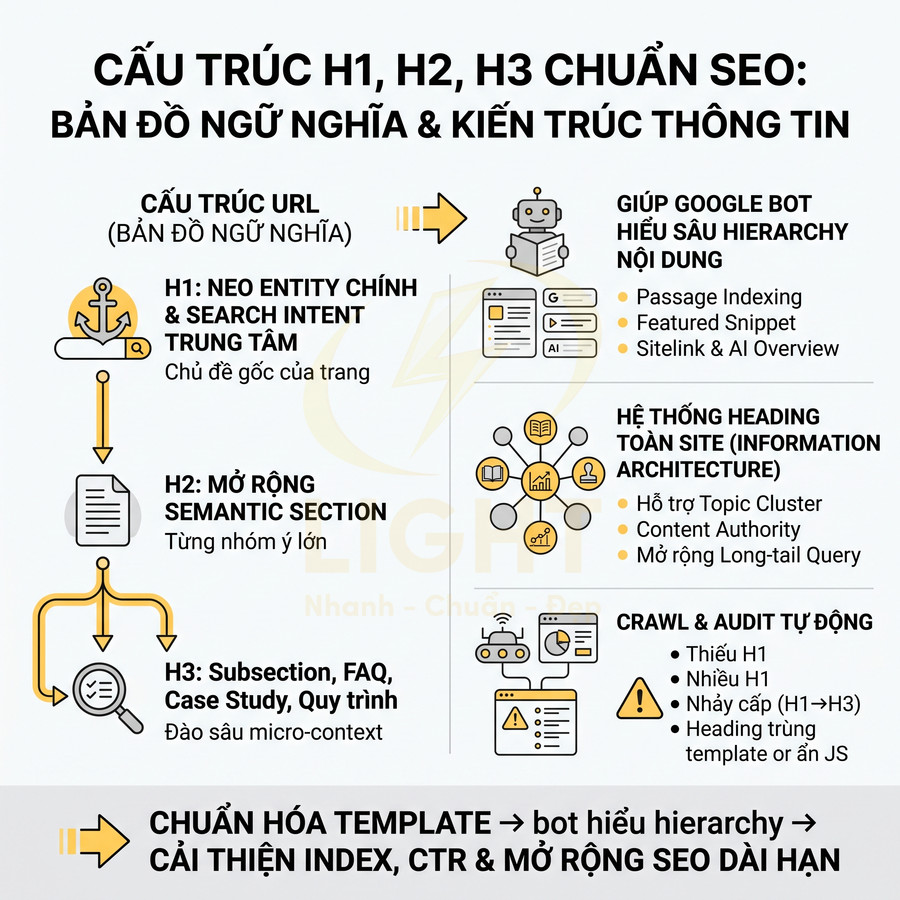

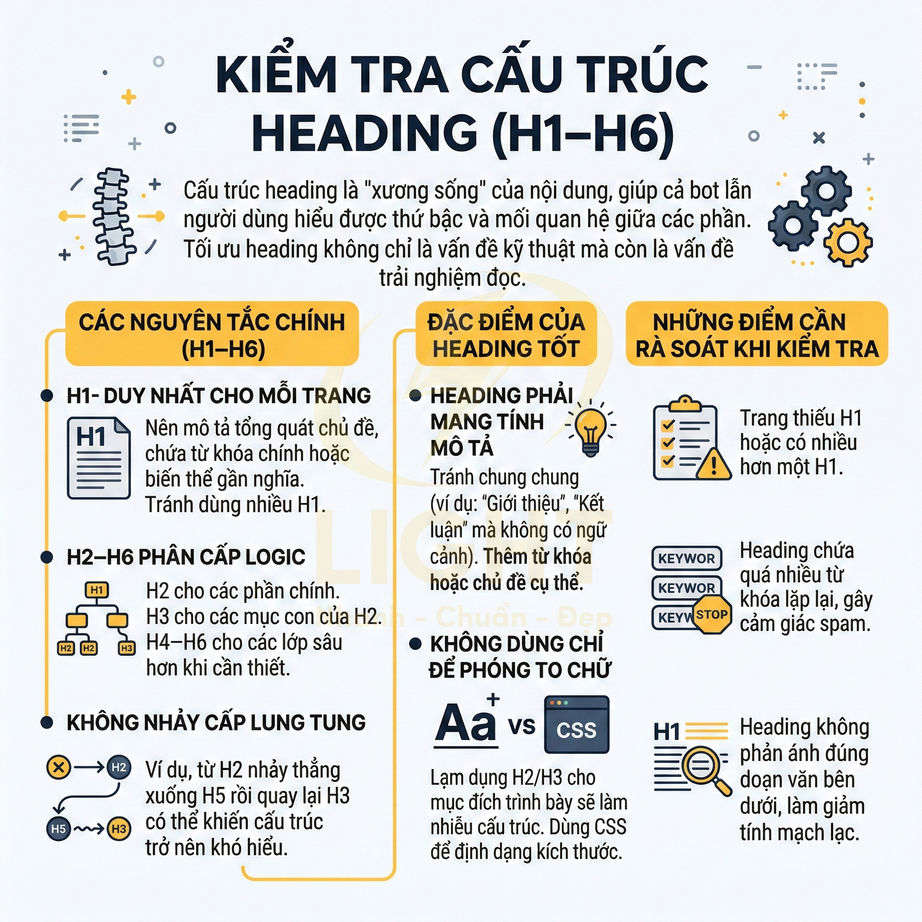

Kiểm tra cấu trúc Heading (H1–H6)

Cấu trúc heading là “xương sống” của nội dung, giúp cả bot lẫn người dùng hiểu được thứ bậc và mối quan hệ giữa các phần. Tối ưu heading không chỉ là vấn đề kỹ thuật mà còn là vấn đề trải nghiệm đọc:

- H1 duy nhất cho mỗi trang: H1 nên mô tả tổng quát chủ đề, chứa từ khóa chính hoặc biến thể gần nghĩa. Tránh dùng nhiều H1 trên cùng một trang (trừ một số trường hợp đặc biệt như theme cũ hoặc AMP, nhưng vẫn nên chuẩn hóa).

- H2–H6 phân cấp logic:

- H2 cho các phần chính của nội dung.

- H3 cho các mục con của H2.

- H4–H6 cho các lớp sâu hơn khi thực sự cần thiết.

- Không nhảy cấp lung tung: Ví dụ, từ H2 nhảy thẳng xuống H5 rồi quay lại H3 có thể khiến cấu trúc trở nên khó hiểu, đặc biệt với các công cụ hỗ trợ đọc màn hình.

- Heading phải mang tính mô tả: Tránh dùng các heading chung chung như “Giới thiệu”, “Kết luận” cho nhiều bài mà không có ngữ cảnh. Nên thêm từ khóa hoặc chủ đề cụ thể để tăng độ liên quan.

- Không dùng heading chỉ để phóng to chữ: Việc lạm dụng H2/H3 cho mục đích trình bày sẽ làm nhiễu cấu trúc nội dung. Thay vào đó, sử dụng CSS để định dạng kích thước.

Khi kiểm tra, nên rà soát:

- Trang thiếu H1 hoặc có nhiều hơn một H1.

- Heading chứa quá nhiều từ khóa lặp lại, gây cảm giác spam.

- Heading không phản ánh đúng nội dung đoạn văn bên dưới, làm giảm tính mạch lạc.

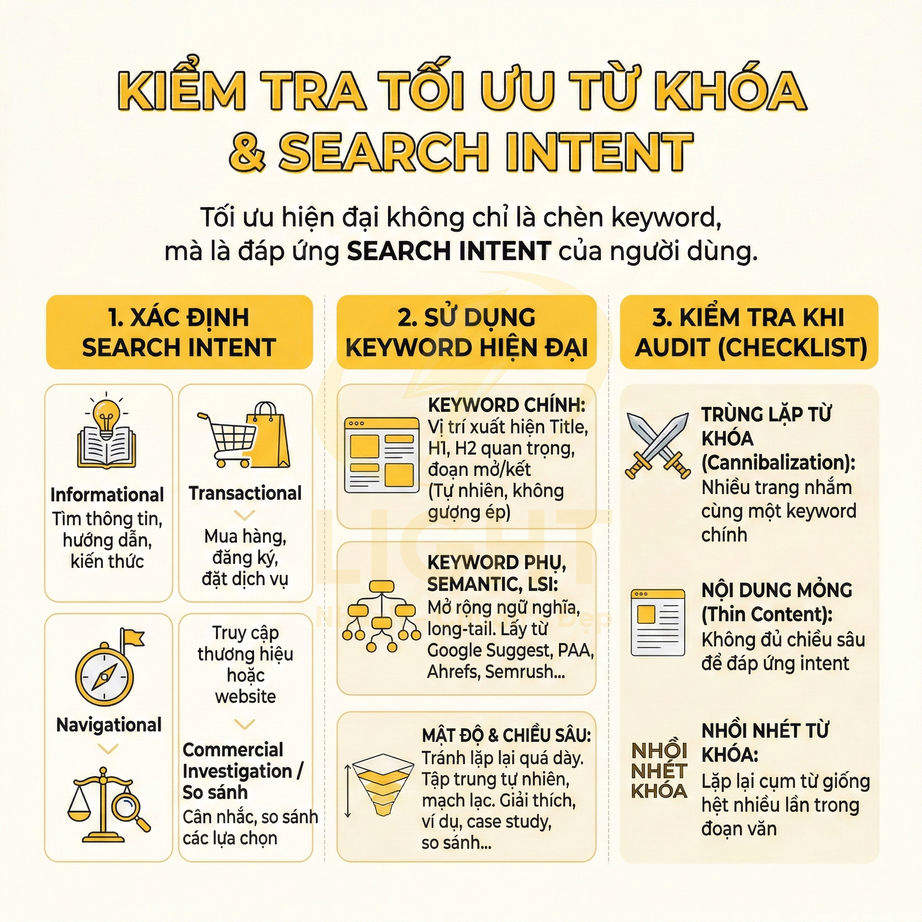

Kiểm tra tối ưu từ khóa và Search Intent

Tối ưu từ khóa hiện đại không chỉ là chèn keyword vào nội dung mà là đáp ứng trọn vẹn Search Intent của người dùng. Mỗi trang nên được xây dựng xoay quanh một “topic” với một keyword chính và cụm từ khóa liên quan:

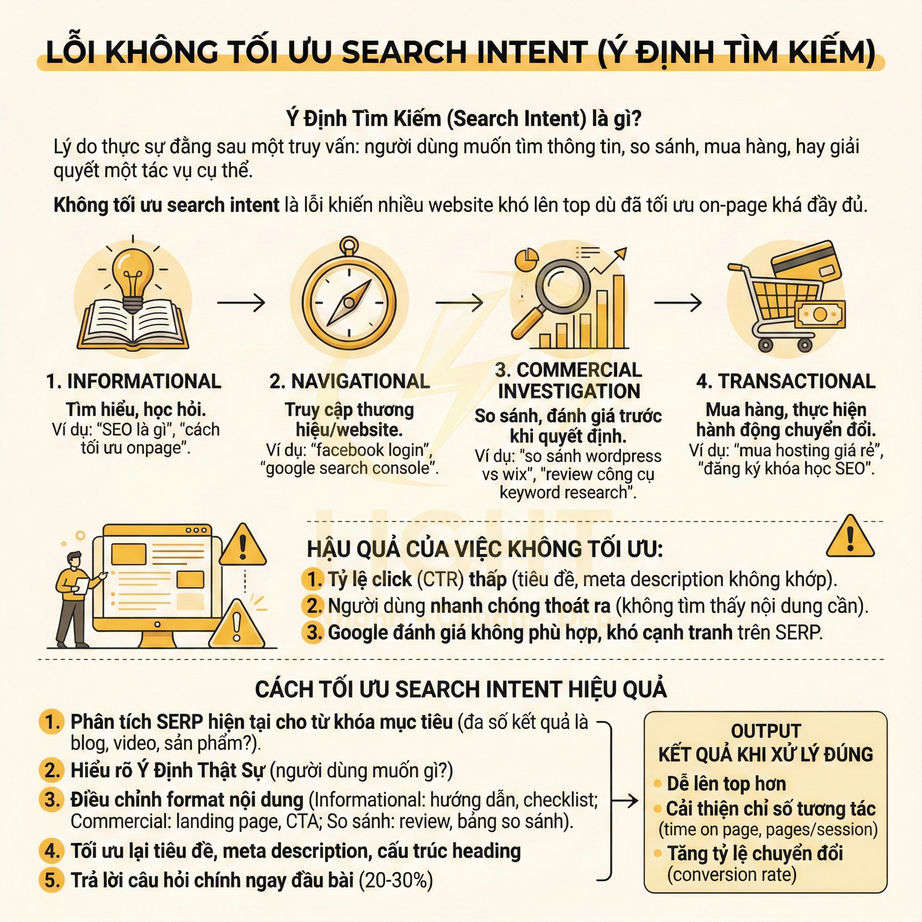

- Xác định Search Intent:

- Informational: Người dùng muốn tìm thông tin, hướng dẫn, kiến thức.

- Transactional: Người dùng có ý định mua hàng, đăng ký, đặt dịch vụ.

- Navigational: Người dùng muốn truy cập một thương hiệu hoặc website cụ thể.

- Commercial investigation / so sánh: Người dùng đang cân nhắc, so sánh các lựa chọn.

- Keyword chính: Xuất hiện ở Title, H1, một vài H2 quan trọng, đoạn mở đầu và kết thúc, nhưng phải tự nhiên, không gượng ép.

- Keyword phụ, semantic, LSI:

- Dùng để mở rộng ngữ nghĩa, bao phủ nhiều biến thể truy vấn dài (long-tail).

- Có thể lấy từ Google Suggest, People Also Ask, Related Searches, hoặc các công cụ như Ahrefs, Semrush.

- Mật độ từ khóa: Không còn một con số “chuẩn” cố định, nhưng nên tránh lặp lại quá dày trong một đoạn ngắn. Tập trung vào sự tự nhiên, mạch lạc và chiều sâu nội dung.

- Chiều sâu nội dung: Thay vì lặp lại keyword, hãy giải thích khái niệm, đưa ví dụ, case study, bảng so sánh, quy trình từng bước… để tăng độ liên quan ngữ nghĩa.

Khái niệm search intent được nghiên cứu sâu trong lĩnh vực information retrieval. Trong nghiên cứu phân loại truy vấn nổi tiếng của Andrei Broder tại AltaVista, truy vấn tìm kiếm được chia thành ba nhóm chính: informational, navigational và transactional. Phân loại này giúp hệ thống tìm kiếm hiểu mục đích thực sự của người dùng và lựa chọn loại tài liệu phù hợp nhất để hiển thị. Các nghiên cứu sau này tiếp tục mở rộng mô hình này với các truy vấn so sánh hoặc nghiên cứu thương mại. Việc xây dựng nội dung phù hợp với intent giúp cải thiện mức độ liên quan và tăng khả năng xếp hạng của trang (Broder, 2002, A Taxonomy of Web Search).

Khi audit, cần kiểm tra:

- Các trang nhắm cùng một keyword chính, gây cannibalization.

- Các trang có nội dung mỏng (thin content), không đủ chiều sâu để đáp ứng intent.

- Các đoạn văn nhồi nhét keyword, lặp lại cụm từ giống hệt nhiều lần trong một câu hoặc một đoạn.

Kiểm tra nội dung theo tiêu chuẩn EEAT

EEAT (Experience, Expertise, Authoritativeness, Trustworthiness) là khung đánh giá chất lượng nội dung cốt lõi trong Search Quality Rater Guidelines. Đặc biệt với các chủ đề YMYL (Your Money Your Life), việc thể hiện EEAT là bắt buộc nếu muốn duy trì thứ hạng ổn định:

- Experience (Trải nghiệm thực tế):

- Thể hiện qua case study, ví dụ thực tế, hình ảnh hoặc dữ liệu từ dự án đã triển khai.

- Mô tả quy trình, bước làm, kết quả, khó khăn và cách xử lý, thay vì chỉ nói lý thuyết chung chung.

- Expertise (Chuyên môn):

- Có tác giả rõ ràng với bio chi tiết: chức danh, kinh nghiệm, chứng chỉ, đơn vị công tác.

- Nội dung sử dụng thuật ngữ chuyên ngành đúng ngữ cảnh, có giải thích cho người mới.

- Authoritativeness (Độ uy tín):

- Website có trang giới thiệu, thông tin doanh nghiệp, địa chỉ, kênh liên hệ minh bạch.

- Nội dung được các nguồn uy tín khác trích dẫn hoặc liên kết (backlink chất lượng).

- Trustworthiness (Độ tin cậy):

- Trích dẫn nguồn tham khảo uy tín như tài liệu nghiên cứu, website chính thống, guideline từ Google.

- Cập nhật ngày viết, ngày chỉnh sửa, đặc biệt với nội dung liên quan đến tài chính, sức khỏe, pháp lý.

- Chính sách bảo mật, điều khoản sử dụng, thông tin thanh toán (với site thương mại) rõ ràng.

Khi kiểm tra, cần đánh giá:

- Bài viết không có tên tác giả, không có trang giới thiệu tác giả hoặc thông tin chuyên môn mơ hồ.

- Nội dung cũ, số liệu lỗi thời, dẫn đến thông tin sai lệch so với thực tế hiện tại.

- Thiếu dẫn nguồn cho các số liệu, trích dẫn, khuyến nghị quan trọng.

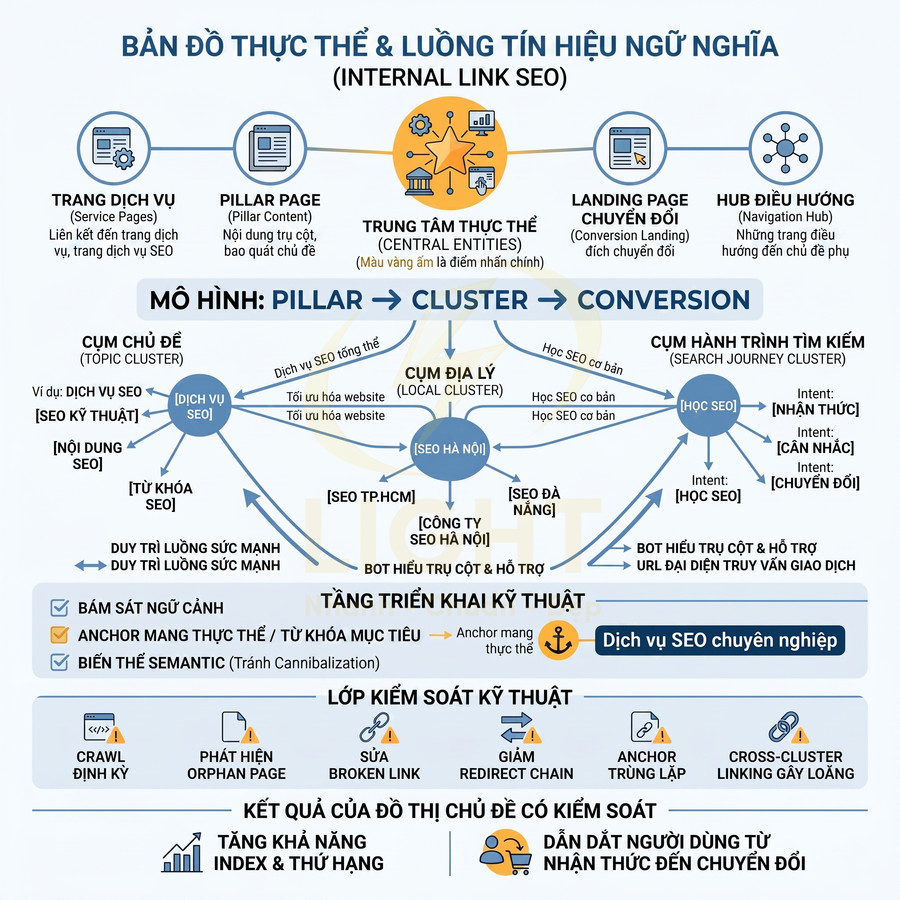

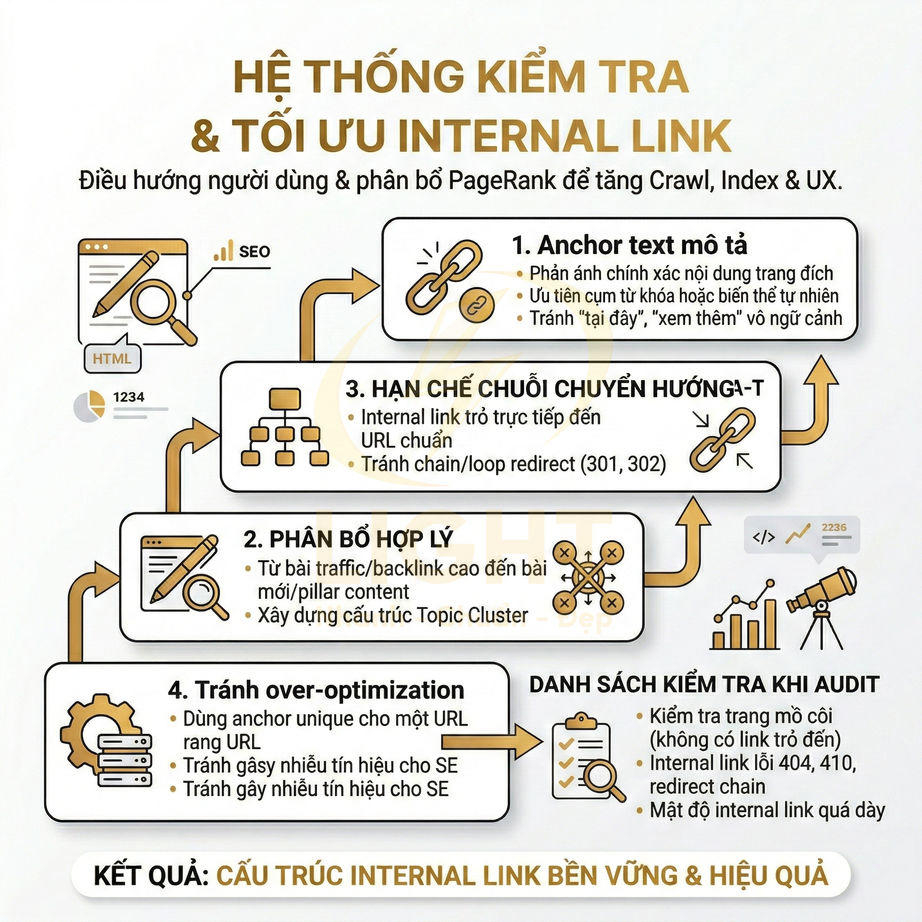

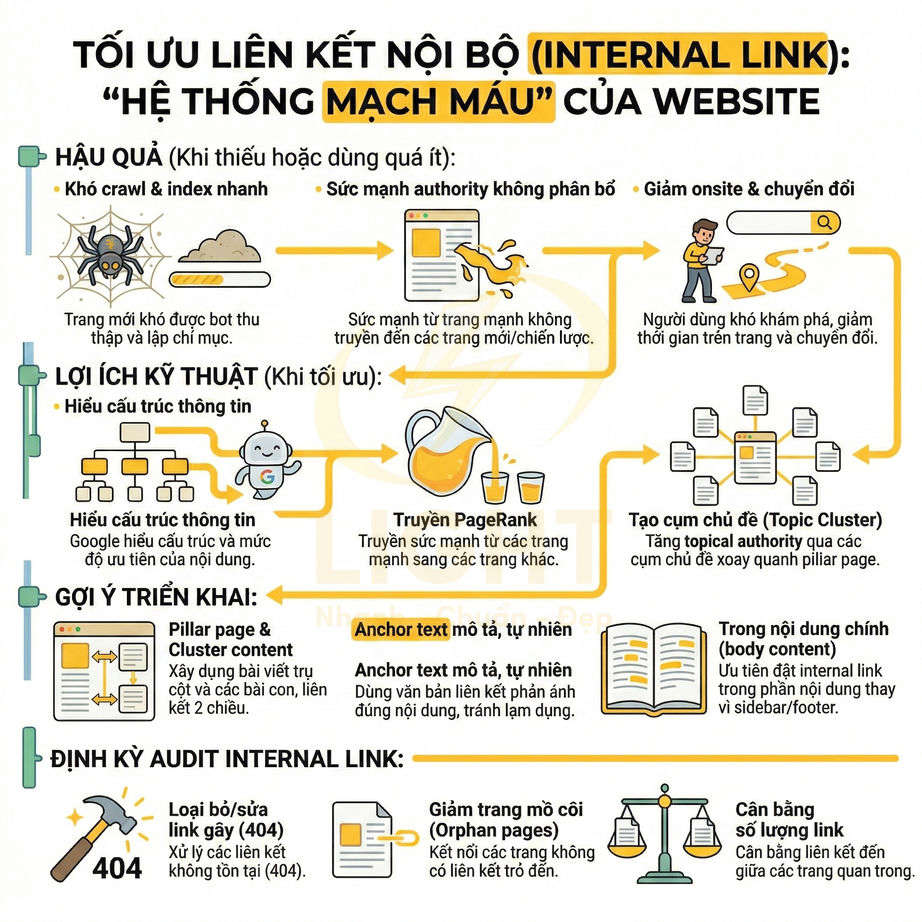

Kiểm tra Internal Link

Internal link là công cụ điều hướng và phân bổ PageRank trong nội bộ website. Một cấu trúc internal link tốt giúp:

- Tăng khả năng crawl và index của các trang sâu.

- Chuyển sức mạnh từ các trang có nhiều backlink/traffic sang các trang mới hoặc trang chiến lược.

- Cải thiện trải nghiệm người dùng bằng cách gợi ý nội dung liên quan.

Khái niệm phân bổ sức mạnh liên kết nội bộ xuất phát từ thuật toán PageRank, được phát triển bởi Sergey Brin và Lawrence Page. Theo mô hình toán học của thuật toán này, mỗi liên kết từ một trang được xem như một “phiếu bầu” chuyển giá trị uy tín đến trang đích. Khi nhiều trang có độ tin cậy cao liên kết đến một URL, xác suất trang đó được đánh giá quan trọng trong đồ thị web sẽ tăng lên. Nghiên cứu chỉ ra rằng cấu trúc liên kết nội bộ hợp lý giúp phân phối PageRank hiệu quả trong toàn bộ website và cải thiện khả năng xếp hạng của các trang chiến lược (Page et al., 1999, The PageRank Citation Ranking).

Khi tối ưu, cần chú ý:

- Anchor text mô tả:

- Sử dụng anchor text phản ánh chính xác nội dung trang đích, ưu tiên cụm từ khóa hoặc biến thể tự nhiên.

- Tránh dùng quá nhiều anchor chung chung như “tại đây”, “xem thêm” mà không có ngữ cảnh.

- Phân bổ hợp lý:

- Ưu tiên liên kết từ các bài có nhiều traffic, nhiều backlink đến các bài mới hoặc pillar content.

- Tạo cấu trúc “topic cluster”: một trang trụ cột (pillar) liên kết đến các bài con (cluster) và ngược lại.

- Hạn chế chuỗi chuyển hướng:

- Internal link nên trỏ trực tiếp đến URL chuẩn (canonical), tránh đi qua nhiều bước redirect (301, 302).

- Chuỗi redirect dài làm lãng phí crawl budget và làm chậm thời gian tải trang.

- Tránh over-optimization: Không dùng cùng một anchor text trỏ đến nhiều URL khác nhau, dễ gây nhiễu tín hiệu cho công cụ tìm kiếm.

Khi audit, nên kiểm tra:

- Các trang mồ côi (orphan pages) không có internal link trỏ đến.

- Các internal link bị lỗi 404, 410 hoặc redirect chain/loop.

- Mật độ internal link quá dày trong một đoạn ngắn, gây rối mắt cho người đọc.

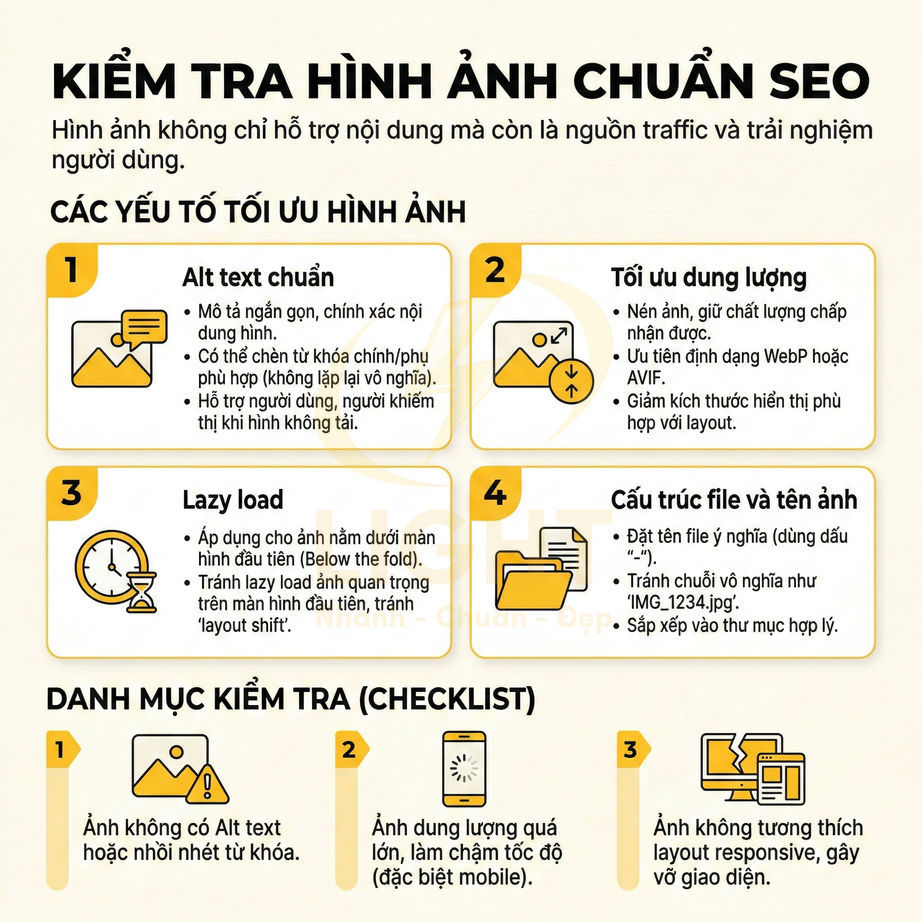

Kiểm tra hình ảnh chuẩn SEO

Hình ảnh chuẩn SEO không chỉ hỗ trợ nội dung mà còn là nguồn traffic tiềm năng từ Google Images và góp phần quan trọng vào trải nghiệm người dùng, Core Web Vitals. Khi tối ưu hình ảnh, cần chú ý:

- Alt text chuẩn:

- Mô tả ngắn gọn, chính xác nội dung hình, ưu tiên ngôn ngữ tự nhiên.

- Có thể chèn từ khóa chính hoặc phụ nếu phù hợp, nhưng không lặp lại từ khóa vô nghĩa.

- Hỗ trợ người dùng khi hình không tải được và hỗ trợ công cụ đọc màn hình cho người khiếm thị.

- Tối ưu dung lượng:

- Nén ảnh bằng các công cụ chuyên dụng, giữ chất lượng ở mức chấp nhận được.

- Ưu tiên định dạng WebP hoặc AVIF để giảm kích thước so với JPEG/PNG truyền thống.

- Giảm kích thước hiển thị (dimension) phù hợp với layout, tránh upload ảnh quá lớn rồi thu nhỏ bằng CSS.

- Lazy load:

- Áp dụng lazy load cho các ảnh nằm dưới màn hình đầu tiên (below the fold) để cải thiện LCP và FCP.

- Đảm bảo ảnh quan trọng trên màn hình đầu tiên không bị lazy load quá mức, tránh gây hiện tượng “layout shift”.

- Cấu trúc file và tên ảnh:

- Đặt tên file ảnh có ý nghĩa, dùng dấu “-” để ngăn cách từ, tránh dùng chuỗi ký tự vô nghĩa như “IMG_1234.jpg”.

- Sắp xếp ảnh vào thư mục hợp lý để dễ quản lý và tránh trùng lặp.

Khi kiểm tra, cần rà soát:

- Ảnh không có Alt text hoặc Alt text bị nhồi nhét từ khóa.

- Ảnh dung lượng quá lớn, ảnh hưởng đến tốc độ tải trang, đặc biệt trên mobile.

- Ảnh không tương thích với layout responsive, gây vỡ giao diện trên các kích thước màn hình khác nhau.

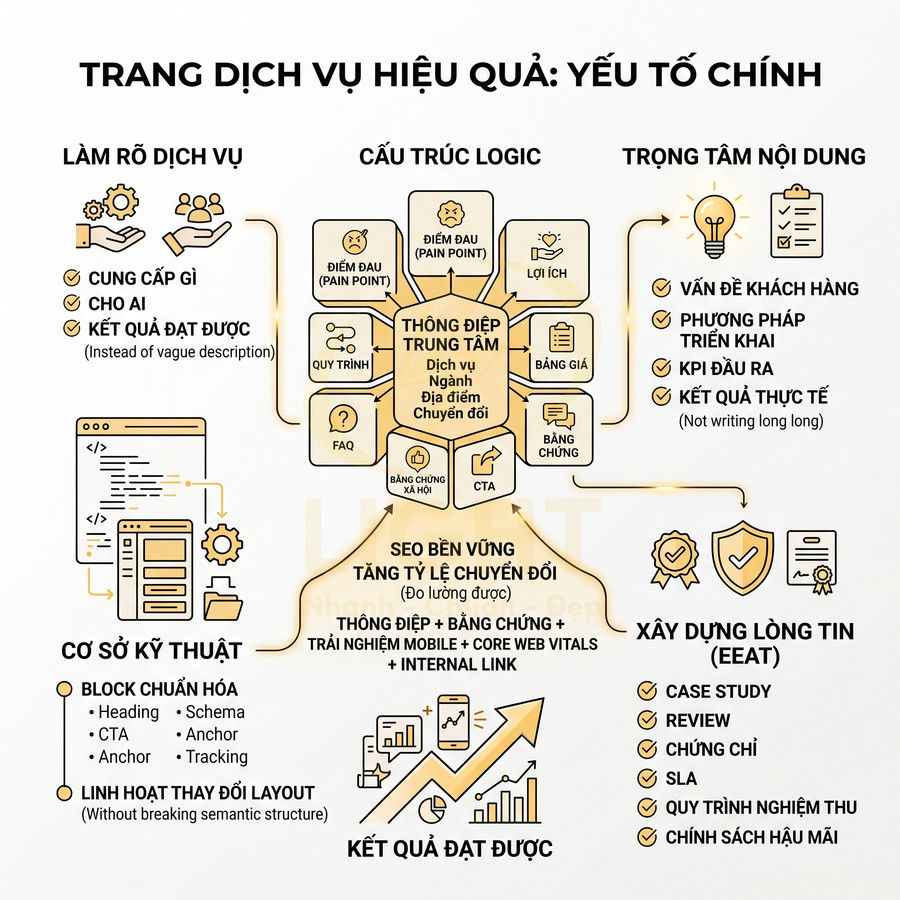

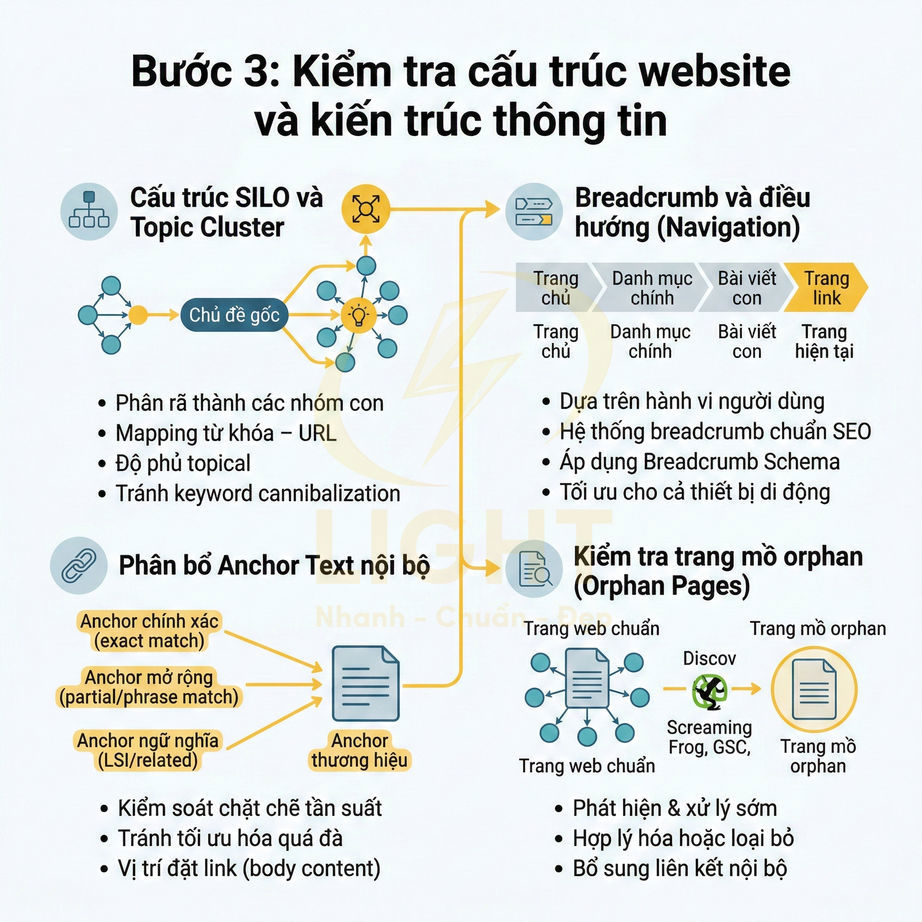

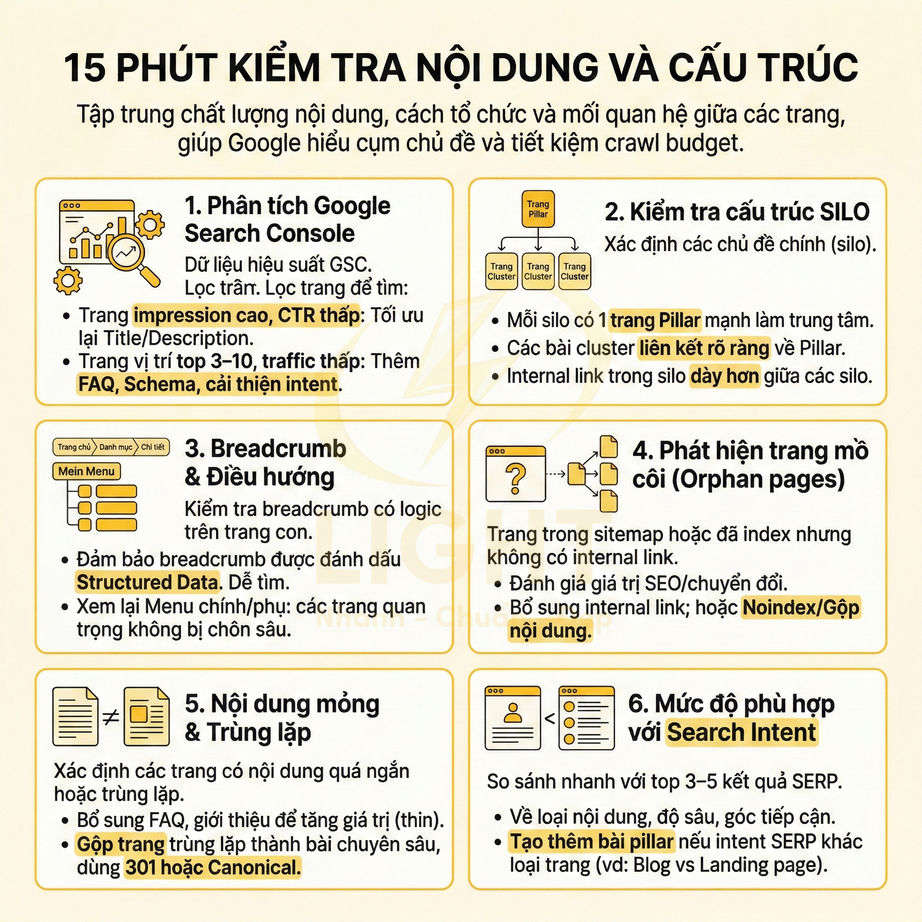

Bước 3: Kiểm tra cấu trúc website và kiến trúc thông tin

Kiểm tra cấu trúc website và kiến trúc thông tin là bước then chốt để đảm bảo nền tảng SEO bền vững và khả năng mở rộng dài hạn. Mô hình SILO và Topic Cluster giúp tổ chức nội dung theo logic ngữ nghĩa, củng cố topical authority và định hướng phân bổ sức mạnh nội bộ. Hệ thống breadcrumb, navigation và chiến lược anchor text nội bộ đóng vai trò điều hướng cả người dùng lẫn bot tìm kiếm, tối ưu crawl depth và ngữ cảnh xếp hạng. Đồng thời, việc phát hiện và xử lý orphan page giúp duy trì cấu trúc liên kết chặt chẽ, tránh phân tán tín hiệu. Một kiến trúc thông tin rõ ràng tạo tiền đề cho thứ hạng ổn định, trải nghiệm mạch lạc và hiệu quả chuyển đổi cao hơn.

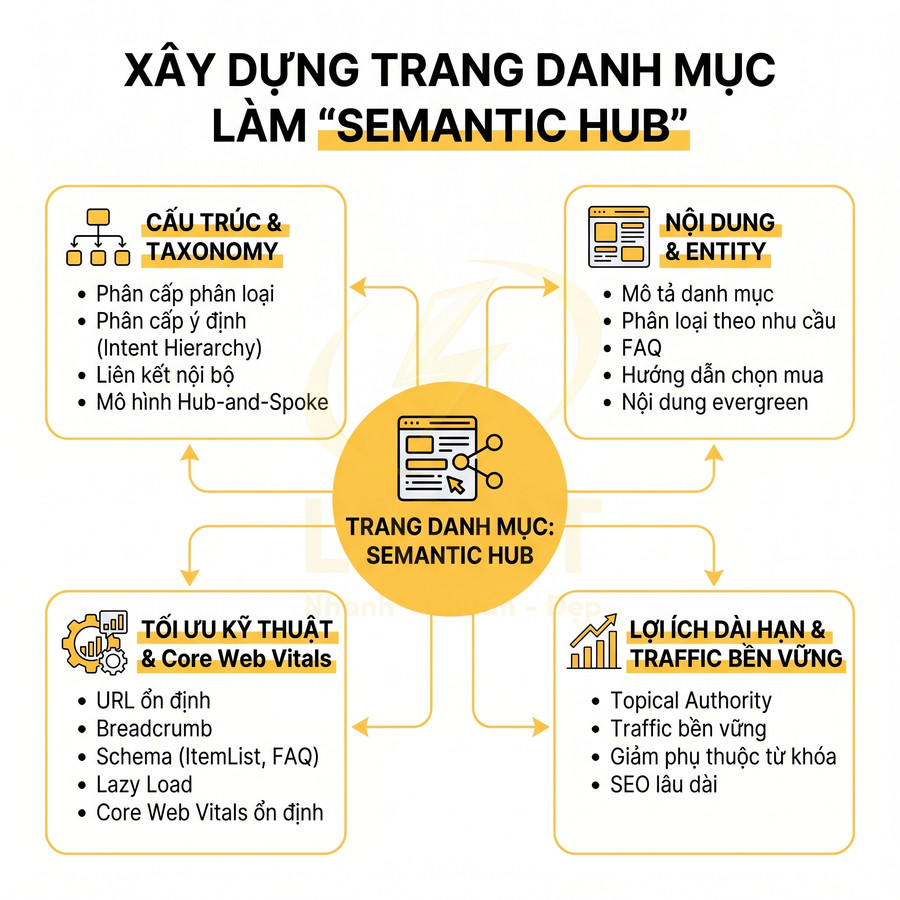

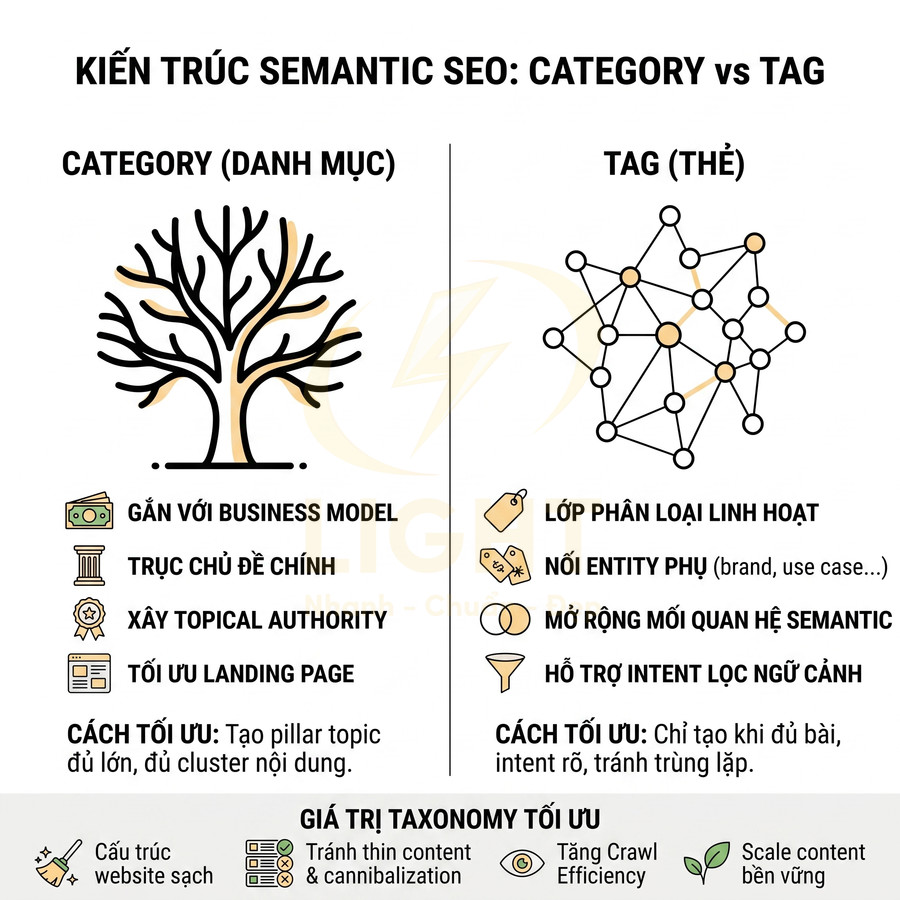

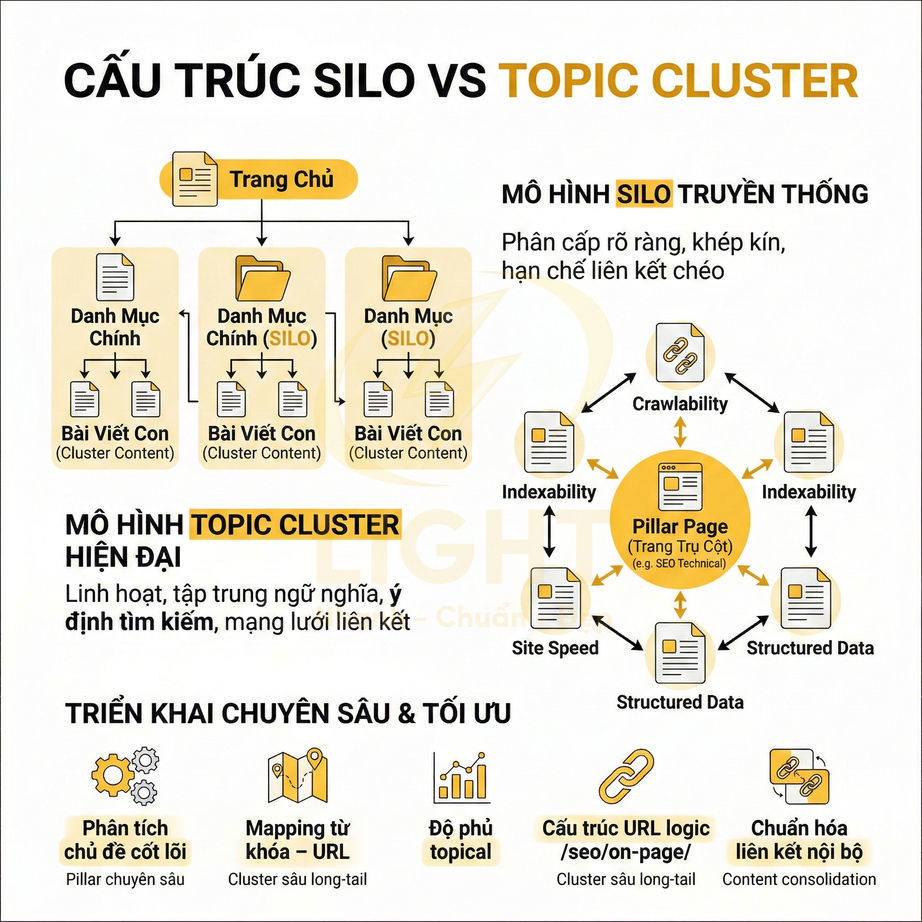

Cấu trúc SILO và Topic Cluster

Cấu trúc SILO và Topic Cluster là nền tảng của kiến trúc thông tin chuẩn SEO, giúp công cụ tìm kiếm hiểu rõ mối quan hệ ngữ nghĩa giữa các chủ đề, đồng thời phân bổ sức mạnh xếp hạng một cách có chiến lược. Thay vì để các bài viết tồn tại rời rạc, toàn bộ nội dung được gom thành các cụm chủ đề (cluster) xoay quanh một chủ đề trung tâm (pillar), tạo thành một mạng lưới liên kết nội bộ chặt chẽ và có định hướng.

Trong khoa học thông tin, việc tổ chức nội dung theo cụm chủ đề được gọi là topic clustering. Các nghiên cứu trong lĩnh vực phân cụm tài liệu chỉ ra rằng khi nội dung được nhóm theo các chủ đề liên quan, hệ thống tìm kiếm có thể hiểu rõ hơn mối quan hệ ngữ nghĩa giữa các tài liệu. Nghiên cứu của Christopher Manning tại Stanford University cho thấy các thuật toán phân cụm giúp cải thiện khả năng truy xuất thông tin bằng cách liên kết các tài liệu liên quan về mặt chủ đề. Việc áp dụng mô hình pillar-cluster trong SEO thực chất là áp dụng nguyên tắc phân cụm này vào kiến trúc website (Manning et al., 2008, Introduction to Information Retrieval).

Trong mô hình SILO truyền thống, cấu trúc thường mang tính phân cấp rõ ràng:

- Trang chủ > Danh mục chính (SILO) > Bài viết con

- Mỗi SILO gần như “khép kín”, hạn chế liên kết chéo sang SILO khác để giữ độ tập trung chủ đề.

Mô hình Topic Cluster hiện đại linh hoạt hơn, tập trung vào ngữ nghĩa và ý định tìm kiếm:

- Một pillar page bao quát toàn bộ chủ đề, nhắm các từ khóa có volume lớn, độ cạnh tranh cao.

- Các bài viết con (cluster content) khai thác sâu từng khía cạnh, long-tail keyword, câu hỏi cụ thể.

- Liên kết 2 chiều: pillar <-> cluster, kết hợp liên kết chéo giữa các cluster có liên quan ngữ nghĩa.

Khi triển khai ở mức chuyên sâu, cần chú ý:

- Phân tích chủ đề gốc: Bắt đầu từ một chủ đề cốt lõi (ví dụ: “SEO Technical”), phân rã thành các nhóm con: crawlability, indexability, site speed, structured data, v.v.

- Mapping từ khóa – URL: Mỗi nhóm chủ đề được gán một pillar page duy nhất, tránh trùng lặp chủ đề giữa các pillar để không tự cạnh tranh (keyword cannibalization).

- Chiều sâu nội dung: Pillar không chỉ là trang “mục lục”, mà phải đủ chuyên sâu, có khả năng tự xếp hạng, đồng thời đóng vai trò trung tâm điều hướng đến các bài cluster.

- Độ phủ topical: Đảm bảo mỗi chủ đề lớn được bao phủ đầy đủ các khía cạnh: định nghĩa, hướng dẫn, case study, checklist, lỗi thường gặp, công cụ, v.v. để xây dựng topical authority.

Về mặt kỹ thuật, cấu trúc URL nên phản ánh một phần cấu trúc SILO/cluster (khi phù hợp):

- /seo/ > /seo/on-page/ > /seo/on-page/title-tag/

- Hoặc dạng phẳng hơn nhưng vẫn duy trì liên kết nội bộ logic: /seo-on-page/, /seo-title-tag/, /seo-meta-description/

Để đánh giá mức độ tối ưu của cấu trúc hiện tại, có thể:

- Xuất toàn bộ URL từ Screaming Frog, phân nhóm theo thư mục hoặc pattern URL.

- Mapping mỗi URL vào một chủ đề chính, đánh dấu các URL “lạc chủ đề” hoặc không thuộc cluster nào.

- Nhận diện các pillar yếu (ít nội dung con, ít internal link) và các cluster bị thiếu mắt xích (thiếu bài giải thích khái niệm, thiếu bài how-to, thiếu FAQ).

Khi tối ưu, ưu tiên:

- Tạo hoặc nâng cấp pillar page cho các chủ đề mang lại doanh thu hoặc traffic tiềm năng cao.

- Chuẩn hóa liên kết nội bộ: mọi bài cluster phải trỏ về pillar bằng anchor có liên quan ngữ nghĩa.

- Giảm bớt các bài trùng lặp chủ đề bằng cách gộp nội dung (content consolidation) và 301 redirect.

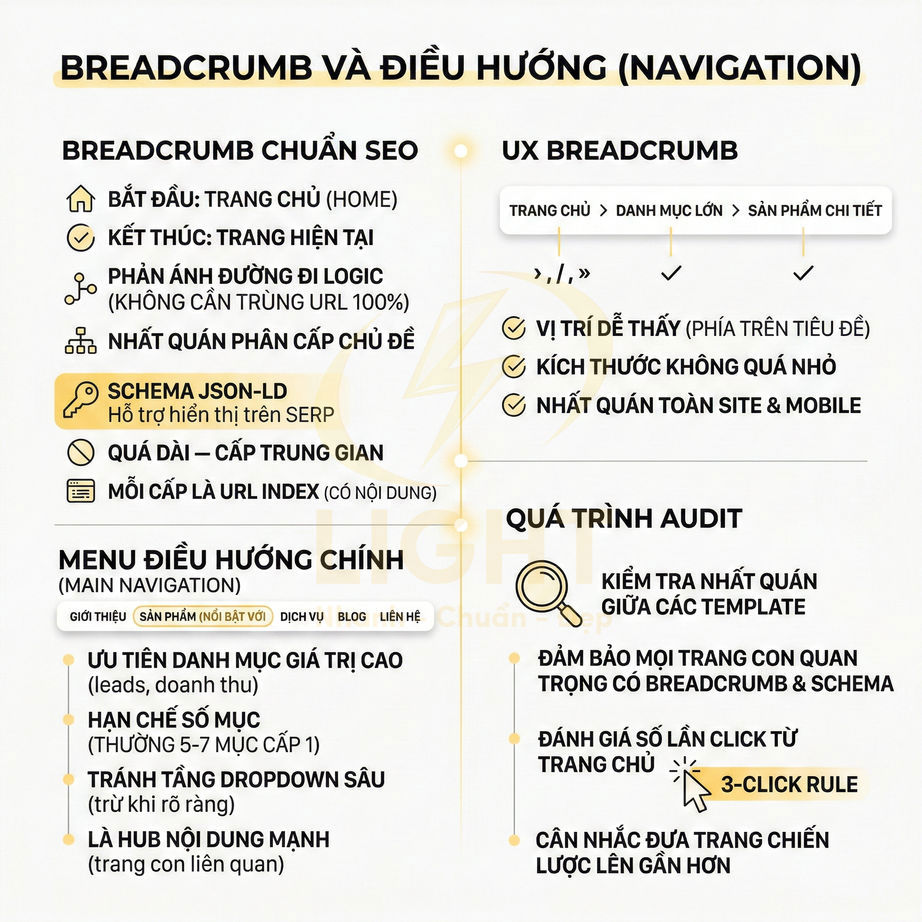

Breadcrumb và điều hướng (Navigation)

Breadcrumb là thành phần quan trọng trong kiến trúc thông tin, vừa hỗ trợ trải nghiệm người dùng, vừa cung cấp tín hiệu phân cấp nội dung cho bot. Một breadcrumb chuẩn SEO cần phản ánh chính xác đường đi logic trong site, không nhất thiết phải trùng 100% với cấu trúc URL, nhưng phải nhất quán về mặt phân cấp chủ đề.

Các nguyên tắc chuyên sâu khi thiết kế breadcrumb:

- Luôn bắt đầu bằng trang chủ (Home) và kết thúc bằng trang hiện tại.

- Không để breadcrumb quá dài; với site nhiều tầng, có thể gom nhóm hoặc rút gọn các cấp trung gian ít giá trị.

- Đảm bảo mỗi cấp breadcrumb là một URL có thể index, có nội dung thực sự, không phải chỉ là trang “trống” để điều hướng.

- Áp dụng Breadcrumb Schema (dạng JSON-LD hoặc microdata) để giúp Google hiển thị đường dẫn breadcrumb trên SERP thay cho URL thô.

Về mặt UX, breadcrumb nên:

- Đặt ở vị trí dễ thấy (thường phía trên tiêu đề bài viết).

- Sử dụng ký hiệu phân tách rõ ràng (›, /, ») và kích thước chữ không quá nhỏ.

- Giữ phong cách nhất quán trên toàn bộ site, kể cả trên mobile.

Menu điều hướng chính (main navigation) cần được thiết kế dựa trên hành vi người dùng và ưu tiên kinh doanh:

- Ưu tiên các danh mục mang lại giá trị cao (doanh thu, lead, hoặc chủ đề chiến lược).

- Hạn chế số lượng mục trong menu chính để tránh quá tải nhận thức; thường 5–7 mục cấp 1 là hợp lý.

- Tránh tạo quá nhiều tầng dropdown sâu (mega menu nhiều lớp) nếu không có cấu trúc thông tin rõ ràng, vì dễ gây rối cho cả người dùng và bot.

- Đảm bảo các mục trong menu là các hub nội dung mạnh, có nhiều trang con liên quan, không dùng các trang mỏng nội dung làm điểm điều hướng chính.

Trong quá trình audit, cần:

- Kiểm tra sự nhất quán của breadcrumb giữa các template (blog, category, product, landing page).

- Đảm bảo mọi trang con quan trọng đều có breadcrumb hiển thị và được đánh dấu schema.

- Đánh giá số lần click từ trang chủ đến các trang chiến lược; nếu quá nhiều bước, cân nhắc đưa chúng lên gần hơn trong cấu trúc điều hướng.

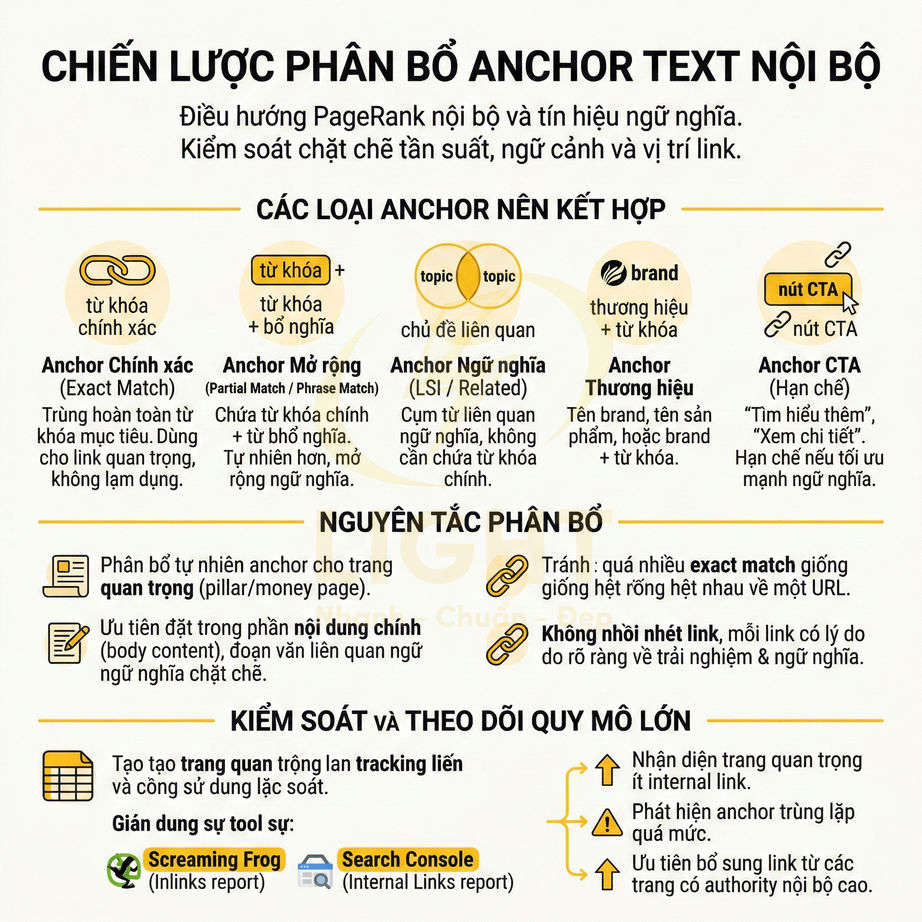

Phân bổ Anchor Text nội bộ

Chiến lược anchor text nội bộ là một trong những đòn bẩy mạnh nhất để điều hướng PageRank nội bộ và tín hiệu ngữ nghĩa. Ở mức chuyên sâu, không chỉ dừng lại ở việc “đa dạng hóa anchor”, mà cần kiểm soát chặt chẽ tần suất, ngữ cảnh và vị trí đặt link.

Các loại anchor nên sử dụng kết hợp:

- Anchor chính xác (exact match): Trùng hoàn toàn với từ khóa mục tiêu của trang đích; dùng cho một số liên kết quan trọng, nhưng không lạm dụng.

- Anchor mở rộng (partial match / phrase match): Chứa từ khóa chính kèm thêm từ bổ nghĩa, giúp tự nhiên hơn và mở rộng ngữ nghĩa.

- Anchor ngữ nghĩa (LSI / related): Sử dụng các cụm từ liên quan về mặt ngữ nghĩa, không nhất thiết chứa từ khóa chính.

- Anchor thương hiệu: Tên brand, tên sản phẩm, hoặc kết hợp brand + từ khóa.

- Anchor dạng CTA: “tìm hiểu thêm”, “xem chi tiết”, nhưng nên hạn chế nếu muốn tối ưu mạnh về ngữ nghĩa.

Nguyên tắc phân bổ:

- Trang càng quan trọng (pillar, money page) càng cần nhiều internal link chất lượng, nhưng anchor phải được phân bổ tự nhiên giữa các loại trên.

- Tránh để một URL nhận quá nhiều anchor exact match giống hệt nhau từ nhiều trang, dễ tạo tín hiệu tối ưu hóa quá đà.

- Ưu tiên đặt internal link trong phần nội dung chính (body content), đặc biệt là đoạn văn có liên quan ngữ nghĩa chặt chẽ, thay vì chỉ ở footer hoặc sidebar.

- Không nhồi quá nhiều link trong một đoạn ngắn; mỗi link cần có lý do rõ ràng về mặt trải nghiệm và ngữ nghĩa.

Để kiểm soát chiến lược liên kết nội bộ ở quy mô lớn, nên lập bảng theo dõi cho từng URL quan trọng, bao gồm:

- URL đích

- Từ khóa mục tiêu chính

- Các biến thể anchor được phép sử dụng

- Số lượng internal link hiện có, nguồn trang trỏ đến

Có thể kết hợp dữ liệu từ Screaming Frog (Inlinks report) và Search Console (Internal Links report) để:

- Nhận diện các trang quan trọng nhưng ít internal link.

- Phát hiện các anchor bị trùng lặp quá mức cho một URL.

- Ưu tiên bổ sung link từ các trang có authority nội bộ cao (nhiều backlink, nhiều traffic) đến các trang cần đẩy mạnh.

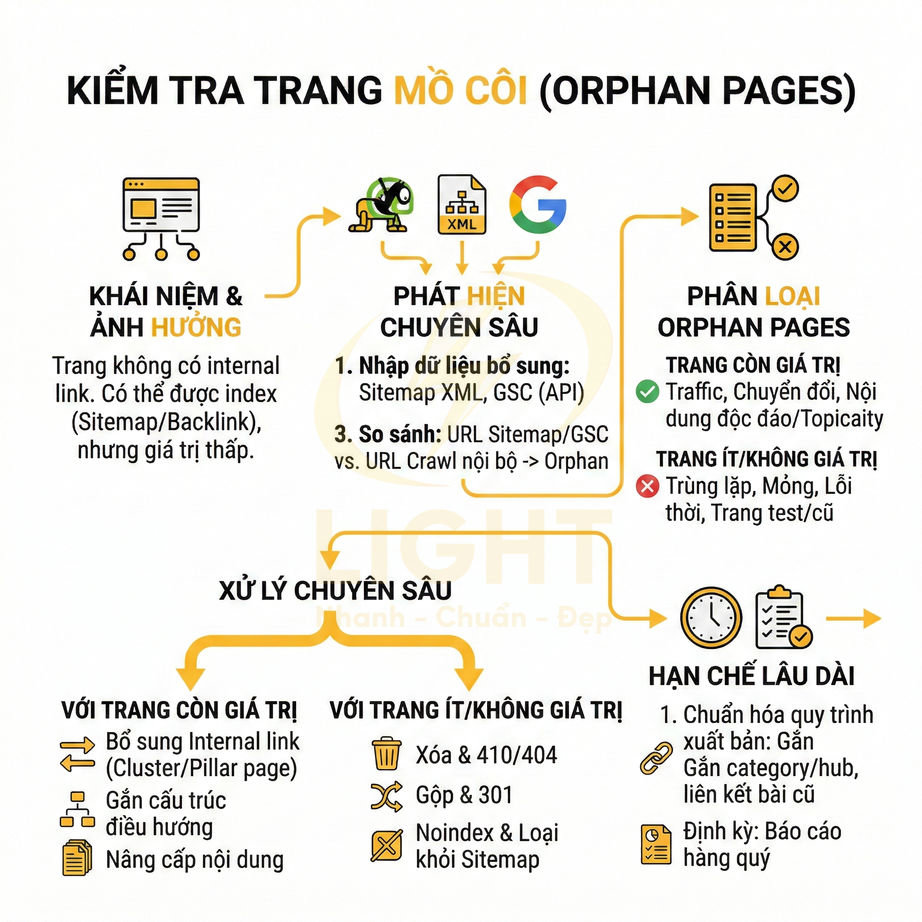

Kiểm tra trang mồ côi (Orphan Pages)

Orphan pages là các trang không nhận được bất kỳ internal link nào từ các trang khác trong site. Về mặt kỹ thuật, chúng có thể vẫn được index nếu nằm trong sitemap hoặc có backlink ngoài, nhưng thường bị đánh giá thấp hơn do thiếu ngữ cảnh nội bộ và khó được người dùng tìm thấy qua điều hướng tự nhiên.

Quy trình phát hiện orphan pages ở mức chuyên sâu:

- Crawl site bằng Screaming Frog ở chế độ “Spider” để thu thập tất cả URL có thể truy cập qua internal link.

- Nhập thêm dữ liệu từ:

- Sitemap XML (Mode > List > Upload sitemap)

- Google Search Console (API integration) để lấy danh sách URL đã được Google biết đến.

- So sánh tập URL từ sitemap/GSC với tập URL thu được từ crawl nội bộ:

- Các URL chỉ xuất hiện trong sitemap/GSC nhưng không xuất hiện trong crawl nội bộ chính là ứng viên orphan.

Sau khi có danh sách orphan pages, cần phân loại:

- Trang còn giá trị:

- Có traffic từ organic, referral hoặc paid.

- Có chuyển đổi (lead, sale) hoặc đóng vai trò quan trọng trong hành trình người dùng.

- Có nội dung độc đáo, phù hợp với chiến lược topical authority.

- Trang ít hoặc không còn giá trị:

- Nội dung trùng lặp, mỏng, lỗi thời, hoặc không còn phù hợp với định hướng hiện tại.

- Trang test, trang campaign cũ, trang tag/category không được tối ưu.

Hướng xử lý chuyên sâu:

- Với trang còn giá trị:

- Bổ sung internal link từ các bài liên quan trong cùng cluster hoặc từ pillar page.

- Đảm bảo trang được gắn vào một cấu trúc điều hướng rõ ràng (category, hub page, hoặc menu phụ).

- Xem xét nâng cấp nội dung để phù hợp hơn với cluster hiện tại, tránh bị “lạc chủ đề”.

- Với trang không cần thiết:

- Nếu không có giá trị SEO và không cần cho người dùng: cân nhắc xóa và 410/404.

- Nếu có một phần giá trị nhưng trùng lặp: gộp nội dung vào trang khác và 301 redirect.

- Nếu cần tồn tại vì lý do kỹ thuật hoặc nghiệp vụ nhưng không muốn index: áp dụng noindex và loại khỏi sitemap.

Về lâu dài, để hạn chế phát sinh orphan pages mới:

- Chuẩn hóa quy trình xuất bản nội dung: mỗi bài mới phải được:

- Gắn vào một category/hub cụ thể.

- Được liên kết từ ít nhất 1–2 trang hiện có trong cùng cluster.

- Định kỳ (ví dụ hàng quý) chạy lại báo cáo orphan pages để phát hiện sớm các URL bị “bỏ quên”.

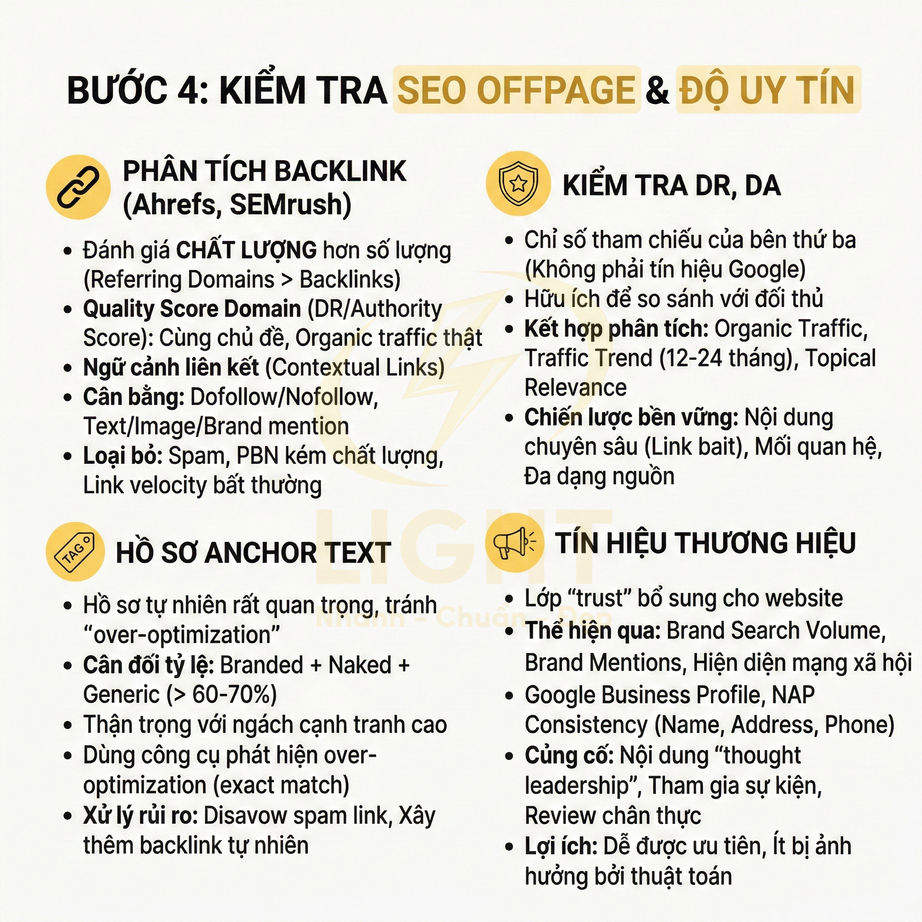

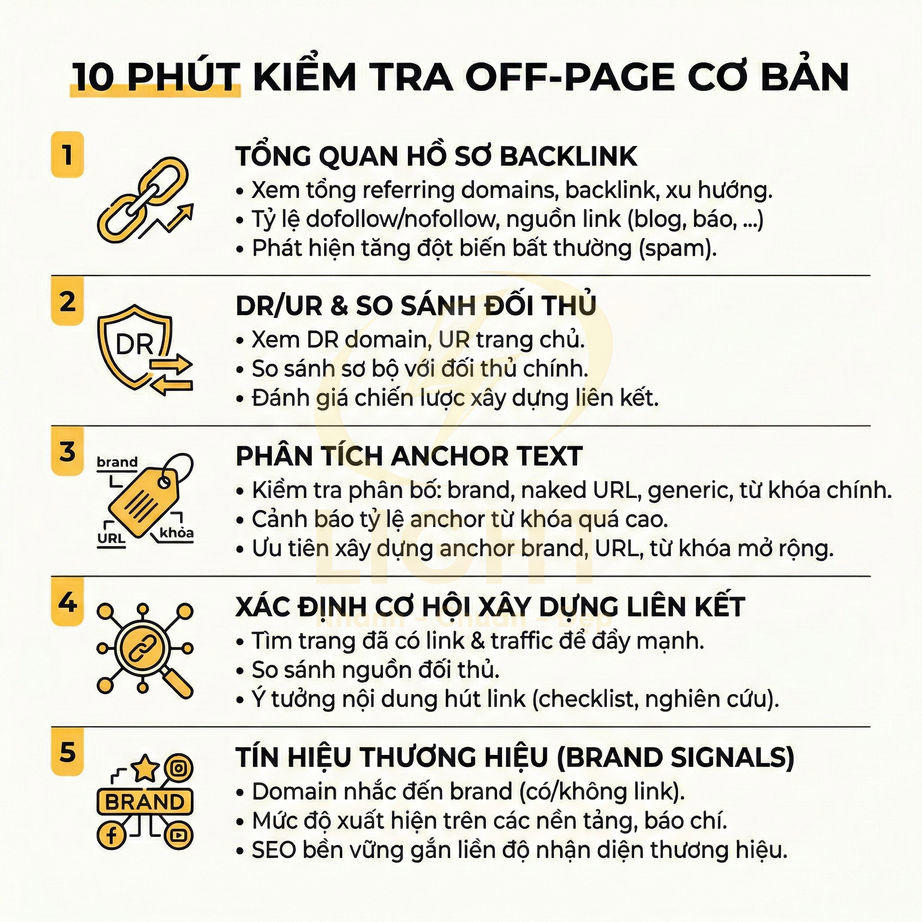

Bước 4: Kiểm tra SEO Offpage và độ uy tín

Kiểm tra SEO Offpage và độ uy tín giúp đánh giá sức mạnh thực sự của domain ngoài phạm vi tối ưu on-page. Phân tích backlink không chỉ dựa vào số lượng mà cần xem xét chất lượng referring domains, ngữ cảnh liên kết, tốc độ tăng trưởng và mức độ liên quan chủ đề. Hồ sơ anchor text, tỷ lệ dofollow/nofollow và phân bổ link đến từng URL phản ánh mức độ tự nhiên của chiến lược xây dựng liên kết. Bên cạnh đó, các chỉ số tham chiếu như DR, DA cần được đối chiếu với organic traffic và xu hướng tăng trưởng thực tế. Tín hiệu thương hiệu, brand mention và mức độ hiện diện đa nền tảng đóng vai trò củng cố trust tổng thể, tạo nền tảng bền vững cho thứ hạng dài hạn.

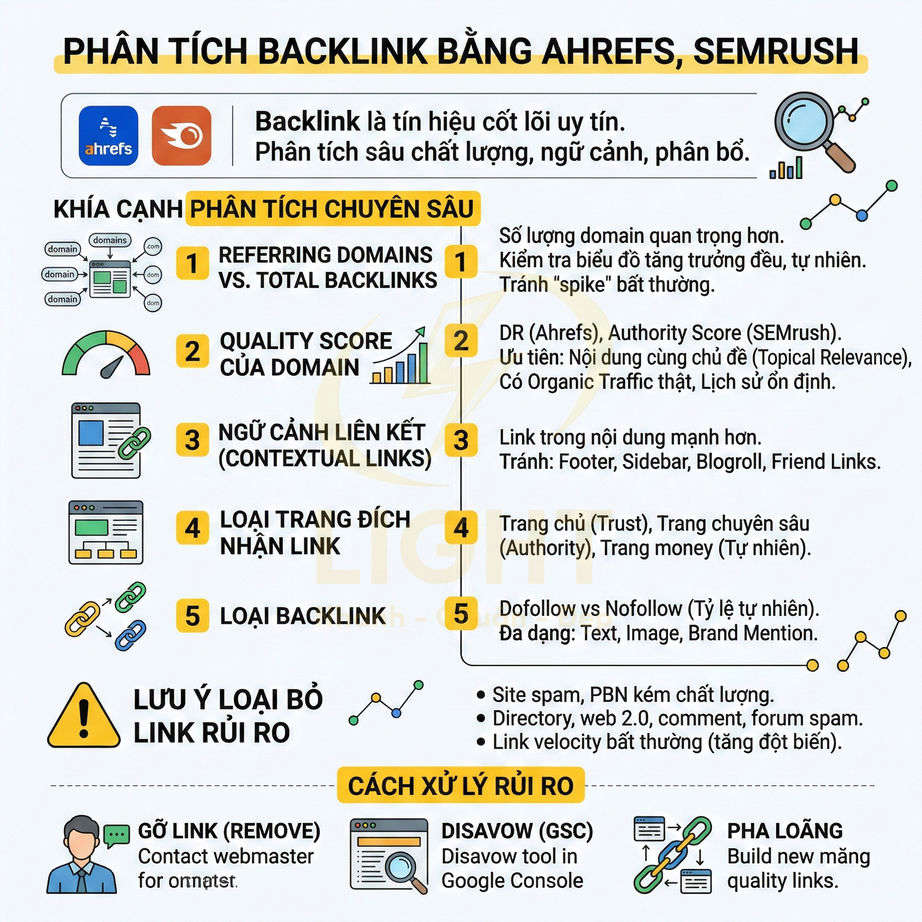

Phân tích Backlink bằng Ahrefs, SEMrush

Backlink là một trong những tín hiệu cốt lõi phản ánh mức độ uy tín và độ phổ biến của website trong mắt công cụ tìm kiếm. Khi phân tích bằng Ahrefs, SEMrush hoặc Ahrefs Webmaster Tools, không chỉ dừng lại ở việc xem tổng số referring domains, mà cần đi sâu vào chất lượng, ngữ cảnh và mô hình phân bổ liên kết.

Trong nghiên cứu về mạng lưới web, các liên kết giữa các trang được xem như một hệ thống trích dẫn học thuật. Tương tự cách một bài báo khoa học được đánh giá thông qua số lượng trích dẫn, các trang web cũng được đánh giá thông qua số lượng và chất lượng liên kết trỏ đến. Các nghiên cứu về link analysis cho thấy các thuật toán như PageRank và HITS có thể xác định các nguồn thông tin đáng tin cậy dựa trên cấu trúc liên kết. Điều này giải thích tại sao các backlink từ website có uy tín cao thường mang lại giá trị xếp hạng lớn hơn nhiều so với các liên kết từ nguồn kém chất lượng (Kleinberg, 1999, Authoritative Sources in a Hyperlinked Environment).

Một số khía cạnh chuyên sâu cần phân tích:

- Referring Domains vs. Total Backlinks: Số lượng domain trỏ về quan trọng hơn số lượng backlink. Một website có 100 domain trỏ về với 300 backlink thường tự nhiên và bền vững hơn so với 5 domain nhưng 10.000 backlink lặp lại. Kiểm tra:

- Tốc độ tăng referring domains theo thời gian (Referring Domains Growth)

- Biểu đồ tăng trưởng có đều, tự nhiên hay có các “spike” bất thường

- Quality Score của domain: Dùng các chỉ số như DR (Ahrefs), Authority Score (SEMrush) để sàng lọc domain chất lượng. Ưu tiên:

- Website có nội dung cùng chủ đề hoặc liên quan chặt chẽ (topical relevance)

- Domain có organic traffic thật, không chỉ số cao nhưng traffic bằng 0

- Trang có lịch sử ổn định, không bị tụt traffic đột ngột (dấu hiệu bị phạt hoặc mất trust)

- Ngữ cảnh liên kết (Contextual Links): Backlink đặt trong nội dung bài viết, đoạn văn có liên quan, với anchor tự nhiên thường mạnh hơn nhiều so với:

- Link ở footer, sidebar, blogroll

- Trang “partner”, “friend links” không có nội dung giá trị

- Loại trang đích nhận link: Phân tích những URL nhận nhiều backlink nhất:

- Trang chủ (homepage) thường nhận nhiều link thương hiệu, giúp tăng trust tổng thể

- Trang nội dung chuyên sâu (blog, resource, guide) giúp tăng topical authority

- Trang money page (dịch vụ, sản phẩm) cần backlink nhưng phải cực kỳ tự nhiên để tránh rủi ro

- Loại backlink:

- Dofollow vs Nofollow: Dofollow truyền sức mạnh chính, nhưng hồ sơ backlink tự nhiên luôn có tỷ lệ nofollow nhất định (social, forum, directory uy tín)

- Text link, image link, link từ mention thương hiệu: đa dạng định dạng giúp hồ sơ tự nhiên hơn

Cần đặc biệt lưu ý loại bỏ hoặc hạn chế:

- Backlink từ site spam, PBN kém chất lượng, có nội dung spin, không có traffic

- Directory, web 2.0, comment spam hàng loạt, forum profile không liên quan

- Backlink có dấu hiệu được tạo trong thời gian rất ngắn với số lượng lớn (link velocity bất thường)

Khi phát hiện các nhóm backlink rủi ro, có thể:

- Liên hệ webmaster yêu cầu gỡ link (remove)

- Dùng file Disavow gửi lên Google Search Console cho các domain không thể kiểm soát

- Xây dựng thêm nhiều backlink chất lượng, liên quan chủ đề để “pha loãng” tác động tiêu cực

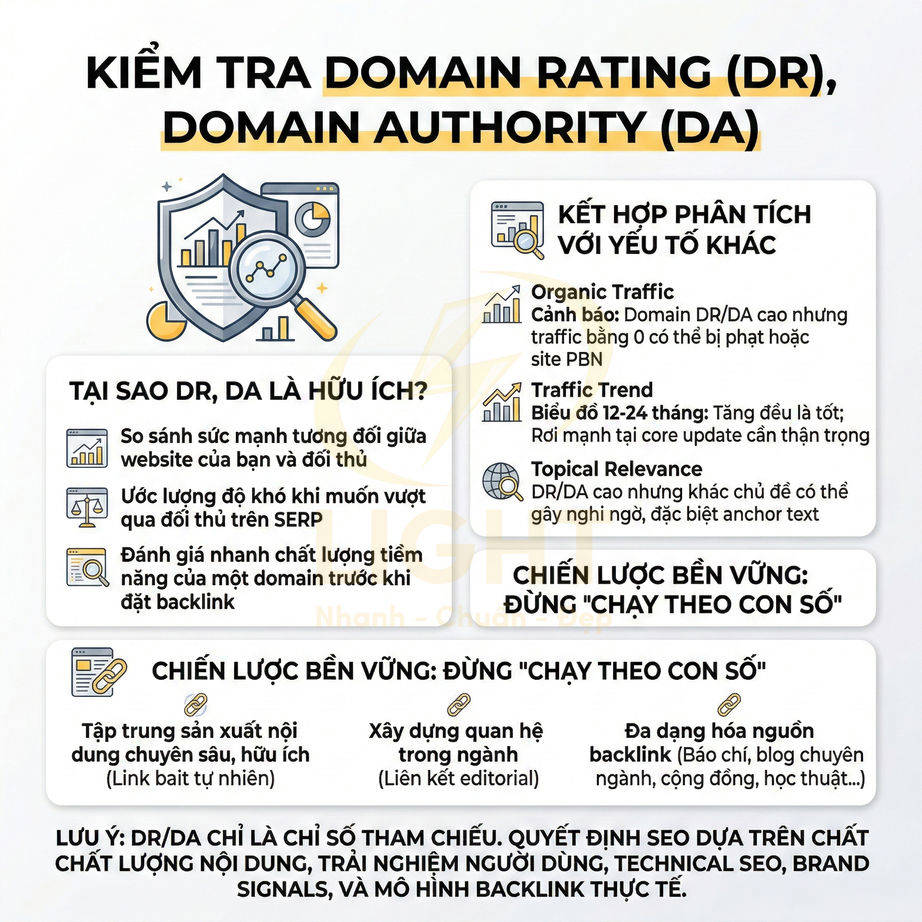

Kiểm tra Domain Rating (DR), Domain Authority (DA)

Các chỉ số như DR (Ahrefs), DA (Moz), Authority Score (SEMrush) là các thước đo do bên thứ ba xây dựng, mô phỏng lại sức mạnh liên kết và độ uy tín tổng thể của domain. Dù không phải tín hiệu chính thức của Google, chúng rất hữu ích để:

- So sánh sức mạnh tương đối giữa website của bạn và đối thủ trong cùng ngách

- Ước lượng độ khó khi muốn vượt qua đối thủ trên SERP

- Đánh giá nhanh chất lượng tiềm năng của một domain trước khi đặt backlink

Khi phân tích DR/DA, nên kết hợp thêm các yếu tố:

- Organic Traffic: Một domain DR/DA cao nhưng organic traffic gần như bằng 0 có thể:

- Bị phạt thuật toán hoặc manual action

- Là site xây dựng chỉ để làm PBN, không phục vụ người dùng thật

- Traffic Trend: Kiểm tra biểu đồ traffic 12–24 tháng:

- Xu hướng tăng đều, ổn định: tín hiệu tốt

- Rơi mạnh tại các mốc cập nhật core update: cần thận trọng khi lấy backlink

- Topical Relevance: DR/DA cao nhưng khác chủ đề quá xa (ví dụ: site về casino trỏ về site y tế) có thể gây nghi ngờ, đặc biệt nếu anchor chứa từ khóa chính.

Trong quá trình tối ưu, không nên “chạy theo con số” DR/DA bằng mọi giá. Chiến lược bền vững là:

- Tập trung sản xuất nội dung chuyên sâu, hữu ích, có khả năng tự nhiên thu hút backlink (link bait)

- Xây dựng quan hệ với các website, publisher, KOL trong ngành để có liên kết editorial

- Đa dạng hóa nguồn backlink: báo chí, blog chuyên ngành, cộng đồng, tài nguyên học thuật, tổ chức, hiệp hội

Lưu ý: DR/DA chỉ nên dùng như một chỉ số tham chiếu. Quyết định SEO cần dựa trên tổng hòa: chất lượng nội dung, trải nghiệm người dùng, technical SEO, brand signals và mô hình backlink thực tế.

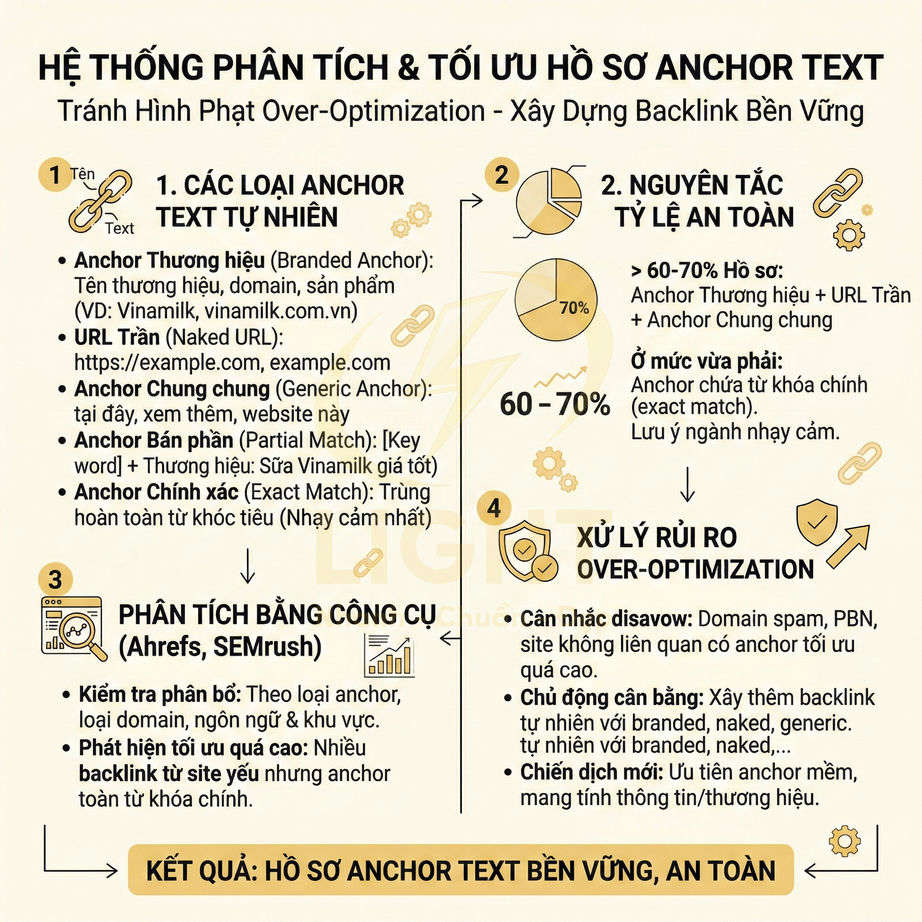

Anchor Text Profile

Hồ sơ anchor text là một trong những yếu tố nhạy cảm nhất trong SEO Offpage. Tối ưu quá đà có thể dẫn đến các hình phạt liên quan đến over-optimization hoặc nghi ngờ thao túng thuật toán. Một hồ sơ anchor tự nhiên thường có:

- Anchor thương hiệu (Branded Anchor): Tên thương hiệu, tên domain, tên sản phẩm/dịch vụ mang tính thương hiệu

- URL trần (Naked URL): https://example.com, www.example.com

- Anchor chung chung (Generic Anchor): “tại đây”, “xem thêm”, “website này”, “click here”

- Anchor bán phần (Partial Match): Chứa một phần từ khóa chính kết hợp với từ khóa phụ hoặc thương hiệu

- Anchor chính xác (Exact Match): Trùng hoàn toàn với từ khóa mục tiêu

Anchor text đóng vai trò như mô tả ngữ nghĩa của liên kết trong hệ thống tìm kiếm. Nghiên cứu của Sergey Brin và Lawrence Page cho thấy văn bản neo (anchor text) thường cung cấp thông tin ngữ nghĩa chính xác hơn so với nội dung trang đích. Điều này xảy ra vì anchor text được viết bởi các website khác để mô tả nội dung mà họ liên kết đến. Do đó các hệ thống tìm kiếm sử dụng anchor text như một tín hiệu bổ sung để hiểu chủ đề của trang. Tuy nhiên khi anchor bị tối ưu quá mức hoặc không tự nhiên, thuật toán có thể coi đó là dấu hiệu thao túng liên kết.

Về tỷ lệ, không có một “công thức vàng” cố định cho mọi ngành, nhưng một số nguyên tắc an toàn thường được áp dụng:

- Anchor thương hiệu + URL trần + anchor chung chung nên chiếm phần lớn hồ sơ (đa số trường hợp > 60–70%)

- Anchor chứa từ khóa chính (exact match) chỉ nên ở mức vừa phải, đặc biệt với:

- Ngách cạnh tranh cao, nhạy cảm (tài chính, y tế, casino, vay tiền, thuốc…)

- Backlink từ domain yếu, không liên quan chủ đề

- Anchor từ site chất lượng cao, cùng chủ đề có thể “mạnh tay” hơn một chút, nhưng vẫn cần giữ sự tự nhiên trong ngữ cảnh câu chữ.

Khi phân tích bằng Ahrefs/SEMrush:

- Kiểm tra phân bổ anchor theo:

- Loại anchor (branded, generic, exact, partial, URL)

- Loại domain (báo chí, blog, forum, directory, social)

- Ngôn ngữ và khu vực (đặc biệt quan trọng với SEO local và đa ngôn ngữ)

- Phát hiện các cụm anchor tối ưu quá cao:

- Nhiều backlink từ site yếu nhưng anchor toàn từ khóa chính

- Anchor thương mại mạnh (mua ngay, giá rẻ, tốt nhất) từ nguồn không tự nhiên

Nếu nhận thấy rủi ro:

- Cân nhắc disavow các domain spam, PBN, hoặc site không liên quan có anchor tối ưu quá đà

- Chủ động xây thêm backlink tự nhiên với anchor thương hiệu, URL trần, anchor chung chung để cân bằng hồ sơ

- Trong các chiến dịch outreach/guest post mới, ưu tiên anchor mềm, mang tính thương hiệu hoặc thông tin, hạn chế anchor thương mại cứng

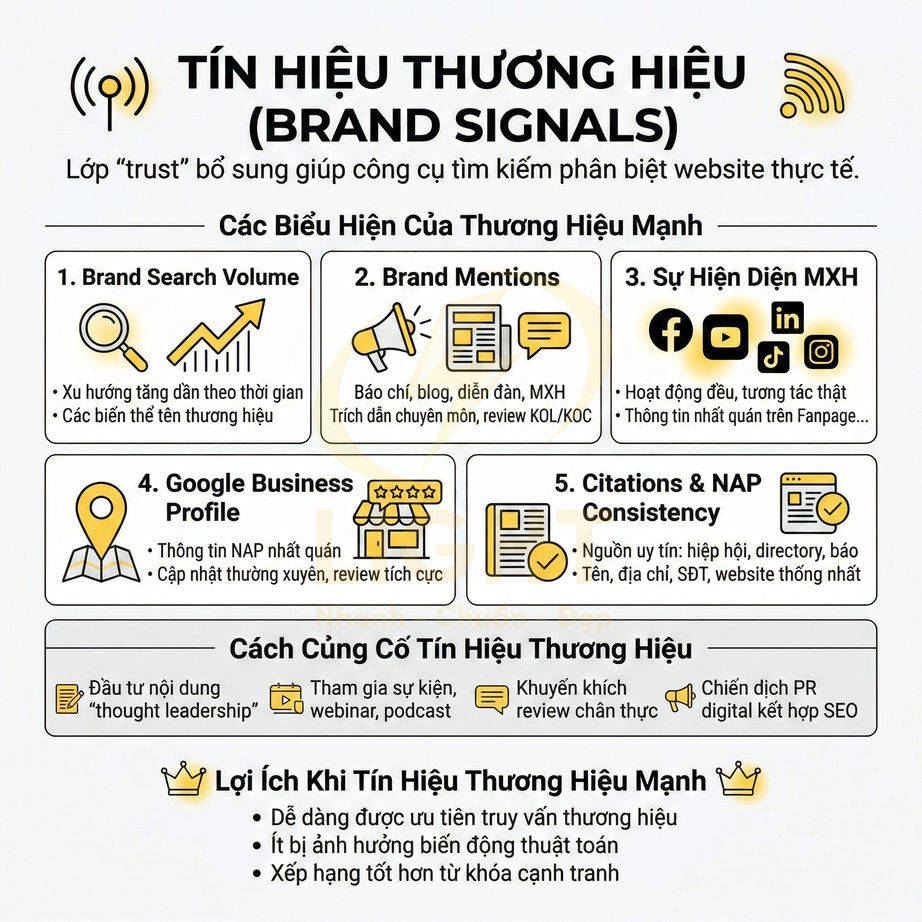

Tín hiệu thương hiệu (Brand Signals)

Tín hiệu thương hiệu là lớp “trust” bổ sung giúp công cụ tìm kiếm phân biệt giữa một website chỉ tối ưu kỹ thuật và một doanh nghiệp/thực thể thật sự có hiện diện trên thị trường. Một thương hiệu mạnh thường thể hiện qua:

- Brand Search Volume: Lượng tìm kiếm tên thương hiệu, tên domain, tên sản phẩm/dịch vụ độc quyền:

- Xu hướng tăng dần theo thời gian là tín hiệu tích cực

- Các biến thể tên thương hiệu (có dấu, không dấu, viết tắt) cũng nên được theo dõi

- Brand Mentions (có hoặc không kèm link):

- Nhắc đến thương hiệu trên báo chí, blog, diễn đàn, mạng xã hội

- Các trích dẫn chuyên môn, phỏng vấn, review từ KOL/KOC hoặc chuyên gia trong ngành

- Sự hiện diện trên mạng xã hội:

- Fanpage, kênh YouTube, LinkedIn, TikTok, Instagram… hoạt động đều, có tương tác thật

- Thông tin mô tả, link website, logo, hình ảnh thương hiệu nhất quán

- Google Business Profile (đối với local/business):

- Thông tin NAP (Name, Address, Phone) nhất quán với website và các directory lớn

- Giờ mở cửa, danh mục ngành nghề, hình ảnh, bài đăng được cập nhật thường xuyên

- Review tích cực, phản hồi chuyên nghiệp, tần suất đánh giá đều đặn

- Citations và NAP Consistency:

- Thông tin doanh nghiệp xuất hiện trên các nguồn uy tín: hiệp hội ngành, directory lớn, báo chí, trang đánh giá

- Đảm bảo tên công ty, địa chỉ, số điện thoại, website thống nhất, không sai khác giữa các nền tảng

Để củng cố brand signals, có thể:

- Đầu tư nội dung mang tính “thought leadership”: nghiên cứu, báo cáo, case study, whitepaper

- Tham gia sự kiện, webinar, podcast, hội thảo chuyên ngành để tăng brand mentions

- Khuyến khích khách hàng để lại review chân thực trên Google, Facebook, các nền tảng đánh giá chuyên ngành

- Triển khai chiến dịch PR digital kết hợp SEO: bài báo, phỏng vấn, chuyên mục cố định trên các trang uy tín

Khi các tín hiệu thương hiệu mạnh, website thường:

- Dễ dàng được ưu tiên hơn trong các truy vấn có yếu tố thương hiệu hoặc điều hướng

- Ít bị ảnh hưởng tiêu cực bởi các biến động nhỏ của thuật toán

- Có khả năng xếp hạng tốt hơn cho các từ khóa cạnh tranh nhờ độ tin cậy tổng thể cao

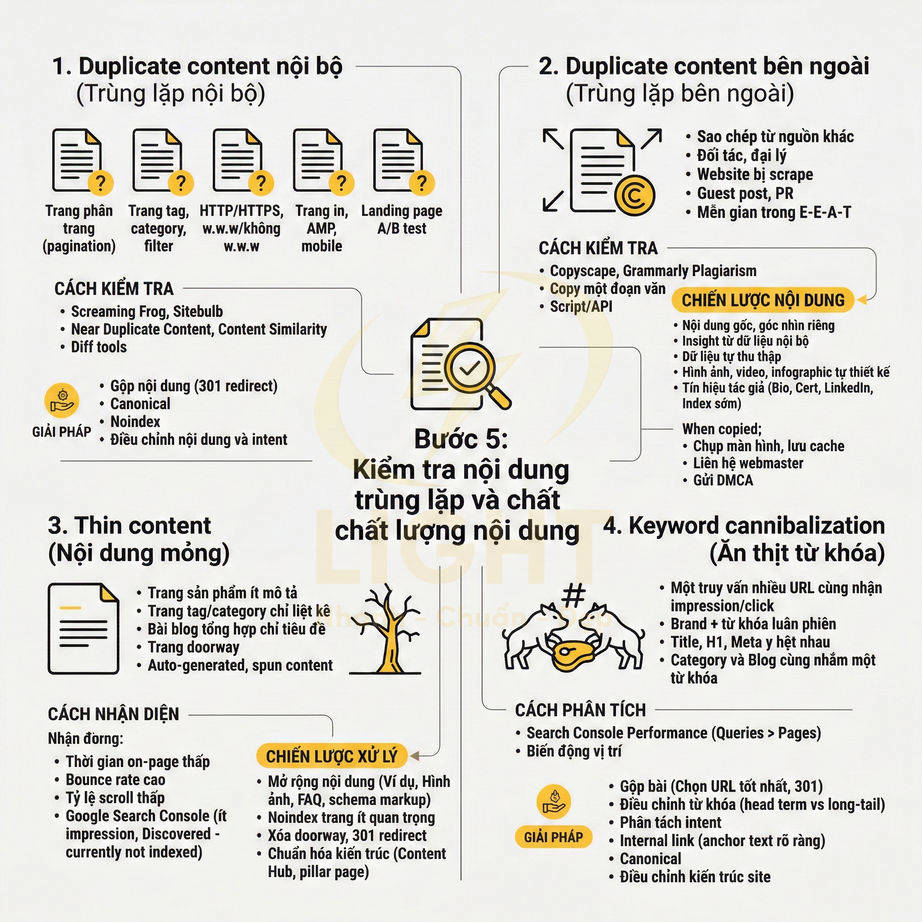

Bước 5: Kiểm tra nội dung trùng lặp và chất lượng nội dung

Bước kiểm tra trùng lặp và chất lượng là “chốt chặn” để giữ website ở trạng thái dễ crawl, dễ hiểu và đáng xếp hạng. Duplicate content làm loãng tín hiệu, lãng phí crawl budget và khiến Google khó chọn đúng trang ưu tiên; trong khi thin content và cannibalization khiến thứ hạng dao động, CTR giảm và trải nghiệm tìm kiếm kém nhất quán. Cách tiếp cận hiệu quả là đánh giá theo vai trò URL trong chiến lược: trang nào cần gom sức mạnh, trang nào nên chuẩn hóa bằng canonical/noindex, và trang nào phải nâng cấp chiều sâu để đáp ứng đúng intent. Khi mỗi trang có mục tiêu rõ ràng, khác biệt ngữ nghĩa và giá trị thực, hệ thống nội dung trở nên ổn định, dễ mở rộng và tăng trưởng bền vững.

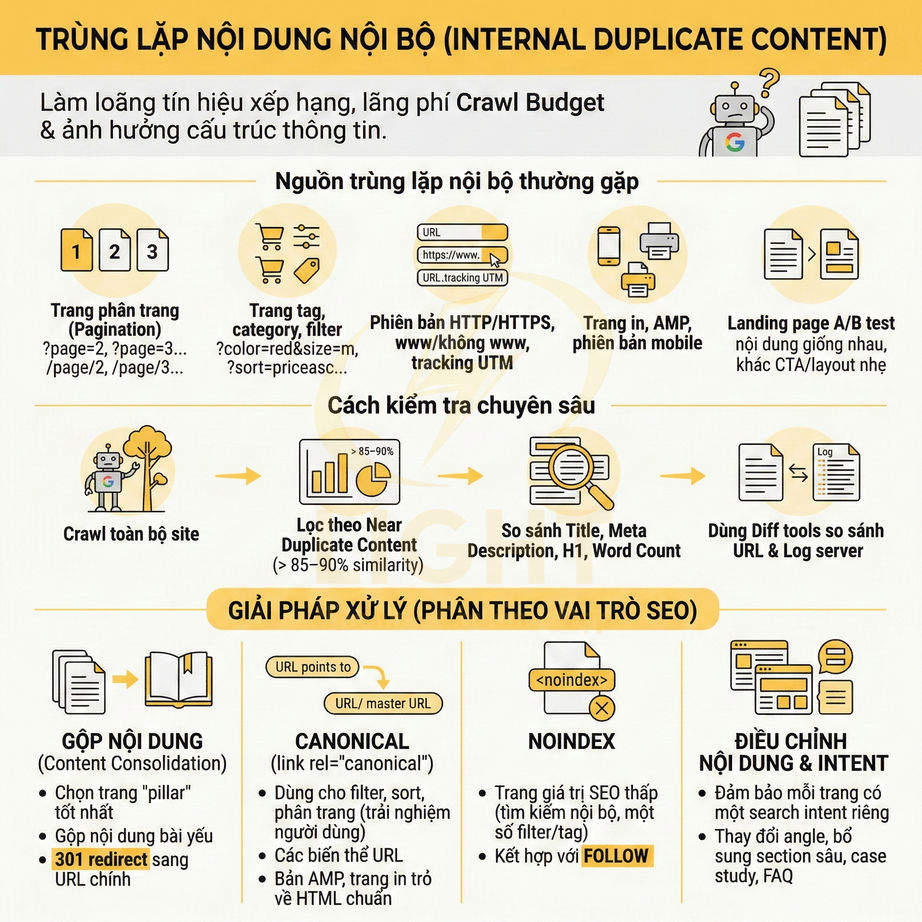

Duplicate content nội bộ

Duplicate content nội bộ không chỉ là “nhiều URL có nội dung gần giống nhau”, mà còn là vấn đề về cấu trúc thông tin, crawl budget và tín hiệu xếp hạng. Khi Googlebot gặp nhiều trang gần như giống nhau, hệ thống sẽ phải chọn một phiên bản đại diện (cluster canonical) và có thể bỏ qua hoặc giảm giá trị các phiên bản còn lại, làm loãng sức mạnh SEO.

Trong lĩnh vực truy xuất thông tin, nội dung trùng lặp được nghiên cứu dưới khái niệm near-duplicate detection. Các nghiên cứu của Stanford University cho thấy một tỷ lệ lớn trang web trên internet có nội dung trùng lặp hoặc gần trùng lặp, đặc biệt do tham số URL hoặc phiên bản trang khác nhau. Để giải quyết vấn đề này, các hệ thống tìm kiếm sử dụng thuật toán như shingling và MinHash để phát hiện các tài liệu tương tự và chọn một phiên bản đại diện trong chỉ mục. Vì vậy việc sử dụng canonical hoặc hợp nhất nội dung giúp công cụ tìm kiếm hiểu rõ trang nào là phiên bản chính (Broder et al., 1997, On the Resemblance and Containment of Documents).

Các nguồn gây trùng lặp nội bộ thường gặp:

- Trang phân trang (pagination): ?page=2, ?page=3 hoặc /page/2, /page/3 với tiêu đề và mô tả giống nhau.

- Trang tag, category, filter tạo nhiều biến thể URL: ?color=red&size=m, ?sort=priceasc, kết hợp filter sinh ra hàng trăm URL tương tự.

- Phiên bản HTTP/HTTPS, có www/không www, có slash/cuối URL hoặc tham số tracking (utmsource, fbclid…).

- Trang in (print version), AMP, phiên bản mobile riêng (m.domain.com) nhưng nội dung giống bản desktop.

- Landing page A/B test chỉ khác rất nhẹ về layout hoặc CTA nhưng giữ nguyên nội dung chính.

Cách kiểm tra chuyên sâu:

- Dùng Screaming Frog hoặc Sitebulb crawl toàn bộ site, sau đó:

- Lọc theo “Near Duplicate Content” hoặc “Content Similarity” để phát hiện nhóm URL có mức độ giống nhau cao (ví dụ > 85–90%).

- So sánh Title, Meta Description, H1 và “Word Count” để nhận diện các cụm trang gần như trùng lặp.

- Dùng các công cụ so sánh nội dung (diff tools) để so sánh từng cặp URL quan trọng, đặc biệt là các trang danh mục, filter, tag.

- Kiểm tra log server (nếu có) để xem Googlebot crawl lặp lại nhiều lần các URL ít giá trị, dấu hiệu của việc lãng phí crawl budget do trùng lặp.

Giải pháp xử lý nên dựa trên vai trò của từng nhóm URL trong chiến lược SEO:

- Gộp nội dung (content consolidation): Khi nhiều bài viết/blog cùng nói về một chủ đề, hãy:

- Chọn 1 trang “pillar” hoặc “master” có hiệu suất tốt nhất (nhiều backlink, traffic, thứ hạng).

- Gộp nội dung từ các bài yếu hơn vào bài chính, tối ưu lại cấu trúc heading, internal link.

- Thiết lập 301 redirect từ các URL cũ sang URL chính để chuyển toàn bộ tín hiệu.

- Canonical: Dùng

<link rel="canonical">khi:- Các trang filter, sort, phân trang cần tồn tại cho trải nghiệm người dùng nhưng không phải là trang mục tiêu SEO.

- Có nhiều phiên bản URL khác nhau dẫn đến cùng một nội dung (ví dụ URL có tham số).

- Có phiên bản AMP hoặc bản in, canonical trỏ về bản chuẩn HTML.

- Noindex:

- Áp dụng cho các trang có giá trị SEO thấp nhưng vẫn cần cho người dùng: trang kết quả tìm kiếm nội bộ, một số trang filter, tag ít nội dung.

- Kết hợp với

followđể vẫn truyền PageRank qua các liên kết trên trang.

- Điều chỉnh nội dung và intent:

- Đảm bảo mỗi trang phục vụ một search intent riêng: thông tin, giao dịch, so sánh, hướng dẫn, review…

- Thay đổi angle nội dung, bổ sung section chuyên sâu, case study, FAQ để phân biệt rõ ràng giữa các trang.

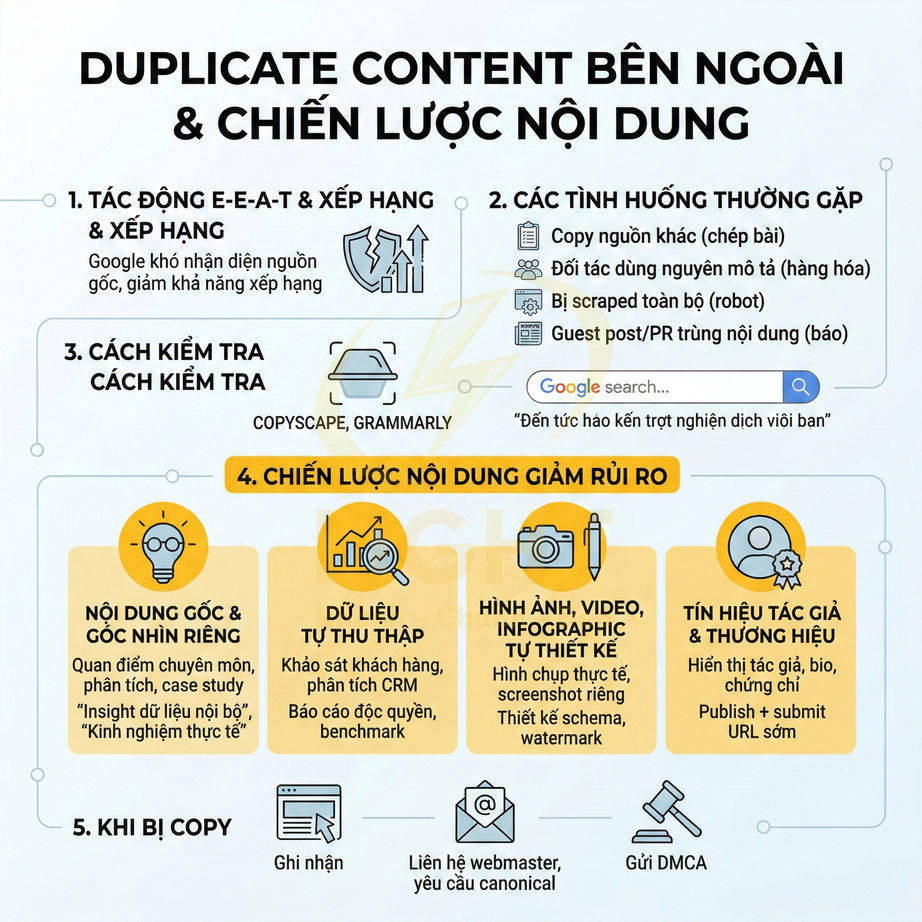

Duplicate content bên ngoài

Duplicate content bên ngoài liên quan trực tiếp đến tín hiệu E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness). Khi nội dung của bạn giống hoặc gần giống với nhiều website khác, Google khó nhận diện đâu là nguồn gốc, từ đó giảm khả năng xếp hạng, đặc biệt trên các truy vấn cạnh tranh.

Các tình huống thường gặp:

- Nội dung được copy từ nguồn khác (bài dịch, bài tổng hợp nhưng không thêm giá trị mới).

- Đối tác, đại lý, nhà phân phối dùng nguyên mô tả sản phẩm, bài blog từ website gốc.

- Website bị người khác scrape hoặc copy toàn bộ bài viết.

- Guest post, PR đăng trên nhiều báo với nội dung gần như giống nhau, trong đó có bản trên site của bạn.

Cách kiểm tra:

- Dùng Copyscape, Grammarly Plagiarism để quét các URL quan trọng, đặc biệt là landing page, bài blog chủ lực.

- Copy một đoạn văn 1–2 câu đặc trưng, đặt trong dấu ngoặc kép và tìm trên Google để xem có bao nhiêu kết quả trùng khớp.

- Đối với site lớn, có thể xuất nội dung (hoặc đoạn mở đầu) và dùng script/API của các công cụ plagiarism để quét hàng loạt.

Chiến lược nội dung để giảm rủi ro duplicate bên ngoài:

- Nội dung gốc, có góc nhìn riêng:

- Thay vì chỉ tổng hợp, hãy đưa ra quan điểm chuyên môn, phân tích, phản biện, hoặc case study thực tế.

- Thêm phần “Insight từ dữ liệu nội bộ” hoặc “Kinh nghiệm triển khai thực tế” mà đối thủ không có.

- Dữ liệu tự thu thập:

- Khảo sát khách hàng, phân tích dữ liệu CRM, dữ liệu hành vi trên site để tạo biểu đồ, số liệu độc quyền.

- Xuất bản báo cáo, whitepaper, benchmark mang dấu ấn riêng, khó bị sao chép hoàn toàn.

- Hình ảnh, video, infographic tự thiết kế:

- Dùng hình chụp thực tế, screenshot từ hệ thống của bạn, không dùng stock image lặp lại khắp nơi.

- Thiết kế infographic, schema, flowchart riêng, gắn watermark hoặc brand subtle để tăng nhận diện.

- Tín hiệu tác giả và thương hiệu:

- Hiển thị rõ tác giả, bio, chứng chỉ, liên kết đến profile chuyên môn (LinkedIn, profile chuyên gia).

- Đảm bảo nội dung quan trọng được index sớm (publish + submit URL trong Search Console) để tăng khả năng được nhận diện là nguồn gốc.

Khi bị người khác copy:

- Ghi nhận bằng cách chụp màn hình, lưu cache, dùng công cụ archive.

- Liên hệ webmaster yêu cầu gỡ hoặc thêm canonical trỏ về site của bạn.

- Nếu vi phạm nghiêm trọng, cân nhắc gửi DMCA đến hosting hoặc Google.

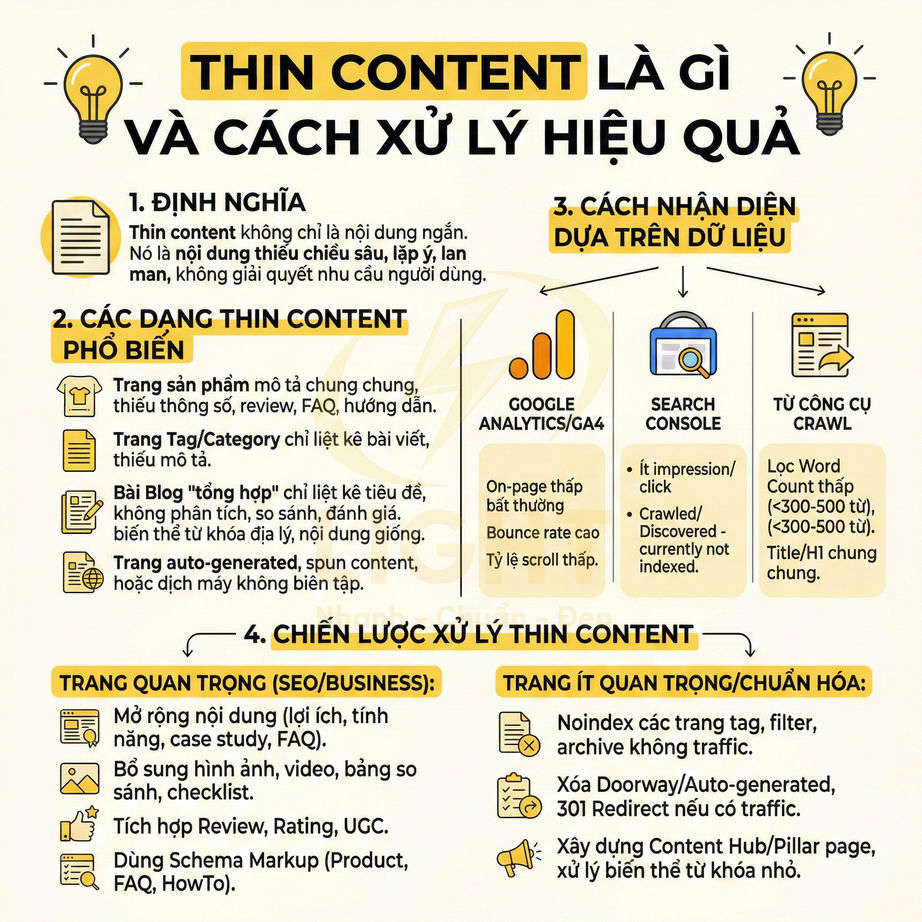

Thin content

Thin content không chỉ là nội dung “ngắn” mà là nội dung thiếu chiều sâu, thiếu mục đích rõ ràng, không giải quyết triệt để nhu cầu người dùng. Một bài 2.000 từ nhưng lặp ý, lan man, không có insight vẫn có thể bị xem là thin content ở cấp độ chất lượng.

Các dạng thin content phổ biến:

- Trang sản phẩm chỉ có vài dòng mô tả chung chung, không có thông số, review, FAQ, hướng dẫn sử dụng.

- Trang tag/category chỉ liệt kê bài viết mà không có phần mô tả, không định nghĩa chủ đề.

- Bài blog “tổng hợp” nhưng chỉ liệt kê tiêu đề, không có phân tích, so sánh, không có tiêu chí đánh giá.

- Trang doorway: tạo nhiều trang nhắm các biến thể từ khóa địa lý nhưng nội dung gần như giống nhau.

- Trang auto-generated, spun content, hoặc nội dung dịch máy không được biên tập.

Cách nhận diện thin content dựa trên dữ liệu:

- Phân tích trong Google Analytics/GA4:

- Trang có thời gian on-page thấp bất thường so với mặt bằng chung.

- Bounce rate cao, tỷ lệ scroll thấp, ít tương tác (click, event).

- Dùng Search Console:

- Trang được index nhưng không có hoặc rất ít impression, không có click trong thời gian dài.

- Trang bị xếp vào nhóm “Crawled – currently not indexed” hoặc “Discovered – currently not indexed” với số lượng lớn.

- Từ công cụ crawl:

- Lọc các URL có “Word Count” thấp (ví dụ < 300–500 từ) và không phải là trang đặc biệt (trang login, giỏ hàng…).

- Kiểm tra các trang có Title/H1 rất chung chung, không thể hiện rõ chủ đề.

Chiến lược xử lý thin content nên phân loại theo mức độ quan trọng:

- Trang quan trọng với SEO hoặc business (trang danh mục, sản phẩm chủ lực, bài pillar):

- Mở rộng nội dung theo cấu trúc rõ ràng: giới thiệu, lợi ích, tính năng, so sánh, case study, FAQ.

- Bổ sung ví dụ thực tế, hình ảnh minh họa, video hướng dẫn, bảng so sánh, checklist.

- Tích hợp review, rating, UGC (user-generated content) để tăng độ phong phú.

- Dùng schema markup (Product, FAQ, HowTo…) để làm rõ ngữ nghĩa cho công cụ tìm kiếm.

- Trang ít quan trọng, không có vai trò rõ ràng:

- Noindex các trang tag, filter, archive không mang lại traffic hoặc không có chiến lược nội dung.

- Xóa hẳn các trang doorway, auto-generated, spun content; nếu có backlink hoặc traffic, dùng 301 redirect sang trang liên quan nhất.

- Chuẩn hóa kiến trúc nội dung:

- Xây dựng content hub/pillar page cho các chủ đề lớn, liên kết đến các bài cluster chuyên sâu.

- Tránh tạo quá nhiều trang con chỉ để nhắm biến thể từ khóa nhỏ, thay vào đó xử lý bằng section trong cùng một bài.

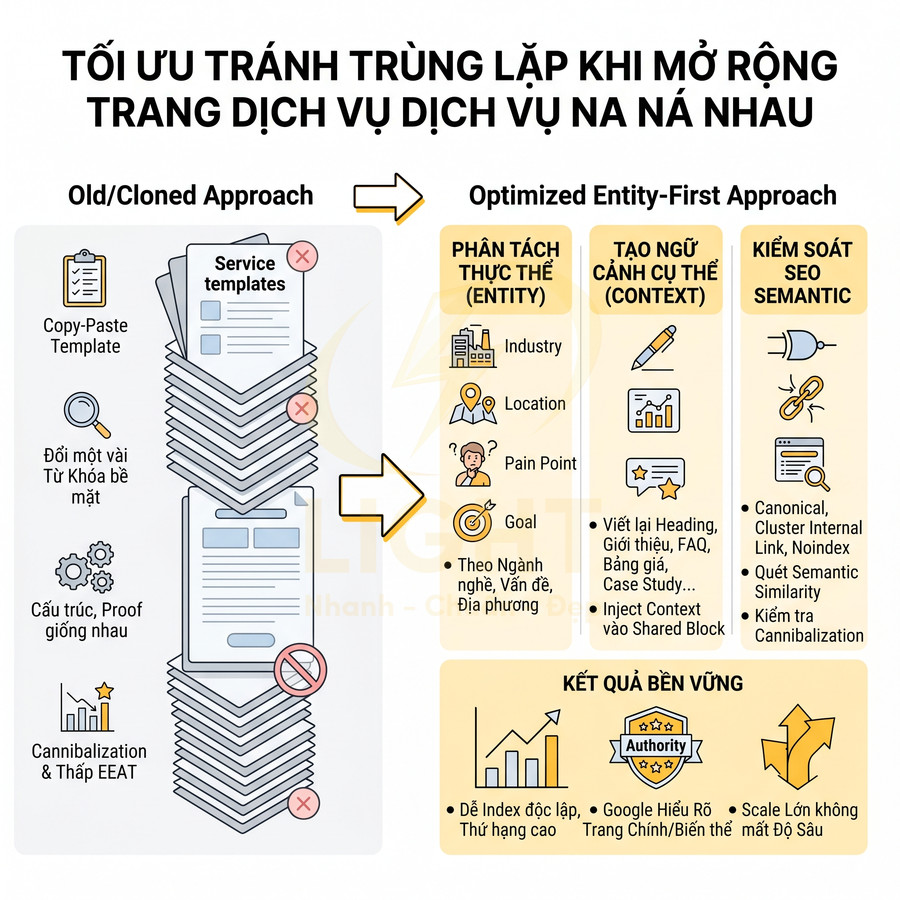

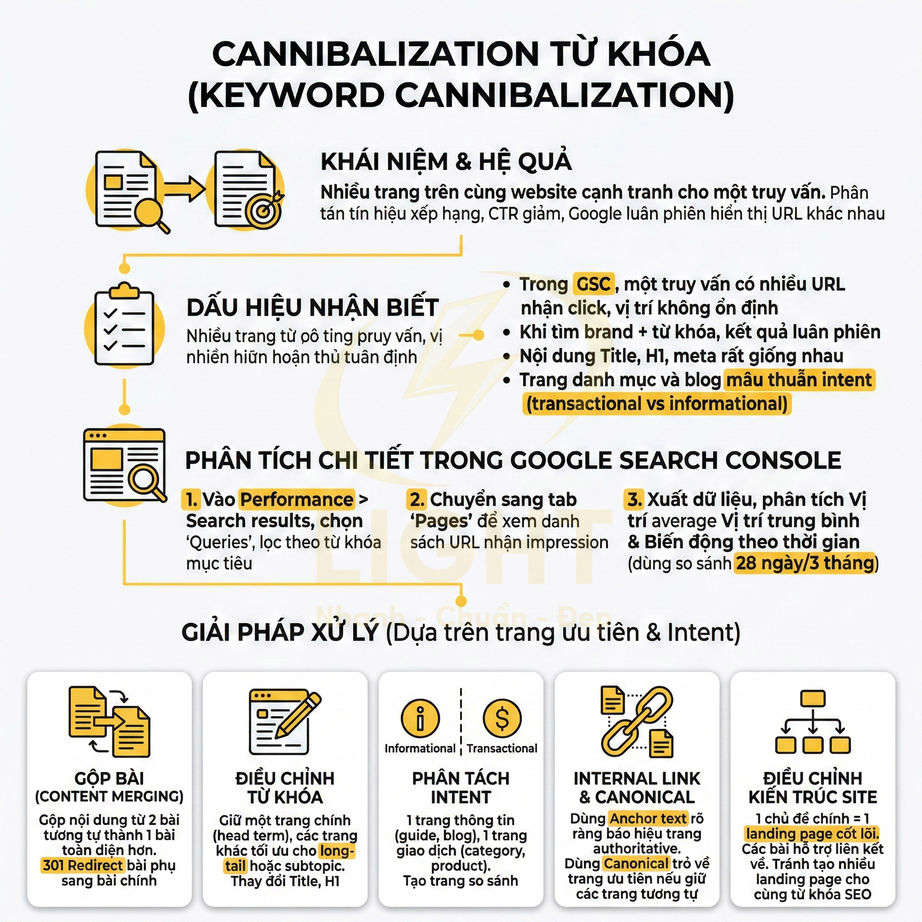

Cannibalization từ khóa

Keyword cannibalization là khi nhiều trang trên cùng một website cùng cạnh tranh cho một truy vấn hoặc nhóm truy vấn tương tự, khiến tín hiệu xếp hạng bị phân tán. Hệ quả là không trang nào đạt được thứ hạng tối ưu, CTR giảm, và Google có thể luân phiên hiển thị các URL khác nhau, gây khó khăn trong việc tối ưu.

Các dấu hiệu nhận biết:

- Trong Google Search Console, một truy vấn có nhiều URL cùng nhận impression/click, nhưng không có URL nào giữ vị trí ổn định.

- Khi tìm kiếm brand + từ khóa, kết quả hiển thị luân phiên nhiều URL khác nhau theo thời gian.

- Hai hoặc nhiều bài viết có Title, H1, meta description, anchor text internal link rất giống nhau.

- Trang danh mục và bài blog cùng nhắm một từ khóa chính, không phân tách rõ intent (transactional vs informational).

Cách phân tích chi tiết trong Search Console:

- Vào Performance > Search results, chọn “Queries”, lọc theo từ khóa mục tiêu.

- Chuyển sang tab “Pages” để xem có bao nhiêu URL đang nhận impression cho truy vấn đó.

- Xuất dữ liệu, phân tích theo:

- Vị trí trung bình của từng URL cho cùng một truy vấn.

- Biến động vị trí theo thời gian (dùng so sánh 28 ngày/3 tháng).

Giải pháp xử lý cannibalization nên dựa trên việc xác định trang ưu tiên và intent của từng trang:

- Gộp bài (content merging):

- Khi hai bài có nội dung chồng lấn lớn, cùng nhắm một từ khóa chính, hãy gộp thành một bài toàn diện hơn.

- Chọn URL có hiệu suất tốt hơn làm URL giữ lại, chuyển nội dung giá trị từ bài kia sang, sau đó 301 redirect.

- Điều chỉnh từ khóa mục tiêu:

- Giữ một trang cho từ khóa chính (head term), các trang còn lại tối ưu cho long-tail hoặc subtopic.

- Thay đổi Title, H1, nội dung để phản ánh rõ sự khác biệt về chủ đề và mức độ chi tiết.

- Phân tách intent:

- Một trang phục vụ intent thông tin (guide, blog), một trang phục vụ intent giao dịch (category, product).

- Tạo trang so sánh, review, checklist riêng nếu người dùng có intent so sánh (comparison intent).

- Internal link và canonical:

- Dùng internal link với anchor text rõ ràng để “báo hiệu” trang nào là authoritative cho một chủ đề.

- Nếu cần giữ nhiều trang tương tự, dùng canonical trỏ về trang ưu tiên để gom tín hiệu.

- Điều chỉnh kiến trúc site:

- Đảm bảo mỗi chủ đề chính chỉ có một landing page cốt lõi, các bài khác đóng vai trò hỗ trợ và liên kết về.

- Tránh tạo nhiều landing page quảng cáo, campaign khác nhau nhưng cùng nhắm một từ khóa SEO.

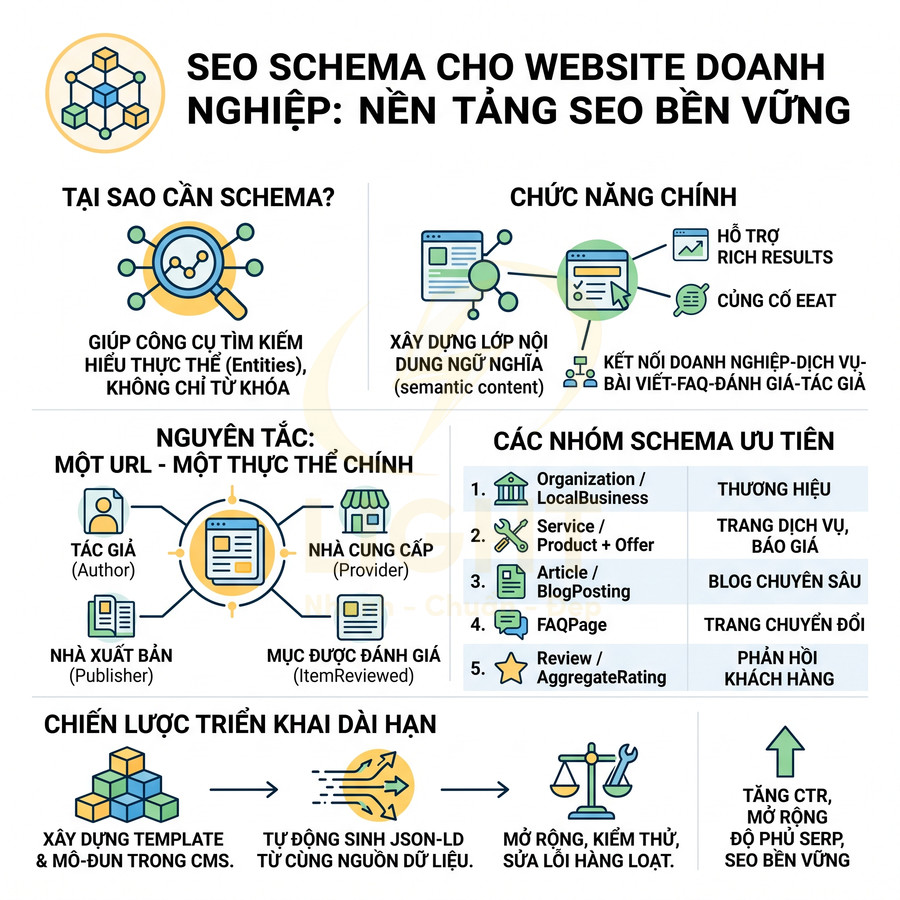

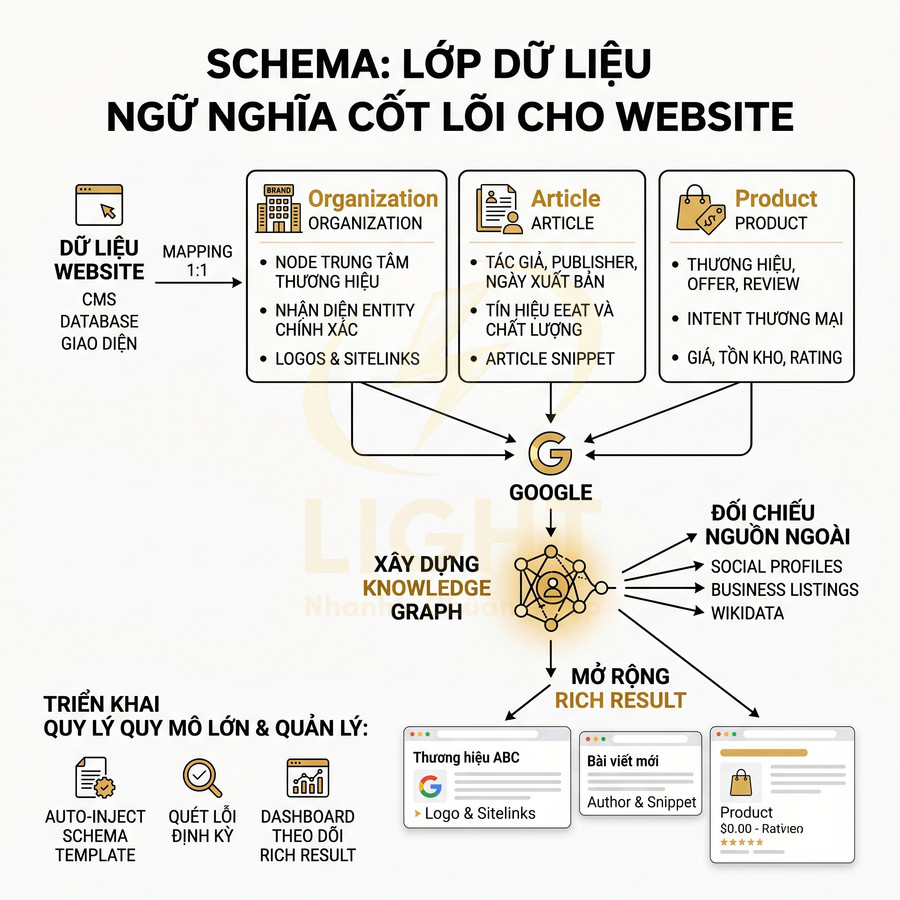

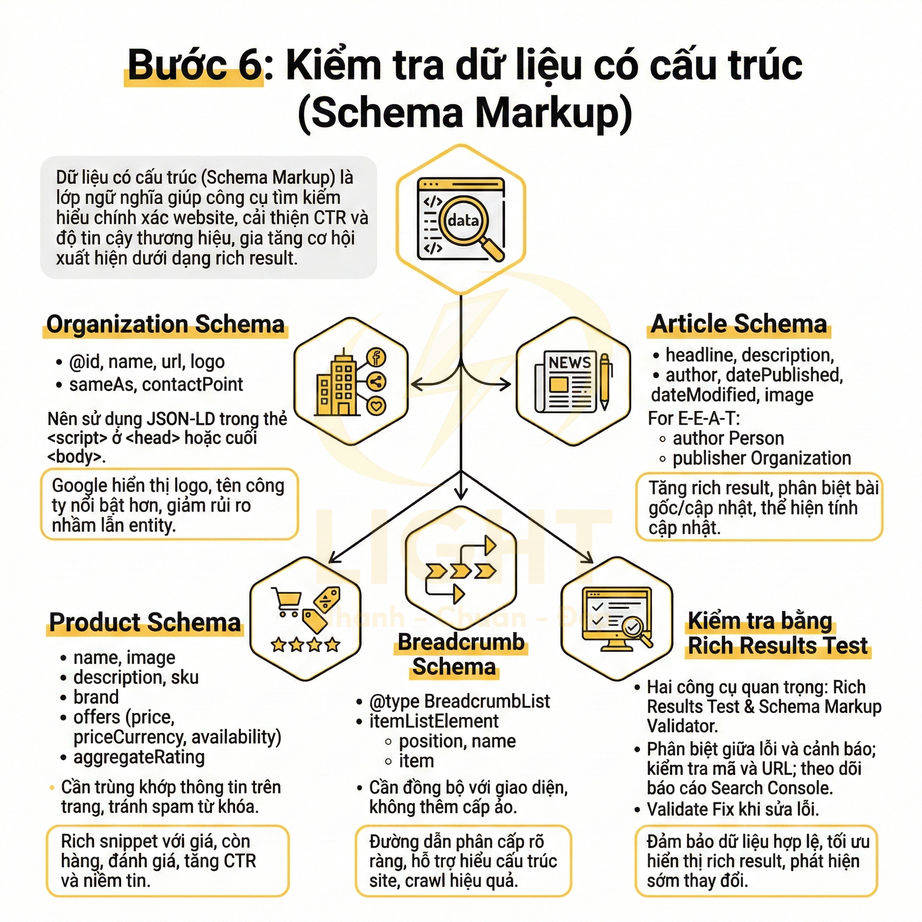

Bước 6: Kiểm tra dữ liệu có cấu trúc (Schema Markup)

Dữ liệu có cấu trúc (Schema Markup) là lớp ngữ nghĩa giúp công cụ tìm kiếm hiểu chính xác bản chất website, từ doanh nghiệp, bài viết đến sản phẩm và cấu trúc phân cấp nội dung. Khi triển khai đúng chuẩn, website không chỉ được thu thập dữ liệu tốt hơn mà còn gia tăng cơ hội xuất hiện dưới dạng rich result nổi bật trên SERP, cải thiện CTR và độ tin cậy thương hiệu.

Việc khai báo các schema quan trọng như Organization, Article, Product hay Breadcrumb cần đảm bảo tính nhất quán giữa dữ liệu hiển thị và dữ liệu khai báo. Đồng thời, kiểm tra định kỳ bằng công cụ chuyên dụng giúp phát hiện lỗi, tránh trùng lặp và duy trì tính chính xác, hợp lệ và khả năng kích hoạt hiển thị nâng cao theo guideline mới nhất của Google.

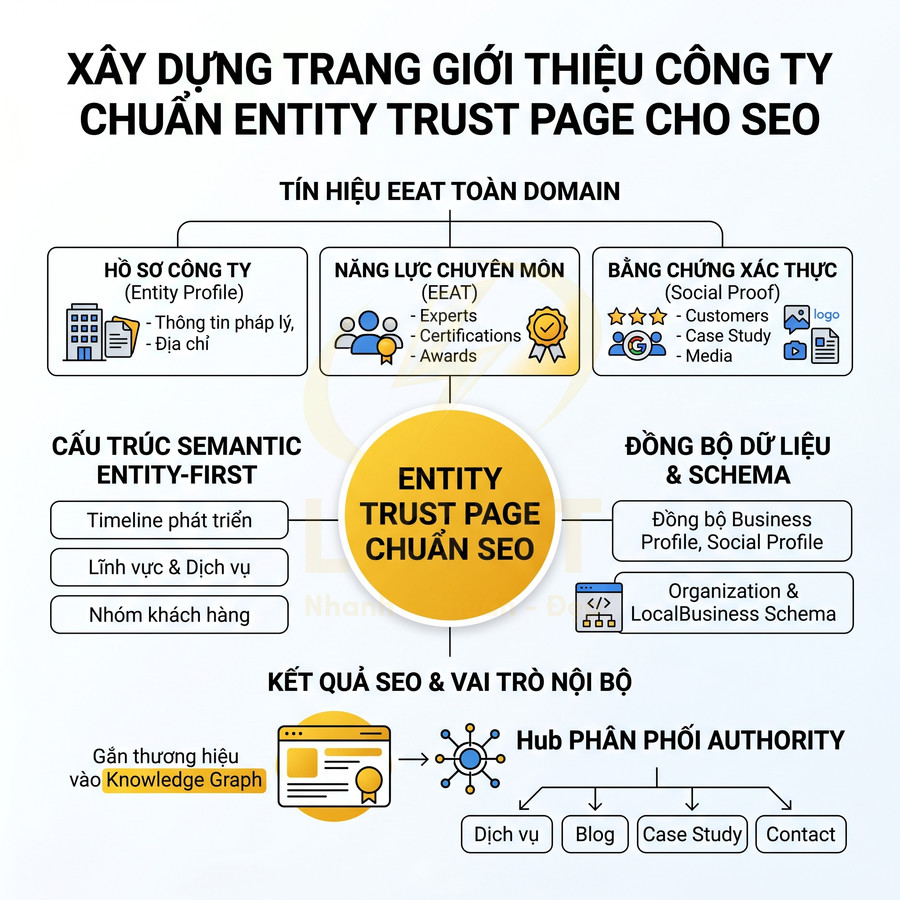

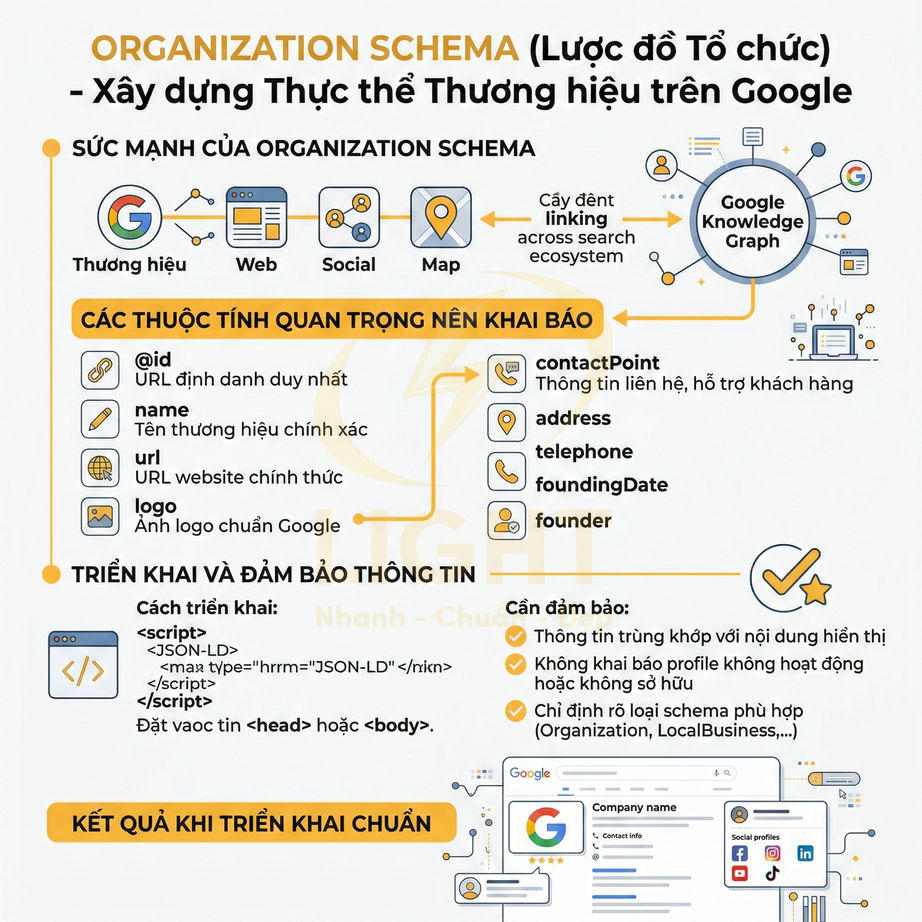

Organization Schema

Organization Schema không chỉ giúp Google hiểu doanh nghiệp là ai, mà còn giúp công cụ tìm kiếm xây dựng một thực thể (entity) rõ ràng trong Knowledge Graph. Khi triển khai đúng, Google có thể liên kết website với thương hiệu, địa chỉ, kênh social và các thông tin khác một cách nhất quán trên toàn bộ hệ sinh thái tìm kiếm.

Các thuộc tính quan trọng nên khai báo trong Organization hoặc LocalBusiness (nếu là doanh nghiệp địa phương) gồm:

- @id: URL định danh duy nhất cho entity doanh nghiệp (thường là URL trang chủ kèm anchor #organization).

- name: Tên thương hiệu chính xác, trùng khớp với tên hiển thị trên website và các kênh khác.

- url: URL chính thức của website.

- logo: URL ảnh logo chuẩn, kích thước và tỉ lệ phù hợp guideline của Google.

- sameAs: Danh sách URL các trang mạng xã hội và hồ sơ chính thức (Facebook, LinkedIn, YouTube, TikTok, Wikipedia…).

- contactPoint: Thông tin liên hệ (số điện thoại, email, loại hỗ trợ như customer service, sales, technical support).

- address, telephone, foundingDate, founder (nếu phù hợp với loại hình doanh nghiệp).

Nên sử dụng định dạng JSON-LD đặt trong thẻ <script type="application/ld+json"> ở <head> hoặc cuối <body> để dễ bảo trì và hạn chế lỗi. Cần đảm bảo:

- Thông tin trong schema trùng khớp với nội dung hiển thị trên trang (tên, logo, địa chỉ, số điện thoại).

- Không khai báo các social profile không còn hoạt động hoặc không thuộc sở hữu doanh nghiệp.

- Chỉ định rõ loại schema phù hợp: Organization, LocalBusiness, hoặc subtype như MedicalOrganization, EducationalOrganization…

Khi Organization Schema được triển khai chuẩn, Google có thể hiển thị logo thương hiệu, tên công ty và thông tin liên hệ nổi bật hơn trong kết quả tìm kiếm, đồng thời giảm rủi ro nhầm lẫn với các thực thể khác có tên tương tự.

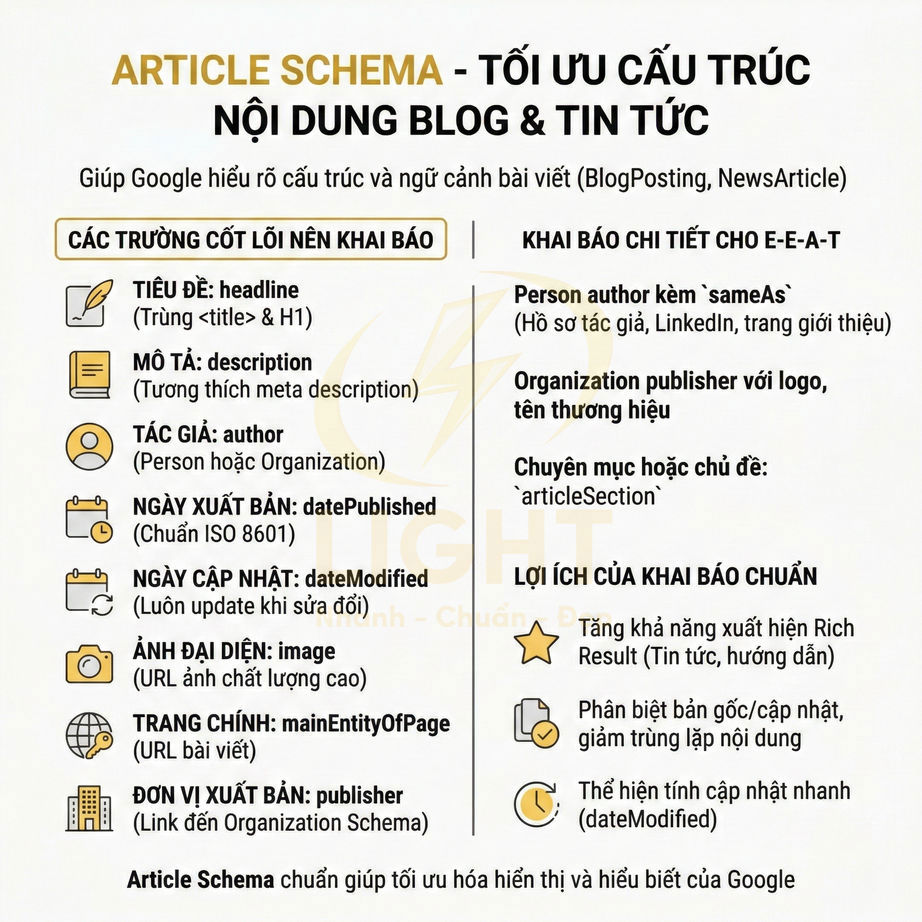

Article Schema

Đối với blog, chuyên mục tin tức hoặc tài nguyên nội dung, Article Schema (hoặc subtype như BlogPosting, NewsArticle) giúp Google hiểu rõ cấu trúc và ngữ cảnh của từng bài viết. Điều này đặc biệt quan trọng với các website xuất bản thường xuyên, nơi Google cần phân biệt bài mới, bài cập nhật, tác giả và chủ đề.

Các trường cốt lõi nên khai báo:

- headline: Tiêu đề bài viết, nên trùng hoặc rất gần với thẻ <title> và H1.

- description: Mô tả ngắn gọn nội dung, tương thích với meta description.

- author: Tên tác giả, có thể là Person hoặc Organization.

- datePublished: Ngày xuất bản lần đầu, theo chuẩn ISO 8601 (ví dụ: 2024-02-19T10:00:00+07:00).

- dateModified: Ngày cập nhật gần nhất, luôn update khi chỉnh sửa nội dung quan trọng.

- image: Một hoặc nhiều URL ảnh đại diện chất lượng cao.

- mainEntityOfPage: URL của bài viết, giúp Google hiểu đây là nội dung chính của trang.

- publisher: Thông tin đơn vị xuất bản, thường liên kết với Organization Schema.

Với các website có yếu tố E-E-A-T (Experience, Expertise, Authoritativeness, Trustworthiness) quan trọng, nên khai báo chi tiết hơn:

- author dạng Person kèm theo sameAs trỏ đến trang hồ sơ tác giả, LinkedIn, hoặc trang giới thiệu.

- publisher dạng Organization với logo, tên thương hiệu rõ ràng.

- articleSection: Chuyên mục hoặc chủ đề của bài viết.

Việc khai báo Article Schema chuẩn giúp:

- Tăng khả năng xuất hiện dưới dạng rich result, đặc biệt với tin tức hoặc bài hướng dẫn chuyên sâu.

- Giúp Google hiểu bài viết nào là bản gốc, bài nào là bản cập nhật, giảm nguy cơ trùng lặp nội dung.

- Thể hiện rõ tính cập nhật của nội dung thông qua dateModified, hỗ trợ tốt cho các chủ đề thay đổi nhanh.

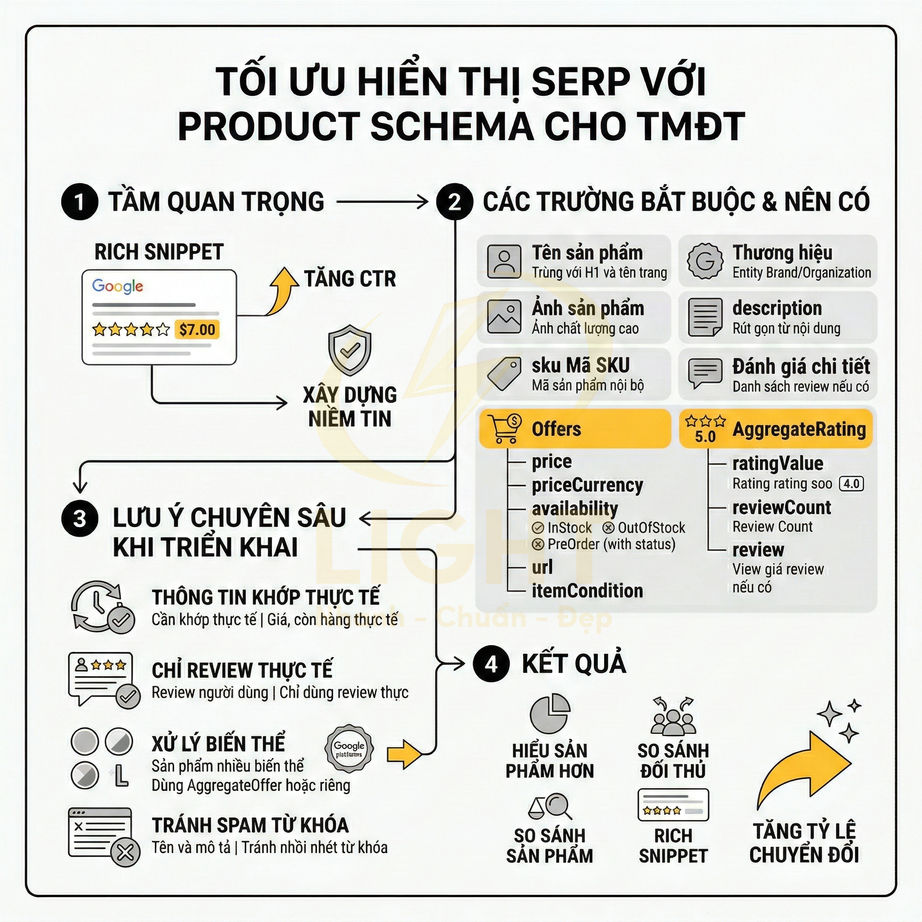

Product Schema

Đối với website thương mại điện tử hoặc trang bán sản phẩm, Product Schema là lớp dữ liệu có cấu trúc quan trọng nhất để tối ưu hiển thị trên SERP. Khi được triển khai đúng, sản phẩm có thể hiển thị rich snippet với giá, tình trạng còn hàng, đánh giá sao, số lượng review, giúp tăng CTR và niềm tin của người dùng.

Các trường bắt buộc và nên có trong Product Schema:

- name: Tên sản phẩm, trùng với H1 và tên hiển thị trên trang.

- image: Một hoặc nhiều ảnh sản phẩm chất lượng cao.

- description: Mô tả sản phẩm, có thể rút gọn từ nội dung chính.

- sku: Mã sản phẩm nội bộ.

- brand: Thương hiệu sản phẩm, có thể là text hoặc entity Brand/Organization.

- offers: Thông tin giá và tình trạng bán, thường là entity Offer hoặc AggregateOffer:

- price: Giá hiện tại.

- priceCurrency: Đơn vị tiền tệ (VD: VND, USD).

- availability: Tình trạng còn hàng (InStock, OutOfStock, PreOrder…).

- url: URL trang sản phẩm.

- itemCondition: Tình trạng sản phẩm (NewCondition, UsedCondition…).

- aggregateRating: Điểm đánh giá trung bình, nếu có:

- ratingValue: Điểm trung bình.

- reviewCount: Số lượng đánh giá.

- review: Danh sách review chi tiết, nếu muốn hiển thị sâu hơn.

Các lưu ý chuyên sâu khi triển khai Product Schema:

- Giá, tình trạng còn hàng, khuyến mãi trong schema phải khớp với thông tin hiển thị trên trang và cập nhật theo thời gian thực hoặc gần thực.

- Không khai báo đánh giá hoặc số sao nếu website không hiển thị review thực tế cho người dùng.

- Với sản phẩm có nhiều biến thể (màu, size), có thể dùng offers dạng AggregateOffer hoặc cấu trúc riêng cho từng biến thể, nhưng cần tuân thủ guideline của Google.

- Tránh spam từ khóa trong name và description, tập trung mô tả chính xác sản phẩm.

Khi Product Schema được tối ưu tốt, Google có nhiều tín hiệu hơn để hiểu sản phẩm, so sánh với đối thủ và quyết định hiển thị rich snippet, từ đó hỗ trợ tăng tỷ lệ chuyển đổi từ kết quả tìm kiếm.

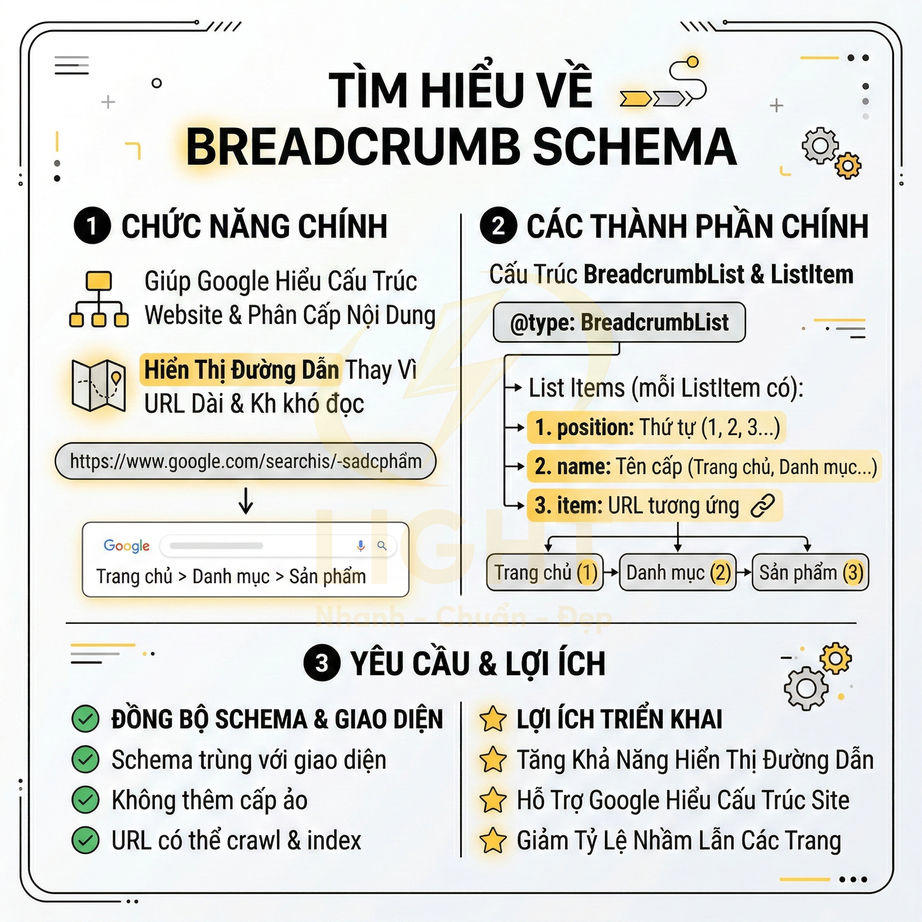

Breadcrumb Schema

Breadcrumb Schema giúp Google hiểu cấu trúc phân cấp nội dung trên website, từ đó hiển thị đường dẫn breadcrumb thay cho URL dài và khó đọc. Điều này không chỉ cải thiện trải nghiệm người dùng trên SERP mà còn giúp Google nắm rõ mối quan hệ giữa các trang trong hệ thống phân cấp.

Các thành phần chính trong BreadcrumbList:

- @type: BreadcrumbList.

- itemListElement: Danh sách các bước breadcrumb, mỗi phần tử là một ListItem:

- position: Thứ tự trong breadcrumb (1, 2, 3…).

- name: Tên cấp (ví dụ: Trang chủ, Danh mục, Sản phẩm).

- item: URL tương ứng với cấp đó.

Cần đồng bộ giữa breadcrumb hiển thị trên giao diện và schema:

- Các cấp trong schema phải trùng với breadcrumb người dùng nhìn thấy trên trang.

- Không thêm cấp ảo trong schema nếu không tồn tại trên giao diện.

- Đảm bảo mỗi URL trong breadcrumb có thể crawl và index bình thường.

Việc triển khai Breadcrumb Schema chuẩn giúp:

- Tăng khả năng Google hiển thị đường dẫn phân cấp rõ ràng, thay vì URL dài và khó hiểu.

- Hỗ trợ Google hiểu cấu trúc site, từ đó phân bổ internal link và crawl budget hiệu quả hơn.

- Giảm tỷ lệ nhầm lẫn khi nhiều trang có cấu trúc URL tương tự nhưng thuộc các nhánh nội dung khác nhau.

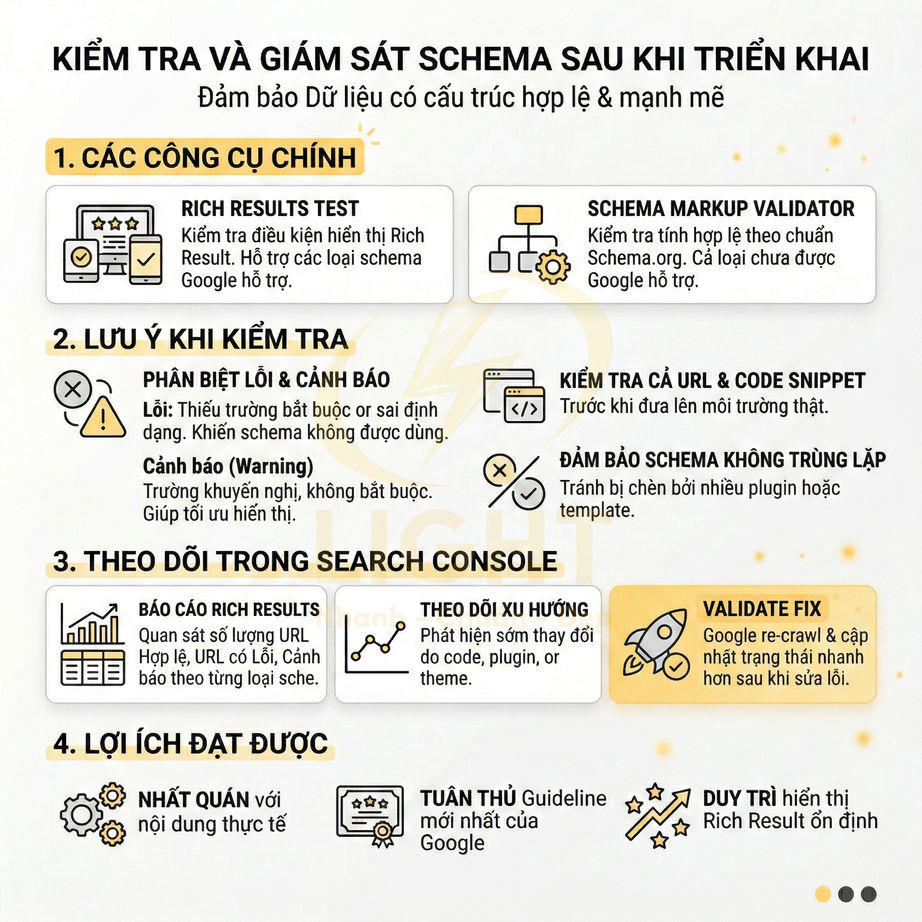

Kiểm tra bằng Rich Results Test

Sau khi triển khai schema, bước kiểm tra và giám sát là bắt buộc để đảm bảo dữ liệu có cấu trúc hợp lệ và đủ mạnh để kích hoạt rich result. Hai công cụ quan trọng:

- Rich Results Test: Kiểm tra khả năng trang đủ điều kiện hiển thị rich result cho các loại schema được Google hỗ trợ.

- Schema Markup Validator: Kiểm tra tính hợp lệ của schema theo chuẩn Schema.org, bao gồm cả những loại chưa được Google hỗ trợ rich result.

Khi sử dụng các công cụ này, cần chú ý:

- Phân biệt giữa lỗi (error) và cảnh báo (warning):

- Lỗi thường liên quan đến trường bắt buộc bị thiếu hoặc sai định dạng, có thể khiến schema không được sử dụng.

- Cảnh báo thường là trường khuyến nghị, không bắt buộc nhưng nên bổ sung để tối ưu hiển thị.

- Kiểm tra cả dạng URL (trang đã online) và dạng code snippet (đoạn JSON-LD) trước khi đưa lên môi trường thật.

- Đảm bảo schema không bị chèn trùng lặp bởi nhiều plugin hoặc template khác nhau.

Sau khi xác nhận schema hợp lệ, cần theo dõi báo cáo Rich Results trong Search Console:

- Quan sát số lượng URL hợp lệ, URL có lỗi, URL có cảnh báo theo từng loại schema (Product, Article, Breadcrumb…).

- Theo dõi xu hướng theo thời gian để phát hiện sớm các thay đổi do cập nhật code, plugin hoặc theme.

- Khi sửa lỗi schema, sử dụng tính năng Validate Fix để Google re-crawl và cập nhật trạng thái nhanh hơn.

Việc kiểm tra định kỳ giúp đảm bảo dữ liệu có cấu trúc luôn nhất quán với nội dung thực tế, tuân thủ guideline mới nhất của Google, và duy trì khả năng hiển thị rich result ổn định cho toàn bộ hệ thống URL quan trọng.

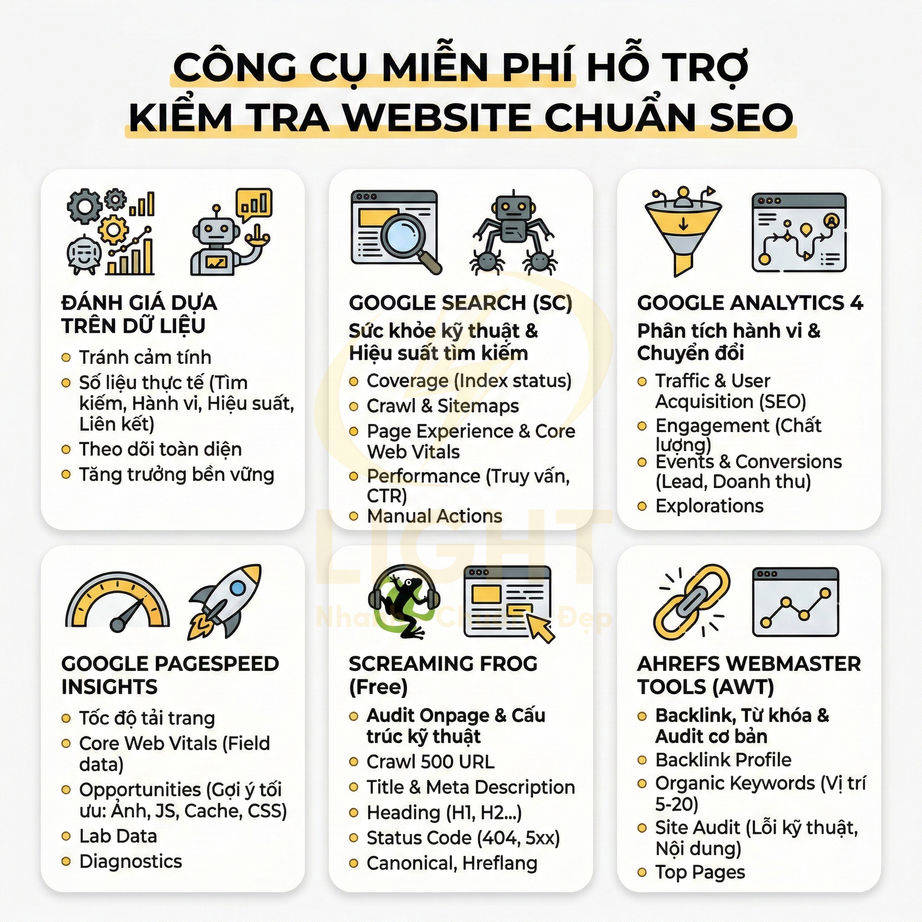

Công cụ miễn phí hỗ trợ kiểm tra website chuẩn SEO

Đánh giá website chuẩn SEO cần dựa trên dữ liệu tìm kiếm, hành vi người dùng, hiệu suất kỹ thuật và hồ sơ liên kết thay vì cảm tính. Các công cụ miễn phí hiện nay cho phép theo dõi từ trạng thái index, truy vấn và CTR, đến Core Web Vitals, cấu trúc onpage và chất lượng backlink. Khi kết hợp đúng cách, dữ liệu từ nhiều nguồn sẽ tạo thành bức tranh toàn diện: truy vấn nào mang lại traffic, trang nào giữ chân tốt, điểm nghẽn hiệu suất nằm ở đâu và cơ hội tối ưu nào còn bỏ ngỏ. Nhờ đó, website được kiểm tra và cải thiện dựa trên số liệu thực tế, hình thành nền tảng tăng trưởng organic bền vững và kiểm soát rủi ro kỹ thuật dài hạn.

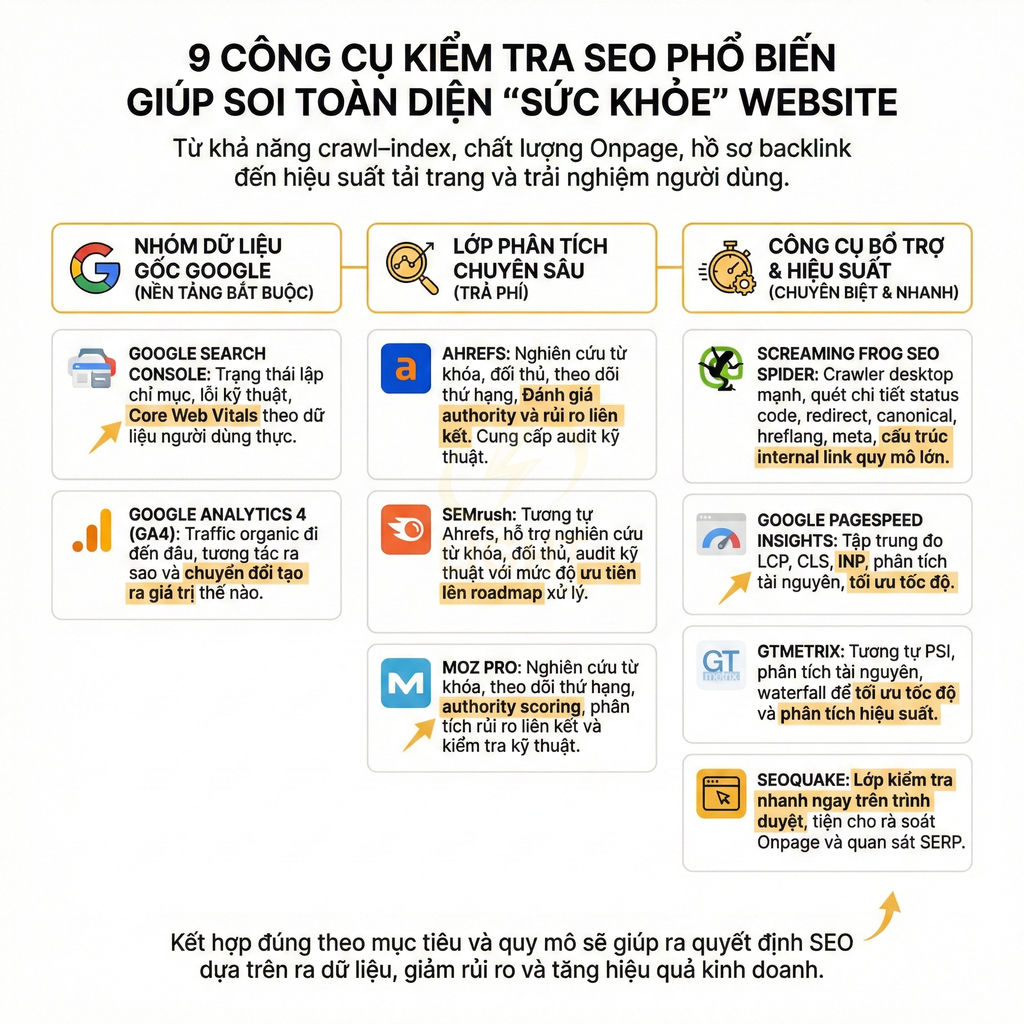

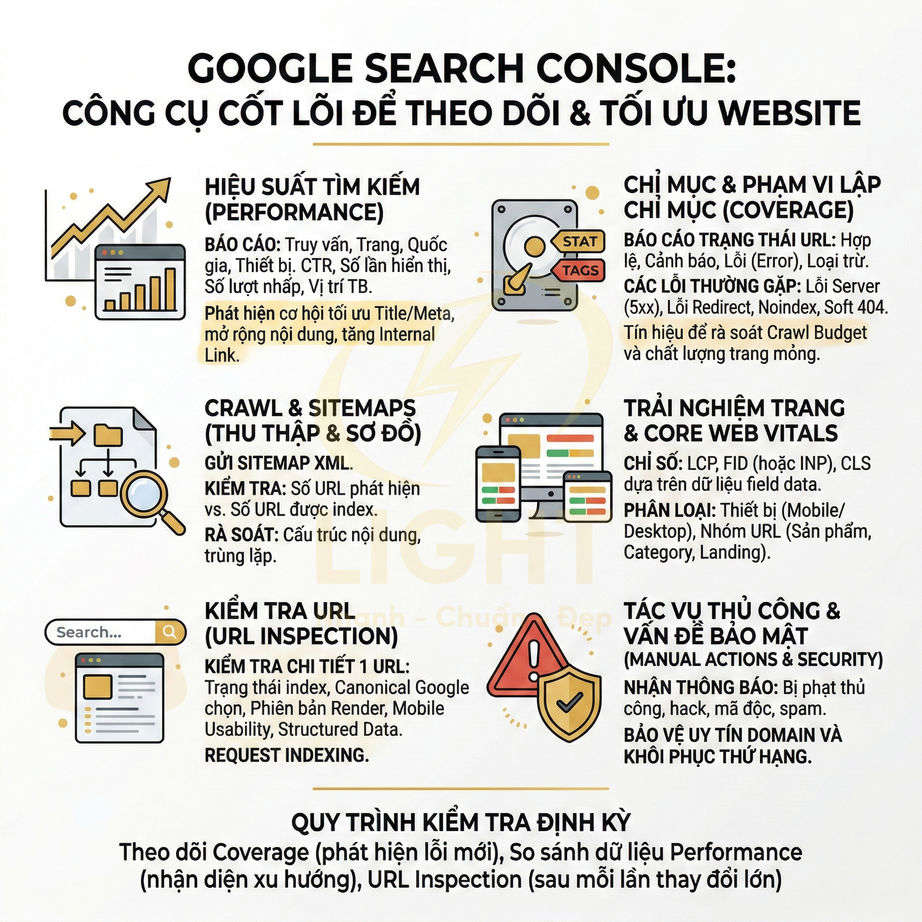

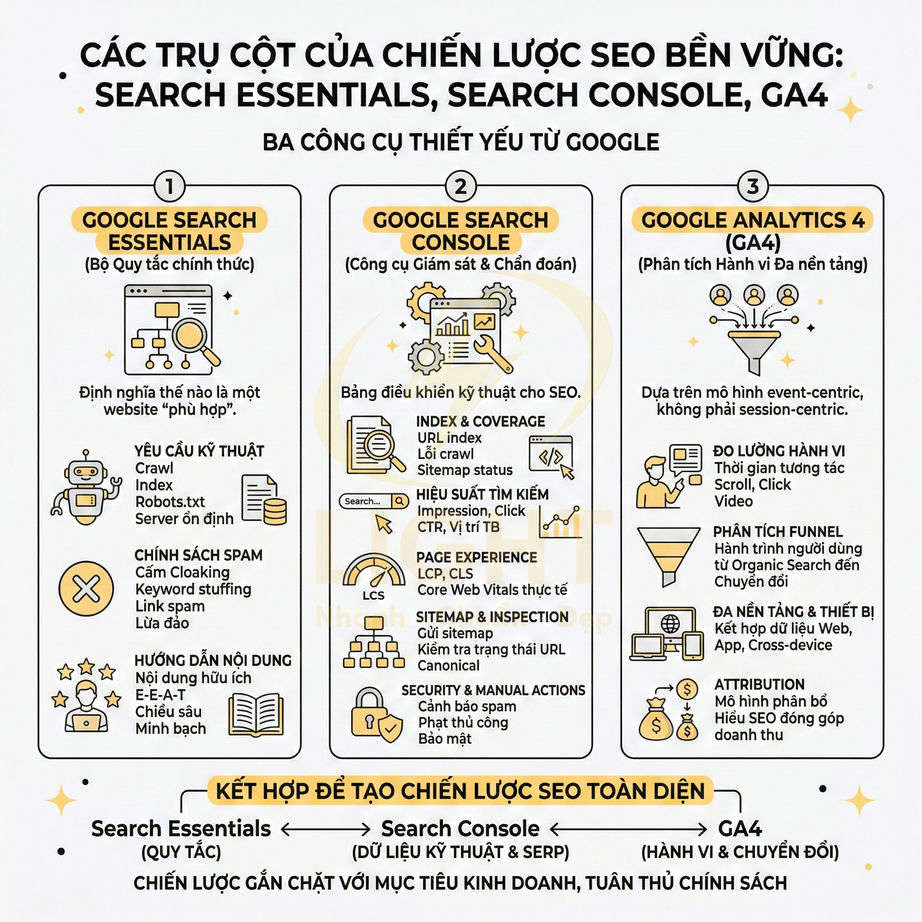

Google Search Console

Google Search Console là công cụ cốt lõi để theo dõi hiệu suất tìm kiếm và sức khỏe kỹ thuật của website trong hệ sinh thái Google. Không chỉ dừng ở việc xem tổng traffic, công cụ này cho phép phân tích sâu từng truy vấn, từng URL và từng loại vấn đề kỹ thuật ảnh hưởng trực tiếp đến khả năng index và xếp hạng.

Ở góc độ kỹ thuật, Google Search Console cung cấp:

- Coverage / Indexing: Báo cáo trạng thái index của toàn bộ URL, phân loại thành Valid, Valid with warnings, Error, Excluded. Có thể phân tích chi tiết các lỗi như Server error (5xx), Redirect error, Submitted URL marked ‘noindex’, Soft 404, giúp xác định chính xác nhóm URL đang bị lãng phí crawl budget hoặc không thể xuất hiện trên SERP.

- Crawl & Sitemaps: Cho phép gửi sitemap XML, kiểm tra số URL được phát hiện và số URL thực sự được index. Khi có sự chênh lệch lớn, đó là tín hiệu cần rà soát lại cấu trúc nội dung, chất lượng trang mỏng (thin content) hoặc vấn đề trùng lặp nội dung.

- Page Experience & Core Web Vitals: Theo dõi các chỉ số LCP, FID (hoặc INP), CLS dựa trên dữ liệu người dùng thực (field data). Có thể lọc theo loại thiết bị (mobile/desktop) và nhóm URL tương tự (URL groups) để ưu tiên tối ưu các template quan trọng như trang sản phẩm, category, landing page.

- URL Inspection: Kiểm tra một URL cụ thể để biết trạng thái index, canonical mà Google chọn, phiên bản đã render, dữ liệu cấu trúc (structured data) và các vấn đề liên quan đến mobile usability. Tính năng Request Indexing hữu ích khi vừa xuất bản hoặc cập nhật nội dung quan trọng.

- Performance: Báo cáo truy vấn, trang, quốc gia, thiết bị, loại giao diện tìm kiếm (web, image, video, Discover). Có thể lọc theo query, URL, hoặc kết hợp nhiều filter để phát hiện:

- Trang có nhiều impression nhưng CTR thấp → cần tối ưu title, meta description, rich snippet.

- Truy vấn có vị trí trung bình tốt nhưng traffic thấp → cơ hội mở rộng nội dung, tăng internal link.

- Truy vấn mang lại chuyển đổi cao (khi kết hợp với dữ liệu GA4) → ưu tiên tối ưu sâu hơn.

- Manual Actions & Security Issues: Nhận thông báo khi website bị phạt thủ công, bị hack, chèn mã độc, hoặc có nội dung spam. Đây là lớp cảnh báo quan trọng để bảo vệ uy tín domain và khôi phục thứ hạng.

Khi triển khai SEO chuyên sâu, nên thiết lập quy trình kiểm tra định kỳ: theo dõi báo cáo Coverage để phát hiện lỗi mới, so sánh dữ liệu Performance theo tuần/tháng để nhận diện xu hướng giảm thứ hạng, và dùng URL Inspection sau mỗi lần thay đổi lớn về cấu trúc hoặc triển khai redirect.

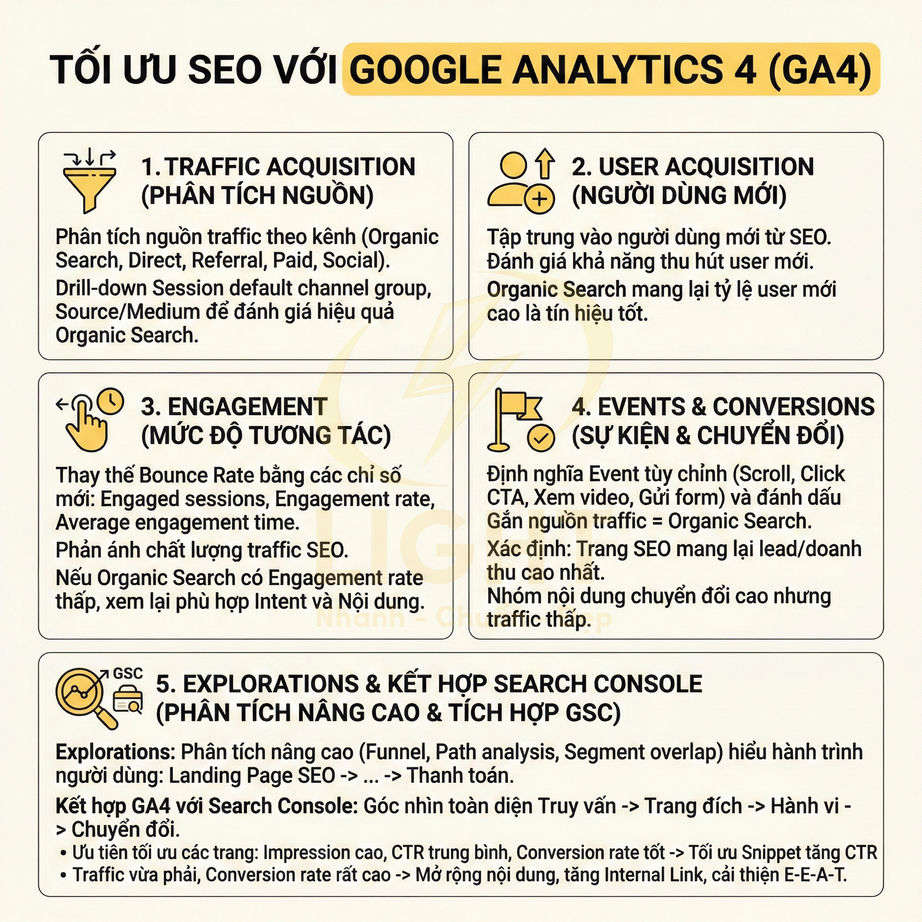

Google Analytics 4

Google Analytics 4 (GA4) là nền tảng phân tích hành vi người dùng dựa trên mô hình event-centric, cho phép hiểu sâu cách người dùng tương tác với website sau khi truy cập từ kết quả tìm kiếm. Khi kết hợp với Google Search Console, GA4 giúp nối liền dữ liệu từ truy vấn → phiên truy cập → hành vi → chuyển đổi.

Các khía cạnh quan trọng trong GA4 phục vụ kiểm tra website chuẩn SEO:

- Traffic Acquisition: Phân tích nguồn traffic theo kênh (Organic Search, Direct, Referral, Paid, Social). Có thể drill-down đến cấp độ session default channel group, source/medium để đánh giá chính xác hiệu quả của Organic Search so với các kênh khác.

- User Acquisition: Tập trung vào người dùng mới, giúp đánh giá khả năng thu hút user mới từ SEO. Khi organic mang lại tỷ lệ user mới cao, đó là tín hiệu tốt về khả năng mở rộng thị trường.

- Engagement: GA4 thay thế các chỉ số cũ như Bounce Rate bằng Engaged sessions, Engagement rate, Average engagement time. Các chỉ số này phản ánh chất lượng traffic SEO: nếu phiên organic có engagement rate thấp, cần xem lại mức độ phù hợp giữa intent truy vấn và nội dung trang.

- Events & Conversions: GA4 cho phép định nghĩa event tùy chỉnh (scroll, click vào CTA, xem video, gửi form) và đánh dấu chúng là conversion. Khi gắn nguồn traffic = Organic Search, có thể xác định:

- Trang SEO nào mang lại nhiều lead hoặc doanh thu nhất.

- Nhóm nội dung nào có tỷ lệ chuyển đổi cao nhưng traffic còn thấp → ưu tiên mở rộng và tăng internal link.

- Explorations: Tính năng phân tích nâng cao (funnel, path analysis, segment overlap) giúp hiểu hành trình người dùng từ trang landing SEO đến các bước tiếp theo. Ví dụ: phân tích funnel từ trang blog → trang sản phẩm → thêm vào giỏ → thanh toán.

Khi tích hợp GA4 với Search Console, có thể tạo góc nhìn toàn diện: truy vấn → trang đích → hành vi → chuyển đổi. Từ đó, ưu tiên tối ưu các trang có:

- Impression cao, CTR trung bình, nhưng conversion rate tốt → tối ưu snippet để tăng CTR.

- Traffic vừa phải nhưng conversion rate rất cao → mở rộng nội dung, tăng internal link, cải thiện E-E-A-T.

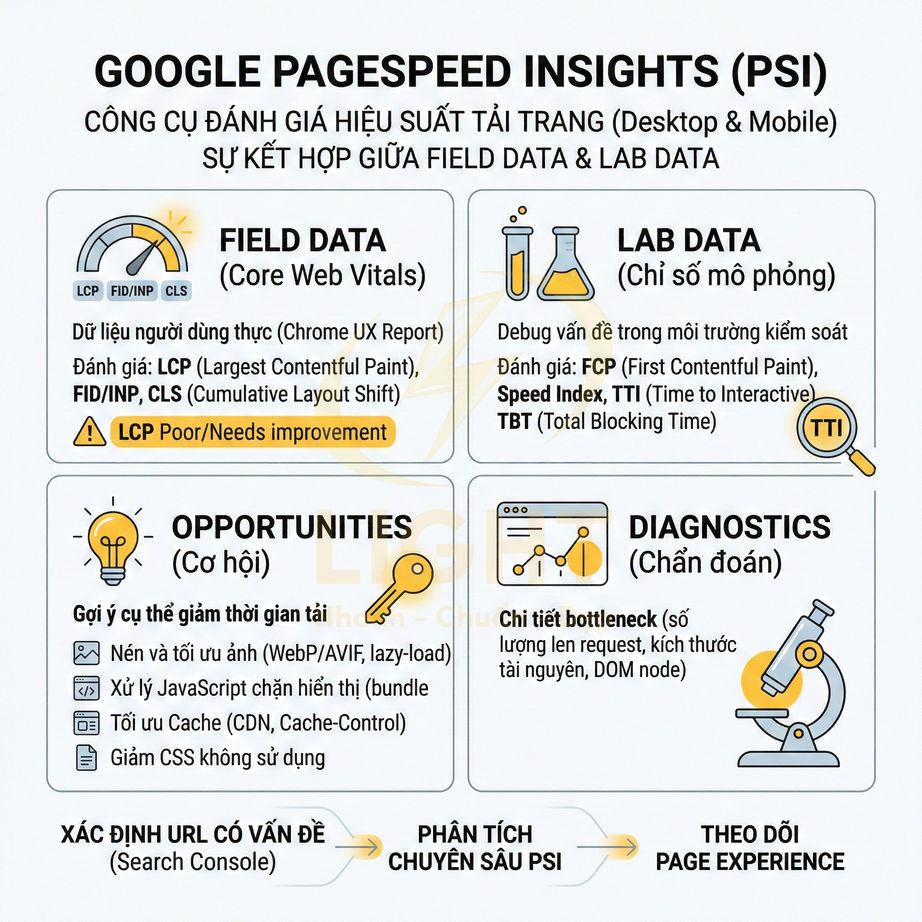

Google PageSpeed Insights

Google PageSpeed Insights (PSI) là công cụ đánh giá hiệu suất tải trang cho cả mobile và desktop, kết hợp giữa lab data (dữ liệu mô phỏng) và field data (Chrome UX Report). Đây là công cụ quan trọng khi tối ưu Page Experience và Core Web Vitals, hai yếu tố ảnh hưởng trực tiếp đến trải nghiệm người dùng và gián tiếp đến SEO.

Các thành phần chính trong báo cáo PSI:

- Field Data (Core Web Vitals): Hiển thị LCP, FID/INP, CLS dựa trên dữ liệu người dùng thực. Nếu một trong các chỉ số này ở mức Needs improvement hoặc Poor, cần ưu tiên tối ưu vì nó phản ánh trải nghiệm thực tế.

- Lab Data: Các chỉ số như First Contentful Paint (FCP), Speed Index, Time to Interactive (TTI), Total Blocking Time (TBT). Đây là cơ sở để debug các vấn đề hiệu suất trong môi trường kiểm soát.

- Opportunities: Gợi ý cụ thể giúp giảm thời gian tải, ví dụ:

- Nén và tối ưu kích thước ảnh (sử dụng định dạng WebP/AVIF, lazy-load).

- Loại bỏ hoặc trì hoãn JavaScript chặn hiển thị (render-blocking JS), tách bundle, sử dụng code splitting.

- Tối ưu cache trình duyệt bằng cách cấu hình header Cache-Control, ETag, và sử dụng CDN.

- Giảm kích thước CSS, loại bỏ CSS không sử dụng (unused CSS).

- Diagnostics: Cung cấp thông tin chi tiết hơn như số lượng request, kích thước tổng tài nguyên, thời gian main-thread bận, số lượng DOM node. Các chỉ số này giúp developer xác định chính xác bottleneck.

Khi tối ưu SEO kỹ thuật, nên kết hợp PSI với dữ liệu Core Web Vitals trong Search Console để:

- Xác định nhóm URL có vấn đề hiệu suất trên diện rộng (Search Console).

- Dùng PSI để phân tích sâu từng URL đại diện, tìm nguyên nhân gốc (root cause).

- Theo dõi lại sau khi triển khai thay đổi để đảm bảo không làm giảm chất lượng Page Experience.

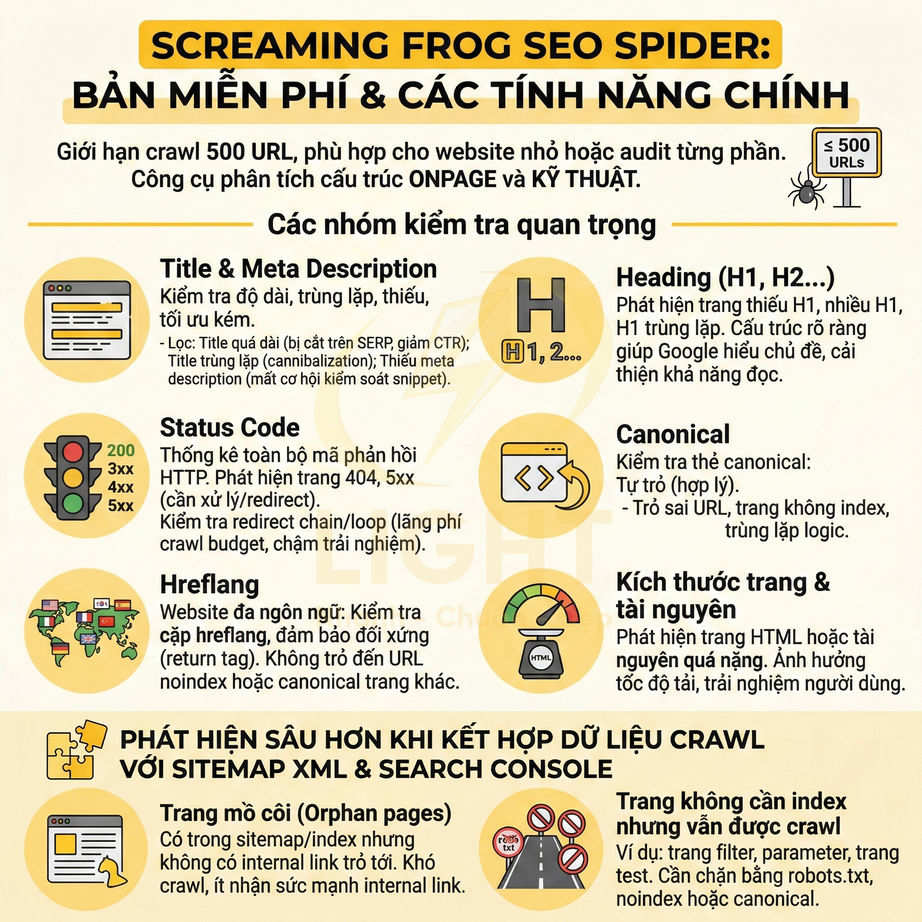

Screaming Frog SEO Spider

Screaming Frog SEO Spider bản miễn phí cho phép crawl đến 500 URL, đủ cho nhiều website nhỏ hoặc để audit từng phần của website lớn. Đây là công cụ mạnh để phân tích cấu trúc onpage và phát hiện các vấn đề kỹ thuật ảnh hưởng đến khả năng crawl và index.

Các nhóm kiểm tra quan trọng khi dùng Screaming Frog:

- Title & Meta Description: Kiểm tra độ dài, trùng lặp, thiếu, hoặc tối ưu kém. Có thể lọc:

- Title quá dài → dễ bị cắt trên SERP, giảm CTR.

- Title trùng lặp → gây cannibalization, khó phân biệt chủ đề.

- Thiếu meta description → mất cơ hội kiểm soát snippet.

- Heading (H1, H2...): Phát hiện trang thiếu H1, có nhiều H1, hoặc H1 trùng lặp. Cấu trúc heading rõ ràng giúp Google hiểu chủ đề chính và phụ, đồng thời cải thiện khả năng đọc của người dùng.

- Status Code: Thống kê toàn bộ mã phản hồi HTTP (200, 3xx, 4xx, 5xx). Từ đó:

- Phát hiện trang 404, 5xx cần xử lý hoặc redirect.

- Kiểm tra redirect chain, redirect loop gây lãng phí crawl budget và làm chậm trải nghiệm.

- Canonical: Kiểm tra thẻ canonical để phát hiện:

- Canonical tự trỏ (self-referencing) hợp lý.

- Canonical trỏ sai URL, trỏ đến trang không index, hoặc trùng lặp logic.

- Hreflang: Với website đa ngôn ngữ/đa quốc gia, Screaming Frog giúp kiểm tra cặp hreflang, đảm bảo có sự đối xứng (return tag) và không trỏ đến URL bị noindex hoặc canonical sang trang khác.

- Kích thước trang & tài nguyên: Phát hiện trang có HTML hoặc tài nguyên quá nặng, ảnh hưởng đến tốc độ tải và trải nghiệm người dùng.

Khi kết hợp dữ liệu crawl của Screaming Frog với sitemap XML và dữ liệu từ Search Console, có thể phát hiện:

- Trang mồ côi (orphan pages): Trang có trong sitemap hoặc được index nhưng không có internal link trỏ tới. Những trang này khó được crawl thường xuyên và ít nhận sức mạnh internal link.

- Trang không cần index nhưng vẫn được crawl: Ví dụ trang filter, parameter, trang test → cần chặn bằng robots.txt, noindex hoặc cấu hình canonical phù hợp.

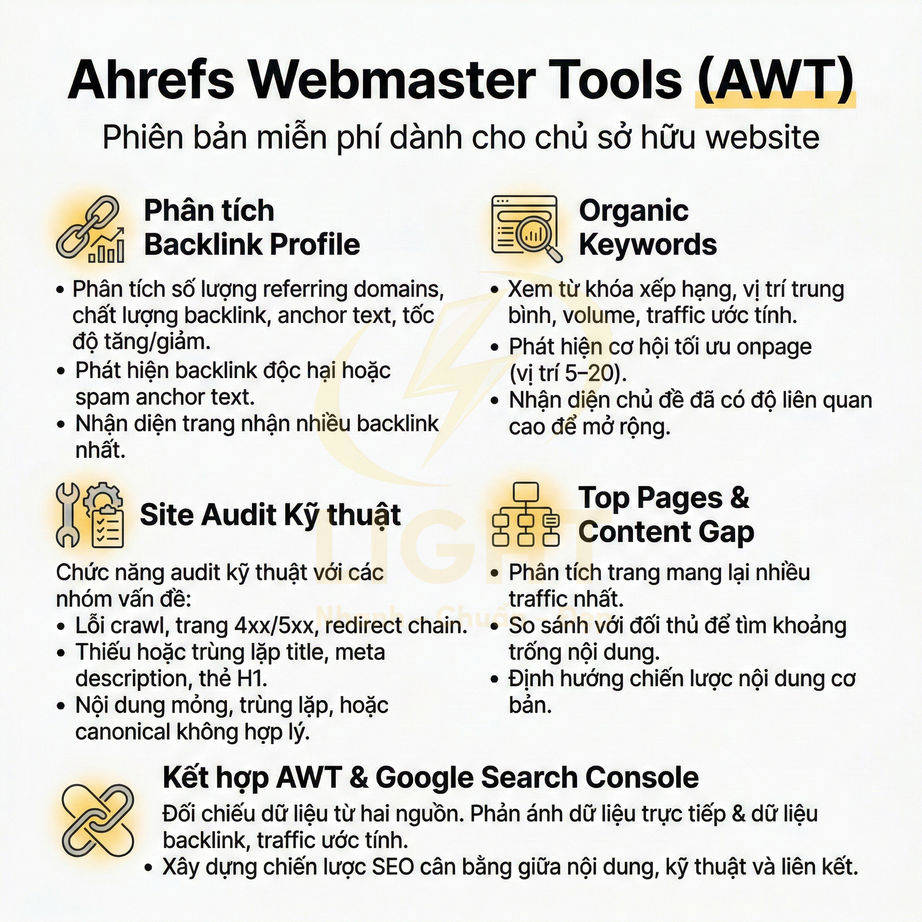

Ahrefs Webmaster Tools

Ahrefs Webmaster Tools (AWT) là phiên bản miễn phí dành cho chủ sở hữu website, cho phép truy cập một phần dữ liệu mạnh mẽ của Ahrefs mà không cần mua gói trả phí đầy đủ. Công cụ này đặc biệt hữu ích để kiểm tra backlink, organic keywords và các lỗi kỹ thuật cơ bản, hỗ trợ cả onpage lẫn offpage SEO.

Các tính năng quan trọng trong AWT phục vụ kiểm tra website chuẩn SEO:

- Backlink Profile: Phân tích số lượng referring domains, chất lượng backlink, anchor text, tốc độ tăng/giảm backlink theo thời gian. Có thể:

- Phát hiện backlink độc hại hoặc spam anchor text → cân nhắc disavow.

- Nhận diện trang nhận nhiều backlink nhất → tối ưu internal link để phân phối sức mạnh.

- Organic Keywords: Xem các từ khóa mà website đang xếp hạng, vị trí trung bình, volume, traffic ước tính. Điều này giúp:

- Phát hiện từ khóa đang ở vị trí 5–20 → cơ hội tối ưu onpage, internal link để đẩy lên top.

- Nhận diện chủ đề mà website đã có độ liên quan cao → mở rộng cụm chủ đề (topic cluster).

- Site Audit: AWT cung cấp chức năng audit kỹ thuật với các nhóm vấn đề:

- Lỗi crawl, trang 4xx/5xx, redirect chain.

- Thiếu hoặc trùng lặp title, meta description, thẻ H1.