Sitemap XML và robots.txt ảnh hưởng gì đến website chuẩn SEO?

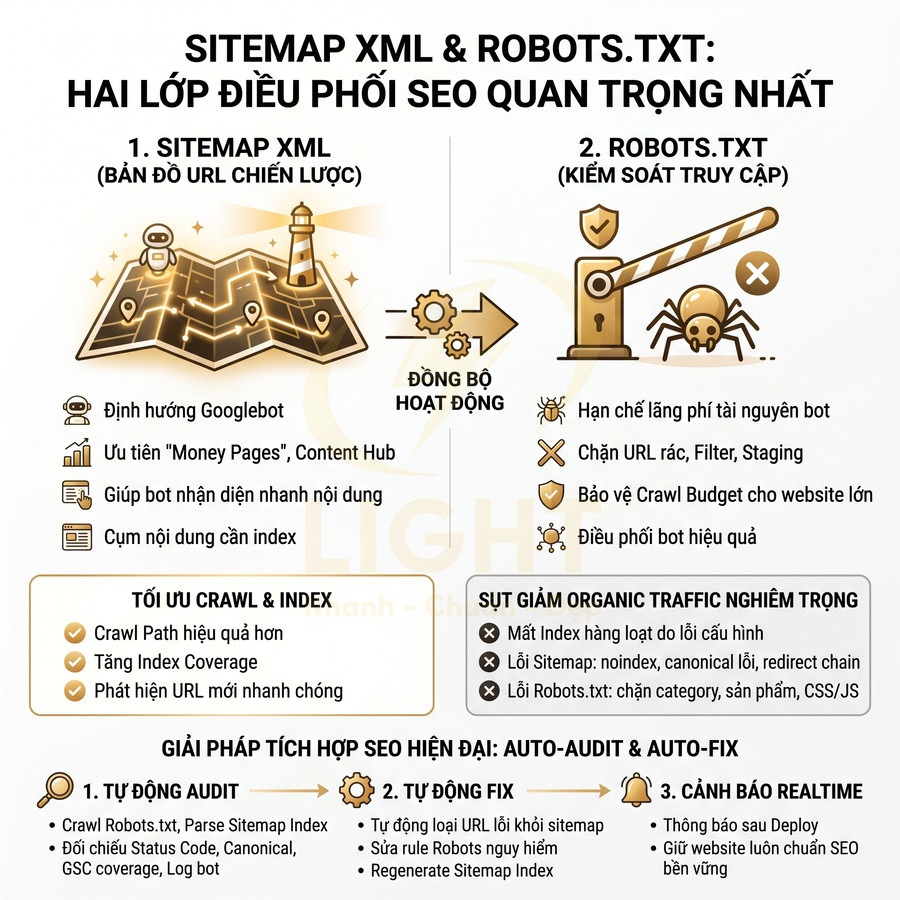

Sitemap XML và robots.txt là hai lớp điều phối crawl và index quan trọng nhất trong technical SEO, quyết định cách Googlebot khám phá, ưu tiên và phân bổ crawl budget trên toàn website. Nếu sitemap đóng vai trò “bản đồ URL chiến lược”, giúp bot nhận diện nhanh money page, content hub và các cụm nội dung cần index, thì robots.txt lại là “lớp kiểm soát truy cập”, ngăn bot lãng phí tài nguyên vào URL rác, filter vô hạn, staging hoặc các vùng không phục vụ SEO. Khi hai thành phần này đồng bộ, website sẽ tối ưu rõ rệt về crawl path, index coverage và tốc độ phát hiện URL mới.

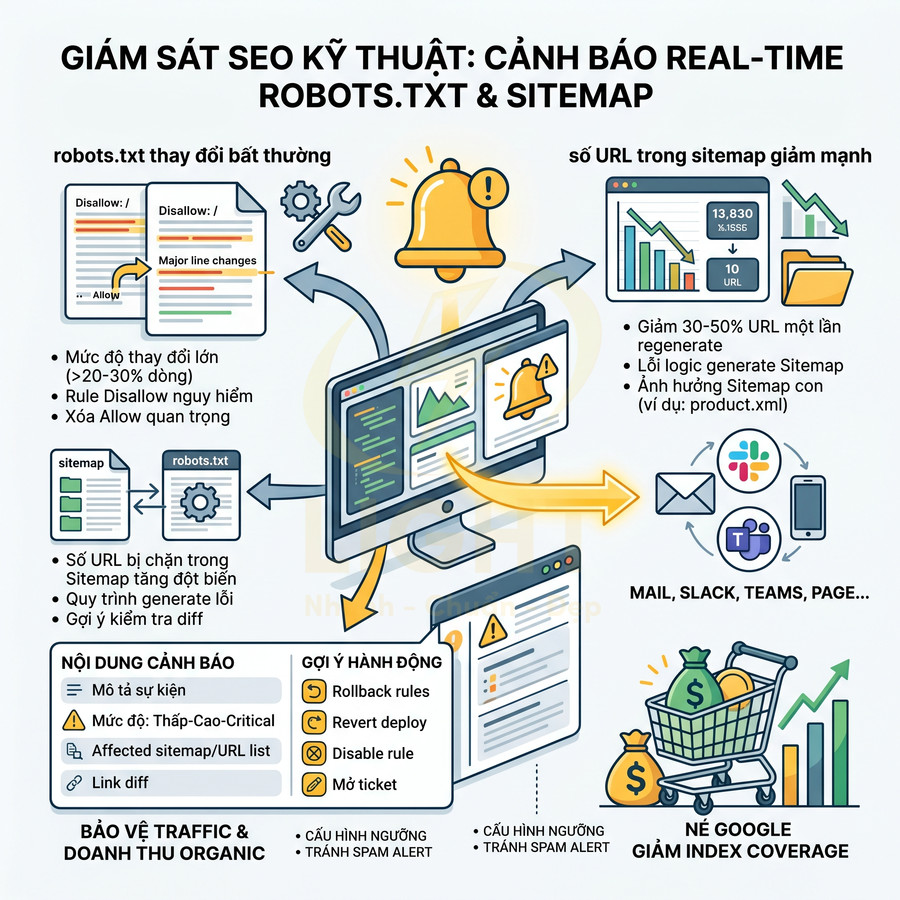

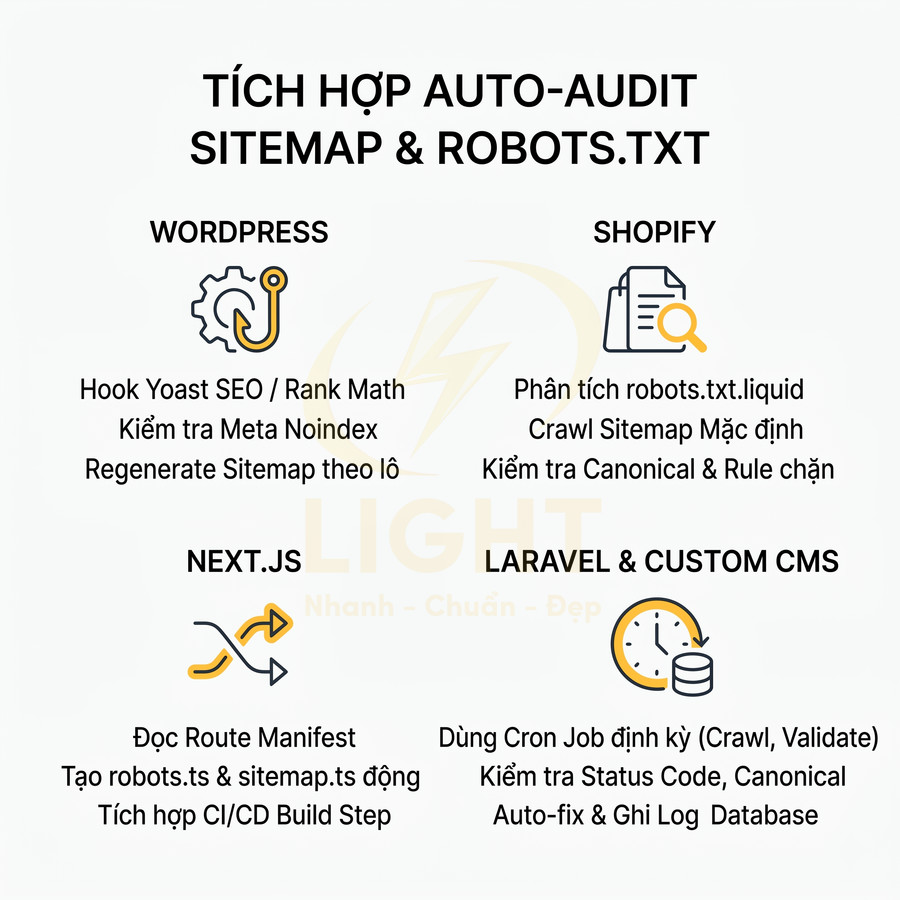

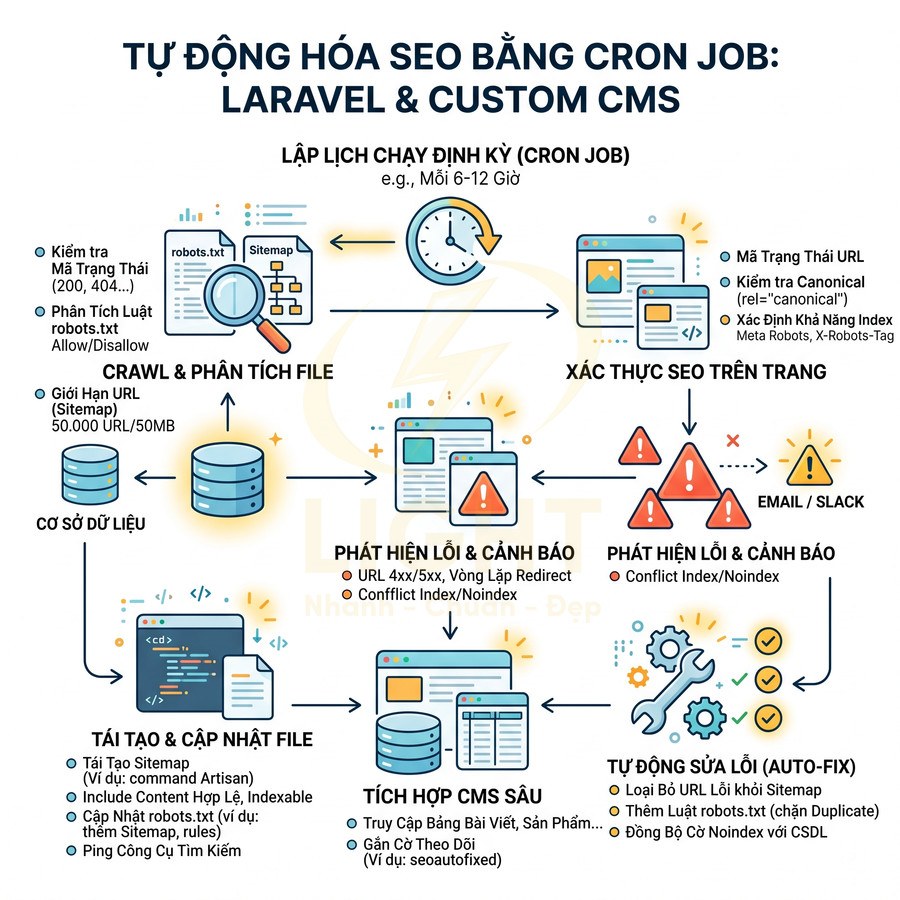

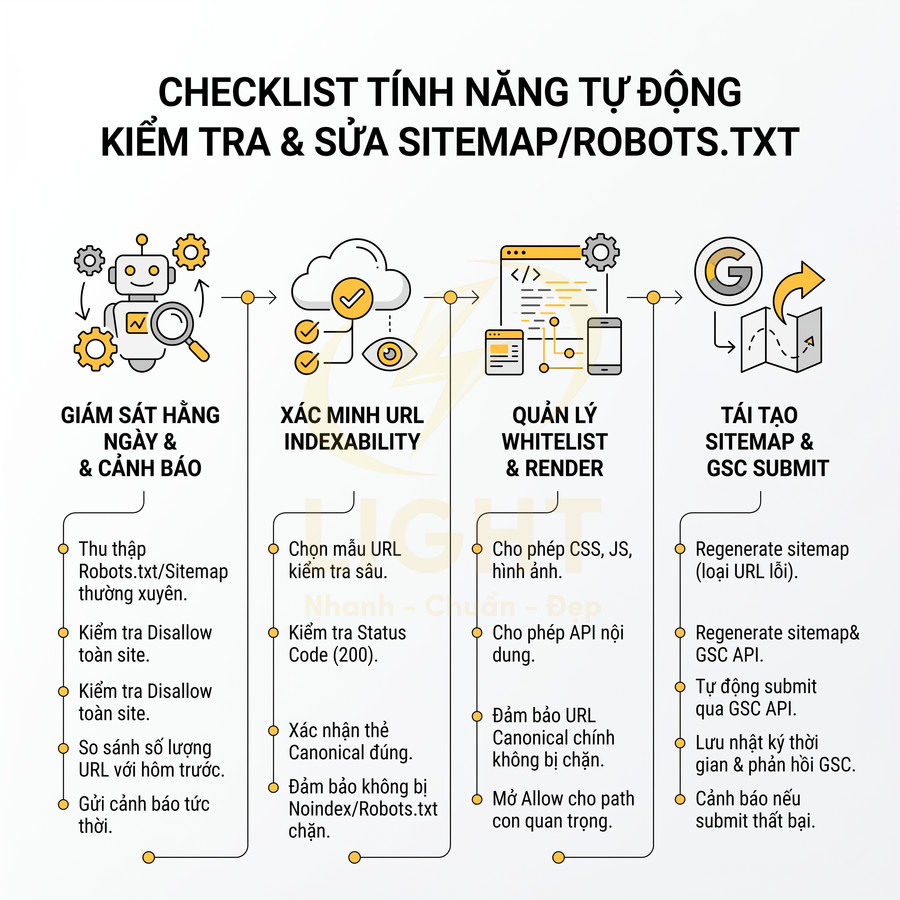

Với các website lớn, sai sót nhỏ như sitemap chứa URL noindex, canonical lỗi, redirect chain hoặc robots.txt chặn nhầm category, product, CSS/JS đều có thể gây mất index hàng loạt và sụt giảm organic traffic nghiêm trọng. Vì vậy, hệ thống SEO hiện đại cần tích hợp cơ chế auto-audit và auto-fix theo chu kỳ: tự crawl robots.txt, parse sitemap index, đối chiếu status code, canonical, meta robots, GSC coverage và log bot thực tế để phát hiện xung đột sớm. Từ đó có thể tự động loại URL lỗi khỏi sitemap, sửa rule robots nguy hiểm, regenerate sitemap index và cảnh báo realtime sau deploy, giúp bảo vệ crawl coverage và giữ website luôn ở trạng thái chuẩn SEO bền vững. Sitemap XML và robots.txt chỉ hoạt động ổn định khi website có nền tảng kỹ thuật rõ ràng ngay từ đầu. Một quy trình thiết kế website chuẩn SEO giúp kiểm soát cấu trúc URL, thư mục, trạng thái index và vùng cần chặn bot, tránh xung đột giữa crawl và index.

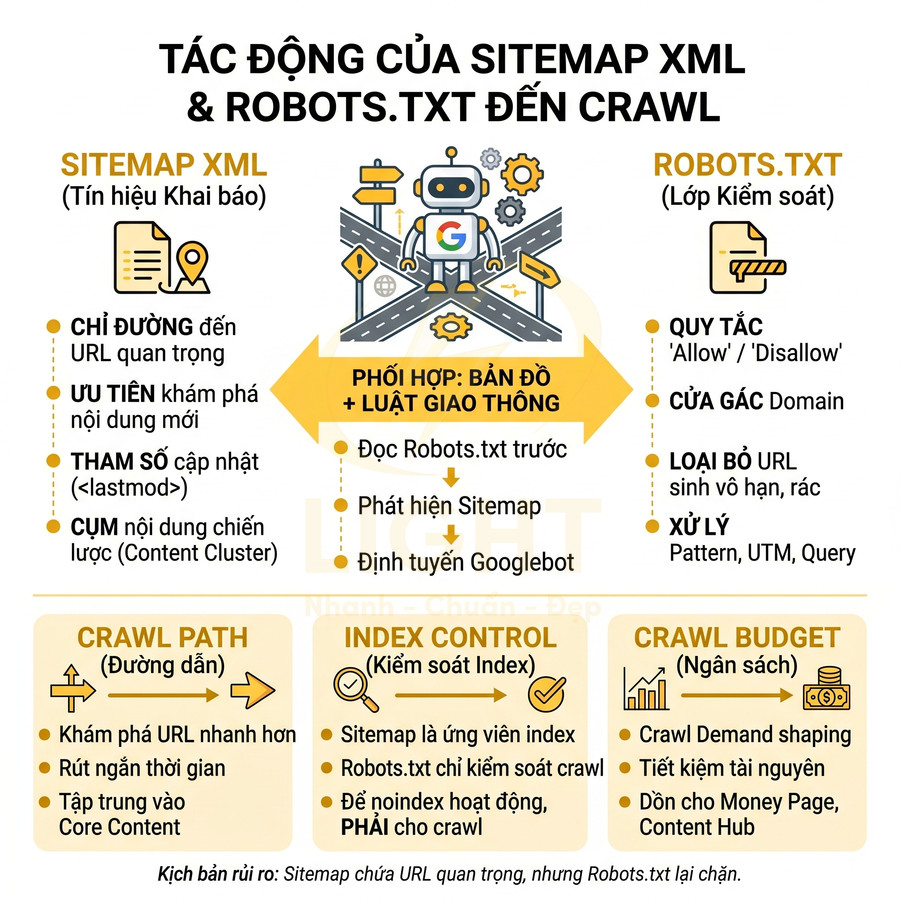

Sitemap XML và robots.txt tác động đến crawl path, index control và crawl budget như thế nào

Sitemap XML và robots.txt phối hợp như một hệ thống định tuyến và kiểm soát cho Googlebot, trực tiếp ảnh hưởng đến crawl path, index control và crawl budget. Sitemap đóng vai trò tín hiệu khai báo, tập trung các URL quan trọng, cập nhật và có giá trị SEO, giúp bot khám phá nhanh money page, content hub và các cụm nội dung chiến lược. Ngược lại, robots.txt là lớp kiểm soát truy cập, loại bỏ khỏi không gian crawl các khu vực không cần index, URL sinh vô hạn hoặc trùng lặp, từ đó tiết kiệm tài nguyên crawl cho phần “core” của website. Khi hai file này được cấu hình đồng bộ, Googlebot vừa được dẫn hướng chính xác, vừa tránh lãng phí crawl vào những vùng nội dung rác hoặc không phục vụ mục tiêu SEO. Sitemap XML và robots.txt chỉ phát huy hiệu quả khi website có cấu trúc rõ ràng, không phát sinh quá nhiều URL thừa. Một nền tảng thiết kế website hợp lý giúp phân biệt trang cần crawl, trang cần index và khu vực nên hạn chế bot ngay từ giai đoạn xây dựng.

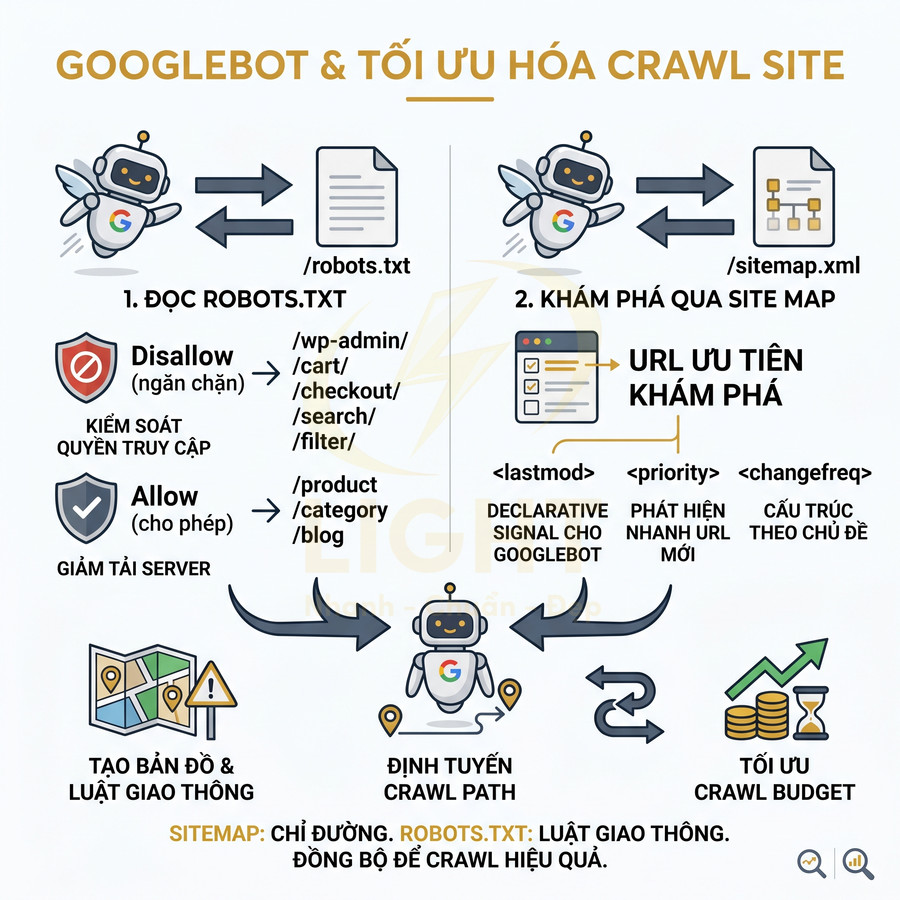

Googlebot đọc sitemap để khám phá URL mới và robots.txt để quyết định quyền truy cập crawl

Sitemap XML và robots.txt không chỉ là hai file “bắt buộc phải có” trong technical SEO, mà còn là hai lớp điều hướng – kiểm soát – tối ưu hóa trực tiếp ảnh hưởng đến crawl path, index control và crawl budget. Về bản chất, sitemap XML là một declarative signal cho Googlebot về những URL nào đáng được ưu tiên khám phá và đánh giá, trong khi robots.txt là một access control layer quy định rõ khu vực nào bot được phép hoặc không được phép crawl. Sự kết hợp đúng cách giữa hai file này giúp định tuyến bot đi qua những vùng nội dung có giá trị cao, giảm thiểu việc lãng phí crawl budget vào các URL rác, trùng lặp hoặc không có giá trị SEO. Luận điểm này phù hợp với nghiên cứu về crawling ở quy mô lớn, nơi crawler không thể truy cập mọi URL với cùng tần suất mà phải ưu tiên tài nguyên dựa trên tín hiệu khám phá, giá trị và khả năng truy cập. Olston và Najork (2010) mô tả web crawling là bài toán phức tạp hơn nhiều so với duyệt BFS đơn giản, vì crawler phải xử lý frontier, lịch crawl, độ mới nội dung và giới hạn tài nguyên. Vì vậy, sitemap đóng vai trò như danh sách URL được chủ site “đề cử”, còn robots.txt xác định phần không gian URI nên tránh. Khi hai lớp này đồng bộ, crawl path trở nên có định hướng hơn thay vì phụ thuộc hoàn toàn vào internal link.

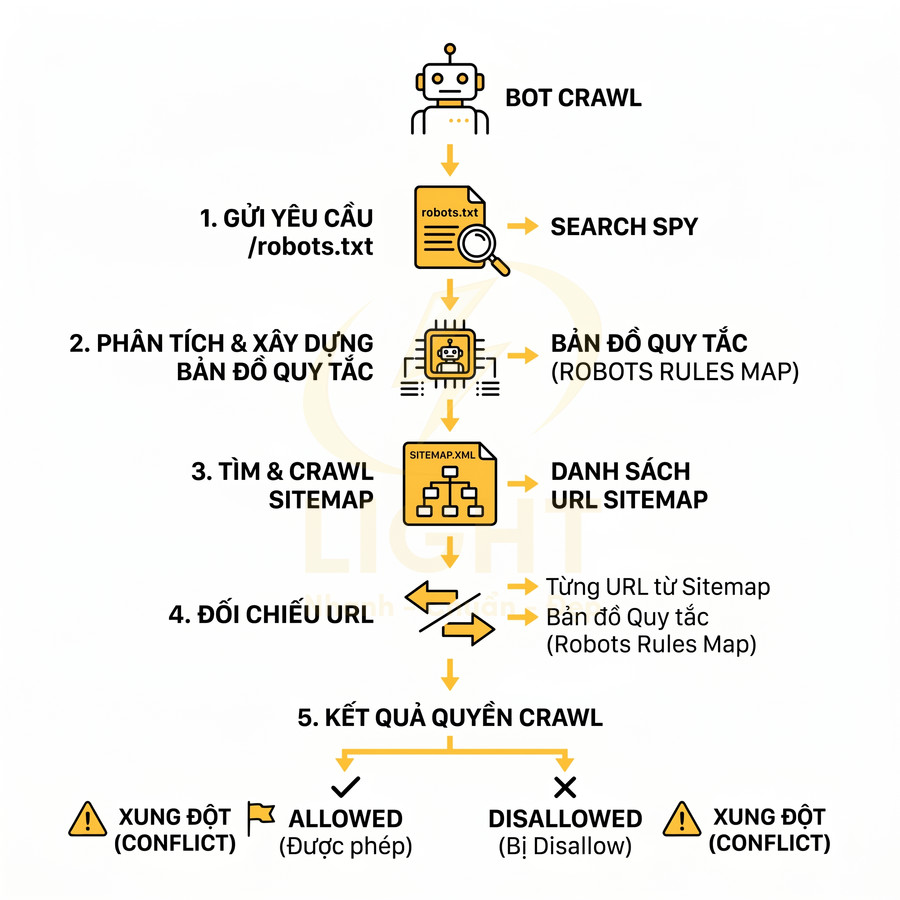

Quy trình crawl chuẩn của Googlebot thường bắt đầu bằng một request đến /robots.txt. Tại đây, bot phân tích các directive theo từng User-agent (ví dụ: User-agent: , User-agent: Googlebot, User-agent: Googlebot-Image…), sau đó áp dụng các rule Allow và Disallow theo cơ chế most specific match. Nếu trong robots.txt có khai báo dòng Sitemap:, Googlebot sẽ sử dụng thông tin này để truy cập trực tiếp vào sitemap XML, thay vì phải tự khám phá qua internal link hoặc backlink. Điều này rút ngắn đáng kể thời gian phát hiện URL mới, đặc biệt với các website lớn, nhiều cấp thư mục hoặc có cấu trúc internal link phức tạp. Về mặt tiêu chuẩn kỹ thuật, Robots Exclusion Protocol được RFC 9309 chuẩn hóa như một cơ chế để chủ dịch vụ chỉ định cách crawler tự động có thể truy cập tài nguyên URI. Tài liệu này mô tả robots.txt là file chứa các nhóm user-agent và rule, trong đó mỗi rule định nghĩa crawler có thể truy cập đường dẫn nào hoặc không (Koster et al., 2022). Điều quan trọng là robots.txt không phải cơ chế bảo mật, mà là quy ước crawler được yêu cầu tuân thủ. Vì vậy, trong SEO, robots.txt nên được xem là lớp điều phối crawl, không phải công cụ che giấu nội dung nhạy cảm hoặc thay thế xác thực truy cập.

Trong sitemap XML, ngoài danh sách URL, các thuộc tính như <lastmod>, <changefreq> (dù Google ít sử dụng), <priority> (hầu như chỉ mang tính tham khảo), cùng các extension như image, video, news, hreflang cung cấp thêm ngữ cảnh cho Googlebot về mức độ quan trọng và tính cập nhật của từng URL. Khi được cấu hình chuẩn, sitemap giúp Googlebot:

- Phát hiện nhanh các URL mới tạo hoặc vừa được cập nhật nội dung quan trọng.

- Nhận diện các cụm nội dung (content cluster) thông qua sitemap con (sitemap index) cho từng loại template: product, category, blog, landing page.

- Ưu tiên crawl các URL có lastmod gần đây, đặc biệt trong các vertical nhạy cảm về thời gian như news, deal, event.

lastmod nên được dùng cẩn trọng: chỉ cập nhật khi nội dung thay đổi thật sự có ý nghĩa SEO, vì cập nhật giả tạo hàng loạt có thể làm giảm độ tin cậy vận hành của hệ thống sitemap. Ở chiều ngược lại, robots.txt đóng vai trò “cửa gác” cho toàn bộ domain. Các rule trong robots.txt có thể:

- Ngăn Googlebot crawl các khu vực không phục vụ mục tiêu index như

/wp-admin/,/cart/,/checkout/,/search/,/filter/, hoặc các endpoint API. - Giảm tải server bằng cách hạn chế bot truy cập vào các pattern URL sinh vô hạn (faceted navigation, sort, filter, pagination phức tạp).

- Định tuyến bot tránh xa các thư mục staging, test, hoặc môi trường dev nếu lỡ để public.

Về mặt crawl path, sự kết hợp giữa sitemap và robots.txt tạo ra một “bản đồ + luật giao thông” cho bot. Sitemap chỉ đường đến các URL quan trọng, còn robots.txt quy định những tuyến đường nào được phép đi. Nếu hai lớp này đồng bộ, Googlebot sẽ:

- Ưu tiên crawl các URL trong sitemap, đặc biệt là những URL có tín hiệu cập nhật mới.

- Giảm tần suất hoặc bỏ qua hoàn toàn các URL bị Disallow, từ đó không lãng phí crawl budget.

- Đi theo các đường internal link từ những URL đã crawl, nhưng vẫn bị giới hạn bởi rule robots.txt.

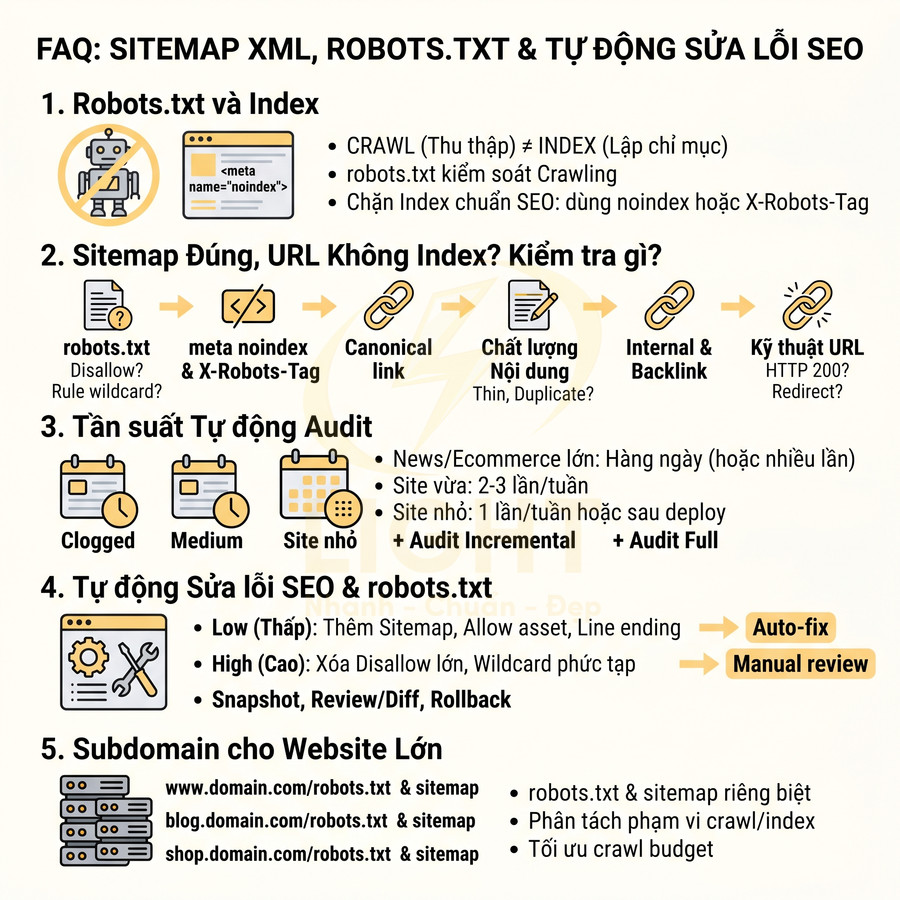

Về index control, cần phân biệt rõ:

- robots.txt chỉ kiểm soát quyền crawl, không trực tiếp kiểm soát quyền index. Một URL bị chặn crawl vẫn có thể xuất hiện trong index nếu Google biết đến nó qua backlink, nhưng sẽ không có nội dung đầy đủ. Điểm này cần được nhấn mạnh vì nhiều lỗi mất index đến từ việc dùng robots.txt thay cho noindex. RFC 9309 quy định robots.txt là phương thức để crawler biết phần nào của dịch vụ có thể được truy cập, chứ không phải một chỉ thị lập chỉ mục hay cơ chế bảo mật (Koster et al., 2022). Nếu một URL bị chặn robots.txt, crawler có thể không đọc được meta robots noindex trên trang đó. Vì vậy, với trang cần loại khỏi index, cách đúng thường là cho phép crawl nhưng đặt

noindex, rồi loại khỏi sitemap. Chặn robots trước khi Google đọc noindex có thể tạo tín hiệu mâu thuẫn và khó kiểm soát hơn. - meta robots noindex và X-Robots-Tag mới là tín hiệu trực tiếp để yêu cầu không index. Tuy nhiên, để Google đọc được noindex, URL đó phải không bị chặn bởi robots.txt.

- Sitemap là tín hiệu tích cực: URL xuất hiện trong sitemap thường được hiểu là “ứng viên muốn được index”. Nếu sitemap chứa nhiều URL noindex hoặc bị chặn robots, tín hiệu này trở nên nhiễu.

Về crawl budget, với các website lớn (hàng chục nghìn đến hàng triệu URL), Google áp dụng cơ chế phân bổ crawl budget dựa trên hai yếu tố chính: crawl capacity (khả năng chịu tải của server) và crawl demand (mức độ quan tâm của Google đối với site). Sitemap và robots.txt tác động vào phần crawl demand shaping:

- Sitemap tập trung tín hiệu vào các URL quan trọng, giúp Googlebot hiểu đâu là phần “core” của website.

- Robots.txt loại bỏ khỏi không gian crawl các URL rác, URL sinh vô hạn, URL trùng lặp, từ đó phần crawl budget còn lại được dồn cho money page, category, product, content hub.

- Khi sitemap được chia nhỏ theo loại nội dung (ví dụ:

sitemap-products.xml,sitemap-categories.xml,sitemap-blog.xml), Google có thể phân bổ crawl budget chi tiết hơn theo từng nhóm URL.

Nếu cấu hình sai, hai file này có thể gây lãng phí crawl budget nghiêm trọng, ví dụ:

- Sitemap chứa hàng loạt URL filter, search, pagination vô hạn, trong khi money page lại không xuất hiện.

- Robots.txt không chặn các pattern URL rác (ví dụ:

?sort=,?color=,?page=vô hạn), khiến bot tiêu tốn phần lớn crawl budget vào các biến thể không cần index. - Sitemap và robots.txt mâu thuẫn: sitemap khai báo URL quan trọng, nhưng robots.txt lại Disallow thư mục chứa chúng.

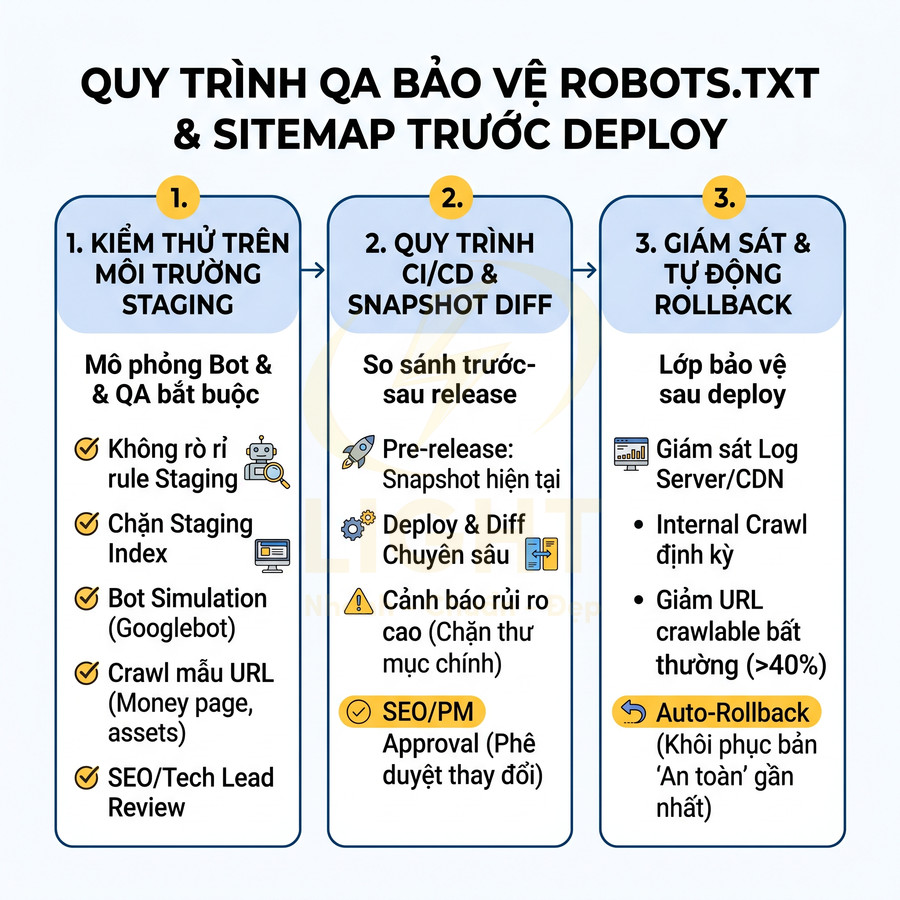

Với các hệ thống lớn, một chiến lược technical SEO trưởng thành thường bao gồm:

- Thiết kế cấu trúc sitemap theo mô-đun, mapping 1-1 với các template chính (product, category, blog, landing, brand, tag…).

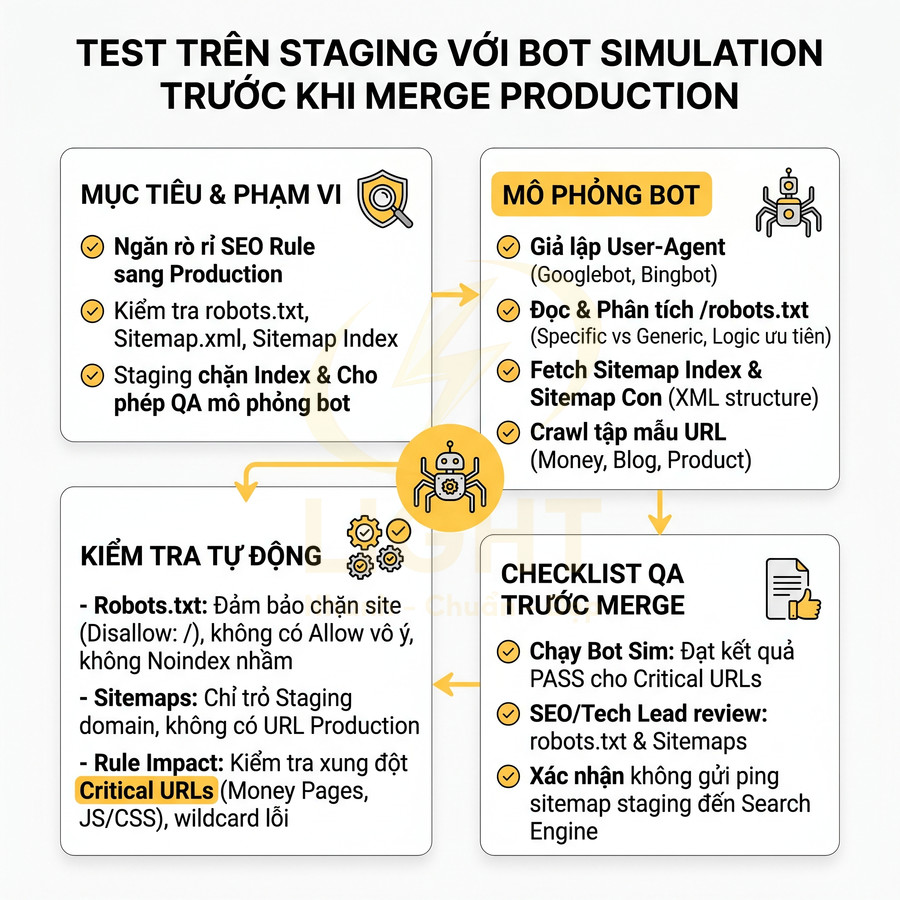

- Thiết lập rule robots.txt theo pattern URL, tránh dùng wildcard quá rộng, đồng thời test kỹ trên staging trước khi deploy production.

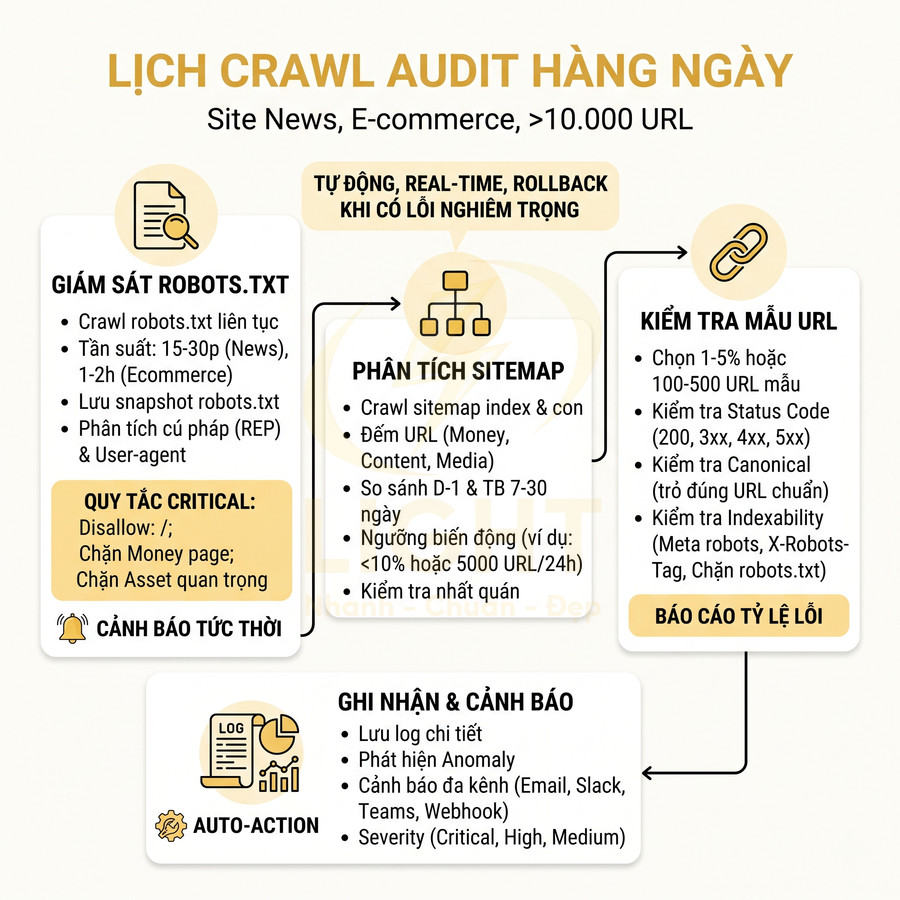

- Xây dựng cơ chế auto-audit định kỳ để so sánh danh sách URL trong sitemap với rule robots.txt và trạng thái index thực tế trong GSC.

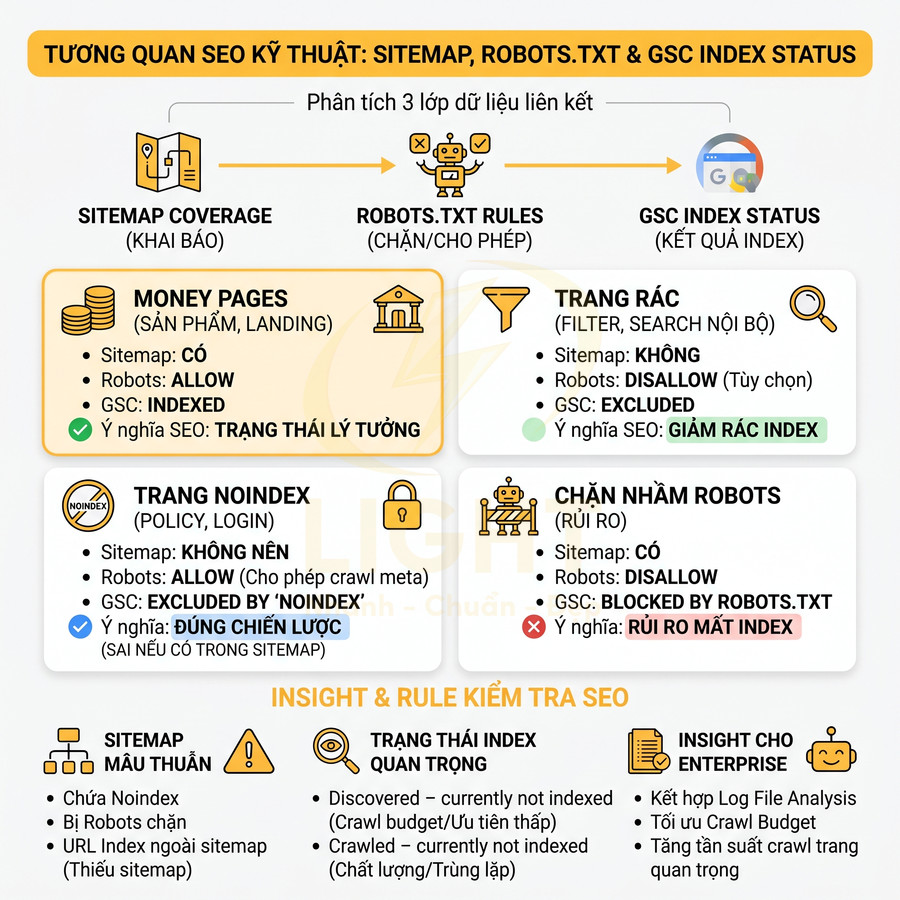

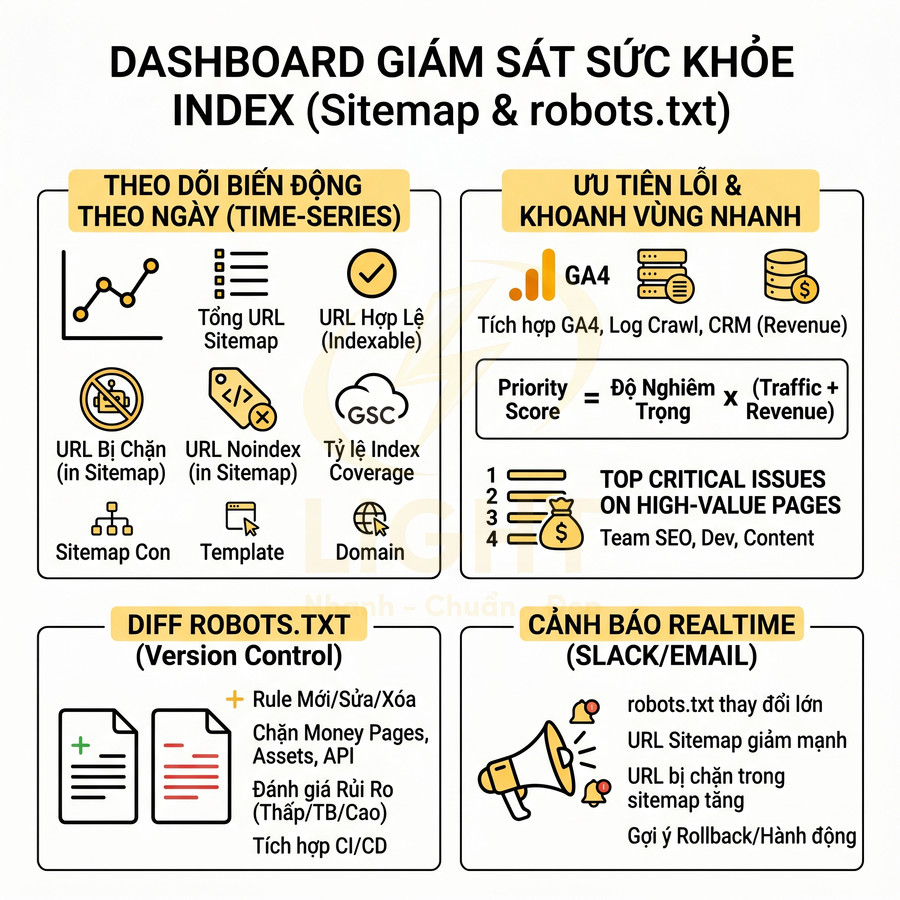

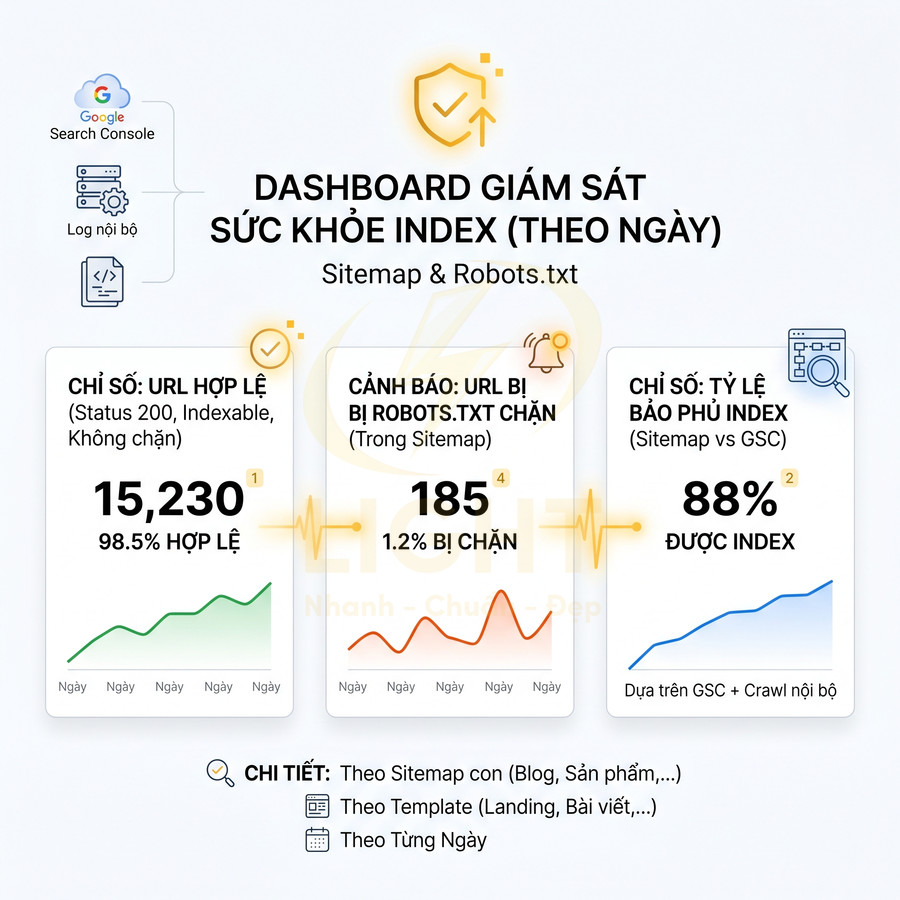

Tương quan giữa sitemap coverage, robots rule và trạng thái index trong Google Search Console

Trong Google Search Console, việc phân tích riêng lẻ từng báo cáo thường không đủ để phát hiện các vấn đề technical SEO phức tạp. Cần nhìn sitemap coverage, robots rule và trạng thái index như ba lớp dữ liệu liên kết chặt chẽ với nhau. Khi sitemap được submit, GSC cung cấp báo cáo Coverage (hoặc Pages trong giao diện mới) cho biết:

- Số lượng URL hợp lệ (Indexed / Good).

- Số lượng URL bị loại trừ (Excluded) theo từng lý do cụ thể.

- Số lượng URL có lỗi (Error), ví dụ: 404, server error, redirect error.

Cách phân tích ba lớp này tương tự tư duy trong information retrieval: một tài nguyên chỉ thực sự hữu ích khi vừa được phát hiện, vừa truy cập được, vừa đủ điều kiện để được đưa vào chỉ mục. Manning, Raghavan và Schütze (2008) giải thích rằng hệ thống truy xuất thông tin phụ thuộc vào pipeline gồm thu thập tài liệu, biểu diễn tài liệu và truy xuất theo truy vấn. Áp dụng vào technical SEO, sitemap đại diện cho lớp phát hiện, robots.txt đại diện cho lớp quyền truy cập, còn trạng thái index trong GSC phản ánh kết quả sau xử lý. Nếu một URL xuất hiện trong sitemap nhưng bị robots chặn hoặc noindex, pipeline bị gãy ở giữa, làm giảm hiệu quả index.

Các trạng thái quan trọng cần chú ý gồm:

- Indexed: URL đã được index và có thể xuất hiện trong kết quả tìm kiếm.

- Crawled – currently not indexed: Google đã crawl nhưng tạm thời không index, thường do chất lượng nội dung, trùng lặp, hoặc chưa đủ tín hiệu.

- Discovered – currently not indexed: Google biết đến URL nhưng chưa crawl, thường liên quan đến crawl budget hoặc ưu tiên thấp.

- Excluded by ‘noindex’ tag: URL có meta noindex hoặc X-Robots-Tag noindex.

- Blocked by robots.txt: URL bị chặn crawl bởi rule robots.

- Alternate page with proper canonical tag: URL được xem là bản trùng lặp, canonical trỏ sang URL khác.

Khi đối chiếu với sitemap coverage, có thể rút ra nhiều insight quan trọng:

- Nếu tỷ lệ lớn URL trong sitemap rơi vào Excluded by ‘noindex’ tag, chứng tỏ sitemap đang chứa nhiều URL mà chiến lược SEO không muốn index. Điều này làm nhiễu tín hiệu ưu tiên của sitemap.

- Nếu nhiều URL trong sitemap bị Blocked by robots.txt, có khả năng rule robots.txt đang chặn nhầm thư mục hoặc pattern quan trọng.

- Nếu có nhiều URL được index nhưng không nằm trong sitemap, có thể sitemap chưa bao phủ đầy đủ các template quan trọng (category, tag, landing, filter được phép index).

Để phân tích có hệ thống, nên lập bảng đối chiếu giữa ba lớp dữ liệu: sitemap, robots.txt và GSC. Cấu trúc bảng như sau:

| Nhóm URL | Trạng thái trong sitemap | Trạng thái trong robots.txt | Trạng thái trong GSC | Ý nghĩa SEO |

|---|---|---|---|---|

| Money page (product, landing) | Có trong sitemap | Được phép crawl | Indexed / Good | Trạng thái lý tưởng, cần duy trì và theo dõi |

| Trang filter, search nội bộ | Không có trong sitemap | Có thể Disallow | Excluded / Not indexed | Giảm rác index, tiết kiệm crawl budget |

| Trang noindex (policy, login) | Không nên có trong sitemap | Cho phép crawl | Excluded by ‘noindex’ | Đúng nếu không nằm trong sitemap; sai nếu vẫn được khai báo |

| Trang bị robots.txt chặn nhầm | Có trong sitemap | Disallow | Blocked by robots.txt | Rủi ro mất index, cần audit và sửa rule |

Từ bảng này, có thể xây dựng các rule kiểm tra tự động:

- URL thuộc nhóm money page nhưng:

- Không xuất hiện trong sitemap → cần bổ sung vào sitemap tương ứng.

- Bị Disallow trong robots.txt → cần xem lại rule, ưu tiên Allow cho pattern này.

- Có trạng thái Discovered – currently not indexed hoặc Crawled – currently not indexed với số lượng lớn → cần đánh giá chất lượng nội dung, internal link, và tín hiệu authority.

- URL noindex:

- Không nên xuất hiện trong sitemap; nếu có, cần loại bỏ để tránh gửi tín hiệu mâu thuẫn.

- Nên được phép crawl (không bị robots.txt chặn) để Google có thể đọc meta noindex và xử lý đúng.

- URL filter, search nội bộ:

- Không nên nằm trong sitemap.

- Có thể Disallow trong robots.txt nếu không có giá trị SEO.

- Nếu vẫn được index nhiều, cần xem xét thêm noindex hoặc điều chỉnh internal link.

Với các website enterprise, việc kết hợp log file analysis với dữ liệu GSC và sitemap/robots cho phép nhìn rõ hơn cách Googlebot thực sự tiêu thụ crawl budget: bot đang crawl nhiều ở đâu, có đang lặp lại quá nhiều request vào các URL rác hay không, và các URL quan trọng có được crawl với tần suất đủ cao hay không.

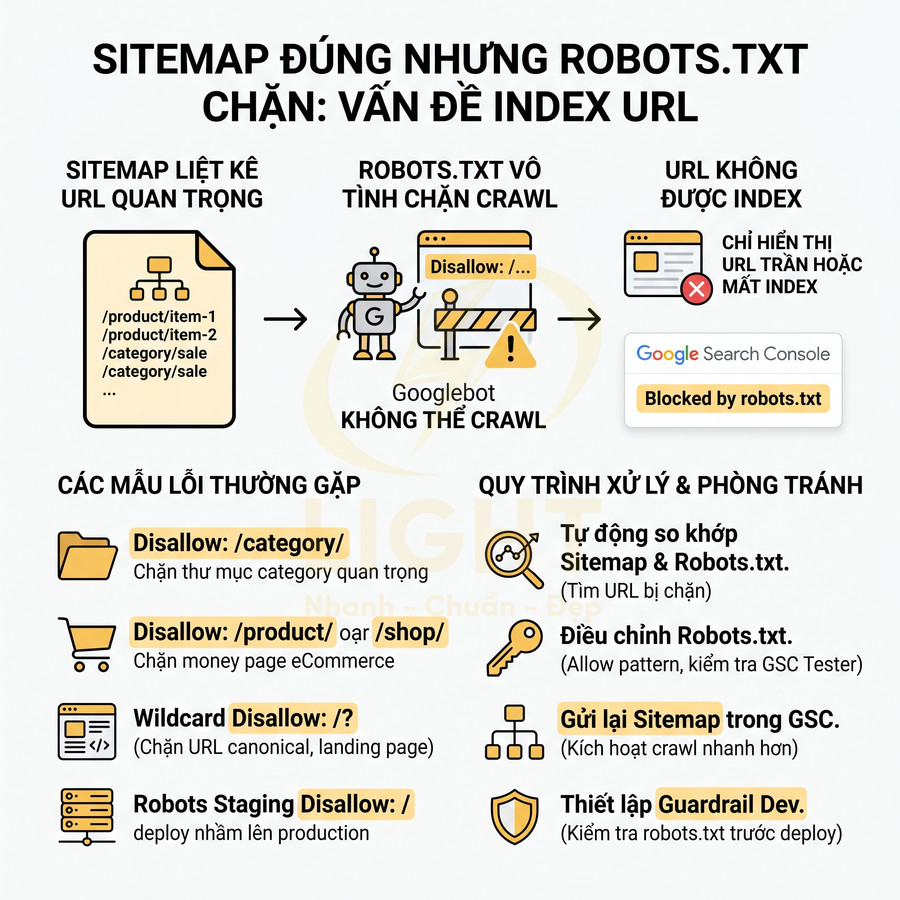

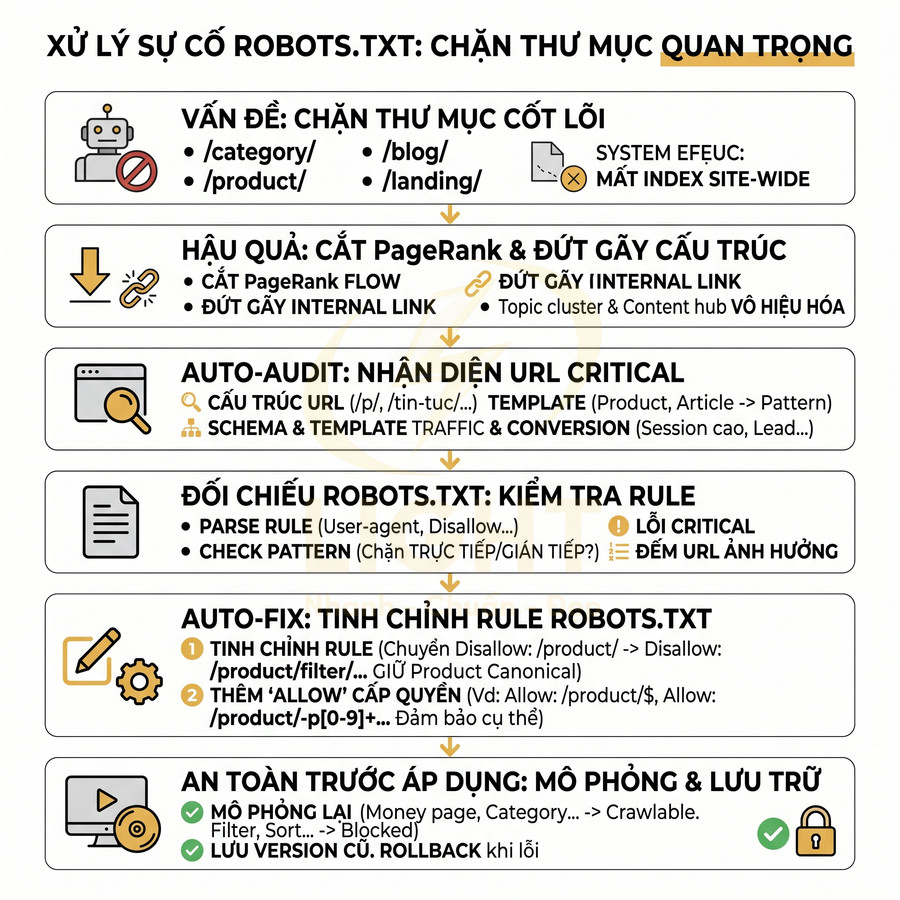

Khi sitemap đúng nhưng robots.txt chặn crawl làm URL không được index

Một trong những kịch bản rủi ro nhất trong technical SEO là khi sitemap được thiết kế chuẩn, liệt kê đầy đủ money page và URL quan trọng, nhưng robots.txt lại vô tình chặn crawl các URL đó hoặc cả thư mục chứa chúng. Trong trường hợp này, Googlebot vẫn có thể “biết” về sự tồn tại của URL thông qua sitemap, internal link hoặc backlink, nhưng không thể truy cập nội dung để đánh giá, dẫn đến việc URL không được index hoặc chỉ index ở mức rất hạn chế (không có snippet, chỉ hiển thị URL trần). Rủi ro này nghiêm trọng vì robots.txt được crawler đọc trước khi truy cập tài nguyên. RFC 9309 mô tả rõ robots.txt gồm các group và rule, crawler sẽ dùng rule phù hợp để quyết định URI nào có thể truy cập (Koster et al., 2022). Nếu rule Disallow: /product/ được áp dụng cho Googlebot, toàn bộ product URL trong sitemap có thể trở thành URL “được khai báo nhưng không thể crawl”. Ở quy mô ecommerce, đây không chỉ là lỗi kỹ thuật mà là rủi ro doanh thu: sitemap gửi tín hiệu ưu tiên, nhưng robots.txt cắt đứt khả năng đánh giá nội dung, khiến index coverage sụt nhanh.

Các pattern lỗi thường gặp:

- Disallow: /category/ trong khi sitemap chứa toàn bộ URL category, và category là tầng điều hướng quan trọng trong kiến trúc site.

- Disallow: /product/ hoặc Disallow: /shop/ trong các site eCommerce, vô tình chặn toàn bộ money page.

- Wildcard quá rộng như Disallow: /? chặn tất cả URL có query parameter, bao gồm cả những URL canonical hợp lệ cần index (ví dụ: landing page dùng UTM hoặc tham số tracking nhưng canonical về URL sạch).

- Robots staging với Disallow: / bị deploy nhầm lên production, khiến toàn bộ site bị chặn crawl trong thời gian dài.

Trong GSC, các URL này thường xuất hiện với trạng thái Blocked by robots.txt. Nếu URL đã từng được index trước khi bị chặn, có thể vẫn còn xuất hiện trong kết quả tìm kiếm một thời gian, nhưng nội dung sẽ không được cập nhật nữa. Về lâu dài, khi Google đánh giá lại, các URL này có thể bị loại khỏi index do không thể crawl để xác nhận tính hợp lệ và cập nhật.

Vấn đề trở nên nghiêm trọng hơn khi:

- Sitemap index được chia nhỏ theo thư mục (ví dụ:

/category/,/product/), và cả thư mục đó bị Disallow. - Website có hàng chục nghìn đến hàng trăm nghìn URL trong thư mục bị chặn, dẫn đến mất index hàng loạt chỉ vì một rule sai.

- Hệ thống CI/CD tự động deploy robots.txt từ môi trường staging sang production mà không có bước kiểm tra.

Để phòng tránh và xử lý, một hệ thống auto-audit technical SEO nên có các chức năng sau:

- Parse toàn bộ sitemap (bao gồm sitemap index và sitemap con), thu thập danh sách URL và pattern thư mục.

- Parse robots.txt, xây dựng rule map cho từng User-agent, đặc biệt là Googlebot và Googlebot-Mobile.

- So khớp từng URL trong sitemap với rule map để xác định:

- URL trong sitemap nhưng bị Disallow → gắn nhãn lỗi critical.

- Thư mục chứa phần lớn URL trong sitemap bị Disallow → cảnh báo ở mức hệ thống.

- Tích hợp dữ liệu GSC để ưu tiên xử lý các URL:

- Có impression/click nhưng đang bị Blocked by robots.txt.

- Đã từng index nhưng hiện tại không còn được crawl.

Về mặt quy trình, khi phát hiện URL trong sitemap bị Disallow, các bước xử lý nên bao gồm:

- Kiểm tra lại chiến lược SEO: URL đó có thực sự cần index không? Nếu không, cần loại khỏi sitemap thay vì mở robots.

- Nếu URL là money page hoặc trang quan trọng:

- Điều chỉnh rule robots.txt để Allow pattern tương ứng (ví dụ:

Allow: /product/ngay cả khi có rule Disallow rộng hơn). - Deploy robots.txt mới và sử dụng công cụ robots.txt Tester trong GSC để xác nhận.

- Gửi lại sitemap trong GSC để kích hoạt quá trình recrawl nhanh hơn.

- Điều chỉnh rule robots.txt để Allow pattern tương ứng (ví dụ:

- Thiết lập guardrail trong quy trình dev:

- Không cho phép deploy robots.txt có Disallow: / lên production trừ khi có approval đặc biệt.

- So sánh diff robots.txt giữa staging và production trước mỗi lần release.

Với các website lớn, chỉ một rule Disallow sai có thể làm “bốc hơi” hàng chục nghìn URL khỏi index trong vài tuần, kéo theo sụt giảm traffic organic và revenue. Do đó, việc đồng bộ chặt chẽ giữa sitemap, robots.txt và chiến lược index control (meta robots, canonical, cấu trúc internal link) là một trong những trụ cột quan trọng nhất của technical SEO ở cấp độ enterprise.

Cấu trúc sitemap XML chuẩn SEO mà hệ thống cần tự động kiểm tra định kỳ

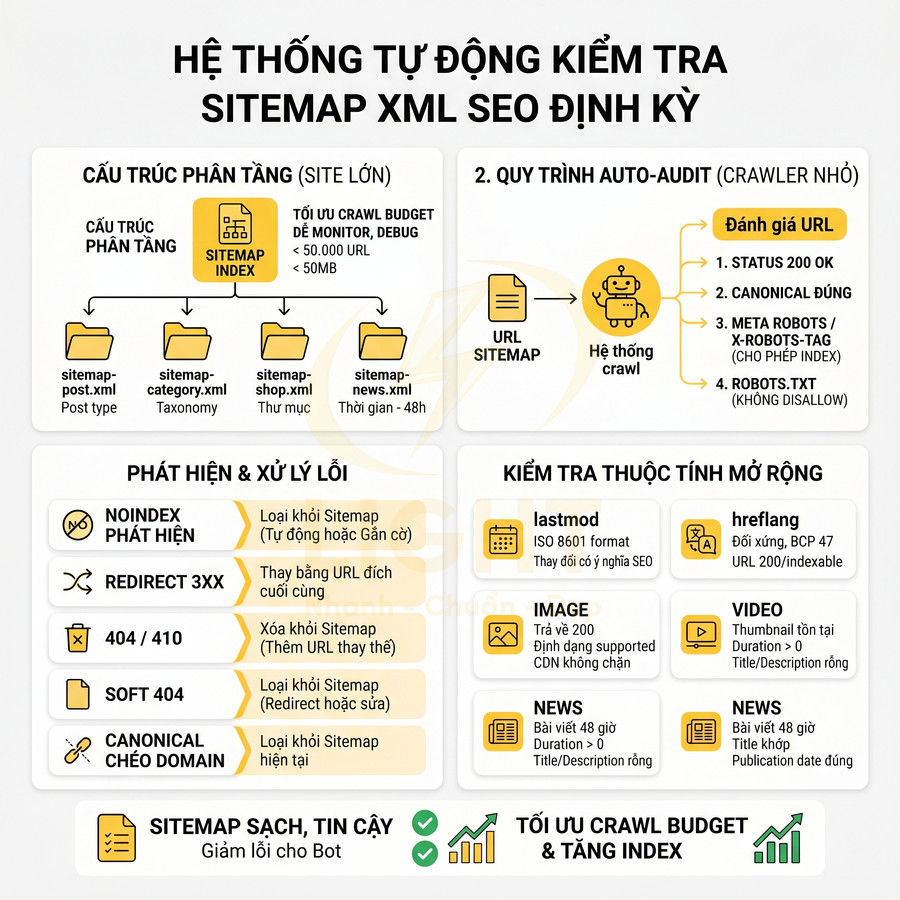

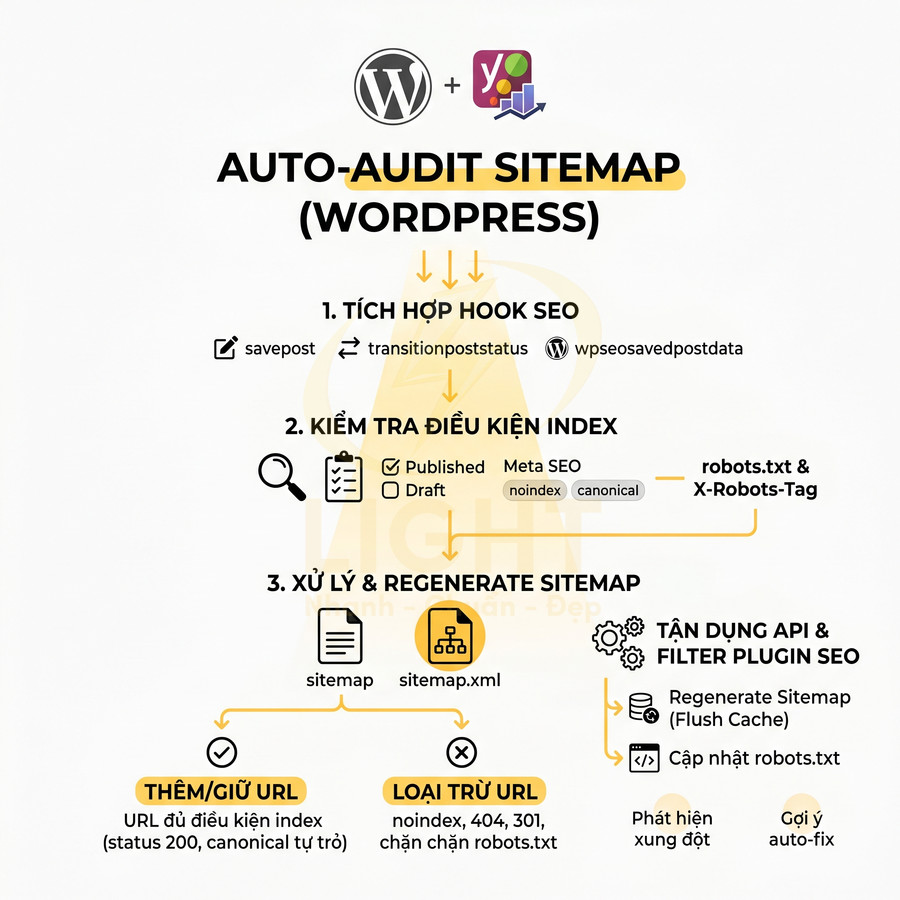

Sitemap XML chuẩn SEO cần được hệ thống tự động kiểm tra định kỳ để luôn phản ánh tập URL quan trọng, sạch và indexable. Công cụ auto-audit phải hoạt động như một crawler thu nhỏ, đánh giá đồng thời status code, canonical, robots, robots.txt và các tín hiệu mở rộng như lastmod, hreflang, image, video, news. Bên cạnh việc loại bỏ URL lỗi (noindex, 3xx, 404, soft 404, canonical chéo domain), hệ thống phải phân loại nguyên nhân, log chi tiết và đề xuất auto-fix phù hợp. Với website lớn, cần tổ chức sitemap theo post type, taxonomy, thư mục hoặc thời gian, kết hợp sitemap index để dễ monitor, debug và tối ưu crawl budget, đảm bảo mọi URL giá trị đều được ưu tiên thu thập và index.

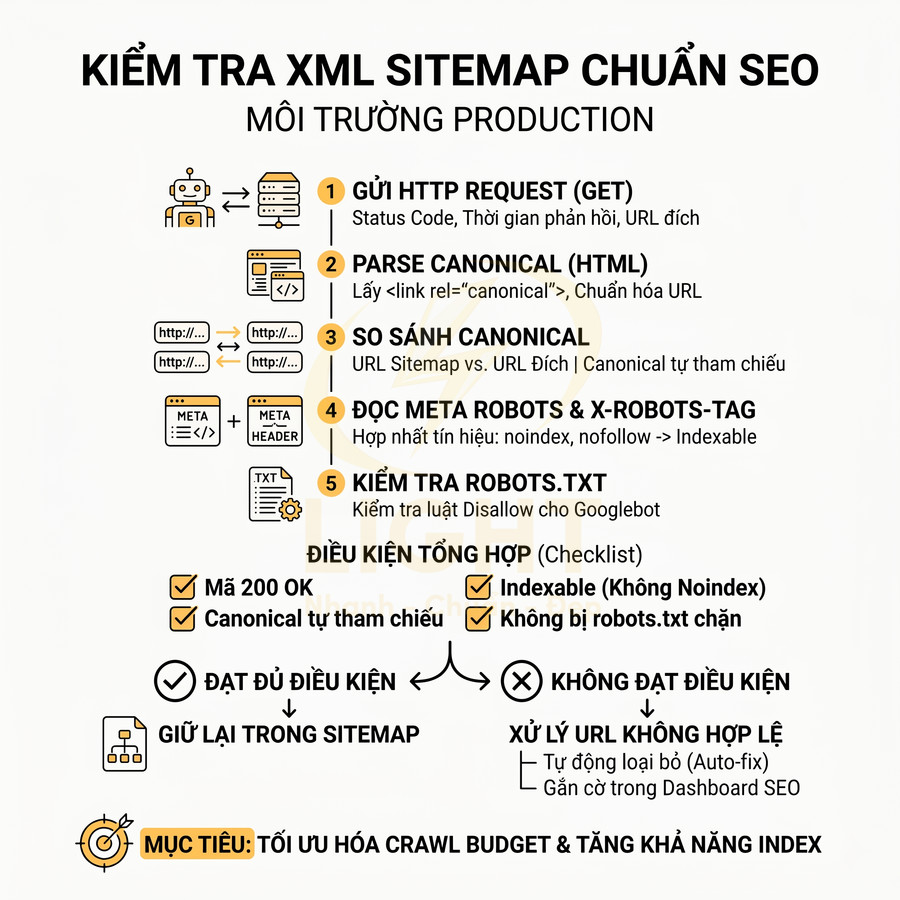

Kiểm tra URL 200, canonical đúng và chỉ chứa trang được phép index

Sitemap XML chuẩn SEO trong môi trường production nên được xem như một “index kỹ thuật” của toàn bộ hệ thống URL quan trọng. Vì vậy, ngoài ba nguyên tắc cơ bản chỉ chứa URL trả về mã 200, canonical trùng với URL trong sitemap và URL được phép index, hệ thống auto-audit cần vận hành như một crawler thu nhỏ, có khả năng đánh giá tính “indexable” ở mức độ kỹ thuật lẫn logic SEO. Có thể củng cố ý này bằng nghiên cứu về sitemap và cấu trúc website. Lin và cộng sự (2011) cho rằng sitemap có thể đại diện cho cấu trúc tri thức và các luồng sử dụng chính của website, đồng thời hỗ trợ crawler tập trung vào các trang quan trọng. Vì vậy, sitemap production không nên là bản dump toàn bộ URL, mà phải là danh mục kỹ thuật của các URL có khả năng index thật sự. Điều kiện tối thiểu gồm: trả về 200, không noindex, không bị robots chặn, canonical hợp lệ và nội dung đủ giá trị. Nếu sitemap chứa URL redirect, 404 hoặc canonical sang trang khác, nó làm giảm độ sạch của tín hiệu khai báo.

Về mặt kỹ thuật, mỗi URL trong sitemap cần được kiểm tra theo chuỗi bước có thứ tự rõ ràng để tránh nhầm lẫn do redirect hoặc canonical phức tạp:

- Gửi HTTP request đến từng URL trong sitemap:

- Sử dụng phương thức GET với đầy đủ header quan trọng (User-Agent, Accept-Language…) để mô phỏng gần nhất hành vi của Googlebot.

- Ghi nhận status code và phân loại theo nhóm 2xx, 3xx, 4xx, 5xx; đồng thời lưu lại URL đích cuối cùng sau chuỗi redirect (nếu có).

- Đo thời gian phản hồi (TTFB, tổng response time) để phát hiện các URL chậm bất thường, có thể ảnh hưởng đến crawl budget.

- Parse HTML để lấy <link rel="canonical">:

- Xác định canonical trong phần <head>, ưu tiên thẻ rel="canonical" duy nhất; nếu có nhiều canonical, đánh dấu là cấu hình sai.

- Chuẩn hóa URL canonical (normalize scheme, trailing slash, tham số tracking) trước khi so sánh với URL hiện tại.

- So sánh canonical với:

- URL được khai báo trong sitemap.

- URL đích cuối cùng sau redirect (nếu URL sitemap đang redirect).

- Đánh dấu các trường hợp canonical tự tham chiếu (self-referencing) là hợp lệ, các trường hợp canonical trỏ sang URL khác là “non-self canonical” cần xem xét.

- Đọc meta robots và header X-Robots-Tag:

- Parse thẻ <meta name="robots" content="..."> và các thẻ meta theo user-agent cụ thể (ví dụ: <meta name="googlebot" ...>).

- Đọc header X-Robots-Tag trong response để phát hiện các chỉ thị noindex, nofollow, noarchive, nosnippet được set ở mức server.

- Hợp nhất các tín hiệu robots (header + meta) theo ưu tiên của Google: nếu bất kỳ nơi nào có noindex, URL được xem là không indexable.

- Kiểm tra robots.txt:

- Đọc file robots.txt tương ứng với domain của URL, áp dụng đúng logic phân giải user-agent (Googlebot, Googlebot-Image, Googlebot-News…).

- Kiểm tra xem đường dẫn URL có bị chặn bởi bất kỳ rule Disallow áp dụng cho Googlebot hoặc user-agent chung * hay không.

- Ghi nhận các pattern chặn rộng (ví dụ: /search/, /private/) để đề xuất loại bỏ toàn bộ nhóm URL đó khỏi sitemap.

Sau khi hoàn tất chuỗi kiểm tra, hệ thống cần đánh giá điều kiện tổng hợp: 200 + canonical self-referencing + indexable + không bị robots.txt chặn. Chỉ những URL đạt đủ bốn điều kiện này mới được giữ lại trong sitemap. Các URL không đạt cần được:

- Tự động loại khỏi sitemap trong lần regenerate kế tiếp, nếu hệ thống được phép auto-fix.

- Hoặc gắn cờ (flag) trong dashboard SEO nội bộ với thông tin chi tiết: status code, canonical, meta robots, rule robots.txt liên quan, lần crawl gần nhất.

Cách tiếp cận này giúp sitemap trở thành tập hợp URL “sạch” và có độ tin cậy cao, giảm thiểu tình trạng Googlebot phải xử lý redirect chain, 404, 5xx hoặc trang noindex, từ đó tối ưu hóa crawl budget và tăng khả năng index cho các URL thực sự quan trọng.

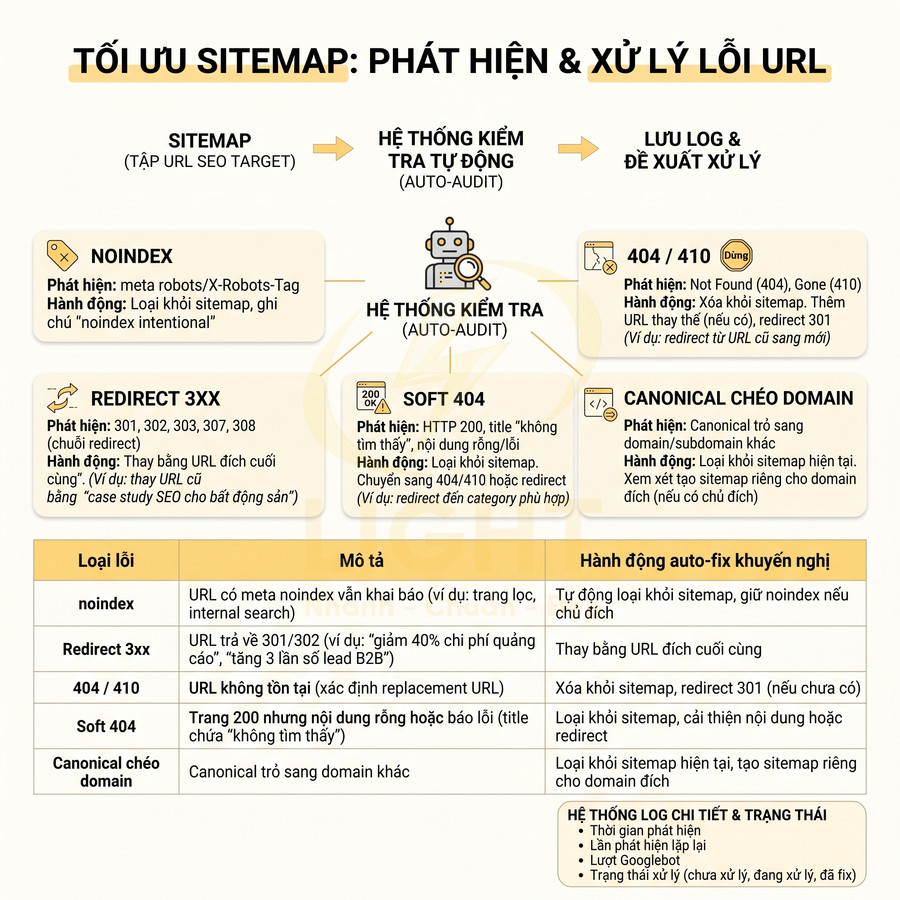

Phát hiện URL noindex, redirect 3xx, 404, soft 404 và canonical chéo domain

Để sitemap thực sự phản ánh “tập URL mục tiêu SEO”, hệ thống auto-audit không chỉ dừng ở việc loại trừ URL lỗi, mà cần phân loại nguyên nhân và đề xuất hành động xử lý phù hợp. Việc phân loại chi tiết giúp team SEO và dev hiểu rõ vấn đề nằm ở cấu hình sitemap, cấu hình server, hay chiến lược nội dung.

- URL noindex:

- Phát hiện thông qua meta robots hoặc X-Robots-Tag có chứa noindex (hoặc noindex, nofollow).

- Đối chiếu với business rule: có phải URL này được chủ đích noindex (ví dụ: trang lọc, trang internal search) hay là cấu hình nhầm.

- Đối với URL chủ đích noindex, hệ thống nên tự động loại khỏi sitemap và ghi chú “noindex intentional”.

- Redirect 3xx:

- Ghi nhận toàn bộ chuỗi redirect (301, 302, 303, 307, 308) và URL đích cuối cùng.

- Phân biệt redirect vĩnh viễn (301, 308) và tạm thời (302, 307) để cảnh báo mức độ ưu tiên xử lý.

- Đề xuất thay thế URL trong sitemap bằng URL đích cuối cùng, đồng thời kiểm tra lại canonical và indexability của URL đích.

- 404 / 410:

- Phân biệt 404 (not found) và 410 (gone) để hiểu ý đồ xóa vĩnh viễn.

- Đối chiếu với dữ liệu nội bộ (ID bài viết, sản phẩm) để xác định xem có URL thay thế (replacement URL) hay không.

- Nếu có URL thay thế, hệ thống có thể gợi ý:

- Thêm URL mới vào sitemap.

- Thiết lập redirect 301 từ URL cũ sang URL mới (nếu chưa có).

- Soft 404:

- Phát hiện dựa trên pattern nội dung (template “không tìm thấy sản phẩm”, “bài viết đã bị xóa”, “0 kết quả tìm kiếm”) kết hợp với độ dài nội dung rất thấp.

- Có thể sử dụng rule dựa trên:

- HTTP 200 nhưng title chứa từ khóa “không tìm thấy”, “not found”, “deleted”…

- Body chỉ chứa thông báo lỗi, không có nội dung chính, không có internal link quan trọng.

- Đề xuất hoặc:

- Chuyển sang 404/410 chuẩn.

- Hoặc redirect đến category/URL thay thế phù hợp.

- Canonical chéo domain:

- Phát hiện khi canonical trỏ sang domain hoặc subdomain khác với domain chứa sitemap hiện tại.

- Đánh giá xem đây có phải là chiến lược canonical cross-domain có chủ đích (ví dụ: bản copy trên domain phụ canonical về domain chính) hay là lỗi cấu hình.

- Trong trường hợp canonical cross-domain có chủ đích, URL đó không nên nằm trong sitemap của domain nguồn; thay vào đó, có thể cân nhắc tạo sitemap riêng cho domain đích.

Hệ thống nên lưu log chi tiết từng loại lỗi, ví dụ:

| Loại lỗi | Mô tả | Hành động auto-fix khuyến nghị |

|---|---|---|

| noindex trong sitemap | URL có meta noindex nhưng vẫn được khai báo | Tự động loại khỏi sitemap, giữ noindex nếu chủ đích |

| Redirect 3xx | URL trong sitemap trả về 301/302 | Thay URL cũ bằng URL đích cuối cùng trong sitemap |

| 404 / 410 | URL không còn tồn tại | Xóa khỏi sitemap, nếu có URL thay thế thì thêm URL mới |

| Soft 404 | Trang 200 nhưng nội dung rỗng hoặc thông báo lỗi | Loại khỏi sitemap, đề xuất cải thiện nội dung hoặc redirect |

| Canonical chéo domain | Canonical trỏ sang domain/subdomain khác | Loại khỏi sitemap hiện tại, xem xét tạo sitemap riêng cho domain đích |

Để tăng tính hữu dụng, mỗi bản ghi log nên kèm theo: thời gian phát hiện, lần phát hiện lặp lại, số lần Googlebot truy cập (nếu tích hợp dữ liệu log server), và trạng thái xử lý (chưa xử lý, đang xử lý, đã fix) nhằm hỗ trợ quy trình SEO nội bộ.

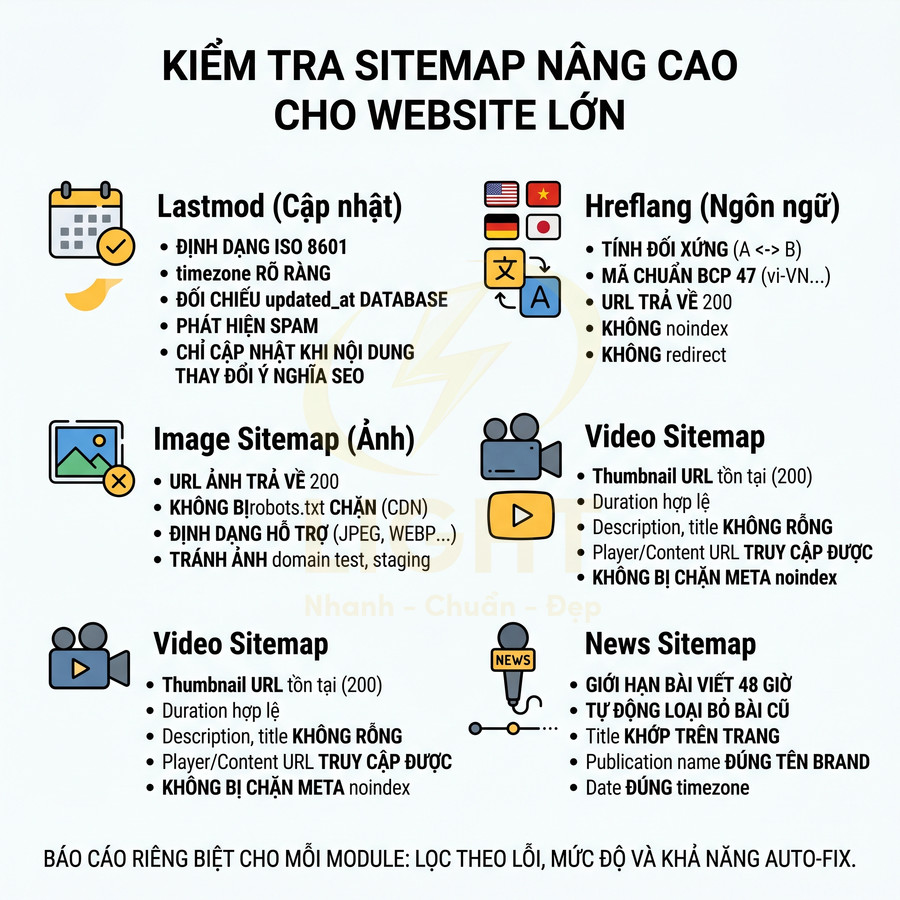

Kiểm tra lastmod, hreflang, image sitemap, video sitemap và news sitemap

Đối với website lớn, đa ngôn ngữ hoặc có nhiều loại nội dung media, các thuộc tính mở rộng trong sitemap đóng vai trò như “tín hiệu ưu tiên” giúp search engine hiểu rõ mức độ cập nhật, ngôn ngữ, và loại tài nguyên. Hệ thống auto-audit cần validate chặt chẽ từng thuộc tính để tránh gửi tín hiệu sai hoặc spam.

- lastmod:

- Kiểm tra định dạng chuẩn ISO 8601 (ví dụ: 2026-04-16T10:30:00+00:00), bao gồm timezone rõ ràng.

- Đối chiếu lastmod với:

- Thời điểm cập nhật nội dung trong database (updated_at).

- Thời điểm thay đổi cấu trúc onpage quan trọng (title, H1, nội dung chính, schema).

- Phát hiện các pattern spam:

- Tất cả URL đều có lastmod giống nhau mỗi ngày dù không có thay đổi nội dung.

- Lastmod được cập nhật theo cron cố định mà không gắn với thay đổi thực tế.

- Đề xuất chỉ cập nhật lastmod khi có thay đổi nội dung “có ý nghĩa SEO”, tránh cập nhật khi chỉ sửa minor UI hoặc tracking.

- hreflang:

- Đảm bảo tính đối xứng:

- Mỗi URL A (vi-VN) trỏ hreflang sang URL B (en-US), thì URL B cũng phải trỏ ngược lại sang A.

- Kiểm tra cả trong sitemap và trong HTML (nếu có) để phát hiện inconsistency.

- Validate mã ngôn ngữ và vùng theo chuẩn BCP 47 (vi-VN, en-US, fr-FR…), tránh các mã không hợp lệ hoặc viết sai (ví dụ: vn-VN).

- Đảm bảo tất cả URL trong cụm hreflang:

- Trả về 200.

- Không noindex.

- Không redirect sang URL khác.

- Đảm bảo tính đối xứng:

- Image sitemap:

- Kiểm tra từng URL ảnh:

- Trả về 200, không 3xx, 4xx, 5xx.

- Không bị robots.txt chặn (đặc biệt là khi dùng CDN riêng).

- Validate định dạng ảnh được hỗ trợ (JPEG, PNG, WebP, GIF…) và loại trừ các định dạng không được index (một số vector, file nguồn thiết kế).

- Đối chiếu domain ảnh với domain chính:

- Nếu dùng CDN, đảm bảo CDN không chặn bot và có cấu hình canonical phù hợp (nếu cần).

- Tránh liệt kê ảnh từ domain test, staging hoặc private.

- Kiểm tra từng URL ảnh:

- Video sitemap:

- Kiểm tra các trường quan trọng:

- Thumbnail URL: tồn tại, trả về 200, không bị chặn.

- Duration: giá trị hợp lệ, không bằng 0.

- Description, title: không rỗng, không trùng lặp hàng loạt.

- Player URL hoặc content URL: truy cập được, không private, không yêu cầu login.

- Đảm bảo video không bị chặn bởi robots.txt hoặc meta noindex trên trang chứa video.

- Kiểm tra các trường quan trọng:

- News sitemap:

- Giới hạn bài viết trong 48 giờ gần nhất theo guideline Google News:

- Hệ thống cần tự động loại bỏ bài cũ hơn 48 giờ khỏi news sitemap, nhưng vẫn có thể giữ trong sitemap thường.

- Kiểm tra:

- Title: khớp với title hiển thị trên trang, không bị cắt cụt.

- Publication name: đúng tên brand đã đăng ký với Google News.

- Publication date: đúng timezone, không backdate hoặc future date giả tạo.

- Giới hạn bài viết trong 48 giờ gần nhất theo guideline Google News:

Mỗi module (lastmod, hreflang, image, video, news) nên có báo cáo riêng, cho phép lọc theo loại lỗi, mức độ nghiêm trọng và khả năng auto-fix, vì các lỗi này thường khó phát hiện thủ công nhưng ảnh hưởng trực tiếp đến khả năng xuất hiện trên Google Images, Google Videos và Google News.

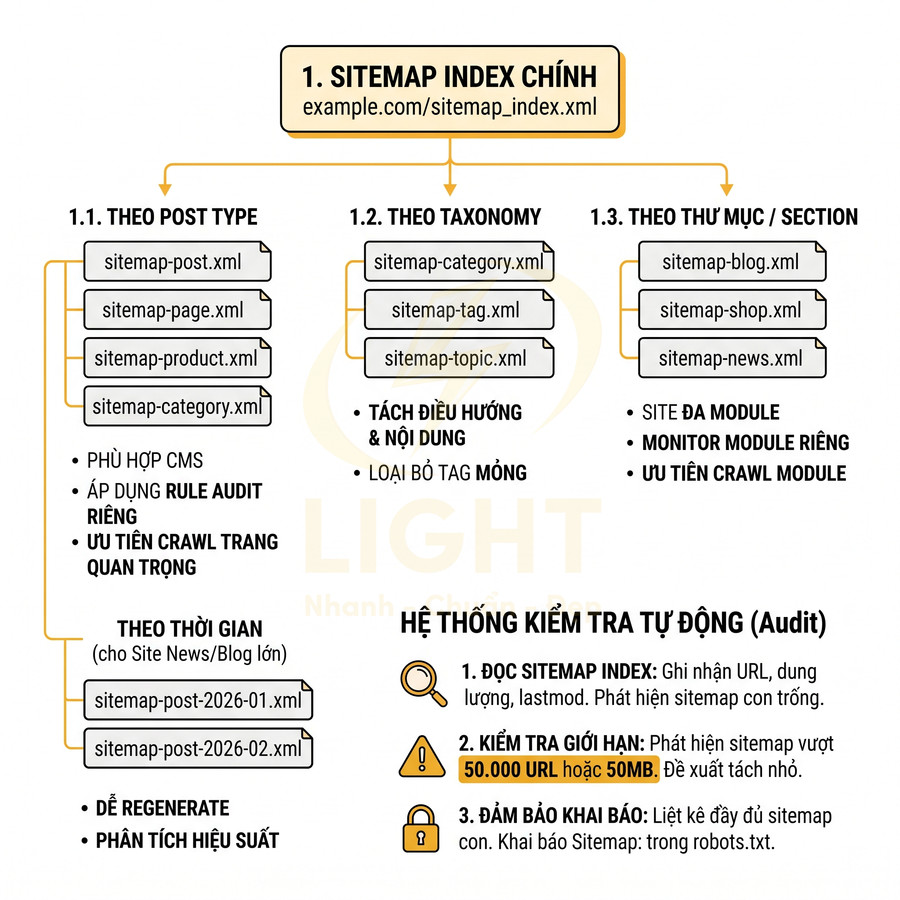

Phân tầng sitemap index cho website lớn theo post type, taxonomy và thư mục

Đối với website có hàng trăm nghìn đến hàng triệu URL, cấu trúc sitemap index không chỉ để vượt qua giới hạn 50.000 URL hoặc 50MB, mà còn là công cụ tổ chức thông tin giúp search engine hiểu rõ cấu trúc nội dung và ưu tiên crawl theo nhóm. Việc phân tầng hợp lý giúp việc regenerate, monitor và debug sitemap trở nên dễ dàng hơn rất nhiều.

- Theo post type:

- Ví dụ: sitemap-post.xml, sitemap-page.xml, sitemap-product.xml, sitemap-category.xml…

- Phù hợp với CMS như WordPress, WooCommerce, Magento, nơi mỗi post type có logic URL và template riêng.

- Cho phép:

- Áp dụng rule auto-audit khác nhau cho từng post type (ví dụ: product yêu cầu image bắt buộc, post yêu cầu word count tối thiểu).

- Ưu tiên crawl cho post type quan trọng về business (product, landing page) so với các trang tĩnh ít thay đổi.

- Theo taxonomy:

- Ví dụ: sitemap-category.xml, sitemap-tag.xml, sitemap-topic.xml…

- Giúp tách rõ nhóm URL điều hướng (category, tag) khỏi URL nội dung (post, product).

- Hệ thống có thể:

- Áp dụng rule riêng cho taxonomy (tránh index tag mỏng, category trùng lặp).

- Đề xuất noindex hoặc loại khỏi sitemap các taxonomy không mang lại traffic hoặc bị coi là thin content.

- Theo thư mục hoặc section:

- Ví dụ: sitemap-blog.xml, sitemap-shop.xml, sitemap-news.xml, sitemap-forum.xml…

- Phù hợp với site đa module, mỗi module có logic URL riêng (ví dụ: /blog/, /shop/, /forum/).

- Cho phép:

- Monitor riêng từng module: số URL indexable, tỷ lệ lỗi, tốc độ cập nhật.

- Ưu tiên crawl cho module đang được đẩy mạnh SEO hoặc marketing.

- Theo thời gian:

- Ví dụ: sitemap-post-2026-01.xml, sitemap-post-2026-02.xml…

- Đặc biệt hữu ích cho site news, blog lớn:

- Dễ regenerate sitemap theo tháng mà không ảnh hưởng các tháng cũ.

- Dễ phân tích hiệu suất index theo thời gian (tháng nào index chậm, lỗi nhiều).

Hệ thống tự động cần có khả năng:

- Đọc sitemap index:

- Crawl từng sitemap con, ghi nhận số lượng URL, dung lượng file, thời gian lastmod của từng sitemap con.

- Phát hiện sitemap con trống hoặc gần như trống (ít URL) để đề xuất gộp.

- Phát hiện sitemap con vượt giới hạn:

- Nếu số lượng URL > 50.000 hoặc dung lượng > 50MB (sau nén), gắn cờ và đề xuất chiến lược tách nhỏ (theo post type, theo thời gian, theo thư mục).

- Kiểm tra xem việc tách nhỏ có giữ được logic grouping hiện tại hay không, tránh tạo cấu trúc sitemap khó hiểu.

- Đảm bảo khai báo đầy đủ:

- Tất cả sitemap con đều được liệt kê trong sitemap index, không có sitemap “mồ côi” chỉ submit thủ công trong GSC.

- Sitemap index (hoặc các sitemap chính) được khai báo trong robots.txt bằng dòng Sitemap:, giúp bot dễ phát hiện.

Khi kết hợp auto-audit sitemap với cấu trúc sitemap index được phân tầng hợp lý, hệ thống SEO nội bộ có thể vận hành gần như tự động: phát hiện lỗi, tự sửa các lỗi đơn giản, cảnh báo lỗi phức tạp, và đảm bảo rằng mọi URL quan trọng đều được search engine nhìn thấy trong trạng thái tối ưu nhất.

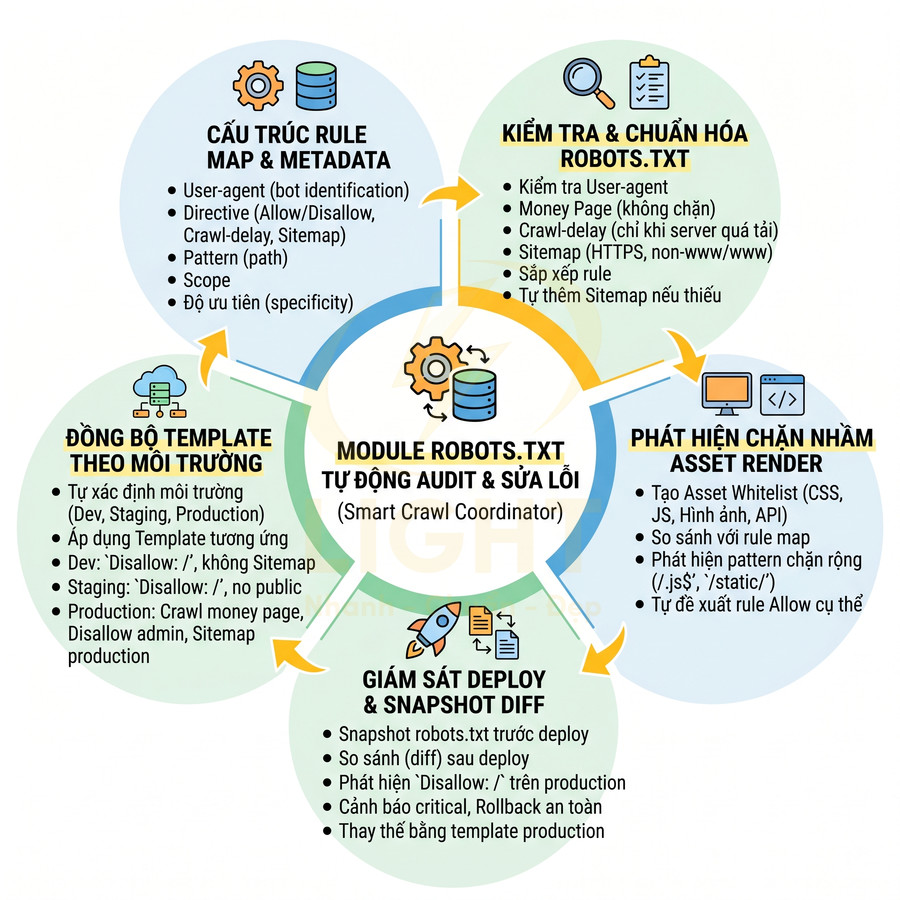

Cấu trúc robots.txt chuẩn SEO mà website nên có module tự động audit và tự động sửa

Module robots.txt chuẩn SEO cần vận hành như một lớp điều phối crawl thông minh, dựa trên rule map có cấu trúc rõ ràng cho từng nhóm User-agent, kết hợp metadata để phân tích quyền truy cập, xung đột Allow/Disallow và mức độ ưu tiên rule. Hệ thống phải tự động kiểm tra các directive quan trọng như Disallow, Allow, Crawl-delay, Sitemap, đồng thời phát hiện rule chặn nhầm CSS, JS, image, font và API render thông qua một asset whitelist được định nghĩa sẵn. Bên cạnh đó, module cần cơ chế giám sát sau deploy để bắt lỗi robots staging còn sót Disallow: /, dùng snapshot và diff để rollback an toàn. Cuối cùng, việc đồng bộ template robots.txt theo từng môi trường dev, staging, production giúp giảm thiểu rủi ro sai sót và bảo vệ hiệu suất SEO dài hạn.

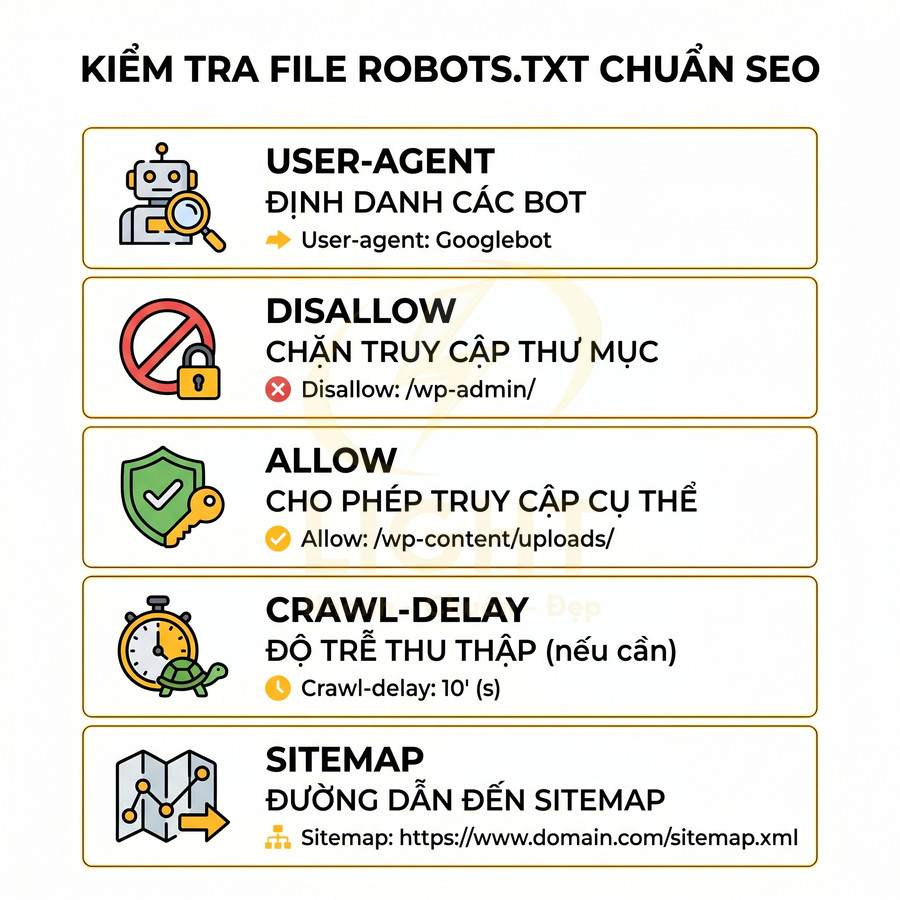

Kiểm tra User-agent, Disallow, Allow, Crawl-delay và đường dẫn sitemap

File robots.txt chuẩn SEO không chỉ là một vài dòng Disallow/Allow đơn giản, mà nên được xem như một lớp cấu hình điều phối crawl cho toàn bộ hệ thống. Để module auto-audit và auto-fix hoạt động hiệu quả, robots.txt cần được chuẩn hóa theo một cấu trúc có thể parse được, nhất quán và không mơ hồ. Cách tiếp cận tốt là chuyển toàn bộ nội dung robots.txt thành một rule map có cấu trúc, trong đó mỗi rule được gắn với một nhóm User-agent cụ thể, kèm theo metadata phục vụ phân tích. RFC 9309 cung cấp cơ sở kỹ thuật để xem robots.txt như một cấu trúc rule có thể parse, gồm user-agent, group và rule allow/disallow (Koster et al., 2022). Điều này hỗ trợ việc xây dựng module auto-audit thay vì kiểm tra thủ công. Hệ thống nên chuyển robots.txt thành rule map, sau đó mô phỏng từng URL quan trọng để biết rule nào đang thắng. Cách làm này đặc biệt cần thiết khi có Allow/Disallow chồng chéo, ví dụ chặn /assets/ nhưng mở lại /assets/js/. Nếu không mô phỏng rule theo độ cụ thể, đội SEO rất dễ hiểu sai phạm vi ảnh hưởng của một dòng robots.

Một rule map chi tiết thường bao gồm:

- User-agent: định danh bot (Googlebot, Googlebot-Image, Bingbot, …).

- Directive: loại rule (Disallow, Allow, Crawl-delay, Sitemap, Host, Clean-param…).

- Pattern: path hoặc pattern được áp dụng (ví dụ: /wp-admin/, /static/, /.js$).

- Scope: áp dụng cho toàn bộ site hay một phần (subdirectory, subdomain).

- Priority / Specificity: độ ưu tiên dựa trên độ dài pattern và mức độ cụ thể, dùng để giải quyết xung đột Allow/Disallow.

Module auto-audit nên parse robots.txt thành các block theo từng nhóm User-agent, ví dụ:

- Block cho User-agent: Googlebot.

- Block cho User-agent: Googlebot-Image (nếu có nhu cầu kiểm soát riêng hình ảnh).

- Block cho User-agent: (wildcard cho các bot còn lại).

Với mỗi block, hệ thống cần đánh giá:

- Quyền crawl tổng thể (toàn site, một phần site, hay bị chặn gần như hoàn toàn).

- Các thư mục quan trọng (money page, category, product, blog, landing page) có bị chặn trực tiếp hoặc gián tiếp hay không.

- Các rule có xung đột (Allow và Disallow cùng áp dụng cho một path) và rule nào đang thắng theo chuẩn robots.

Các điểm kiểm tra chuyên sâu:

- User-agent:

- Đảm bảo có rule rõ ràng cho Googlebot, và khi cần có thể tách riêng cho Googlebot-Image, Googlebot-News, Googlebot-Video để tối ưu từng vertical.

- Không cấu hình rule quá chặt cho Googlebot, ví dụ:

- Không Disallow toàn bộ các thư mục chứa nội dung chính chỉ vì lo duplicate.

- Không áp dụng pattern chặn quá rộng cho User-agent: rồi vô tình ảnh hưởng Googlebot nếu không có Allow override đủ cụ thể.

- Kiểm tra consistency giữa block User-agent: Googlebot và User-agent: để tránh trường hợp wildcard chặn nhưng block riêng lại không đủ cụ thể để mở.

- Disallow / Allow:

- Phát hiện mọi trường hợp Disallow: / trên production, kể cả khi rule này chỉ xuất hiện trong block User-agent: hoặc một bot cụ thể nhưng có khả năng ảnh hưởng Googlebot.

- Đối chiếu danh sách URL quan trọng (money page, category, product, blog, landing page SEO) với rule map để đảm bảo:

- Không có path cha bị Disallow khiến path con quan trọng bị chặn theo.

- Nếu thư mục cha bị Disallow vì lý do crawl budget (ví dụ: /filter/, /search/), phải có Allow cụ thể cho các path con cần index.

- Áp dụng nguyên tắc: Allow càng cụ thể càng có ưu tiên cao hơn Disallow ít cụ thể hơn. Module audit nên tính toán độ dài pattern và mức độ match để xác định rule thực tế đang được áp dụng.

- Phát hiện các pattern Disallow quá rộng như:

- Disallow: /app/ trong khi toàn bộ frontend SPA nằm trong /app/.

- Disallow: /public/ nhưng lại chứa image, CSS, JS quan trọng.

- Crawl-delay:

- Ghi nhận rằng Google gần như bỏ qua Crawl-delay, nhưng nhiều bot khác (Bing, Yandex, một số crawler third-party) vẫn tôn trọng directive này.

- Module audit nên:

- Đánh dấu cảnh báo nếu Crawl-delay cho các bot lớn (Bingbot, Yandex) quá cao, gây chậm index hoặc update nội dung.

- Đề xuất chỉ sử dụng Crawl-delay khi có bằng chứng server quá tải (log server, error 5xx, spike CPU/IO).

- Phân biệt Crawl-delay theo từng User-agent, tránh áp dụng một giá trị chung cho tất cả.

- Sitemap:

- Đảm bảo tồn tại ít nhất một dòng: Sitemap: https://www.domain.com/sitemap.xml

- Kiểm tra:

- Protocol: bắt buộc HTTPS nếu site production dùng HTTPS.

- Consistency: đúng phiên bản www/non-www và đúng subdomain (www.domain.com vs shop.domain.com).

- Không trỏ nhầm sang sitemap của staging, dev hoặc domain khác.

- Nếu có nhiều sitemap (sitemap index, sitemap cho blog, product…), module audit cần:

- Kiểm tra tính hợp lệ HTTP (status 200, không 3xx/4xx/5xx).

- Đảm bảo không có sitemap trỏ tới URL staging/dev.

Module tự động chuẩn hóa robots.txt có thể thực hiện:

- Tự động thêm dòng Sitemap nếu thiếu, dựa trên cấu hình domain production.

- Sắp xếp lại thứ tự rule theo nhóm User-agent, sau đó là Disallow/Allow/Crawl-delay/Sitemap để dễ đọc và dễ diff.

- Loại bỏ dòng trống dư thừa, comment lỗi thời, nhưng vẫn giữ lại các comment quan trọng được đánh dấu (ví dụ: # DO NOT EDIT – managed by SEO team).

- Khóa hoặc bảo vệ các block rule quan trọng do SEO/Dev thiết lập, chỉ cho phép thay đổi thông qua quy trình approve.

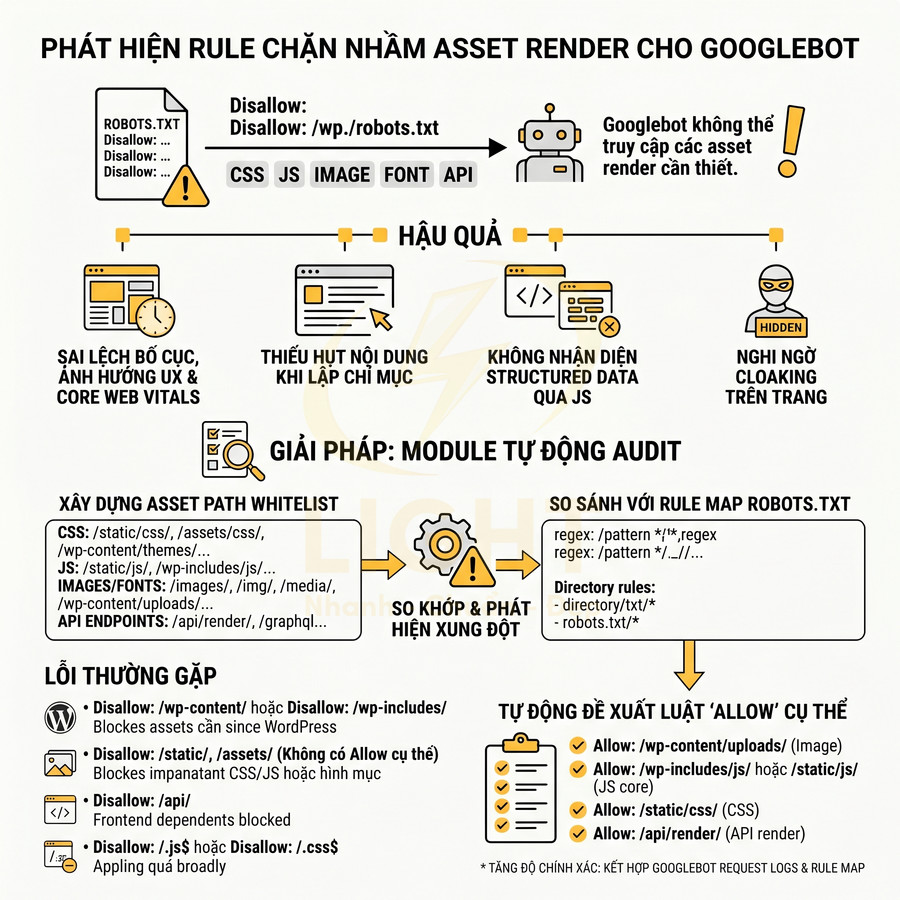

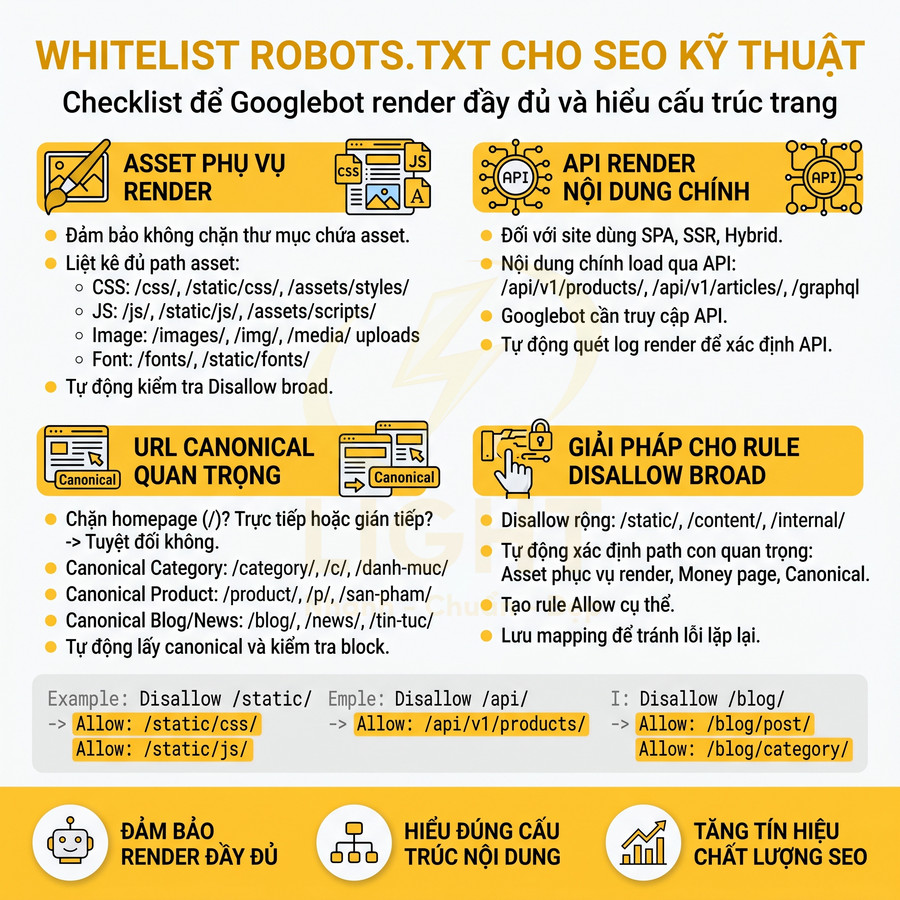

Phát hiện rule chặn nhầm CSS, JS, image, API render cần cho Googlebot

Để Google có thể render trang giống người dùng thực, Googlebot cần truy cập đầy đủ CSS, JS, image, font, API render. Nếu robots.txt chặn nhầm các asset này, Google có thể:

- Không render đúng layout, dẫn đến đánh giá sai về UX và Core Web Vitals.

- Không đọc được nội dung được render bằng JS, gây thiếu nội dung trong index.

- Không nhận diện đúng structured data được inject bằng JS.

- Hiểu sai về nội dung ẩn/hiện, có thể nghi ngờ cloaking.

Module auto-audit cần xây dựng một asset path whitelist bao gồm:

- Các thư mục chứa CSS: /static/css/, /assets/css/, /wp-content/themes/…

- Các thư mục chứa JS: /static/js/, /assets/js/, /wp-includes/js/…

- Các thư mục chứa image và font: /images/, /img/, /media/, /fonts/, /wp-content/uploads/…

- Các endpoint API render nội dung chính: /api/render/, /api/content/, /graphql…

Sau đó, hệ thống so khớp whitelist này với rule map để phát hiện:

- Các thư mục asset bị Disallow toàn bộ mà không có Allow override.

- Các pattern regex hoặc pattern kết thúc (suffix) chặn toàn bộ file .js, .css, .png, .jpg, .webp, .woff2…

- Các endpoint API quan trọng bị Disallow trong khi frontend phụ thuộc vào chúng để render nội dung chính.

Các pattern lỗi thường gặp:

- Disallow: /wp-content/ hoặc Disallow: /wp-includes/ chặn luôn CSS/JS cần thiết cho WordPress theme và plugin.

- Disallow: /static/, /assets/, /cdn/ mà không có Allow cho file CSS/JS hoặc image quan trọng.

- Disallow: /api/ trong khi frontend (SPA/SSR) dùng API này để render nội dung chính trên trang.

- Disallow: /.js$ hoặc Disallow: /.css$ áp dụng quá rộng, chặn toàn bộ JS/CSS.

Khi phát hiện xung đột, module có thể tự động đề xuất (hoặc auto-fix nếu được cho phép) các rule Allow cụ thể, ví dụ:

- Allow: /wp-content/uploads/ để mở image, media.

- Allow: /wp-includes/js/ hoặc Allow: /static/js/ cho JS core.

- Allow: /static/css/ cho CSS layout.

- Allow: /api/render/ hoặc các endpoint API phục vụ render nội dung.

Để tăng độ chính xác, hệ thống có thể kết hợp:

- Log request của Googlebot (từ server log) để xác định các path asset mà Googlebot thường truy cập.

- So sánh với rule map để xem có path nào trong số đó đang bị Disallow.

- Đánh dấu mức độ ưu tiên fix dựa trên tần suất truy cập và mức độ ảnh hưởng (asset layout vs asset phụ).

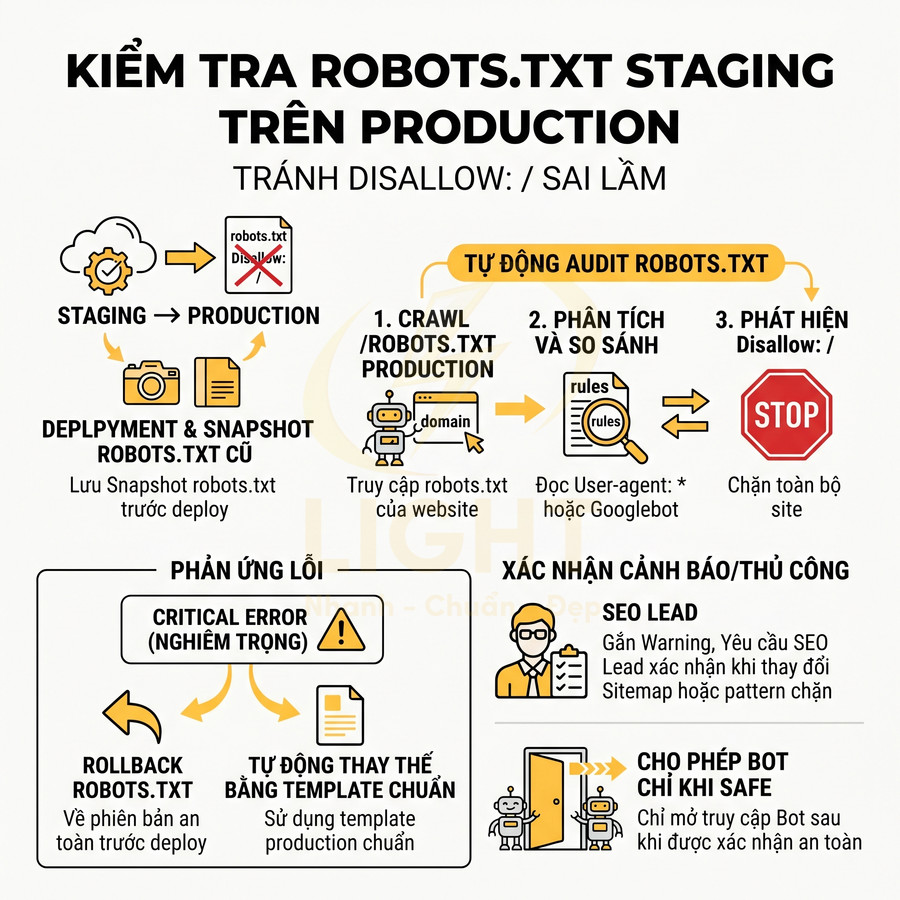

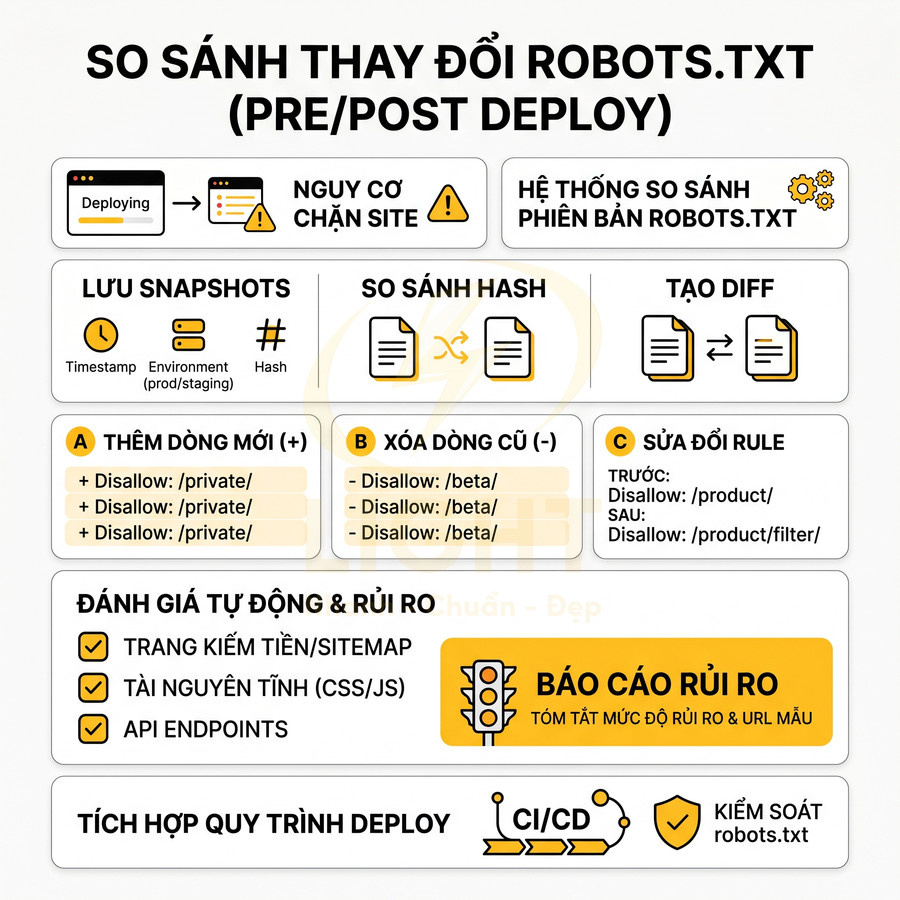

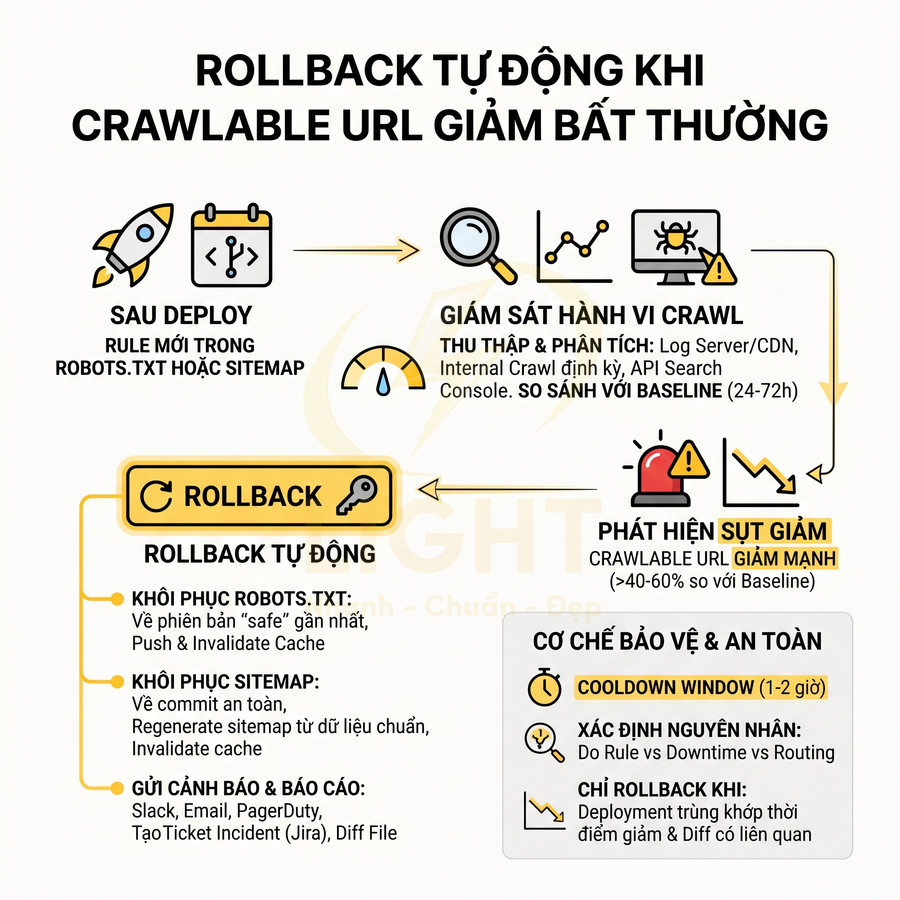

Kiểm tra robots staging còn sót Disallow: / sau khi deploy production

Trên môi trường staging, việc sử dụng Disallow: / để chặn toàn bộ bot là hợp lý nhằm tránh index nội dung test. Tuy nhiên, rủi ro lớn xuất hiện khi file robots.txt của staging bị deploy nhầm lên production, giữ nguyên Disallow: / và khiến toàn bộ website bị chặn crawl. Module auto-audit cần có cơ chế phát hiện pattern này ngay lập tức sau mỗi lần deploy.

Quy trình kiểm tra tự động có thể bao gồm:

- Ngay sau deploy, một crawler nội bộ (hoặc job CI/CD) truy cập /robots.txt trên domain production.

- Parse rule cho:

- User-agent: .

- User-agent: Googlebot (nếu có block riêng).

- Phát hiện các pattern chặn toàn bộ site:

- Disallow: / trong block áp dụng cho Googlebot hoặc wildcard.

- Các pattern tương đương như Disallow: / hoặc Disallow cho thư mục gốc.

- Nếu phát hiện, gắn cờ lỗi critical và:

- Kích hoạt cơ chế rollback robots.txt về phiên bản an toàn đã được approve.

- Hoặc tự động thay thế robots.txt bằng template production chuẩn.

Để tăng độ an toàn, hệ thống nên:

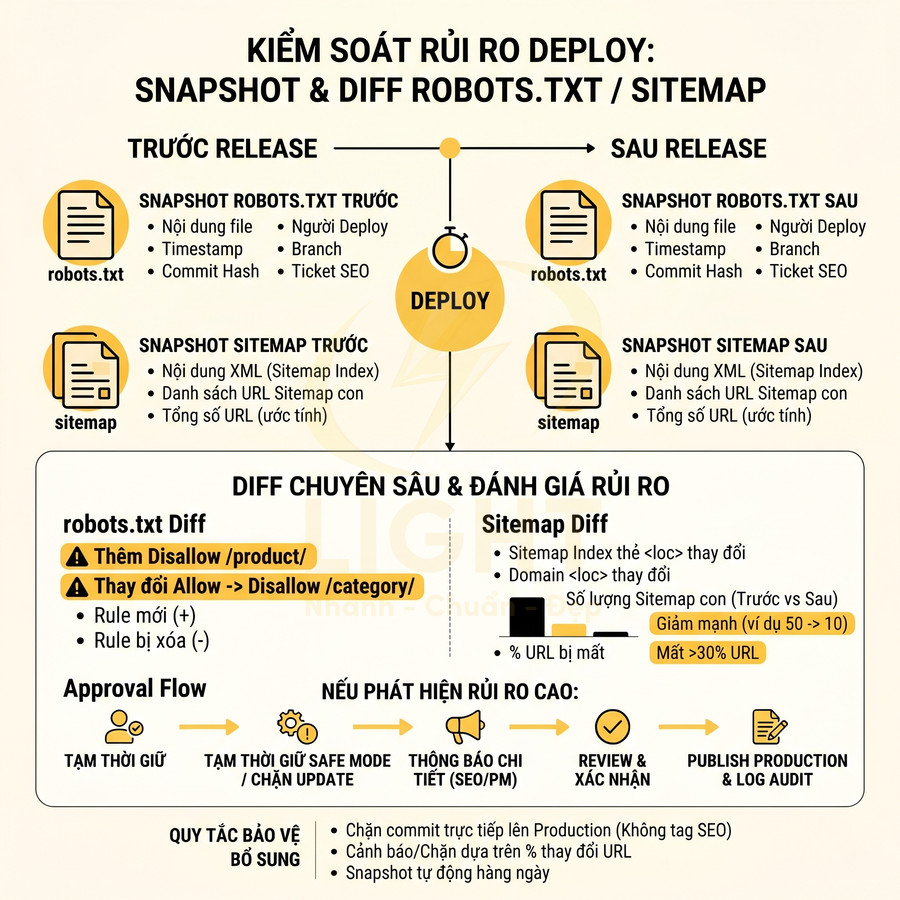

- Lưu snapshot robots.txt trước mỗi lần deploy (kèm timestamp, commit ID, người thực hiện).

- Sau deploy, so sánh diff giữa phiên bản mới và snapshot:

- Nếu phát hiện thêm Disallow: / hoặc pattern chặn toàn site, đánh dấu critical.

- Nếu phát hiện xóa dòng Sitemap hoặc thay đổi domain trong Sitemap, đánh dấu warning/critical tùy mức độ.

- Nếu rule cho các thư mục quan trọng (money page, category, product, blog) bị thay đổi, yêu cầu xác nhận thủ công từ SEO lead.

- Chỉ cho phép bot truy cập (bằng cách mở firewall hoặc bỏ noindex header) sau khi robots.txt mới được xác nhận an toàn.

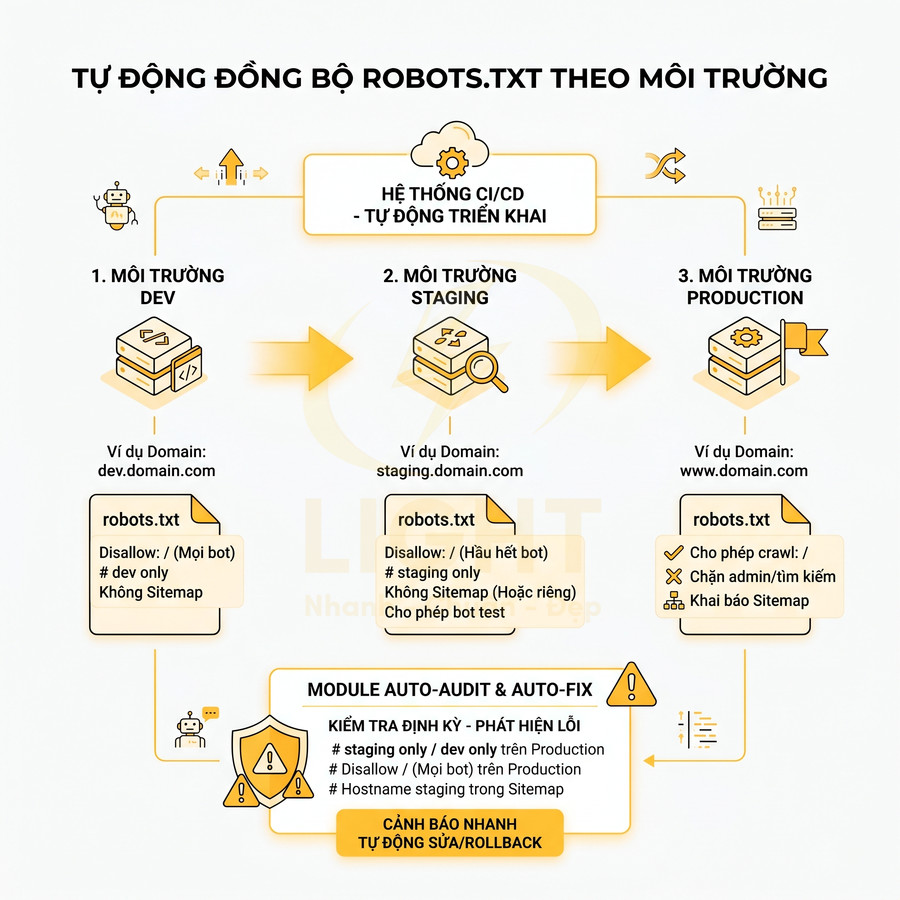

Tự động đồng bộ robots.txt theo môi trường dev, staging, production

Một chiến lược an toàn và chuyên nghiệp là thiết kế template robots.txt riêng cho từng môi trường và để hệ thống CI/CD tự động áp dụng đúng template khi deploy. Điều này giúp giảm tối đa rủi ro copy nhầm robots.txt từ staging sang production, đồng thời đảm bảo mỗi môi trường có chính sách crawl phù hợp.

Module auto-audit có thể xác định môi trường hiện tại dựa trên:

- Domain/hostname (ví dụ: dev.domain.com, staging.domain.com, www.domain.com).

- Environment variable (ENV=dev, staging, production) được inject vào build.

- IP range hoặc network segment (nội bộ vs public).

Sau khi xác định môi trường, hệ thống đối chiếu robots.txt hiện tại với template tương ứng:

- Dev:

- Disallow: / cho tất cả User-agent.

- Không khai báo Sitemap để tránh bot tìm thấy URL dev.

- Có thể thêm comment nội bộ (ví dụ: # dev only) để module audit dễ nhận diện.

- Staging:

- Disallow: / cho hầu hết bot, đặc biệt là Googlebot, Bingbot.

- Không khai báo Sitemap, hoặc dùng sitemap riêng không submit lên GSC.

- Có thể cho phép một số bot test nội bộ (User-agent custom) để kiểm tra render, performance.

- Comment rõ ràng: # staging only – do not use on production.

- Production:

- Cho phép crawl các thư mục quan trọng: /, /category/, /product/, /blog/, /landing/…

- Disallow các khu vực:

- Admin: /wp-admin/, /admin/, /backend/.

- Search nội bộ: /search/, /?s=.

- Filter rác, parameter không cần index: /filter/, ?sort=, &utm_ (có thể kết hợp với Clean-param).

- Khai báo đầy đủ dòng Sitemap với domain production chính xác.

Module auto-audit nên chạy định kỳ (hoặc hook sau mỗi deploy) để kiểm tra:

- Robots.txt trên production có đang chứa các pattern chỉ dành cho staging/dev hay không:

- Disallow: / cho User-agent: .

- Comment như “staging only”, “dev only”.

- Hostname staging trong dòng Sitemap (ví dụ: https://staging.domain.com/sitemap.xml).

- Nếu phát hiện, lập tức:

- Cảnh báo cho team Dev và SEO qua kênh tích hợp (Slack, email, ticket…).

- Tùy cấu hình, có thể auto-switch sang template production chuẩn hoặc rollback.

Bằng cách kết hợp rule map chi tiết, asset whitelist, snapshot diff và template theo môi trường, module auto-audit/auto-fix robots.txt có thể hoạt động như một lớp bảo vệ SEO quan trọng, giảm thiểu rủi ro chặn nhầm crawl, mất index hoặc render sai trên các môi trường khác nhau.

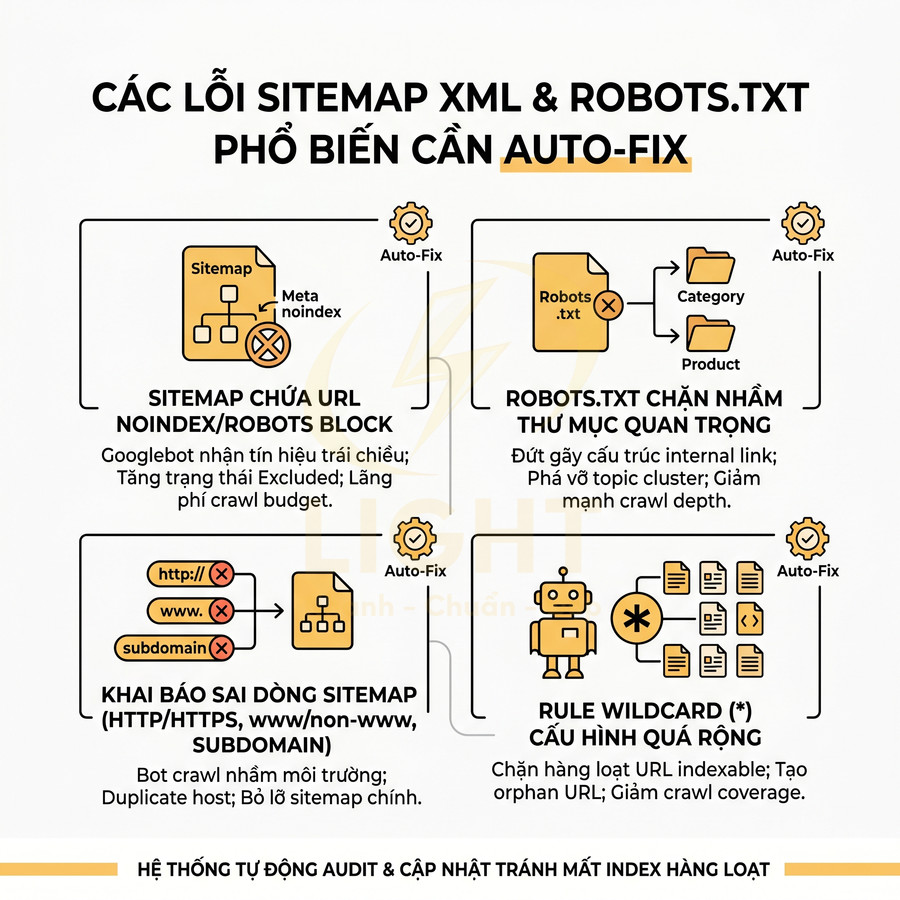

Các lỗi sitemap XML và robots.txt phổ biến cần auto-fix để tránh mất index hàng loạt

Sitemap XML và robots.txt cần được kiểm soát chặt để tránh xung đột tín hiệu index. Khi sitemap chứa URL bị chặn robots hoặc gắn meta noindex, Googlebot nhận tín hiệu trái chiều, làm rối hệ thống đánh giá indexability, tăng trạng thái Excluded và lãng phí crawl budget. Với site lớn, điều này có thể khiến nhiều URL quan trọng bị chậm hoặc mất index, nên cần cơ chế auto-audit/auto-fix ở cả mức URL và pattern.

Robots.txt chặn nhầm thư mục category, product, blog, landing sẽ làm đứt cấu trúc internal link, phá vỡ topic cluster và giảm mạnh crawl depth. Hệ thống nên tự nhận diện pattern URL quan trọng, đối chiếu rule robots, gắn nhãn critical, rồi đề xuất/tự tinh chỉnh Disallow–Allow an toàn.

Việc khai báo sai dòng Sitemap: (HTTP/HTTPS, www/non-www, subdomain) khiến bot crawl nhầm môi trường, duplicate host hoặc bỏ lỡ sitemap chính. Auto-fix cần tự phát hiện sitemap chuẩn từ CMS, chuẩn hóa domain–protocol, cập nhật robots.txt và kiểm tra lại tính nhất quán.

Wildcard trong robots.txt nếu cấu hình quá rộng có thể chặn nhầm hàng loạt URL indexable, tạo orphan URL dù vẫn có internal link. Cần phân tích pattern wildcard, mô phỏng phạm vi ảnh hưởng trên dữ liệu sitemap/crawl, đánh giá mức độ nghiêm trọng, sau đó tách rule chi tiết hơn, bổ sung Allow cho path quan trọng và tái crawl để đảm bảo crawl coverage tối ưu.

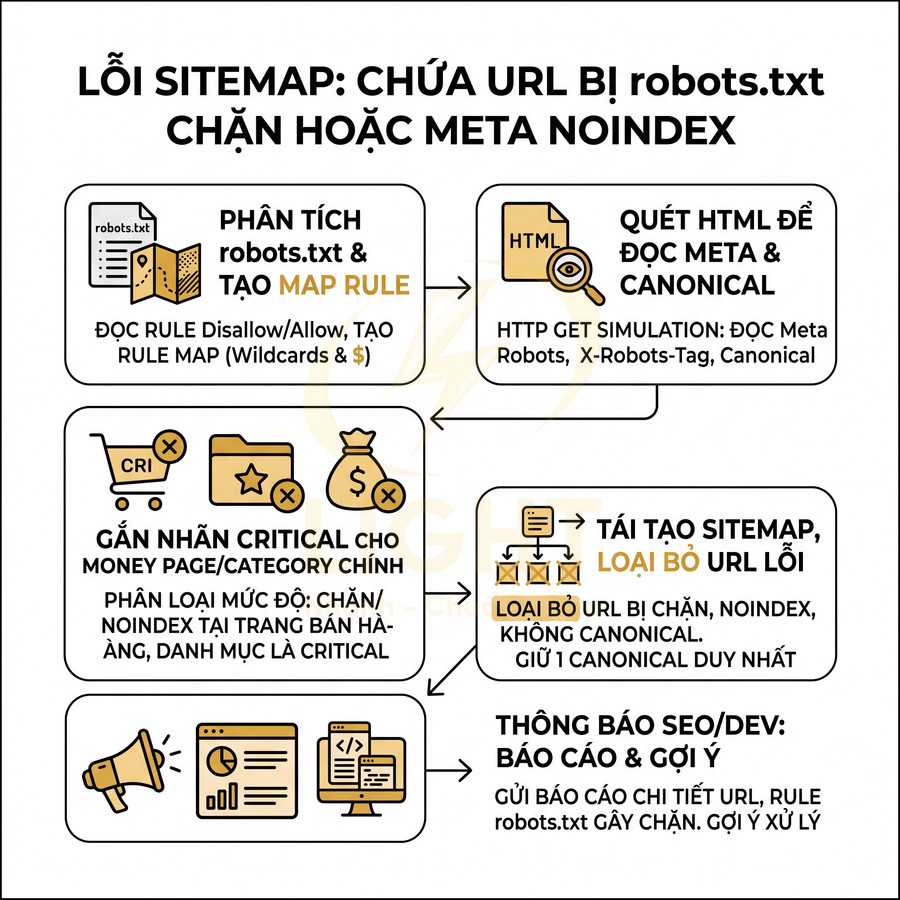

Sitemap chứa URL bị robots.txt chặn hoặc meta noindex

Lỗi sitemap chứa URL bị robots.txt chặn hoặc có meta noindex không chỉ làm tăng số lượng trạng thái Excluded trong GSC, mà còn gây nhiễu toàn bộ hệ thống tín hiệu indexability của website. Về mặt kỹ thuật, sitemap XML là tập hợp các URL được ưu tiên crawl và index, do đó việc đưa vào các URL không indexable khiến Googlebot phải xử lý mâu thuẫn:

- Sitemap nói: “URL này quan trọng, hãy index”.

- Robots.txt hoặc meta robots nói: “Không được crawl/index URL này”.

Trong các hệ thống lớn (ecommerce, news, SaaS), mâu thuẫn này có thể làm giảm hiệu quả crawl budget, khiến nhiều URL quan trọng bị trì hoãn index hoặc không được index. Một hệ thống auto-audit/auto-fix cần hoạt động ở mức URL-level và pattern-level để xử lý triệt để.

Quy trình xử lý tự động chi tiết:

- So khớp URL sitemap với rule map robots.txt:

- Parse toàn bộ file robots.txt, chuyển các rule Disallow/Allow thành một rule map có thể match pattern (bao gồm wildcard và $).

- Với mỗi URL trong sitemap, chạy qua engine match rule để xác định trạng thái:

- Crawlable (không bị Disallow hoặc được Allow override).

- Blocked (bị Disallow và không có Allow cụ thể hơn).

- Lưu kết quả vào index nội bộ: url, user-agent, isblockedbyrobots, matchedrule.

- Crawl HTML để đọc meta robots, X-Robots-Tag, canonical:

- Thực hiện HTTP GET với đầy đủ header (user-agent, accept-language, v.v.) để mô phỏng Googlebot.

- Đọc:

- Thẻ

<meta name="robots" content="noindex, nofollow">hoặc biến thể (noindex, follow; none; noarchive, v.v.). - Header

X-Robots-Tagở response (thường dùng cho file PDF, image, hoặc được set bởi server/nginx). - Thẻ

link rel="canonical"để xác định URL có phải bản canonical hay chỉ là duplicate.

- Thẻ

- Chuẩn hóa giá trị meta robots (lowercase, tách bằng dấu phẩy, loại bỏ khoảng trắng) để tránh miss-case.

- Phân loại mức độ nghiêm trọng theo loại URL:

- Dựa trên:

- Pattern URL:

/product/,/category/,/blog/,/landing/,/service/, v.v. - Template hoặc layout ID trong CMS (product template, category template, article template).

- Schema markup: Product, Article, BlogPosting, Service, FAQPage, v.v.

- Pattern URL:

- Nếu URL thuộc nhóm:

- Money page (landing bán hàng, service page, pricing, product).

- Category chính, content hub, pillar page.

- Bị Disallow trong robots.txt, hoặc

- Có meta robots/X-Robots-Tag chứa noindex/none.

- Với URL low-value (tag page, search result nội bộ, filter, parameter), có thể gắn nhãn warning hoặc info.

- Dựa trên:

- Auto-fix trên sitemap:

- Trong bước regenerate sitemap:

- Loại bỏ toàn bộ URL:

- Bị block bởi robots.txt cho user-agent chính (Googlebot, Googlebot-Image, v.v.).

- Có meta robots/X-Robots-Tag noindex/none.

- Có canonical trỏ sang URL khác (chỉ giữ canonical trong sitemap).

- Đảm bảo mỗi canonical URL chỉ xuất hiện một lần trong toàn bộ hệ thống sitemap.

- Loại bỏ toàn bộ URL:

- Gắn cờ “auto-removed-from-sitemap” để có thể rollback nếu cần.

- Trong bước regenerate sitemap:

- Thông báo cho SEO/Dev:

- Tạo báo cáo chi tiết:

- Danh sách URL critical bị noindex hoặc robots block nhưng vẫn có traffic/keyword.

- Rule robots.txt gây block (file, dòng, pattern).

- Thời điểm phát hiện và hành động auto-fix đã thực hiện (remove khỏi sitemap).

- Gợi ý hành động:

- Xem xét bỏ noindex cho money page.

- Sửa robots.txt nếu block nhầm.

- Tạo báo cáo chi tiết:

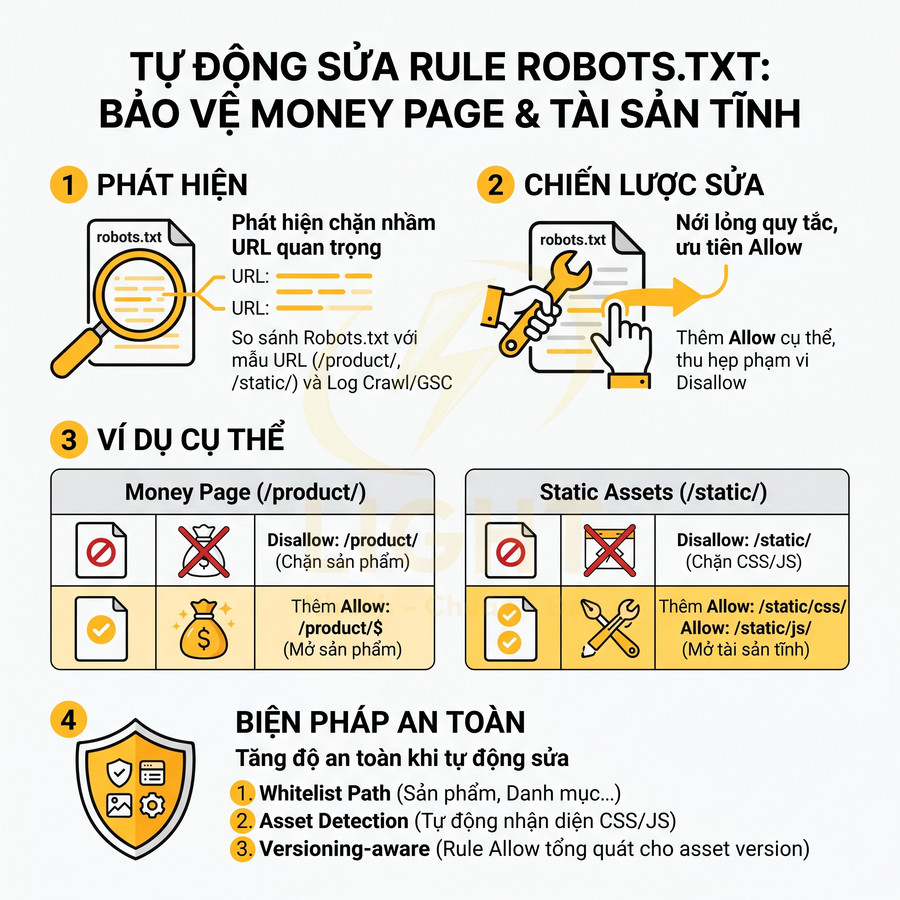

robots.txt chặn thư mục category, product, blog hoặc landing page quan trọng

Khi robots.txt chặn nhầm các thư mục quan trọng như /category/, /product/, /blog/, /landing/, tác động không chỉ là mất index hàng loạt mà còn làm đứt gãy toàn bộ cấu trúc internal link và PageRank flow. Googlebot không thể crawl sâu vào các cluster nội dung, khiến toàn bộ chiến lược topic cluster, content hub, hoặc faceted navigation bị vô hiệu hóa.

Cách hệ thống auto-audit nhận diện pattern URL quan trọng:

- Phân tích cấu trúc URL:

- Nhận diện các segment phổ biến:

/category/,/danh-muc/,/c/,/p/,/san-pham/,/blog/,/tin-tuc/,/landing/, v.v. - Ánh xạ các segment này với loại template trong CMS (category template, product template, article template).

- Nhận diện các segment phổ biến:

- Dựa trên schema và template:

- URL có schema Product → pattern product.

- URL có schema Article/BlogPosting → pattern blog/news.

- URL có layout/ID template “landing”, “service”, “pricing” → pattern landing/money page.

- Cross-check với dữ liệu traffic và conversion:

- Nếu URL/nhóm URL đóng góp nhiều session, revenue, lead → ưu tiên gắn nhãn critical.

Đối chiếu với rule map robots.txt:

- Parse robots.txt thành danh sách rule:

User-agent,Disallow,Allow,Crawl-delay, v.v.

- Với mỗi pattern quan trọng:

- Kiểm tra xem có rule Disallow nào match trực tiếp:

Disallow: /product/Disallow: /category/Disallow: /blog/Disallow: /landing/

- Hoặc match gián tiếp qua wildcard:

Disallow: /p/nhưng toàn bộ product nằm trong/p/.Disallow: /c/nhưng toàn bộ category nằm trong/c/.

- Kiểm tra xem có rule Disallow nào match trực tiếp:

- Nếu pattern quan trọng bị Disallow:

- Gắn nhãn lỗi critical với mức độ site-wide.

- Ước lượng số URL bị ảnh hưởng bằng cách:

- Đếm số URL trong sitemap match pattern.

- Đếm số URL trong crawl nội bộ match pattern.

Đề xuất và auto-fix rule robots.txt:

- Tinh chỉnh rule thay vì xóa hoàn toàn:

- Ví dụ:

- Hiện tại:

Disallow: /product/ - Đề xuất:

Disallow: /product/filter/,Disallow: /product/search/,Disallow: /product/?sort=

- Hiện tại:

- Mục tiêu: chỉ block các URL faceted navigation, filter, sort, internal search; giữ nguyên product canonical.

- Ví dụ:

- Thêm Allow cho path con quan trọng (trong chế độ auto-fix):

- Nếu không thể sửa Disallow vì lý do legacy, có thể:

- Giữ

Disallow: /product/nhưng thêm:Allow: /product/$(cho product root nếu cần).Allow: /product/-p[0-9]+$(pattern product detail).

- Giữ

- Đảm bảo thứ tự rule và mức độ cụ thể (specificity) để Allow override Disallow đúng cách.

- Nếu không thể sửa Disallow vì lý do legacy, có thể:

- Kiểm tra an toàn trước khi apply:

- Mô phỏng lại toàn bộ URL quan trọng với rule mới để đảm bảo:

- Money page, category, product, blog chính → crawlable.

- Filter, sort, search, pagination không cần thiết → vẫn bị block nếu đó là chủ đích.

- Lưu version robots.txt cũ để rollback nếu phát sinh sự cố.

- Mô phỏng lại toàn bộ URL quan trọng với rule mới để đảm bảo:

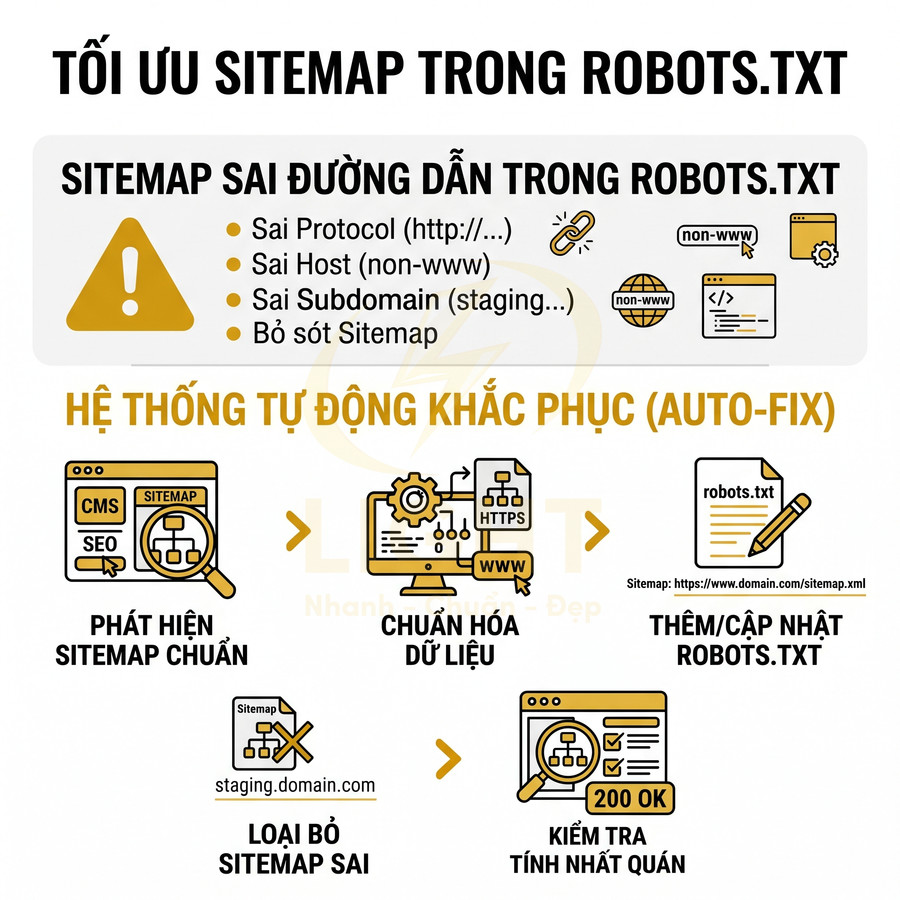

Sitemap không khai báo trong robots.txt hoặc sai đường dẫn HTTPS, www, subdomain

Dòng Sitemap: trong robots.txt là một tín hiệu kỹ thuật đơn giản nhưng rất quan trọng, đặc biệt với các site có nhiều subdomain, nhiều môi trường (dev, staging, production) hoặc nhiều phiên bản domain (www/non-www). Nếu khai báo sai, bot có thể:

- Crawl nhầm sitemap của môi trường staging/dev.

- Sử dụng sitemap HTTP trong khi site chuẩn là HTTPS, gây duplicate protocol.

- Bỏ lỡ sitemap chính nếu không được khai báo và không submit trong GSC.

Các lỗi thường gặp và tác động kỹ thuật:

Sitemap: http://domain.com/sitemap.xmltrong khi site chạy HTTPS:- Google có thể vẫn tự chuyển sang HTTPS, nhưng tín hiệu canonical protocol bị nhiễu.

- Có nguy cơ index phiên bản HTTP nếu redirect không chuẩn (302, chain, mixed content).

Sitemap: https://domain.com/sitemap.xmlnhưng site chuẩn làhttps://www.domain.com:- Tạo ra xung đột www/non-www, đặc biệt nếu redirect không 301 cứng.

- Có thể dẫn đến duplicate host và phân tán tín hiệu link.

- Sitemap trỏ sang subdomain khác không phải nơi chứa nội dung chính:

- Ví dụ: robots.txt trên

www.domain.comnhưng Sitemap trỏ sanghttps://blog.domain.com/sitemap.xmltrong khi blog chỉ là phần nhỏ. - Bot có thể ưu tiên crawl subdomain phụ thay vì main site.

- Ví dụ: robots.txt trên

- Không có dòng Sitemap nào trong robots.txt:

- Bot phải dựa vào GSC hoặc internal link để khám phá sitemap, làm chậm quá trình discover URL mới.

Cách hệ thống auto-fix xử lý:

- Tự động phát hiện URL sitemap chuẩn:

- Đọc cấu hình CMS/SEO plugin (Yoast, RankMath, custom module) để lấy:

- URL sitemap index (ví dụ:

/sitemapindex.xml). - Các sitemap con (post-sitemap.xml, page-sitemap.xml, product-sitemap.xml, v.v.).

- URL sitemap index (ví dụ:

- Chuẩn hóa theo:

- Protocol chuẩn (HTTPS).

- Host chuẩn (www hoặc non-www theo canonical domain).

- Subdomain chuẩn (www.domain.com, không phải staging.domain.com).

- Đọc cấu hình CMS/SEO plugin (Yoast, RankMath, custom module) để lấy:

- Thêm hoặc cập nhật dòng Sitemap trong robots.txt:

- Nếu không có dòng Sitemap:

- Thêm:

Sitemap: https://www.domain.com/sitemapindex.xml(hoặc sitemap.xml tùy cấu hình).

- Thêm:

- Nếu có nhưng sai:

- Thay thế HTTP → HTTPS.

- Thay thế non-www → www (hoặc ngược lại) theo canonical host.

- Loại bỏ các dòng Sitemap trỏ tới:

- Subdomain staging/dev.

- Domain cũ đã migrate.

- Đảm bảo không nhân bản quá nhiều dòng Sitemap không cần thiết, giữ cấu trúc rõ ràng.

- Nếu không có dòng Sitemap:

- Kiểm tra tính nhất quán sau khi sửa:

- Fetch robots.txt và sitemap bằng HTTP client để:

- Đảm bảo status code 200.

- Không có redirect vòng lặp.

- Canonical domain, protocol, subdomain thống nhất.

- Log lại version robots.txt trước và sau khi auto-fix.

- Fetch robots.txt và sitemap bằng HTTP client để:

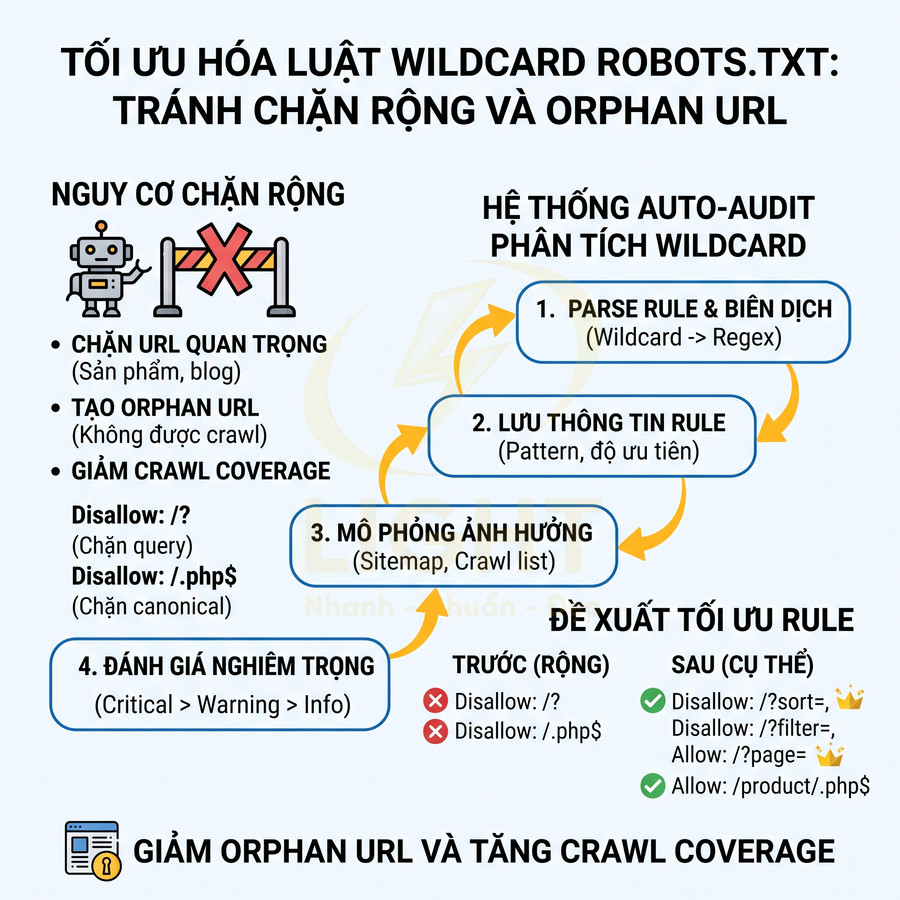

Rule wildcard chặn quá rộng làm orphan URL và giảm crawl coverage

Wildcard trong robots.txt (ký tự và $) cho phép định nghĩa rule rất linh hoạt, nhưng cũng là nguồn gốc của nhiều lỗi nghiêm trọng. Khi một rule wildcard match quá rộng, nó có thể:

- Chặn luôn các URL cần index (product, category, blog).

- Biến nhiều URL có internal link thành orphan URL theo nghĩa “không được crawl” dù vẫn được liên kết.

- Làm giảm mạnh crawl coverage, khiến Googlebot chỉ crawl một phần nhỏ site.

Các pattern wildcard nguy hiểm thường gặp:

Disallow: /?để chặn URL có query string:- Nếu site dùng query cho filter, sort, pagination, nhưng cũng dùng cho canonical URL (ví dụ:

?page=1), rule này có thể chặn nhầm.

- Nếu site dùng query cho filter, sort, pagination, nhưng cũng dùng cho canonical URL (ví dụ:

Disallow: /.php$:- Nếu URL canonical vẫn là dạng

/product.php, rule này sẽ chặn toàn bộ product.

- Nếu URL canonical vẫn là dạng

Disallow: /sort=,Disallow: /filter=:- Nếu cấu trúc URL phức tạp, có thể match cả URL quan trọng có tham số khác.

Cách hệ thống auto-audit phân tích wildcard:

- Parse và biên dịch rule wildcard:

- Chuyển mỗi rule Disallow/Allow có wildcard thành biểu thức match (regex hoặc pattern engine tối ưu).

- Lưu thông tin:

- Rule gốc (string).

- Pattern đã biên dịch.

- Độ ưu tiên (theo thứ tự xuất hiện và độ cụ thể).

- Mô phỏng pattern URL bị ảnh hưởng:

- Áp dụng pattern lên:

- Danh sách URL trong sitemap.

- Danh sách URL thu được từ crawl nội bộ.

- Đếm:

- Số URL indexable (không noindex, có canonical tự thân) bị match bởi wildcard Disallow.

- Tỷ lệ % URL quan trọng (product, category, blog, landing) trong tập bị match.

- Áp dụng pattern lên:

- Đánh giá mức độ nghiêm trọng:

- Nếu:

- Tỷ lệ URL indexable bị match > một ngưỡng (ví dụ 5–10%), hoặc

- Có nhiều money page, category, product, blog chính bị match,

- Nếu chỉ match URL parameter, filter, sort, search → có thể gắn nhãn info/warning.

- Nếu:

Đề xuất tối ưu rule wildcard:

- Tách rule chi tiết hơn:

- Thay vì:

Disallow: /?

- Có thể:

Disallow: /?sort=Disallow: /?filter=Allow: /?page=nếu pagination cần crawl.

- Mục tiêu: chỉ block các pattern thực sự gây duplicate/faceted, không block canonical.

- Thay vì:

- Thêm Allow cho path cần giữ:

- Nếu buộc phải giữ wildcard rộng, có thể:

- Giữ

Disallow: /.php$nhưng thêm:Allow: /product/.php$cho product canonical.

- Giữ

- Đảm bảo thứ tự rule để Allow cụ thể hơn được ưu tiên.

- Nếu buộc phải giữ wildcard rộng, có thể:

- Giảm orphan URL do robots block:

- Sau khi tối ưu wildcard, chạy lại crawl nội bộ:

- Kiểm tra các URL trước đây bị block nay đã crawlable.

- Đảm bảo các URL có internal link quan trọng không còn ở trạng thái “orphan vì robots”.

- Sau khi tối ưu wildcard, chạy lại crawl nội bộ:

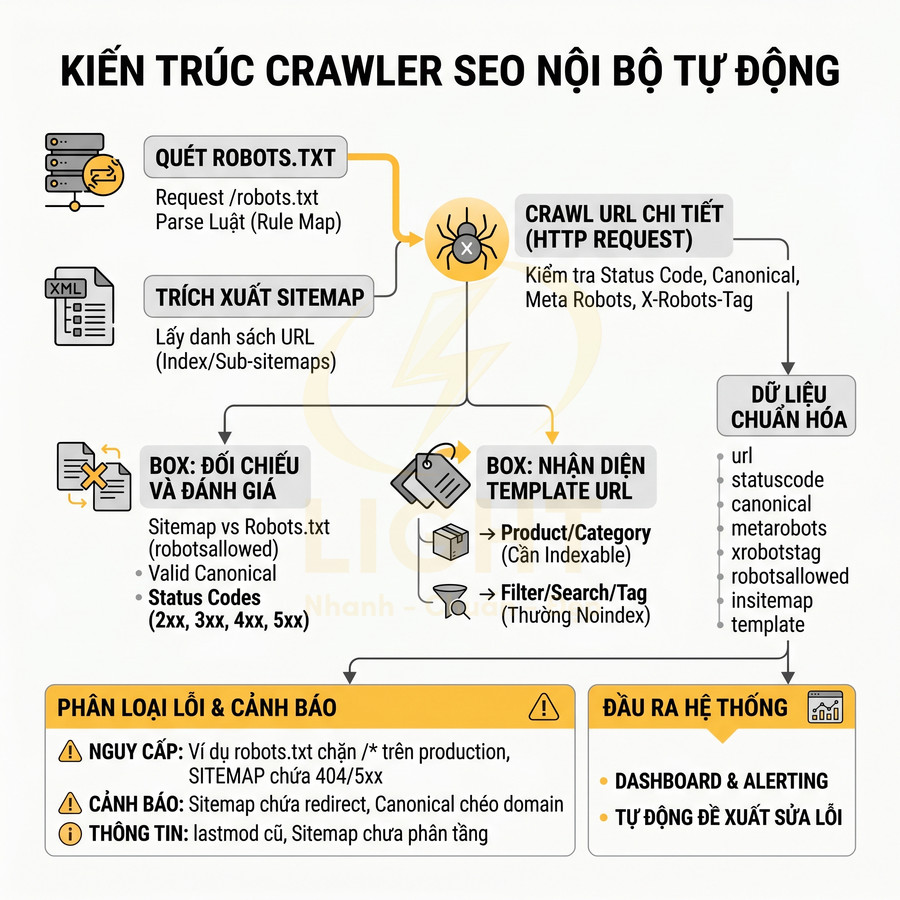

Thiết kế tính năng crawler tự động kiểm tra sitemap và robots.txt toàn website

Crawler nội bộ cần được thiết kế như một pipeline thống nhất, trong đó robots.txt và sitemap đóng vai trò lớp điều hướng trung tâm cho toàn bộ quá trình thu thập và đánh giá URL. Hệ thống phải mô phỏng hành vi search bot: ưu tiên đọc robots.txt, xây dựng rule map chi tiết, sau đó crawl sitemap để lấy danh sách URL, metadata và mối quan hệ cấu trúc. Trên tập URL này, crawler tiến hành HTTP crawl, ghi nhận status code, canonical, meta robots, X-Robots-Tag và tính toán mức độ indexability. Dữ liệu được lưu chuẩn hóa theo từng trường, cho phép phân tích sâu, xây dựng dashboard, cảnh báo và tự động đề xuất sửa lỗi. Toàn bộ kiến trúc cần hỗ trợ mở rộng, cache rule theo domain và tích hợp với các module phân loại lỗi, nhận diện template URL.

Crawl robots.txt trước để build rule map rồi đối chiếu với sitemap URL list

Một crawler SEO nội bộ ở mức production cần mô phỏng tương đối chính xác hành vi của Googlebot và các search bot phổ biến: luôn request và phân tích robots.txt trước, sau đó mới tiến hành crawl sitemap và từng URL. Việc này không chỉ là “best practice” mà còn là nền tảng để phát hiện các xung đột cấu hình (configuration conflicts) giữa file robots.txt, sitemap và trạng thái index thực tế của URL.

Quy trình crawler chi tiết có thể thiết kế theo pipeline sau:

- Bước 1: Gửi request đến

/robots.txt- Sử dụng HTTP GET, có timeout và retry policy rõ ràng (ví dụ: 3 lần retry, exponential backoff) để tránh đánh dấu nhầm là “robots.txt không tồn tại”.

- Ghi log đầy đủ: status code, response time, response size, IP, user-agent được sử dụng.

- Nếu status code là 5xx hoặc timeout, có thể áp dụng fallback rule (ví dụ: tạm coi là cho phép crawl toàn bộ, nhưng gắn cờ warning để SEO review).

- Bước 2: Parse toàn bộ directive theo từng User-agent và build rule map

- Parser cần hỗ trợ:

- Các directive chuẩn:

User-agent,Disallow,Allow,Crawl-delay,Sitemap. - Pattern matching với wildcard

và ký tự kết thúc$theo chuẩn Google. - Nhiều block

User-agentkhác nhau, ưu tiên block khớp chính xác với bot đang mô phỏng (ví dụ: Googlebot) hơn block.

- Các directive chuẩn:

- Build rule map dạng cấu trúc:

- Danh sách rule

AllowvàDisallowđã chuẩn hóa (normalize) path: lowercase nếu cần, remove trailing slash, decode URL. - Logic ưu tiên: rule có pattern dài hơn (specific hơn) được ưu tiên; nếu độ dài bằng nhau thì

AllowoverrideDisallowtheo cách Google xử lý. - Lưu thêm

crawldelaynếu có, để scheduler điều chỉnh tốc độ crawl.

- Danh sách rule

- Parser cần hỗ trợ:

- Bước 3: Tìm dòng

Sitemap:trong robots.txt- Extract tất cả URL sitemap được khai báo: có thể là sitemap index hoặc sitemap con.

- Chuẩn hóa URL sitemap (resolve relative URL nếu có, đảm bảo đúng scheme http/https, đúng host).

- Nếu không có dòng

Sitemap:, gắn cờ warning và cho phép cấu hình thêm danh sách sitemap thủ công trong hệ thống.

- Bước 4: Crawl từng sitemap, lấy danh sách URL, lastmod, hreflang…

- Hỗ trợ các loại sitemap:

sitemapindex: chứa danh sách sitemap con.urlset: chứa các thẻ<url>với<loc>,<lastmod>,<changefreq>,<priority>.- Các extension: image, video, news nếu website có sử dụng.

- Parser cần:

- Validate XML, handle namespace, handle gzip (

.xml.gz). - Giới hạn số lượng URL tối đa mỗi sitemap (theo chuẩn 50.000 URL) và phát hiện khi vượt ngưỡng.

- Lưu mapping: URL thuộc sitemap nào, sitemap index nào để phục vụ phân tích cấu trúc.

- Validate XML, handle namespace, handle gzip (

- Hỗ trợ các loại sitemap:

- Bước 5: Đối chiếu từng URL với rule map để xác định crawl permission

- Với mỗi URL trong sitemap:

- Chuẩn hóa path (path normalization) rồi chạy qua engine match rule robots.txt.

- Xác định robotsallowed = True/False dựa trên rule có độ ưu tiên cao nhất.

- Nếu URL bị Disallow nhưng vẫn xuất hiện trong sitemap, gắn cờ lỗi ở mức phù hợp (thường là critical hoặc warning tùy template).

- Rule map nên được cache theo domain/host để tái sử dụng cho các batch crawl tiếp theo, giảm số lần request robots.txt.

- Với mỗi URL trong sitemap:

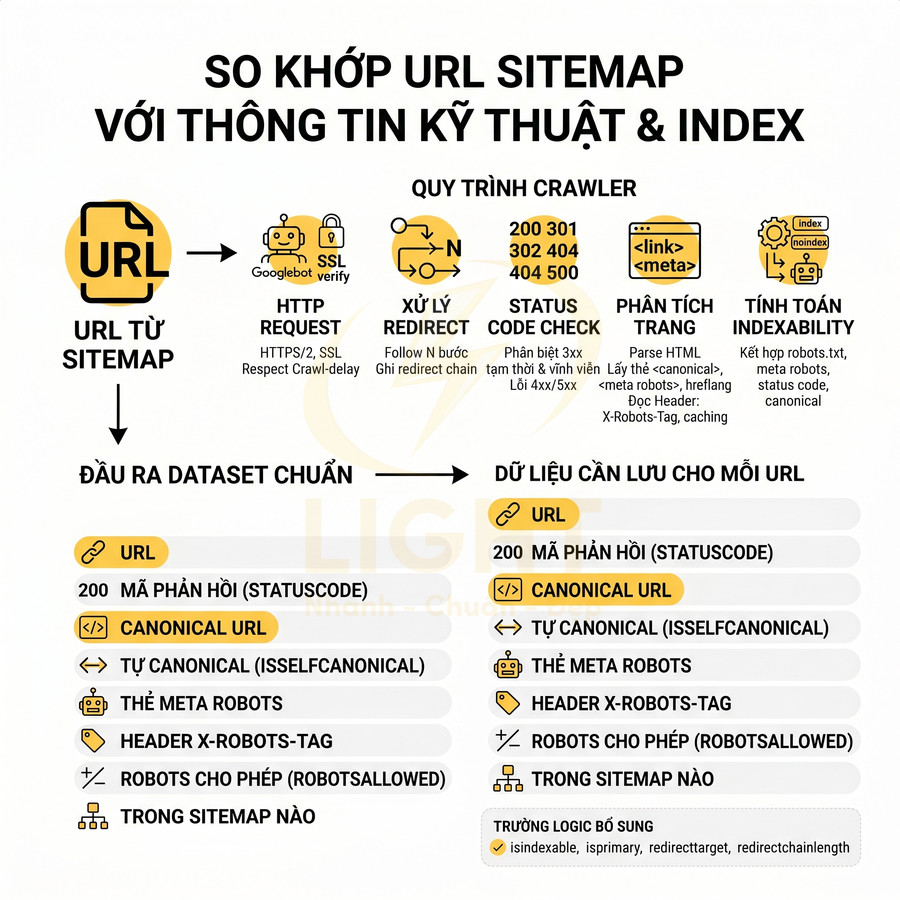

So khớp URL trong sitemap với status code, canonical, indexability và crawl permission

Sau khi có danh sách URL từ sitemap và rule map từ robots.txt, crawler cần thực hiện HTTP crawl chi tiết cho từng URL để đánh giá tình trạng kỹ thuật và khả năng index. Mục tiêu là xây dựng một dataset chuẩn, có thể dùng cho dashboard, alerting và auto-fix.

Quy trình kiểm tra từng URL nên bao gồm:

- Gửi HTTP request với user-agent mô phỏng Googlebot, hỗ trợ:

- Follow redirect tối đa N bước (ví dụ: 5 hops) và ghi lại toàn bộ redirect chain.

- Hỗ trợ HTTP/2, HTTPS, SNI, và verify SSL (ghi log nếu có lỗi chứng chỉ).

- Respect

Crawl-delayvà rate limit để tránh gây overload server.

- Ghi nhận statuscode cuối cùng sau redirect:

- Phân biệt rõ 3xx tạm thời (302, 307) và vĩnh viễn (301, 308) để đánh giá chất lượng sitemap.

- Đánh dấu 4xx, 5xx là lỗi kỹ thuật; 410 có thể là intentional removal.

- Parse HTML (nếu là trang HTML) để lấy:

- Thẻ

<link rel="canonical">và chuẩn hóa URL canonical. - Thẻ

<meta name="robots">để xác định index, noindex, follow, nofollow. - Các thẻ

hreflangnếu cần đối chiếu với sitemap hreflang.

- Thẻ

- Đọc header HTTP:

X-Robots-Tagở level header (có thể áp dụng cho HTML, PDF, file media).- Các header liên quan caching, content-type để phát hiện misconfiguration.

- Tính toán indexability dựa trên:

- robots.txt (robotsallowed).

- meta robots và X-Robots-Tag (noindex, nofollow, none…).

- status code (2xx indexable, 3xx/4xx/5xx non-indexable theo logic SEO).

- Canonical: nếu canonical trỏ sang URL khác, URL hiện tại thường không được coi là primary index target.

Các trường dữ liệu nên lưu cho mỗi URL:

| Trường | Mô tả |

|---|---|

| url | Đường dẫn đầy đủ của trang |

| statuscode | 200, 301, 302, 404, 410, 500… |

| canonical | Giá trị thẻ rel="canonical" |

| isselfcanonical | Canonical có trùng với URL hay không |

| metarobots | index, noindex, follow, nofollow… |

| xrobotstag | Header X-Robots-Tag nếu có |

| robotsallowed | True/False dựa trên rule map robots.txt |

| insitemap | Thuộc sitemap nào, sitemap index nào |

Có thể bổ sung trong hệ thống (không thêm cột trong bảng) các field logic như: isindexable, isprimary (URL tự canonical, indexable, 200), redirecttarget, redirectchainlength để phục vụ phân tích chuyên sâu.

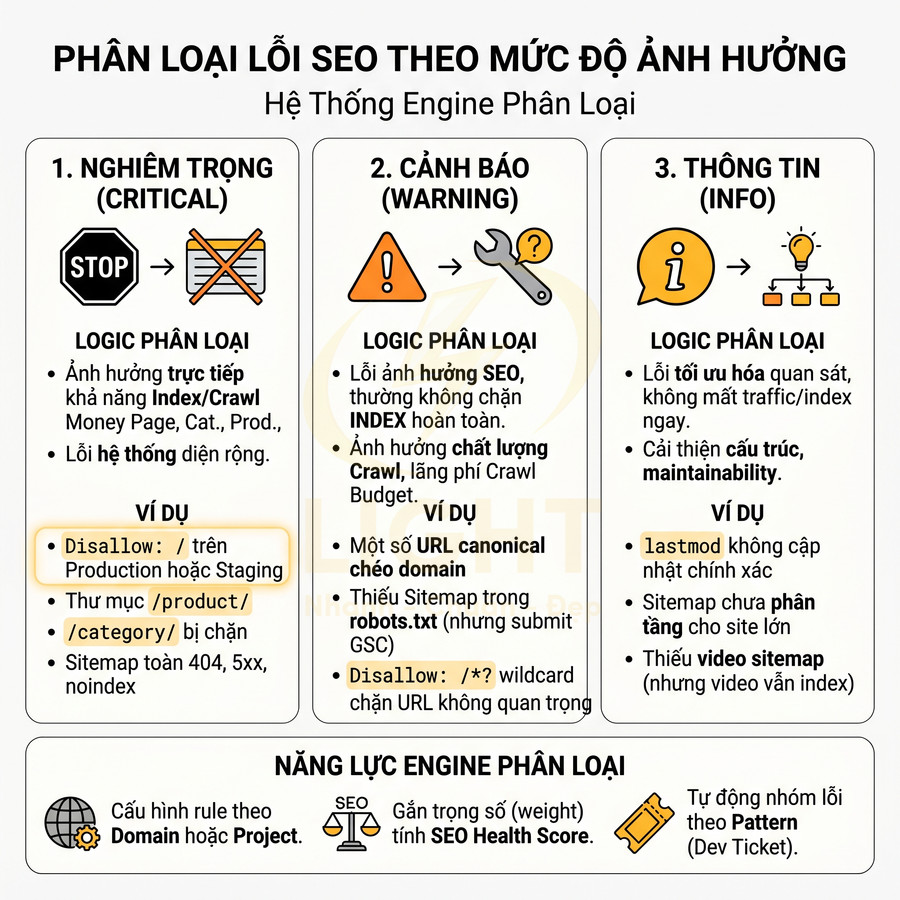

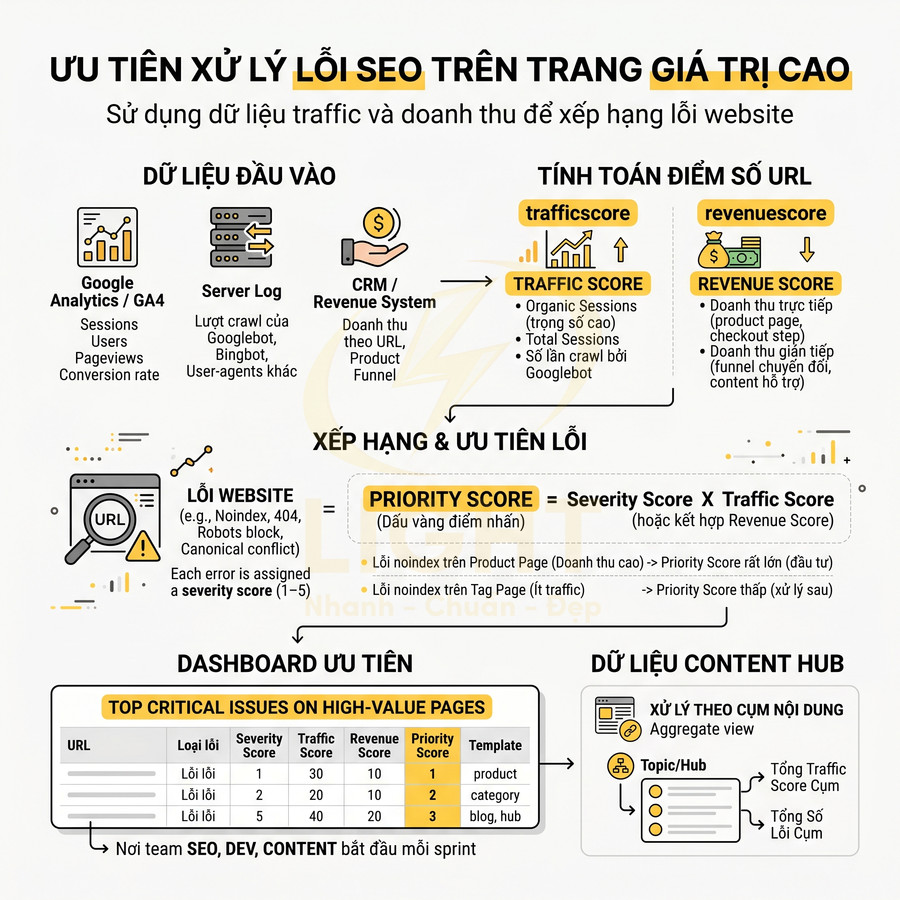

Phân loại lỗi critical, warning, info theo mức độ ảnh hưởng SEO

Hệ thống cần một error classification engine để gán mức độ ưu tiên xử lý cho từng issue. Việc phân loại không nên chỉ dựa trên loại lỗi, mà còn phải xét đến vai trò của URL (template), traffic tiềm năng và mức độ lan rộng (số lượng URL bị ảnh hưởng).

Các nguyên tắc phân loại:

- Critical khi:

- Ảnh hưởng trực tiếp đến khả năng index hoặc crawl của money page, category chính, product quan trọng.

- Lỗi mang tính hệ thống, ảnh hưởng diện rộng (nhiều URL hoặc cả site).

- Ví dụ:

- robots.txt chứa

Disallow: /trên production hoặc staging bị trỏ nhầm. - Các thư mục

/product/,/category/,/blog/bị Disallow trong robots.txt. - Sitemap chứa số lượng lớn URL 404, 5xx, hoặc toàn bộ URL trong sitemap đều noindex.

- Canonical của product page trỏ sang domain khác không kiểm soát.

- robots.txt chứa

- Warning khi:

- Lỗi có thể ảnh hưởng SEO nhưng thường không chặn index hoàn toàn.

- Ảnh hưởng đến chất lượng crawl, phân bổ tín hiệu, hoặc gây lãng phí crawl budget.

- Ví dụ:

- Một số URL canonical chéo domain trong sitemap (không phải toàn bộ).

- Thiếu dòng

Sitemaptrong robots.txt nhưng sitemap vẫn được submit trong Search Console. - Wildcard Disallow rộng (ví dụ:

Disallow: /*?) nhưng hiện tại chưa chặn nhiều URL quan trọng. - Sitemap chứa nhiều URL redirect 301 nhưng vẫn dẫn về đúng đích.

- Info khi:

- Lỗi hoặc observation mang tính tối ưu hóa, không gây mất index hay traffic ngay lập tức.

- Thường dùng để gợi ý cải thiện cấu trúc, maintainability.

- Ví dụ:

lastmodkhông cập nhật chính xác, luôn để một giá trị cũ.- Sitemap chưa phân tầng tối ưu cho site lớn (quá nhiều URL trong một file, không chia theo type).

- Thiếu video sitemap cho site có nhiều video, trong khi video vẫn có thể được index qua trang HTML.

Engine phân loại nên cho phép:

- Cấu hình rule theo domain hoặc project (vì mỗi business có “money page” khác nhau).

- Gắn trọng số (weight) cho từng loại lỗi để tính ra SEO health score tổng thể.

- Tự động nhóm lỗi theo pattern (ví dụ: tất cả URL 404 trong sitemap thuộc /blog/) để tạo ticket cho Dev/SEO.

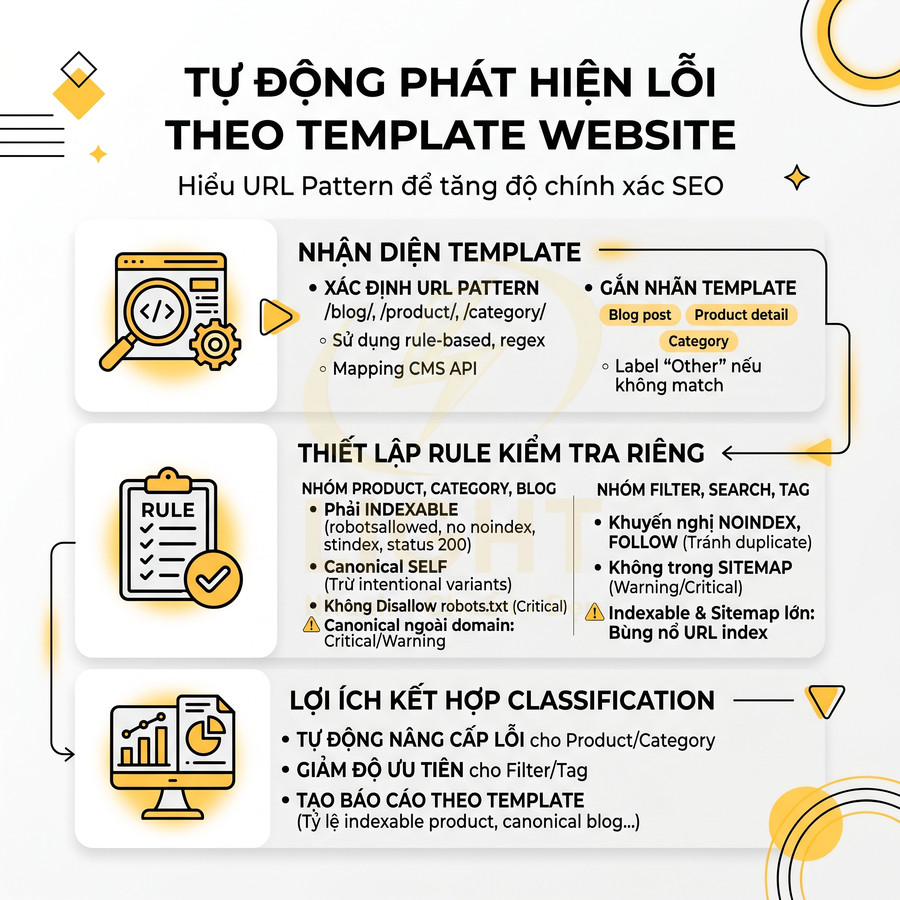

Tự động phát hiện lỗi theo template: blog, category, product, filter, tag page

Để tăng độ chính xác và tính “business-aware”, hệ thống cần hiểu template URL của website. Mỗi template (blog post, category, product, filter, tag, landing page…) có vai trò SEO và kỳ vọng index khác nhau, do đó rule kiểm tra và mức độ ưu tiên cũng phải khác nhau.

Cách triển khai chi tiết:

- Xác định pattern URL cho từng template

- Sử dụng rule-based pattern:

/blog/hoặc/news/→ blog post hoặc listing./category/,/c/→ category./product/,/p/→ product detail./tag/,/topic/→ tag page./search/, URL có query?q=→ search/filter.

- Có thể kết hợp:

- Regex pattern để nhận diện cấu trúc phức tạp.

- Mapping từ CMS (nếu có API) để biết loại template chính xác.

- Sử dụng rule-based pattern:

- Gắn nhãn template cho mỗi URL

- Trong quá trình import từ sitemap và crawl nội bộ, mỗi URL được assign một hoặc nhiều label template.

- Nếu không match rule nào, gắn nhãn “other” hoặc “landing” để xử lý riêng.

- Lưu template như một field trong database để dùng cho:

- Filter trong dashboard (xem riêng product, category…).

- Áp dụng rule kiểm tra khác nhau theo template.

- Thiết lập rule kiểm tra riêng cho từng template

- Product, category, blog:

- Phải indexable trong hầu hết trường hợp:

robotsallowed = True.metarobotskhông chứanoindex,X-Robots-Tagkhông chặn index.- Status code 200, không redirect vòng lặp.

- Canonical nên self:

isself_canonical = Truetrừ các case intentional (ví dụ: variant product canonical về main product).- Nếu canonical trỏ sang domain khác, gắn critical cho product/category; với blog có thể là warning.

- Không nên bị Disallow trong robots.txt; nếu bị, đánh dấu critical.

- Phải indexable trong hầu hết trường hợp:

- Filter, search, tag:

- Thường được khuyến nghị:

noindex, followđể tránh duplicate content và lãng phí crawl budget.- Không xuất hiện trong sitemap (nếu có, gắn warning hoặc critical tùy chiến lược SEO).

- Nếu filter page lại indexable và nằm trong sitemap với số lượng lớn, hệ thống nên:

- Gắn warning về nguy cơ bùng nổ số lượng URL index.

- Đề xuất rule noindex hoặc canonical consolidation.

- Thường được khuyến nghị:

- Landing page / other:

- Có thể indexable hoặc không tùy chiến dịch; hệ thống cho phép override rule theo tag hoặc folder.

- Nếu là landing chạy ads nhưng noindex, có thể chỉ gắn info (không phải lỗi SEO organic).

- Product, category, blog:

Khi kết hợp template với classification engine, hệ thống có thể:

- Tự động nâng mức độ lỗi (escalate) cho các issue xảy ra trên product/category.

- Giảm độ ưu tiên cho lỗi tương tự trên filter/search/tag page.

- Tạo báo cáo theo template: tỷ lệ indexable product, tỷ lệ category bị noindex, số blog post canonical chéo domain… phục vụ quyết định chiến lược SEO.

Logic tự động sửa sitemap XML và robots.txt theo chuẩn technical SEO

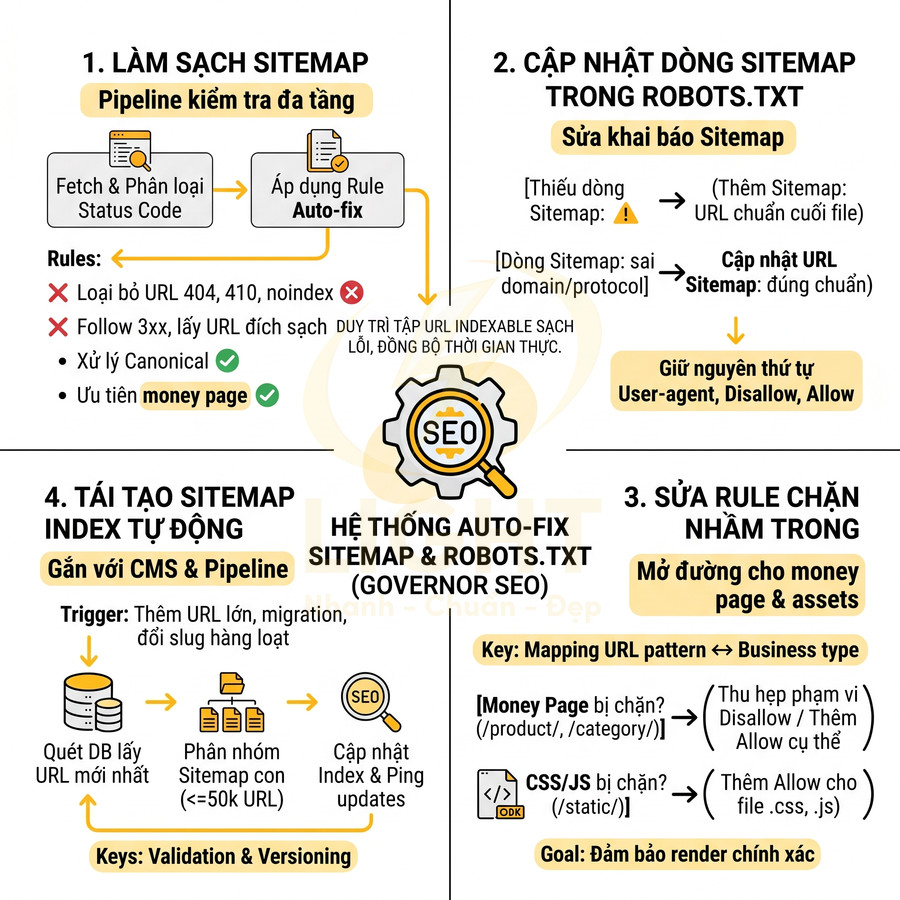

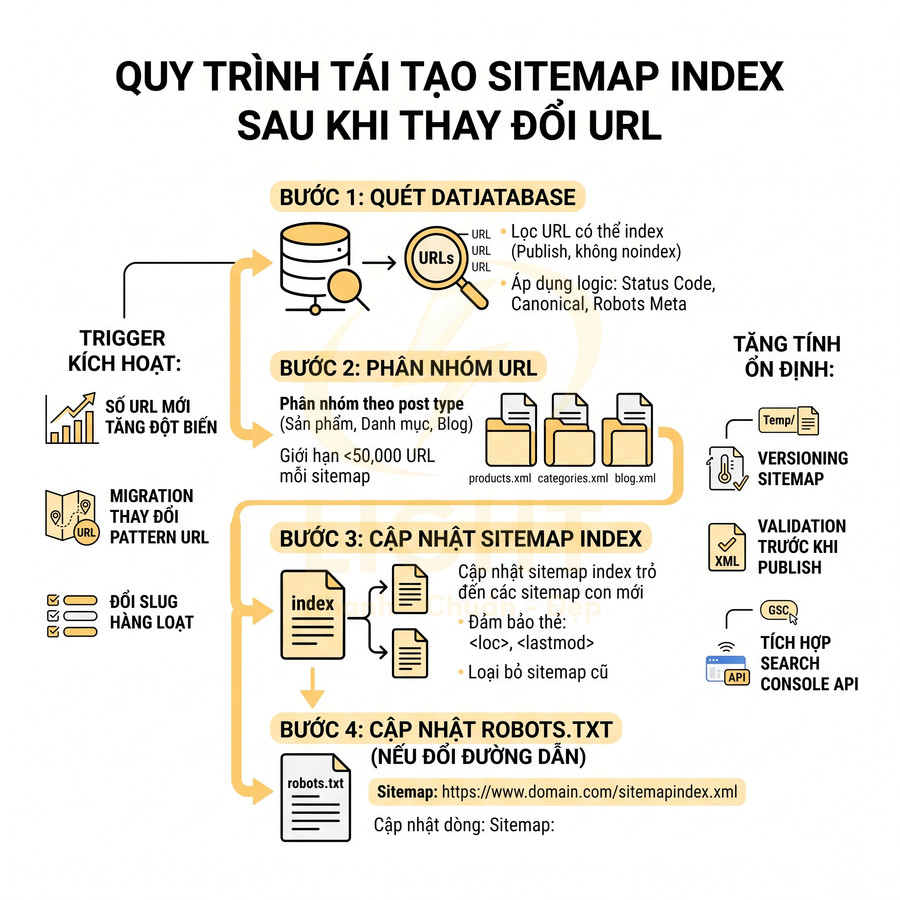

Hệ thống auto-fix cần vận hành như một lớp “governor” kỹ thuật, liên tục đồng bộ giữa trạng thái thực tế của URL và các file điều hướng bot như sitemap XML, robots.txt. Trọng tâm là duy trì một tập URL luôn indexable, sạch lỗi và phản ánh đúng cấu trúc thông tin của website. Ở tầng sitemap, logic đa bước giúp loại bỏ URL 404, redirect, noindex, xử lý canonical và soft 404, đồng thời ưu tiên money page để tối ưu crawl budget. Ở tầng robots.txt, cơ chế phân tích – sửa rule đảm bảo bot luôn tìm được sitemap đúng domain/protocol, không chặn nhầm thư mục quan trọng hoặc static asset phục vụ render. Cuối cùng, quá trình regenerate sitemap index được gắn chặt với CMS và pipeline deploy, kích hoạt theo event (migration, đổi slug, thêm URL lớn) và luôn đi kèm bước validation, versioning để giảm rủi ro kỹ thuật.

Tự động loại URL lỗi khỏi sitemap khi gặp 404, redirect hoặc noindex

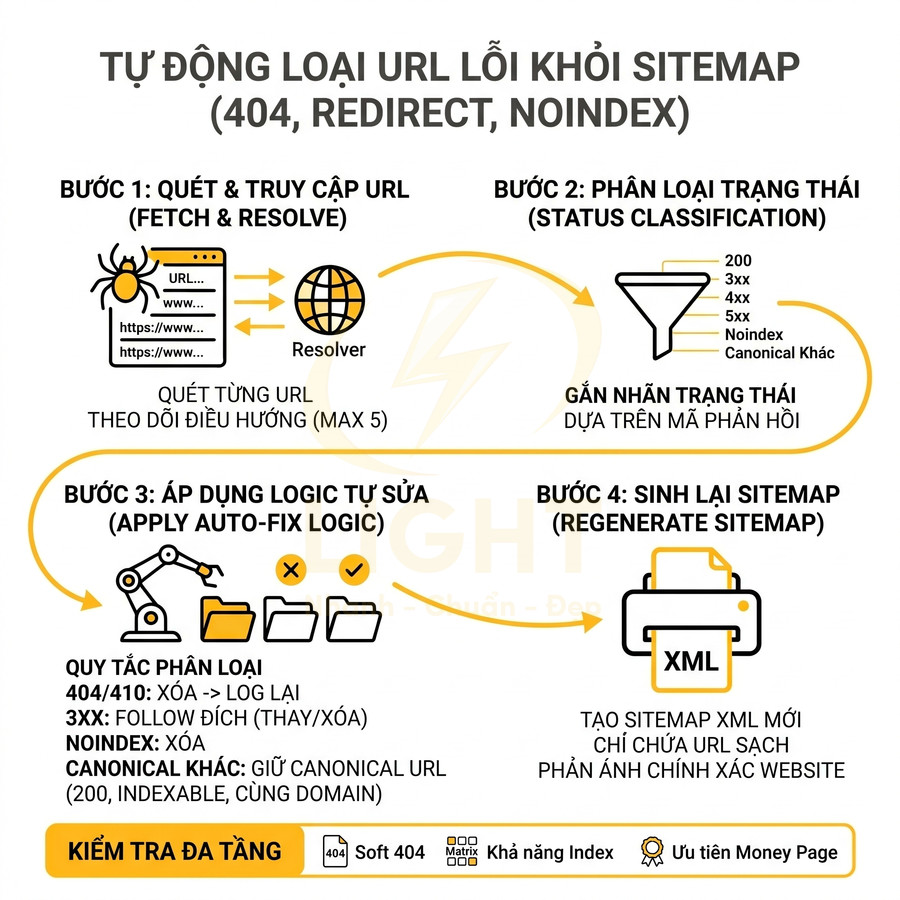

Auto-fix sitemap trong môi trường technical SEO hiện đại không chỉ dừng ở việc xóa URL lỗi một cách cơ học, mà cần một lớp logic kiểm tra đa tầng để đảm bảo sitemap luôn phản ánh chính xác tập URL indexable của website. Mục tiêu là: mọi URL trong sitemap phải có khả năng được crawl, index và mang lại giá trị organic traffic.

Quy trình crawl & đánh giá URL trong sitemap có thể triển khai theo pipeline:

- Bước 1 – Fetch & resolve: Hệ thống crawler gửi request đến từng URL trong sitemap, follow redirect tối đa N hop (thường 5) để xác định final destination và status code cuối cùng.

- Bước 2 – Phân loại trạng thái: Gắn nhãn cho từng URL: 200 indexable, 200 non-indexable (noindex, canonical khác), 3xx, 4xx, 5xx, soft 404, v.v.

- Bước 3 – Áp logic auto-fix: Quyết định giữ, thay thế hay xóa URL khỏi sitemap dựa trên tập rule chuẩn.

- Bước 4 – Regenerate sitemap: Sinh lại file sitemap XML (hoặc sitemap con) từ danh sách URL đã được làm sạch.

Logic cơ bản có thể mở rộng thành bộ rule chi tiết hơn:

- Nếu statuscode = 404/410:

- Xóa URL khỏi sitemap vì đây là URL không còn tồn tại hoặc đã bị khai tử vĩnh viễn.

- Có thể log lại vào bảng orphan/removedurls để phục vụ báo cáo SEO và kiểm tra internal link trỏ về URL này.

- Nếu statuscode = 3xx:

- Follow toàn bộ chuỗi redirect cho đến khi gặp status 200, 4xx hoặc 5xx.

- Nếu final URL = 200 và:

- Không có meta robots = noindex, không bị chặn bởi X-Robots-Tag.

- Canonical trỏ về chính nó (self-canonical) hoặc canonical khác nhưng vẫn là URL indexable mong muốn.

- Thay URL cũ trong sitemap bằng final destination URL để giảm lãng phí crawl budget và tránh redirect chain.

- Nếu final URL là 4xx/5xx hoặc noindex → xóa URL gốc khỏi sitemap, không thêm final URL.

- Nếu metarobots = noindex hoặc X-Robots-Tag = noindex:

- Xóa URL khỏi sitemap vì sitemap chỉ nên chứa URL có khả năng index.

- Trong hệ thống CMS, có thể sync trạng thái: khi editor bật noindex, URL tự động bị loại khỏi sitemap trong lần regenerate kế tiếp.

- Nếu canonical != URL:

- Đọc thẻ

<link rel="canonical">hoặc headerLink: <...>; rel="canonical". - Nếu canonical:

- Trỏ đến một URL 200, indexable.

- Thuộc cùng domain hoặc subdomain được quản lý trong cùng property SEO.

- Cân nhắc chỉ giữ canonical URL trong sitemap, loại bỏ URL hiện tại để tránh duplicate content và tín hiệu mâu thuẫn.

- Trong trường hợp canonical cross-domain (ví dụ canonical sang domain khác), không nên thêm canonical đó vào sitemap của domain hiện tại.

- Đọc thẻ

Để tăng độ chính xác, hệ thống có thể bổ sung thêm các lớp kiểm tra:

- Soft 404 detection: URL trả về 200 nhưng nội dung là trang lỗi (template 404, thông báo “product not found”). Những URL này nên được đánh dấu soft 404 và loại khỏi sitemap.

- Indexability matrix: Kết hợp:

- HTTP status

- Robots meta / X-Robots-Tag

- Robots.txt (bị Disallow hay không)

- Canonical

- Priority cho URL money page: Với các URL thuộc nhóm money page (product, category, landing page), có thể cấu hình rule chặt hơn: nếu phát hiện redirect tạm thời (302/307) kéo dài, gợi ý chuyển sang 301 trước khi cập nhật sitemap.

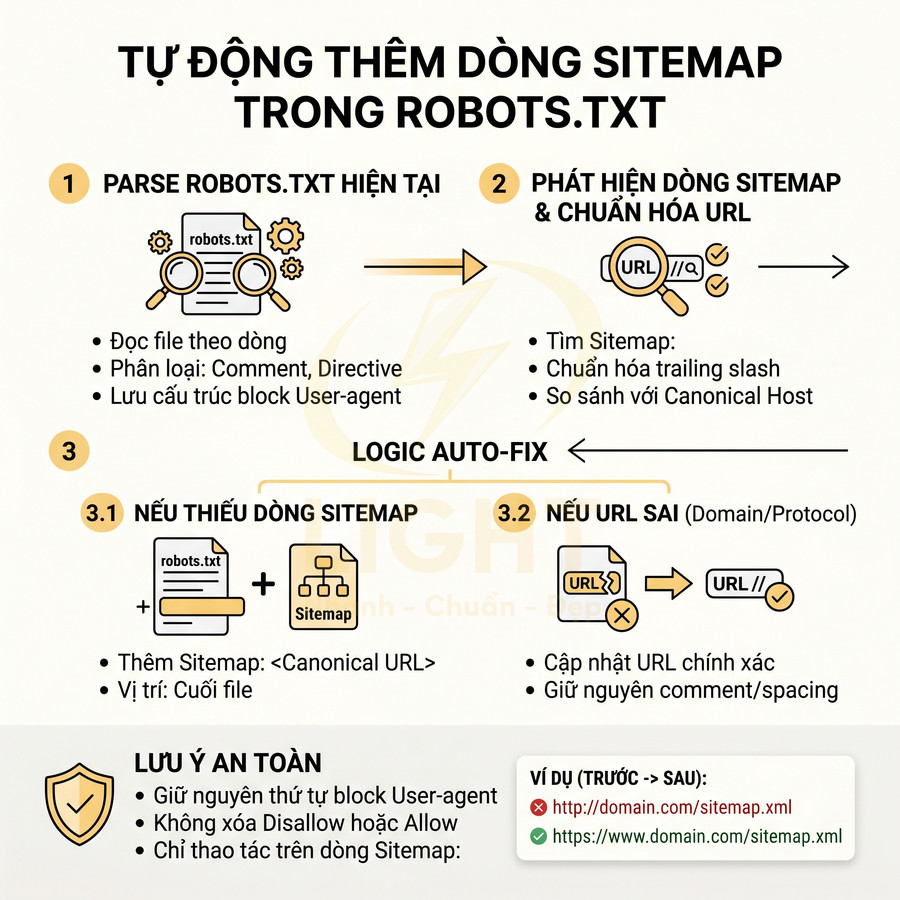

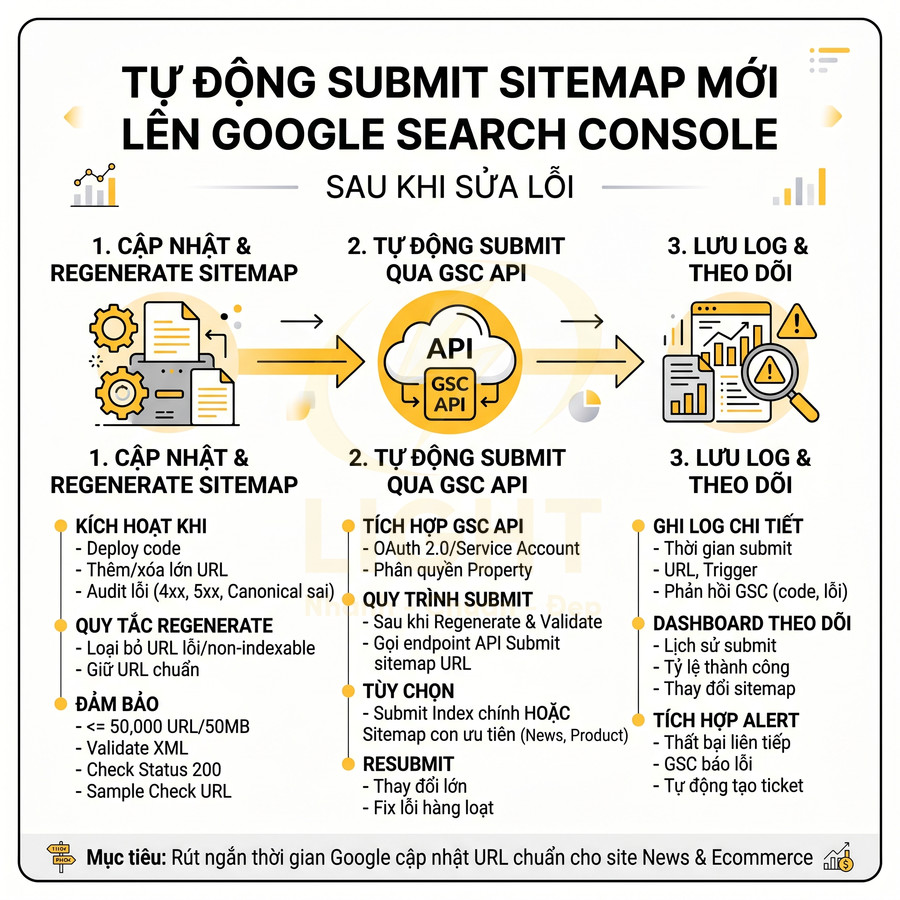

Tự động thêm dòng Sitemap trong robots.txt nếu thiếu hoặc sai domain

Robots.txt là entry point quan trọng để bot tìm đến sitemap. Một dòng khai báo sai protocol (http thay vì https), sai subdomain (non-www vs www) hoặc thiếu hoàn toàn có thể làm giảm hiệu quả crawl. Auto-fix cần thao tác trên robots.txt một cách an toàn, không phá vỡ rule hiện có.

Quy trình xử lý có thể thiết kế như sau:

- Parse robots.txt hiện tại:

- Đọc file theo dòng, phân loại:

- Comment (

# ...) - Directive (

User-agent,Disallow,Allow,Crawl-delay,Sitemap, v.v.)

- Comment (

- Lưu lại cấu trúc block theo từng

User-agentđể không làm thay đổi logic ưu tiên.

- Đọc file theo dòng, phân loại:

- Phát hiện dòng Sitemap:

- Tìm tất cả dòng bắt đầu bằng

Sitemap:(không phân biệt hoa thường). - Chuẩn hóa URL: trim khoảng trắng, chuẩn hóa trailing slash, decode nếu cần.

- So sánh với domain/protocol chuẩn của site (ví dụ: https://www.domain.com là canonical host).

- Tìm tất cả dòng bắt đầu bằng

- Logic auto-fix:

- Nếu không có dòng Sitemap:

- Giữ nguyên toàn bộ block

User-agent,Disallow,Allow, comment. - Thêm một hoặc nhiều dòng:

- Sitemap: https://www.domain.com/sitemap.xml

- Vị trí thêm thường là cuối file để tránh ảnh hưởng đến logic đọc rule của bot.

- Giữ nguyên toàn bộ block

- Nếu có Sitemap nhưng sai domain/protocol:

- Ví dụ:

Sitemap: http://domain.com/sitemap.xmltrong khi site chạy HTTPS + WWW. - Auto-fix cập nhật lại thành:

- Sitemap: https://www.domain.com/sitemap.xml

- Giữ nguyên comment hoặc spacing xung quanh để giảm rủi ro conflict với hệ thống deploy.

- Ví dụ:

- Nếu site sử dụng nhiều sitemap index:

- Auto-fix có thể thêm nhiều dòng Sitemap tương ứng, ví dụ:

- Sitemap: https://www.domain.com/sitemapindex.xml

- Sitemap: https://www.domain.com/newssitemap.xml

- Không xóa các dòng Sitemap cũ nếu chúng vẫn hợp lệ và đang được sử dụng.

- Auto-fix có thể thêm nhiều dòng Sitemap tương ứng, ví dụ:

- Nếu không có dòng Sitemap: