Hosting ảnh hưởng gì đến website chuẩn SEO? Cách chọn hosting không sai

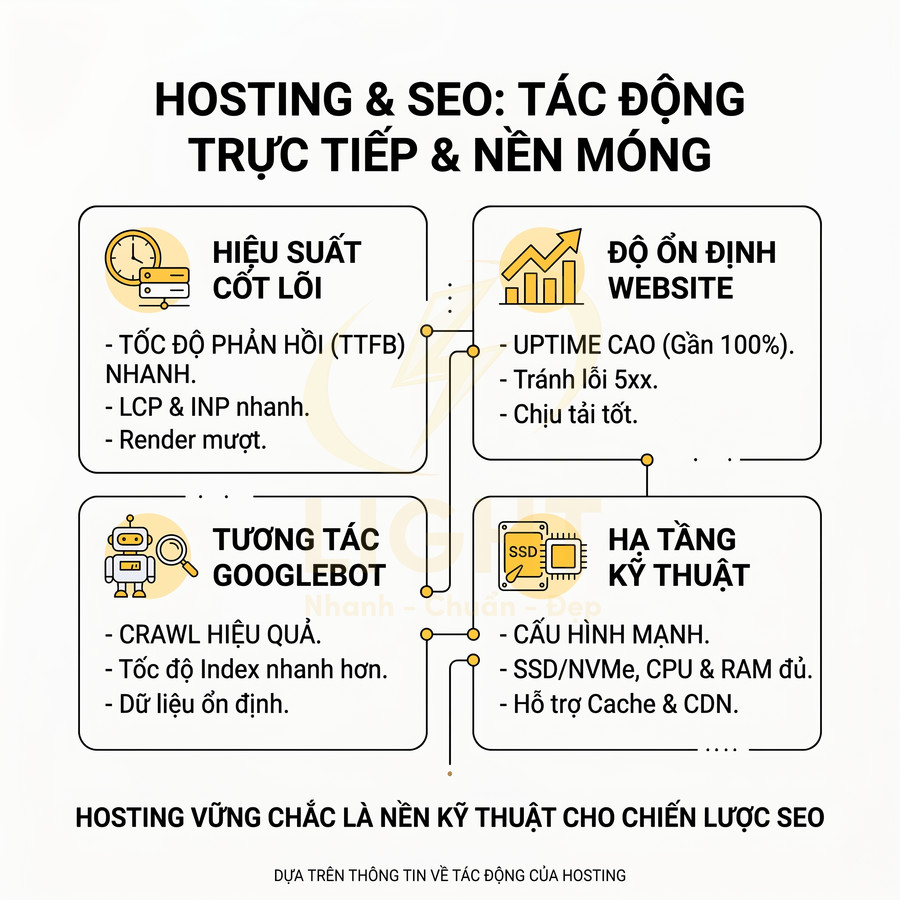

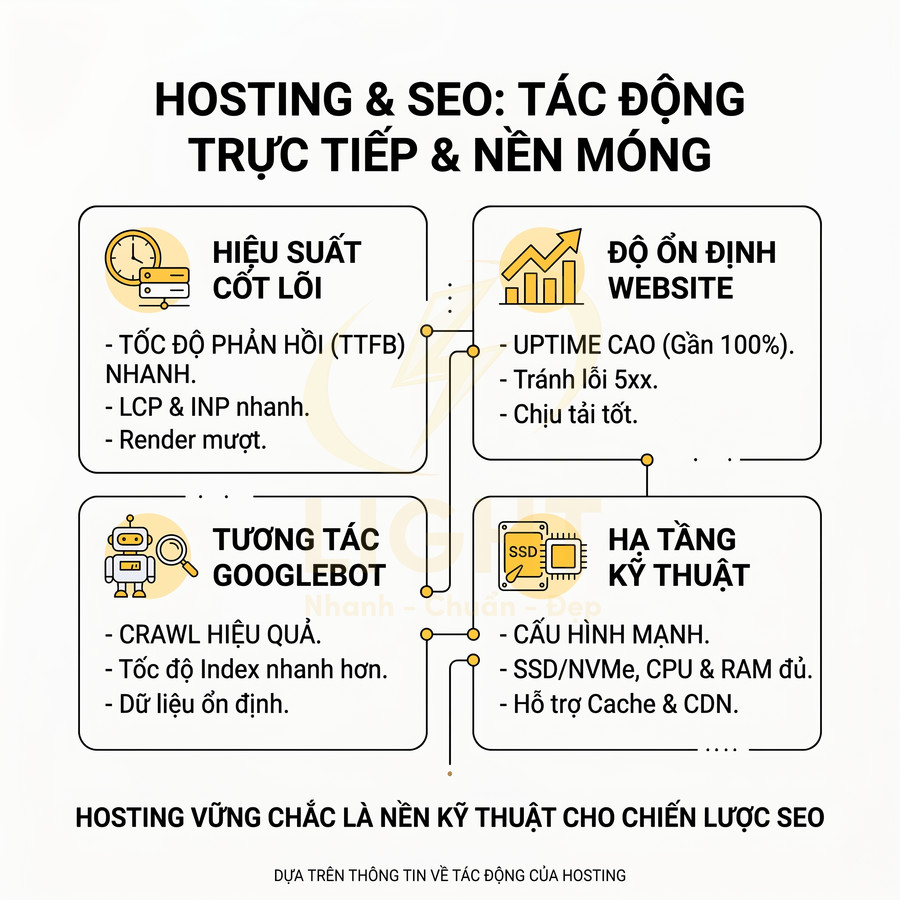

Hosting tác động trực tiếp đến SEO vì nó quyết định tốc độ phản hồi, độ ổn định và khả năng để Googlebot crawl website hiệu quả. Nếu server chậm, TTFB cao, hay thường xuyên lỗi 5xx, Google sẽ giảm tần suất crawl, index chậm hơn và đánh giá website kém ổn định. Chọn đúng hosting nghĩa là ưu tiên hạ tầng có uptime tốt, server gần thị trường mục tiêu, SSD/NVMe, CPU và RAM đủ dùng, hỗ trợ cache, CDN, HTTP/3, backup tự động và khả năng nâng cấp khi traffic tăng. Sai lầm phổ biến là chọn gói rẻ nhưng oversell tài nguyên, khiến web chậm vào giờ cao điểm, ảnh hưởng cả trải nghiệm người dùng lẫn thứ hạng tìm kiếm.

Ở tầng kỹ thuật, hosting là nền móng cho toàn bộ hiệu suất website. Nó chi phối TTFB, server response time, Core Web Vitals như LCP và INP, đồng thời ảnh hưởng trực tiếp đến crawl budget, tốc độ index và sự ổn định của dữ liệu trên Google. Hạ tầng tốt giúp website phản hồi nhanh, render mượt, chịu tải tốt khi có traffic tăng đột biến và giữ trải nghiệm ổn định trên nhiều khu vực địa lý.

Một lựa chọn phù hợp không chỉ nằm ở giá mà ở khả năng vận hành lâu dài: web server tối ưu, cache server-side, Redis, CDN edge caching, SSL, chống downtime, backup và failover. Khi hosting đủ mạnh và ổn định, website có nền kỹ thuật vững để phát huy hiệu quả content, internal link, schema và toàn bộ chiến lược SEO bền vững. Hosting chỉ là một phần của nền tảng SEO kỹ thuật, bên cạnh cấu trúc URL, tốc độ tải, heading, internal link, schema và khả năng index. Khi triển khai thiết kế web chuẩn SEO, các yếu tố này cần được đồng bộ ngay từ đầu để website dễ crawl, dễ hiểu và dễ mở rộng về sau.

Hosting tác động trực tiếp đến tốc độ tải trang, crawl budget và tín hiệu xếp hạng SEO như thế nào

Hosting quyết định trực tiếp “sức khỏe kỹ thuật” của website trong mắt Google lẫn người dùng. Hạ tầng mạnh giúp TTFB và server response time thấp, Googlebot crawl được nhiều URL hơn, đặc biệt ở các tầng sâu, từ đó tối ưu crawl budget và tốc độ index. Ngược lại, server chậm, dao động lớn hoặc thường xuyên lỗi 5xx làm giảm tần suất crawl, khiến dữ liệu index lỗi thời và hạn chế tăng trưởng traffic.

Chất lượng hosting còn chi phối Core Web Vitals như LCP, INP, khả năng render ổn định, thông qua CPU, RAM, I/O, loại ổ đĩa, web server và cơ chế cache. Khi uptime kém, downtime lặp lại, Google giảm trust, chậm index URL mới và ưu tiên các site ổn định hơn, khiến mọi nỗ lực SEO nội dung và liên kết bị suy giảm hiệu quả. Khi chọn hosting cho dự án, cần nhìn xa hơn dung lượng và giá thuê. Hạ tầng máy chủ ảnh hưởng trực tiếp đến tốc độ, bảo mật, khả năng mở rộng và hiệu quả SEO dài hạn. Với các website doanh nghiệp, nền tảng kỹ thuật nên được tính ngay từ giai đoạn làm web để tránh phải tối ưu lại toàn bộ hệ thống sau này.

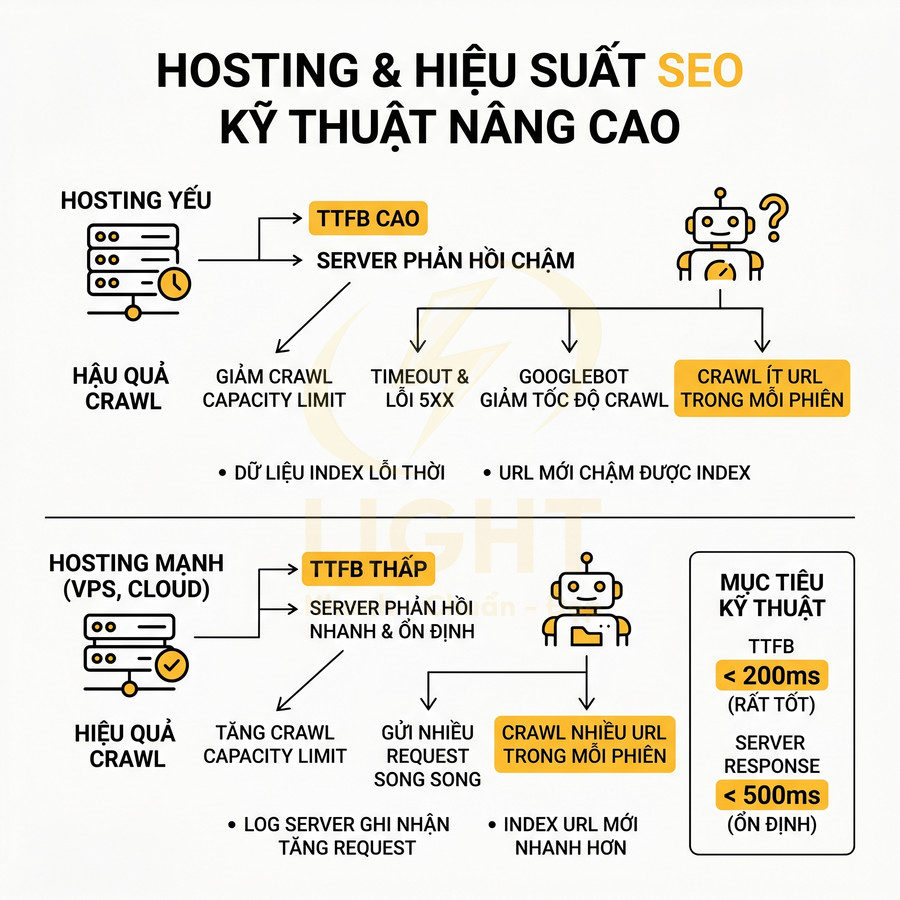

TTFB, server response time và khả năng Googlebot crawl nhiều URL trong mỗi phiên

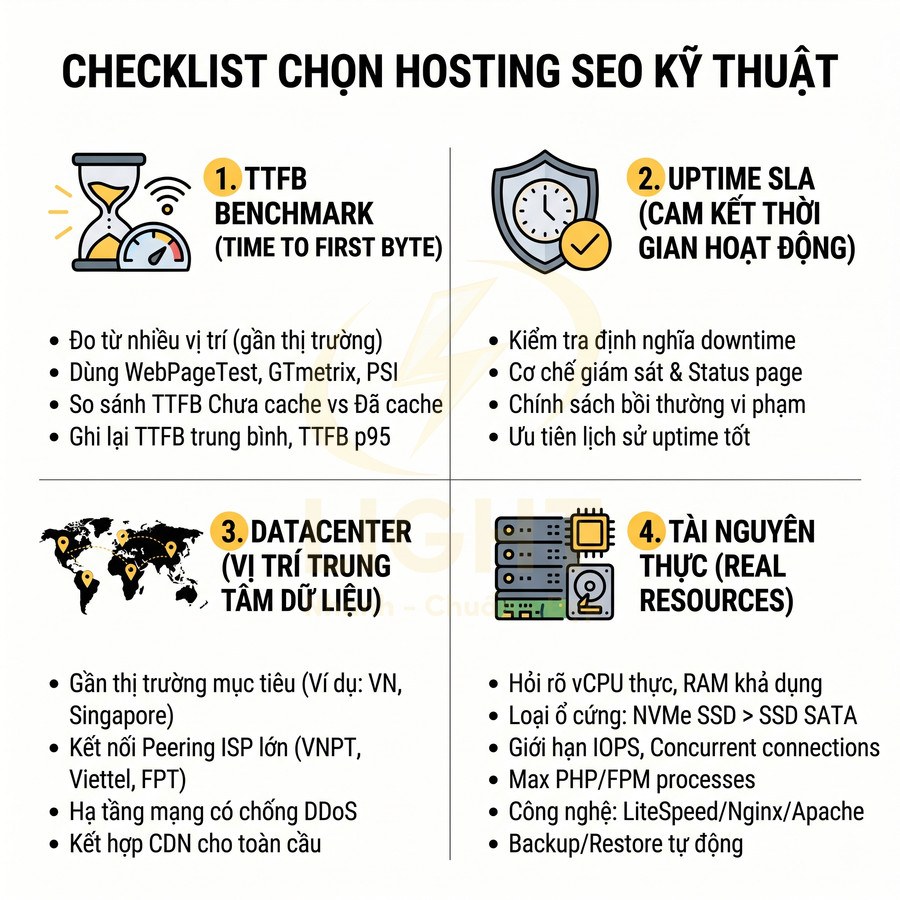

Ở góc độ kỹ thuật SEO nâng cao, hosting chính là lớp hạ tầng quyết định “trần hiệu suất” của toàn bộ website. Mọi tối ưu về code, cache, CDN hay cấu trúc thông tin đều bị giới hạn nếu nền tảng hosting không đủ nhanh và ổn định. Hai chỉ số then chốt phản ánh chất lượng hạ tầng là TTFB (Time To First Byte) và server response time. TTFB đo khoảng thời gian từ lúc trình duyệt hoặc Googlebot gửi HTTP request đến khi nhận được byte dữ liệu đầu tiên từ server, bao gồm: DNS lookup, TCP/TLS handshake, xử lý request ở web server, thực thi code (PHP/Node/… ) và truy vấn database.

Khi TTFB cao, mỗi request của Googlebot bị “đội” thêm vài trăm mili giây đến vài giây, làm giảm đáng kể số URL có thể được crawl trong một phiên. Về mặt crawl budget, Google phân bổ một lượng tài nguyên crawl hữu hạn cho mỗi website, dựa trên hai yếu tố: crawl capacity limit (khả năng chịu tải của server) và crawl demand (nhu cầu crawl dựa trên độ quan trọng và tần suất cập nhật nội dung). Hosting yếu làm crawl capacity limit bị hạ thấp, vì Googlebot nhận thấy server phản hồi chậm, dễ timeout hoặc trả lỗi 5xx, nên chủ động giảm tốc độ crawl để tránh gây quá tải. Về mặt học thuật và thực tiễn SEO, có thể giải thích rõ hơn rằng TTFB cao làm tăng chi phí thời gian cho mỗi lần thu thập dữ liệu, khiến Googlebot khó mở rộng số lượng URL được crawl trong cùng một khoảng thời gian. Google mô tả crawl budget là tổng hợp giữa crawl rate limit và crawl demand; trong đó, nếu website phản hồi nhanh, Googlebot có thể tăng số kết nối dùng để crawl, còn nếu server chậm hoặc trả lỗi 5xx, tốc độ crawl sẽ giảm (Google Search Central, 2017). Vì vậy, hosting có TTFB ổn định không chỉ cải thiện trải nghiệm người dùng, mà còn giúp bot khai thác crawl budget hiệu quả hơn.

Với các website có cấu trúc lớn (hàng nghìn đến hàng trăm nghìn URL), tác động này thể hiện rất rõ trong log server:

- TTFB dao động lớn, đặc biệt trong giờ cao điểm truy cập người dùng.

- Googlebot thường xuyên phải chờ lâu cho các request HTML, dẫn đến giảm số request/phút.

- Các URL sâu trong cấu trúc (category con, tag, sản phẩm cũ) ít được crawl lại, khiến dữ liệu index trở nên “lỗi thời”.

Trong bối cảnh đó, Googlebot có xu hướng:

- Giảm tần suất crawl toàn site khi phát hiện nhiều response time cao hoặc lỗi 5xx liên tiếp.

- Ưu tiên crawl một nhóm nhỏ URL quan trọng (homepage, category chính), bỏ qua hoặc trì hoãn các URL mới, URL cập nhật.

- Giảm tốc độ tăng trưởng số URL được index, dù sitemap và internal link đã được tối ưu.

Ngược lại, khi chuyển sang hosting mạnh hơn (VPS, cloud hosting tối ưu, dedicated server), với CPU, RAM, I/O và network ổn định, TTFB có thể giảm từ 800–1200ms xuống còn 100–300ms. Điều này tạo ra một chuỗi hiệu ứng tích cực:

- Googlebot có thể gửi nhiều request song song hơn mà không làm server quá tải.

- Số lượng URL được crawl trong mỗi phiên tăng lên, đặc biệt ở các tầng URL sâu.

- Log server ghi nhận số request từ Googlebot tăng đều, ít bị “đứt quãng” theo thời gian.

- Thời gian index URL mới rút ngắn, các thay đổi onpage (title, meta, schema, internal link) được phản ánh nhanh hơn trên kết quả tìm kiếm.

Ở mức độ vận hành, việc theo dõi server response time dưới các mức tải khác nhau (giờ thấp điểm, giờ cao điểm, khi chạy chiến dịch quảng cáo) là bắt buộc. Không chỉ giá trị trung bình, mà cả độ ổn định (variance) mới là yếu tố Googlebot “cảm nhận” rõ. Server response time dao động mạnh thường dẫn đến:

- Timeout ở một phần request, tạo ra lỗi 5xx hoặc 504 Gateway Timeout.

- Googlebot tạm thời giảm tốc độ crawl, sau đó mất thời gian để “thử lại” và tăng dần trở lại.

- Crawl budget bị tiêu tốn cho các lần retry, thay vì dùng để khám phá URL mới.

| Chỉ số | Ngưỡng tốt cho SEO | Ảnh hưởng khi vượt ngưỡng |

|---|---|---|

| TTFB | < 200ms (rất tốt), < 500ms (chấp nhận được) | Googlebot crawl ít URL hơn, người dùng rời trang sớm |

| Server response time | Ổn định < 500ms dưới tải bình thường | Dao động lớn gây timeout, lỗi 5xx, giảm crawl budget |

| Crawl requests/phút | Tăng dần theo thời gian, không bị tụt đột ngột | Giảm mạnh khi server yếu, Google giảm tần suất crawl |

Đối với các dự án SEO lớn, phân tích log server ở mức chuyên sâu là công việc thường xuyên, không chỉ làm một lần. Cần đối chiếu:

- TTFB và response time theo từng nhóm URL (HTML, API, file tĩnh).

- Số lượng request của Googlebot theo ngày/giờ, so sánh với thời điểm triển khai nội dung mới.

- Tỷ lệ lỗi 5xx, 4xx trong các phiên crawl lớn, đặc biệt sau khi submit sitemap hoặc nhận nhiều backlink mới.

Nếu log cho thấy Googlebot thường xuyên gặp response time cao hoặc lỗi 5xx ở các endpoint quan trọng (trang chủ, category, sitemap), giải pháp không chỉ là tối ưu code, query database hay cache ứng dụng, mà còn phải nâng cấp hoặc thay đổi loại hosting, tối ưu web server (Nginx/Apache/LiteSpeed), cấu hình PHP-FPM, connection limit, keep-alive… để đảm bảo hạ tầng đủ sức phục vụ đồng thời cả người dùng lẫn bot.

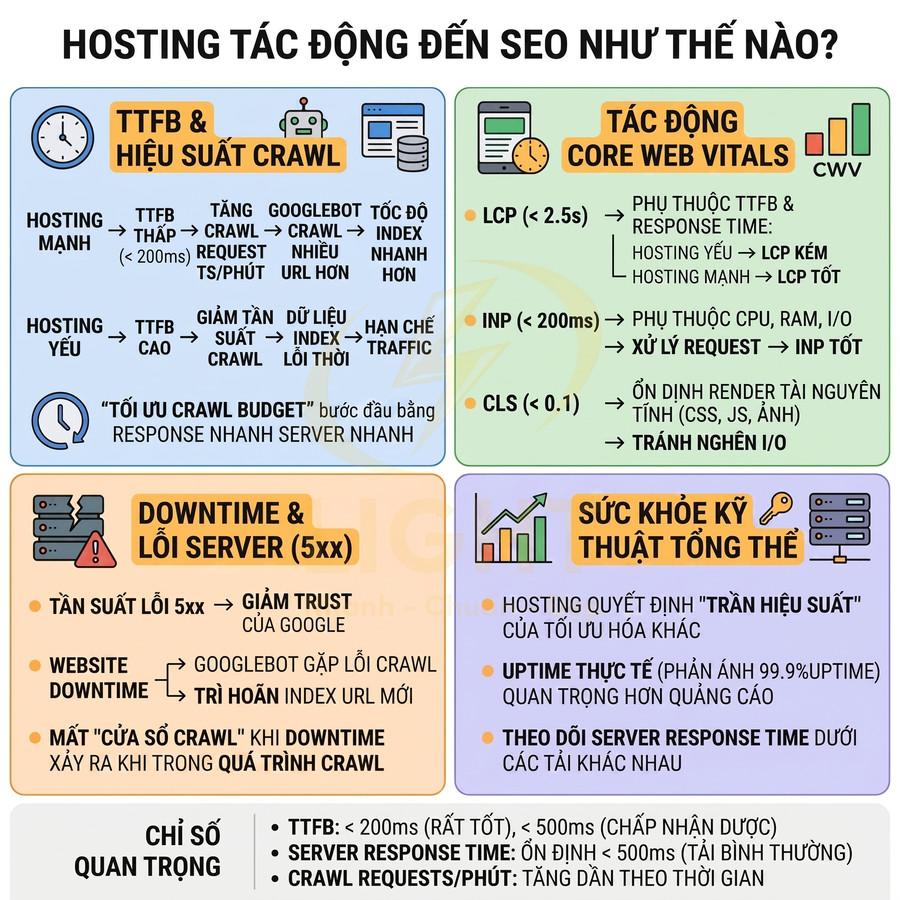

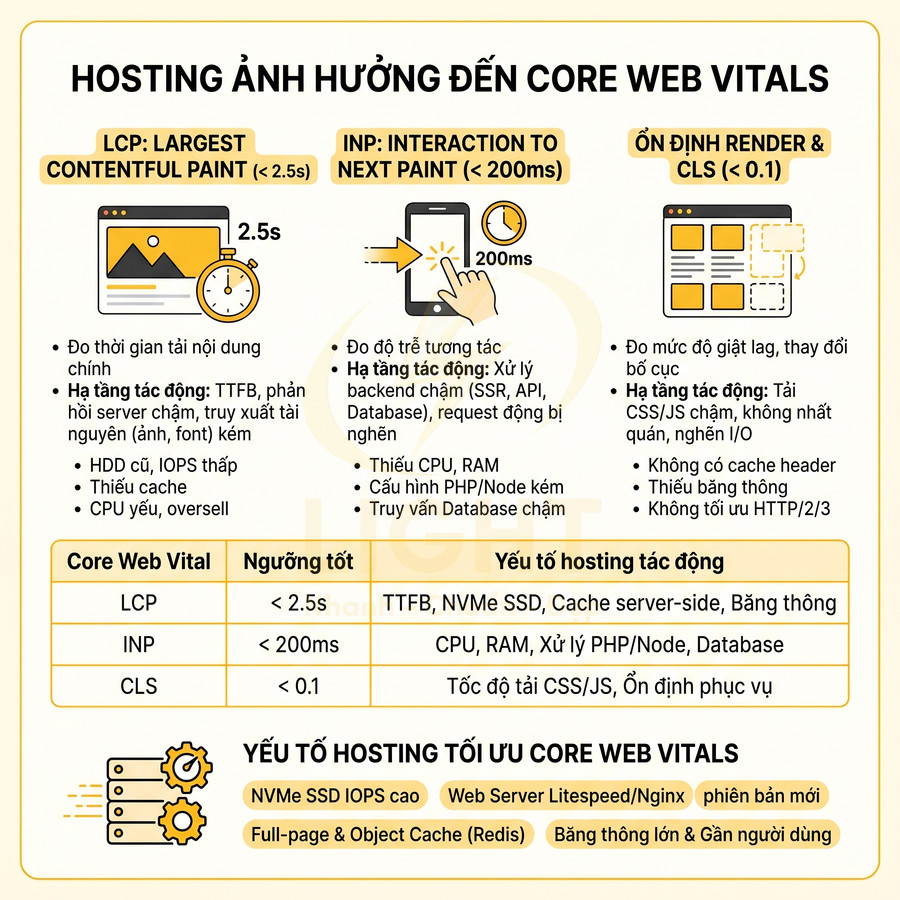

Hosting ảnh hưởng Core Web Vitals: LCP, INP, ổn định render và trải nghiệm trang

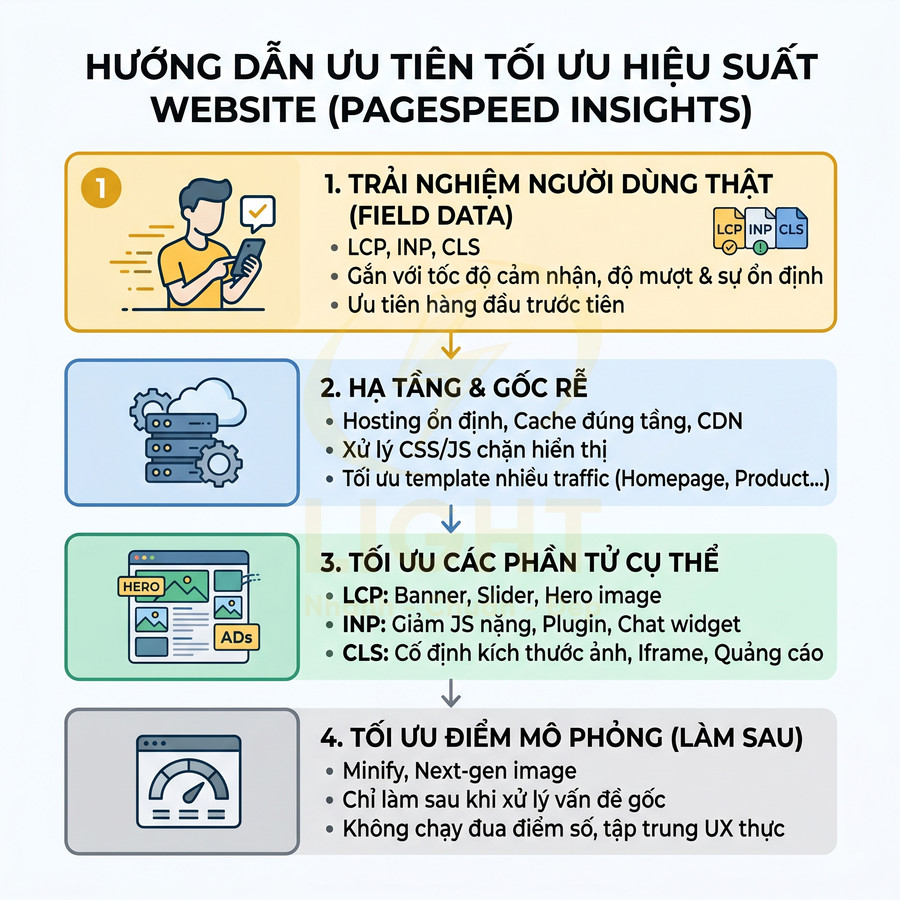

Core Web Vitals là nhóm chỉ số trải nghiệm trang mà Google sử dụng như một tín hiệu xếp hạng. Trong đó, LCP (Largest Contentful Paint) và INP (Interaction to Next Paint) chịu tác động mạnh từ chất lượng hosting, vì chúng phụ thuộc trực tiếp vào tốc độ phản hồi server, khả năng xử lý backend và tốc độ phục vụ tài nguyên tĩnh. Core Web Vitals nên được trình bày như một hệ đo lường trải nghiệm thực tế, không chỉ là “điểm tốc độ” trong công cụ kiểm tra. Google định nghĩa LCP là chỉ số đo tốc độ tải nội dung chính, INP đo khả năng phản hồi khi người dùng tương tác, còn CLS đo độ ổn định bố cục; các ngưỡng tốt lần lượt là LCP dưới 2,5 giây, INP dưới 200 mili giây và CLS dưới 0,1 (Google, 2020). Hosting ảnh hưởng trực tiếp đến các chỉ số này thông qua TTFB, tốc độ xử lý backend, khả năng phục vụ tài nguyên tĩnh, cache và độ ổn định khi có nhiều request đồng thời.

LCP đo thời gian tải phần nội dung lớn nhất trong viewport (hero image, banner, block text lớn). Quy trình để LCP hoàn thành thường gồm:

- Trình duyệt gửi request HTML → phụ thuộc TTFB và server response time.

- Trình duyệt phân tích HTML, tải CSS/JS, xác định phần tử LCP.

- Tải tài nguyên liên quan (ảnh, font, background) → phụ thuộc tốc độ I/O, băng thông, cache.

Nếu hosting sử dụng HDD cũ, IOPS thấp, không có cache server-side (OPcache, page cache, object cache), CPU yếu hoặc bị oversell tài nguyên, thời gian render HTML và truy xuất tài nguyên tĩnh sẽ kéo dài, khiến LCP dễ vượt ngưỡng khuyến nghị (< 2.5s). Ngay cả khi đã tối ưu ảnh, preload font, giảm kích thước CSS/JS, một hạ tầng chậm vẫn tạo ra “nút thắt cổ chai” ở bước đầu tiên: TTFB và thời gian xử lý backend. Cần bổ sung rằng hiệu năng hosting không chỉ nằm ở dung lượng lưu trữ, mà nằm ở độ trễ truy xuất, IOPS, CPU khả dụng và khả năng duy trì hiệu suất dưới tải thật. Trong nghiên cứu về độ trễ trên nền tảng thương mại điện tử, Basalla và cộng sự (2021) cho thấy độ trễ có ảnh hưởng rõ đến hiệu suất website, đặc biệt mạnh hơn với người dùng di động và người dùng có hành vi điều hướng nhanh. Điều này cho thấy hosting yếu không chỉ làm chậm một trang đơn lẻ, mà còn làm suy giảm toàn bộ hành trình người dùng: xem danh mục, lọc sản phẩm, mở trang chi tiết, thêm giỏ hàng và hoàn tất chuyển đổi.

INP phản ánh độ trễ khi người dùng tương tác với trang (click, tap, nhập liệu). Dù phần lớn phụ thuộc vào JavaScript, event handler và main thread trên frontend, hosting vẫn đóng vai trò quan trọng trong các tình huống:

- Trang sử dụng render server-side (SSR) hoặc hydration phức tạp.

- Form gửi dữ liệu, gọi API nội bộ, truy vấn database, xử lý logic kinh doanh.

- Các thao tác cần xác thực, tính toán giá, kiểm tra tồn kho, tạo session.

Hosting thiếu CPU, RAM hoặc IOPS khiến các request động xử lý chậm, làm tăng INP, đặc biệt trên các trang có nhiều script, form, tính năng tương tác. Khi INP cao, người dùng cảm thấy website “ì ạch”, click không phản hồi ngay, dẫn đến tăng bounce rate, giảm thời gian tương tác – những tín hiệu hành vi gián tiếp tác động đến hiệu quả SEO.

Ổn định render còn liên quan đến khả năng hosting phục vụ tài nguyên tĩnh (CSS, JS, hình ảnh, font) một cách nhanh và nhất quán. Nếu server thường xuyên:

- Bị nghẽn I/O khi nhiều request truy cập cùng lúc.

- Thiếu băng thông hoặc không tối ưu HTTP/2/HTTP/3, không bật compression.

- Không có cơ chế cache header, dẫn đến mỗi lần tải lại đều phải truy xuất đĩa.

Trình duyệt sẽ phải chờ lâu để tải nhiều file song song, gây layout shift và ảnh hưởng đến trải nghiệm. Dù CLS (Cumulative Layout Shift) chủ yếu do cách code frontend (kích thước ảnh không cố định, font swap, quảng cáo chèn giữa nội dung), hosting yếu làm kéo dài thời gian tải CSS/JS, khiến các phần tử trên trang thay đổi vị trí muộn hơn, người dùng cảm nhận rõ sự “giật lag”.

| Core Web Vital | Ngưỡng tốt | Yếu tố hosting tác động |

|---|---|---|

| LCP | < 2.5s | TTFB, tốc độ đọc NVMe SSD, cache server-side, băng thông |

| INP | < 200ms | CPU, RAM, xử lý PHP/Node, tốc độ truy vấn database |

| CLS | < 0.1 | Tốc độ tải CSS/JS, ổn định phục vụ tài nguyên tĩnh |

Đối với website chuẩn SEO, tối ưu Core Web Vitals phải được thực hiện song song ở hai lớp: frontend và hạ tầng. Ở lớp hạ tầng, các yếu tố hosting có tác động mạnh gồm:

- Loại ổ đĩa: NVMe SSD với IOPS cao giúp giảm thời gian truy xuất file và database.

- Loại web server: Nginx/LiteSpeed thường cho hiệu suất tốt hơn Apache cấu hình mặc định.

- Cache server-side: full-page cache, object cache (Redis/Memcached), OPcache cho PHP.

- Phiên bản và cấu hình PHP/Node/…: phiên bản mới, tối ưu worker, process manager.

- Băng thông và network latency: đặt server gần khu vực người dùng mục tiêu.

Kể cả khi đã nén ảnh, tối ưu code, giảm JavaScript, nếu hosting vẫn dùng HDD cũ, không có cache, CPU yếu, thì LCP và INP khó đạt chuẩn trên diện rộng (field data). Ngược lại, hosting hiện đại với NVMe SSD, web server tối ưu và cache hợp lý giúp giảm đáng kể thời gian render, tạo nền tảng vững chắc cho mọi nỗ lực tối ưu frontend, đặc biệt trên các website có traffic lớn và nhiều trang động.

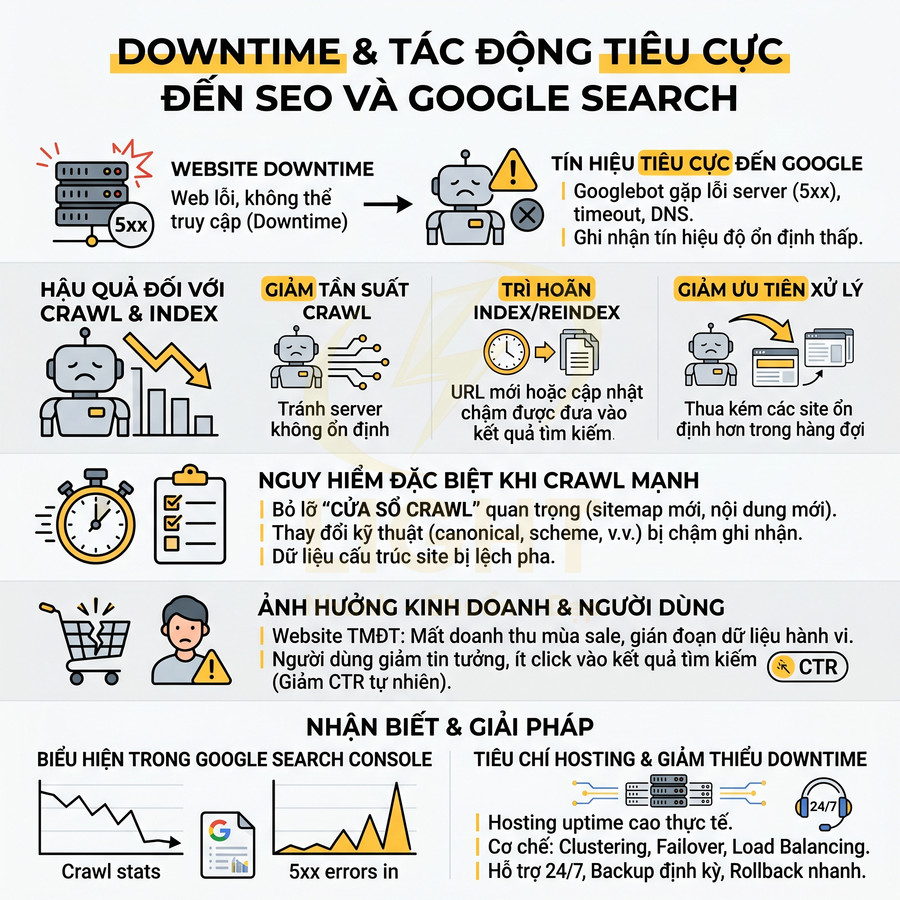

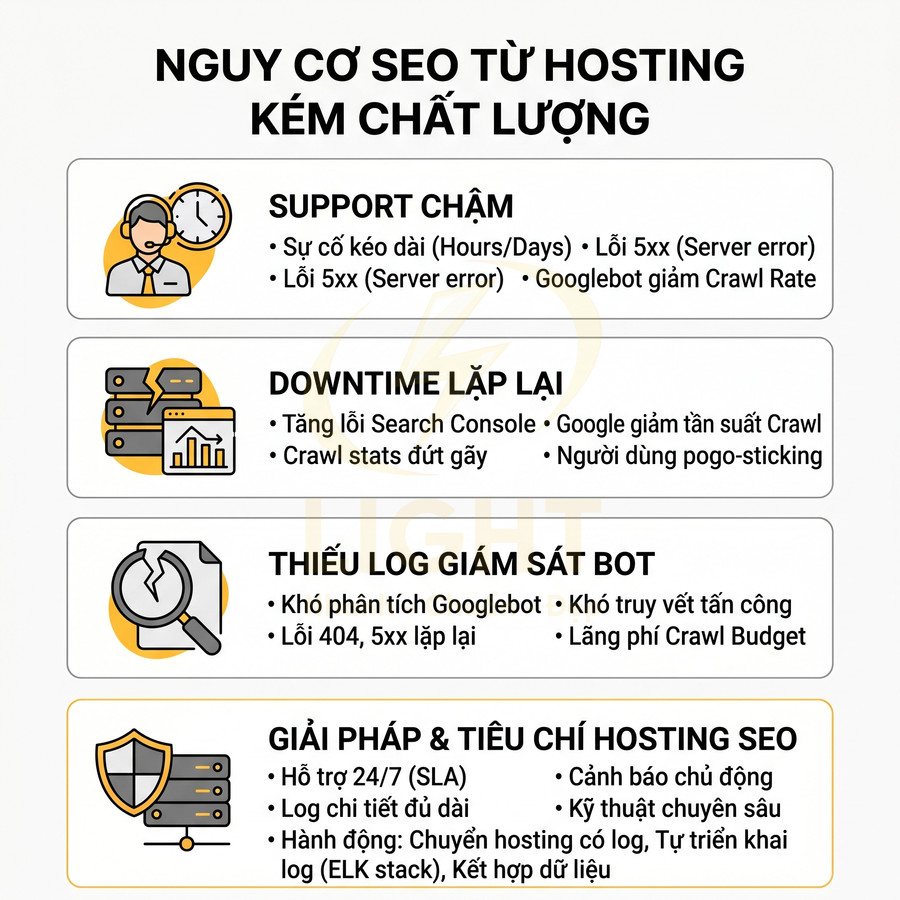

Downtime khiến Google gặp lỗi crawl, giảm trust và chậm index URL mới

Downtime là khoảng thời gian website không thể truy cập được do server lỗi, bảo trì hoặc sự cố hạ tầng. Về mặt SEO, downtime không chỉ làm mất traffic tức thời mà còn ảnh hưởng đến độ tin cậy (trust) của website trong hệ thống của Google. Khi Googlebot truy cập một URL và nhận lỗi 5xx (server error) hoặc không kết nối được (connection timeout, DNS error), nó ghi nhận tín hiệu tiêu cực về độ ổn định của website. Downtime cần được nhìn như một rủi ro SEO có tính tích lũy, không chỉ là sự cố kỹ thuật tạm thời. Google cho biết khi website phản hồi chậm hoặc trả nhiều lỗi server, Googlebot sẽ giảm tốc độ crawl để tránh gây thêm tải cho máy chủ (Google Search Central, 2017). Điều này có nghĩa là nếu downtime lặp lại đúng thời điểm Googlebot đang thu thập dữ liệu, các URL mới hoặc vừa cập nhật có thể bị index chậm. Với website thương mại điện tử hoặc website tin tức, downtime trong vài giờ có thể làm lỡ “cửa sổ crawl” quan trọng, khiến nội dung khuyến mãi, tồn kho hoặc tin mới không được cập nhật kịp thời trên kết quả tìm kiếm.

Nếu tình trạng này lặp lại ở quy mô lớn hoặc trong thời gian dài, các hệ thống của Google có xu hướng:

- Giảm tần suất crawl để tránh “đánh thức” một server không ổn định.

- Trì hoãn việc index hoặc reindex các URL mới/cập nhật.

- Giảm mức độ ưu tiên của site trong hàng đợi xử lý, đặc biệt khi cạnh tranh với các site cùng chủ đề nhưng ổn định hơn.

Downtime xảy ra trùng với thời điểm Googlebot đang crawl mạnh (sau khi submit sitemap mới, triển khai nhiều nội dung mới, hoặc vừa nhận được backlink từ site lớn) đặc biệt nguy hiểm. “Cửa sổ crawl” quan trọng này có thể bị bỏ lỡ, dẫn đến:

- Hàng loạt URL mới không được index đúng thời điểm chiến dịch SEO đang cần.

- Các thay đổi kỹ thuật (chuyển hướng, canonical, hreflang, schema) bị chậm ghi nhận.

- Dữ liệu về cấu trúc site trong index của Google bị “lệch pha” so với phiên bản thực tế.

Với các website thương mại điện tử, downtime trong mùa sale hoặc chiến dịch quảng cáo lớn không chỉ gây mất doanh thu mà còn làm gián đoạn dữ liệu hành vi người dùng (session bị cắt, event không ghi nhận), ảnh hưởng đến các thuật toán xếp hạng dựa trên tín hiệu trải nghiệm và tương tác. Ngoài ra, người dùng quay lại gặp lỗi nhiều lần sẽ giảm mức độ tin tưởng, ít click vào kết quả của bạn trong tương lai, làm CTR tự nhiên suy giảm.

Hosting có uptime thấp, thường xuyên bảo trì không thông báo, hoặc không có cơ chế failover, load balancing sẽ khiến downtime xảy ra bất ngờ và khó kiểm soát. Trong Google Search Console, điều này thể hiện qua:

- Biểu đồ crawl stats xuất hiện các “hố” (khoảng thời gian request giảm mạnh).

- Báo cáo coverage ghi nhận nhiều lỗi server (5xx), soft 404 hoặc URL not available.

- Thời gian phản hồi trung bình tăng đột biến trong một số ngày nhất định.

Nếu không xử lý triệt để, website có thể mất dần vị trí cho đối thủ ổn định hơn, dù nội dung và backlink không thua kém. Do đó, khi đánh giá hosting cho SEO, uptime thực tế (được monitor độc lập bằng các công cụ giám sát) và khả năng xử lý sự cố nhanh chóng là tiêu chí bắt buộc, không thể chỉ nhìn vào thông số quảng cáo “99.9% uptime” trên brochure. Các biện pháp như clustering, failover, backup định kỳ, quy trình rollback nhanh, và kênh hỗ trợ kỹ thuật 24/7 có tác động trực tiếp đến khả năng duy trì sự hiện diện ổn định của website trong mắt Googlebot.

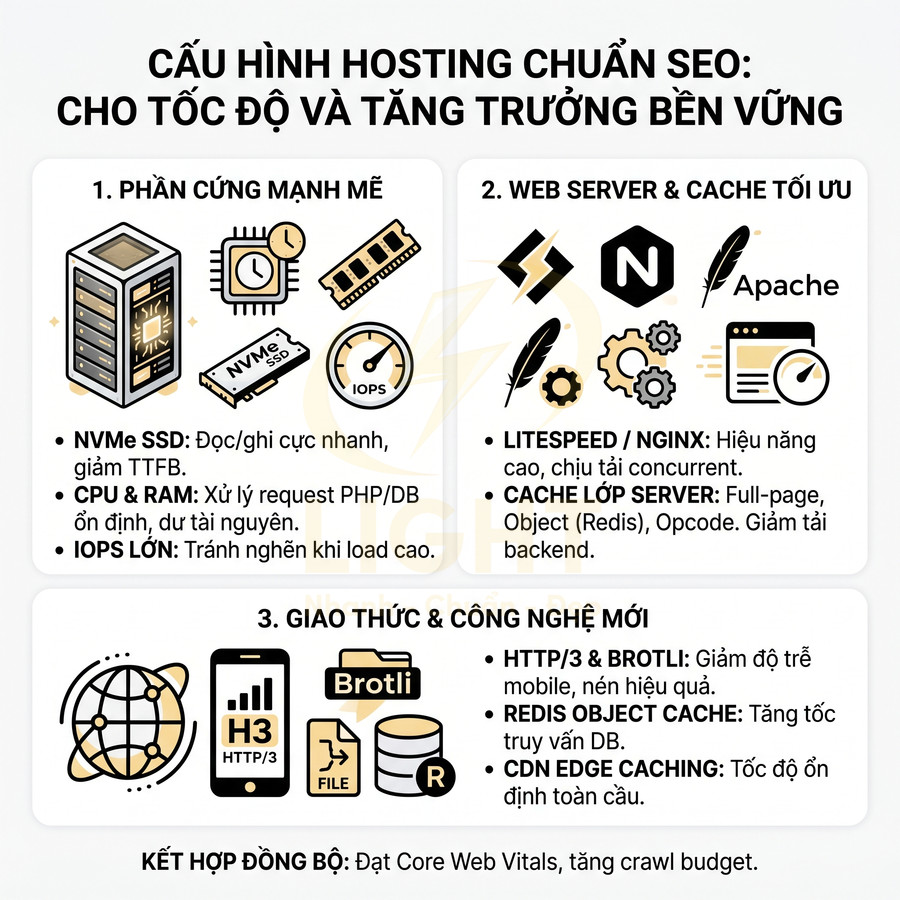

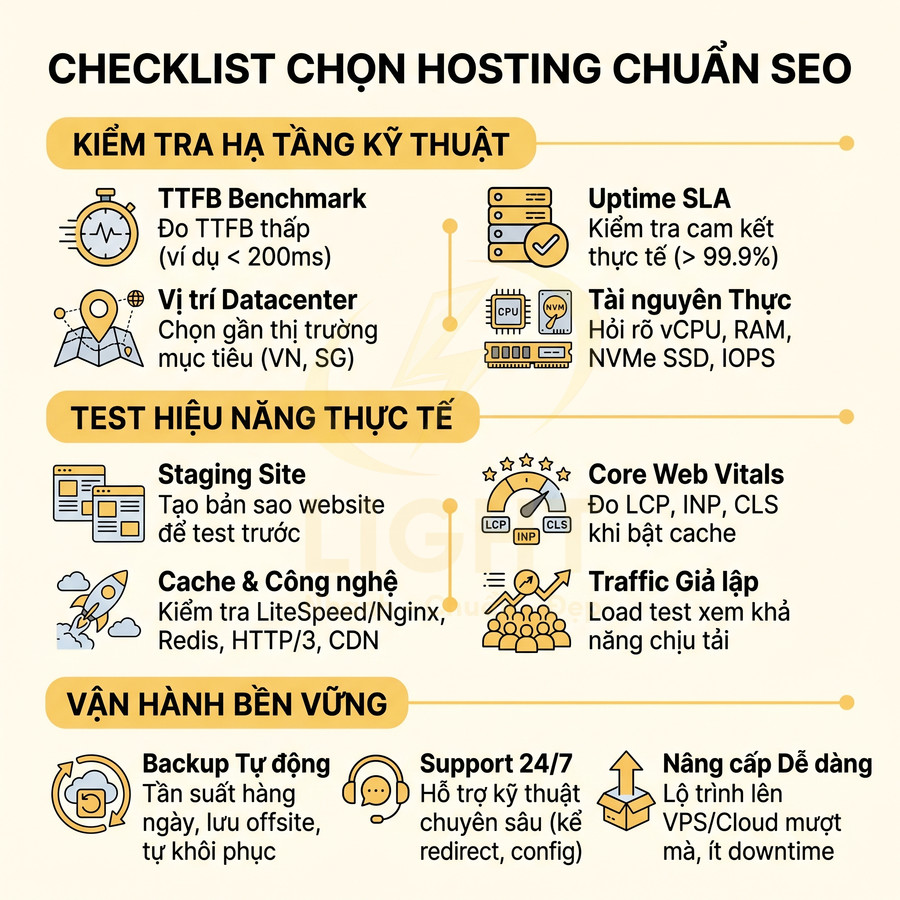

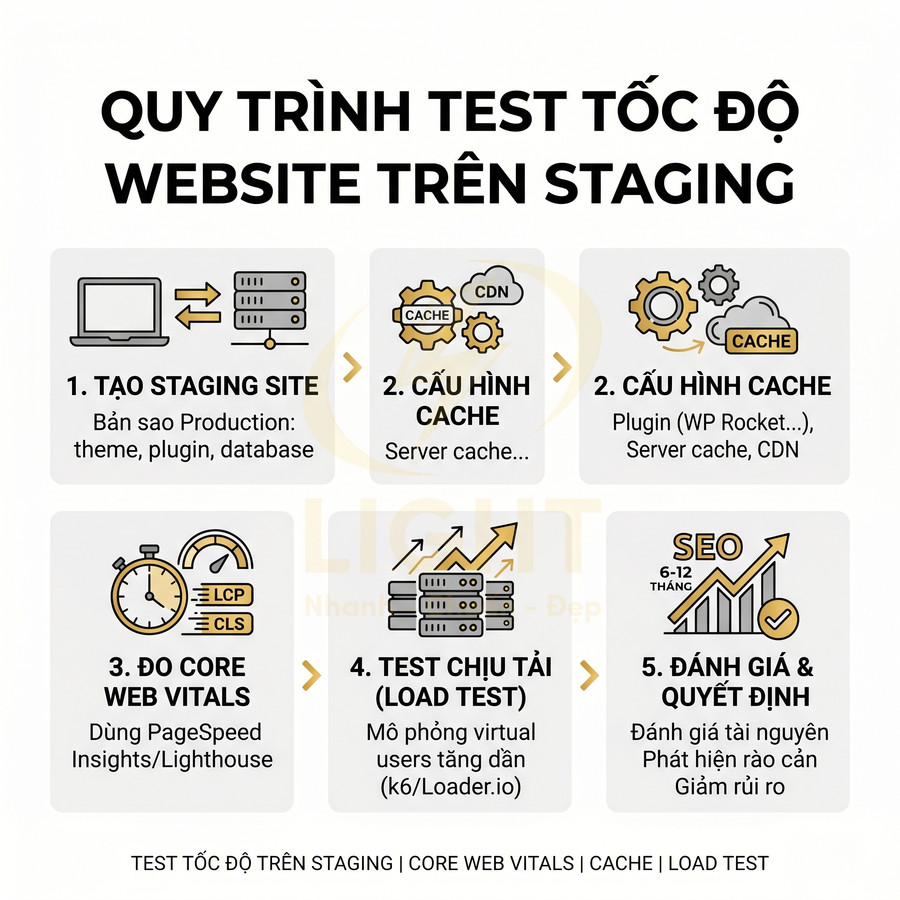

Cấu hình hosting chuẩn SEO cần có cho website tốc độ cao và tăng trưởng bền vững

Cấu hình hosting chuẩn SEO cần đảm bảo nền tảng phần cứng mạnh với NVMe SSD, CPU, RAM và IOPS đủ lớn để xử lý PHP, database và cache ổn định, tạo biên độ tăng trưởng dài hạn. Song song, lựa chọn web server tối ưu như LiteSpeed, Nginx hoặc Apache kết hợp cache server-side (full-page, object, opcode) giúp giảm tải backend, cải thiện TTFB và Core Web Vitals. Ở lớp giao thức và phân phối nội dung, hỗ trợ HTTP/3, Brotli, Redis object cache và CDN edge caching giúp website duy trì tốc độ cao trên nhiều khu vực, thiết bị và điều kiện mạng khác nhau. Tổng thể, hosting cần vừa đáp ứng nhu cầu hiện tại, vừa dễ mở rộng, ưu tiên dư tài nguyên để đảm bảo hiệu suất và SEO bền vững.

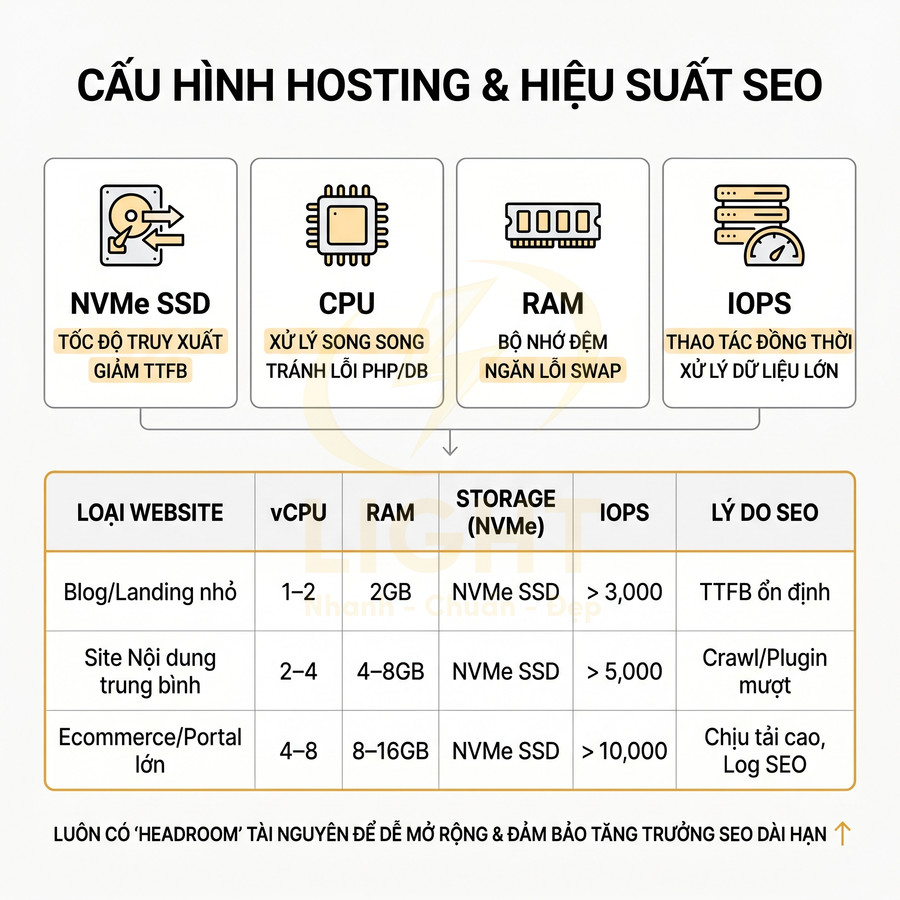

Ổ cứng NVMe SSD, CPU, RAM, IOPS và tài nguyên xử lý PHP database

Cấu hình phần cứng của hosting là lớp nền hạ tầng trực tiếp quyết định khả năng chịu tải, độ ổn định và biên độ tăng trưởng SEO dài hạn. Với các thuật toán ưu tiên trải nghiệm người dùng và Core Web Vitals, Google ngày càng “khắt khe” với tốc độ phản hồi server, độ ổn định khi traffic tăng đột biến và khả năng crawl ở quy mô lớn. Vì vậy, việc lựa chọn cấu hình không chỉ dừng ở mức “chạy được” mà cần hướng tới trạng thái ổn định, dư tài nguyên và dễ mở rộng.

NVMe SSD hiện là tiêu chuẩn gần như bắt buộc cho website chuẩn SEO. Khác với HDD hoặc SSD SATA vốn bị giới hạn bởi giao tiếp SATA truyền thống, NVMe SSD sử dụng giao tiếp PCIe với băng thông và độ trễ vượt trội. Điều này mang lại:

- Tốc độ đọc/ghi tuần tự và ngẫu nhiên cao hơn nhiều lần, giúp truy xuất file PHP, CSS, JS, hình ảnh, log và cache nhanh hơn.

- IOPS (Input/Output Operations Per Second) lớn, giảm tình trạng nghẽn I/O khi có nhiều request đồng thời truy cập database hoặc file cache.

- Giảm đáng kể TTFB (Time To First Byte), hỗ trợ cải thiện các chỉ số như LCP, FID/INP và tốc độ render HTML ban đầu.

Có thể bổ sung bằng cách giải thích mối quan hệ giữa lưu trữ nhanh và hiệu quả SEO ở cấp hệ thống. NVMe SSD giúp giảm độ trễ đọc/ghi, tăng số thao tác I/O mỗi giây và hỗ trợ tốt hơn cho các tác vụ thường gặp trong CMS như đọc file PHP, truy vấn database, ghi cache, tạo sitemap và xử lý log. Khi website có nhiều nội dung, nhiều plugin hoặc nhiều request đồng thời, giới hạn I/O thường trở thành nút thắt trước cả CPU. Vì vậy, NVMe SSD không tự tạo thứ hạng, nhưng giúp giảm nguy cơ TTFB tăng đột biến, lỗi 5xx và timeout – những yếu tố có thể làm giảm crawl rate và làm xấu Core Web Vitals (Google Search Central, 2017; Google, 2020).

Với các website WordPress hoặc CMS tương tự, phần lớn thời gian xử lý nằm ở:

- Thực thi PHP (PHP-FPM, OPCache).

- Truy vấn database (MySQL/MariaDB, PostgreSQL).

- Đọc/ghi cache (full-page cache, object cache, session, log).

CPU quyết định số lượng request động có thể xử lý song song. Mỗi request PHP, cron job, tác vụ queue (queue worker), hay tiến trình nén ảnh, tạo sitemap, xuất báo cáo… đều tiêu tốn CPU. Khi CPU bị “full” trong thời gian dài, bạn sẽ thấy:

- TTFB tăng vọt, đặc biệt ở các trang chưa được cache.

- Googlebot nhận phản hồi chậm, giảm tốc độ crawl, tăng khả năng gặp lỗi 5xx.

- Người dùng gặp hiện tượng loading lâu, time-out hoặc lỗi 502/504.

RAM là không gian cho PHP-FPM, web server, database, Redis/Memcached, hệ điều hành và các dịch vụ nền. Khi RAM không đủ, hệ thống buộc phải dùng swap trên ổ đĩa, khiến mọi thao tác I/O chậm đi rất nhiều. Hệ quả:

- Thời gian phản hồi tăng dần theo thời gian hoạt động, đặc biệt khi có nhiều plugin nặng, page builder hoặc theme phức tạp.

- Dễ phát sinh lỗi 500, 502, 503 khi traffic tăng hoặc khi chạy các tác vụ nặng như import dữ liệu, backup, reindex.

- Database query bị chậm do không đủ bộ nhớ cho buffer pool, query cache, sort buffer.

IOPS thấp là “kẻ giết chết” hiệu năng trong im lặng. Ngay cả khi CPU và RAM còn dư, nếu IOPS bị giới hạn (thường gặp trên shared hosting giá rẻ), các truy vấn database và thao tác đọc/ghi file sẽ bị xếp hàng chờ. Điều này đặc biệt rõ khi:

- Bảng database lớn, nhiều index, nhiều join phức tạp.

- Chạy cron, backup, export/import, đồng bộ dữ liệu với CRM/ERP.

- Log access/error, log plugin SEO, log search nội bộ ghi quá nhiều.

| Loại website | Cấu hình tối thiểu khuyến nghị | Lý do |

|---|---|---|

| Blog/landing nhỏ (< 10.000 visit/tháng) | 1–2 vCPU, 2GB RAM, NVMe SSD, IOPS > 3.000 | Đủ xử lý PHP cơ bản, cache tốt, TTFB ổn định |

| Site nội dung trung bình (10.000–100.000 visit/tháng) | 2–4 vCPU, 4–8GB RAM, NVMe SSD, IOPS > 5.000 | Đảm bảo crawl, xử lý plugin, truy vấn DB phức tạp |

| Ecommerce, portal lớn (> 100.000 visit/tháng) | 4–8 vCPU, 8–16GB RAM, NVMe SSD, IOPS > 10.000 | Đáp ứng traffic cao, nhiều request đồng thời, log SEO |

Với SEO, việc “dư” tài nguyên thường an toàn hơn “vừa đủ”. Khi triển khai chiến dịch content, chạy quảng cáo, launch sản phẩm mới hoặc nhận một lượng lớn backlink, traffic có thể tăng đột biến trong thời gian ngắn. Nếu hosting không có headroom tài nguyên:

- Website chậm lại đúng thời điểm có nhiều người dùng mới, làm giảm tỷ lệ chuyển đổi và tín hiệu tương tác tích cực.

- Googlebot có thể gặp nhiều lỗi 5xx hoặc response chậm, ảnh hưởng crawl budget và tốc độ index.

- Rủi ro phải nâng cấp hoặc di chuyển server gấp, gây downtime, thay đổi IP, ảnh hưởng ổn định SEO.

Khi chọn hosting, nên đánh giá cả:

- Nhu cầu hiện tại (traffic, số bài viết, số sản phẩm, số plugin).

- Kế hoạch tăng trưởng SEO trong 6–12 tháng (mở rộng thị trường, tăng tần suất xuất bản, triển khai đa ngôn ngữ, thêm subdomain).

- Khả năng nâng cấp dọc (tăng CPU/RAM/IOPS) và ngang (tách database, dùng cluster, load balancing) mà không phải thay đổi toàn bộ hạ tầng.

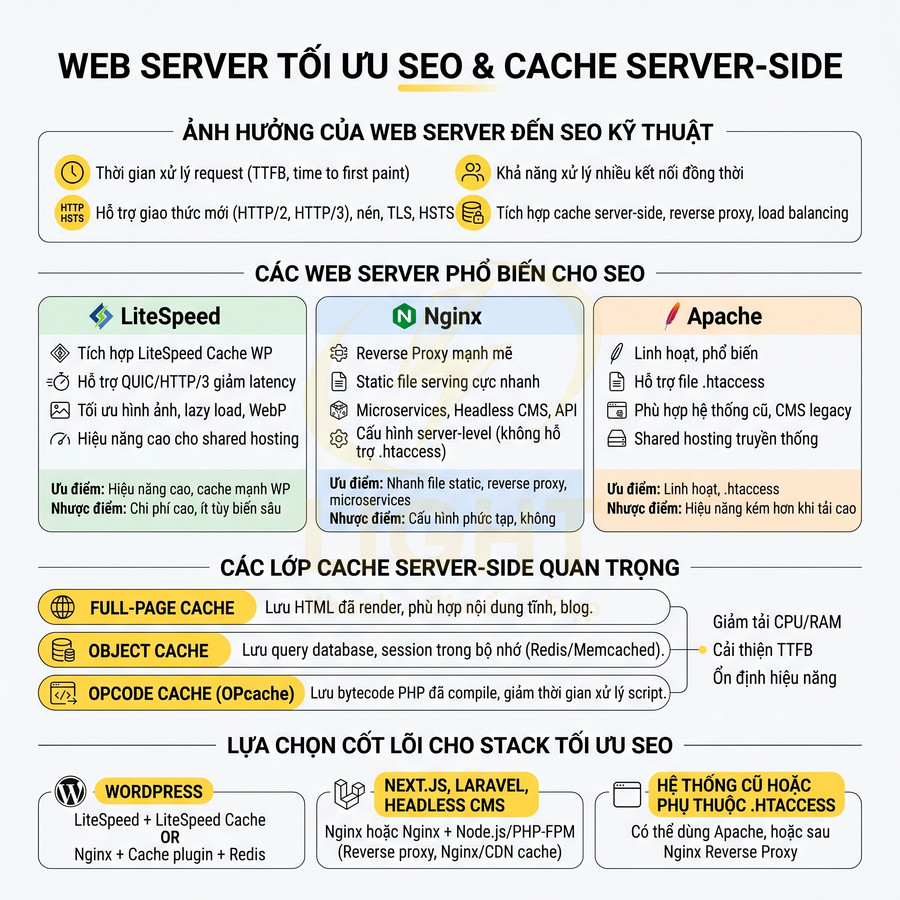

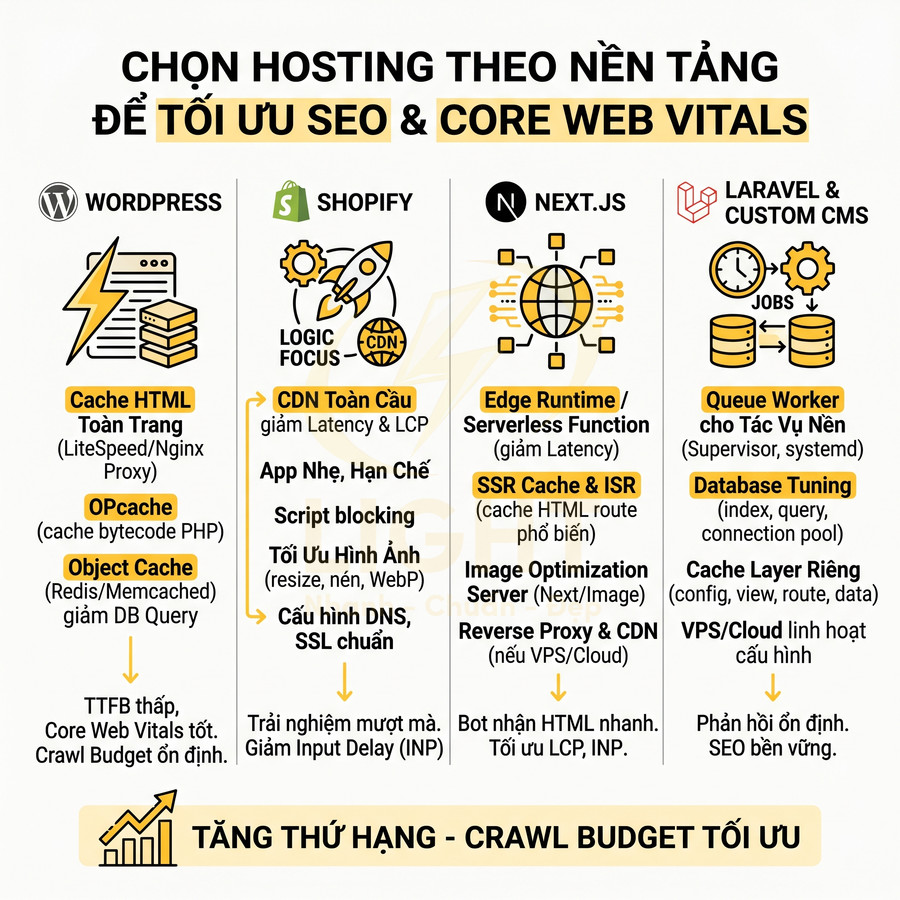

Web server tối ưu SEO: LiteSpeed, Nginx, Apache HTTP Server và cache server-side

Web server là lớp phần mềm tiếp xúc trực tiếp với request HTTP/HTTPS từ trình duyệt và bot. Về góc độ SEO kỹ thuật, web server ảnh hưởng đến:

- Thời gian xử lý request (TTFB, time to first paint).

- Khả năng xử lý nhiều kết nối đồng thời (concurrent connections).

- Hỗ trợ giao thức mới (HTTP/2, HTTP/3), nén, TLS, HSTS.

- Khả năng tích hợp cache server-side, reverse proxy, load balancing.

LiteSpeed Web Server (LSWS) được tối ưu mạnh cho hosting shared và WordPress. Một số lợi thế nổi bật:

- Tích hợp sâu với plugin LiteSpeed Cache cho WordPress, hỗ trợ:

- Full-page cache (cache toàn trang HTML).

- ESI (Edge Side Includes) cho phép cache từng block, phù hợp trang có phần động như giỏ hàng, user info.

- Tối ưu hình ảnh, lazy load, WebP, minify/combining CSS/JS.

- Tích hợp QUIC/HTTP/3, giúp giảm latency trên mạng di động.

- Hiệu năng cao hơn Apache trong môi trường nhiều website, nhiều virtual host.

- Giảm tải CPU/RAM nhờ cơ chế event-driven và cache tích hợp.

Nginx mạnh về reverse proxy, static file serving và load balancing. Nginx phù hợp cho:

- Kiến trúc microservices, headless CMS, API-first.

- Các framework như Next.js, Nuxt.js, Laravel, Symfony, Django.

- Mô hình Nginx phía trước (reverse proxy) + ứng dụng Node.js/PHP-FPM phía sau.

Nginx không hỗ trợ .htaccess, mọi cấu hình rewrite, redirect, cache rule cần được khai báo trong file cấu hình server, đòi hỏi kỹ năng sysadmin cao hơn nhưng đổi lại hiệu năng và khả năng kiểm soát tốt hơn.

Apache HTTP Server phổ biến, linh hoạt, hỗ trợ .htaccess, phù hợp với:

- Các hệ thống cũ, nhiều rule rewrite phức tạp, nhiều CMS legacy.

- Môi trường shared hosting truyền thống, nơi người dùng cần tự chỉnh .htaccess.

Tuy nhiên, Apache theo mô hình process/thread-based, nếu không tối ưu kỹ (MPM, KeepAlive, module dư thừa) sẽ dễ trở thành nút thắt cổ chai khi tải cao, đặc biệt trên shared hosting nhiều site.

| Web server | Ưu điểm cho SEO | Nhược điểm |

|---|---|---|

| LiteSpeed | Hiệu năng cao, tích hợp cache mạnh cho WordPress, hỗ trợ HTTP/3 | Thường gắn với hosting trả phí cao hơn, ít tùy biến sâu so với Nginx thuần |

| Nginx | Phục vụ static nhanh, phù hợp reverse proxy, microservices | Cấu hình phức tạp hơn, không hỗ trợ .htaccess |

| Apache | Linh hoạt, phổ biến, hỗ trợ .htaccess | Hiệu năng kém hơn khi tải cao, dễ bị quá tải trên shared hosting |

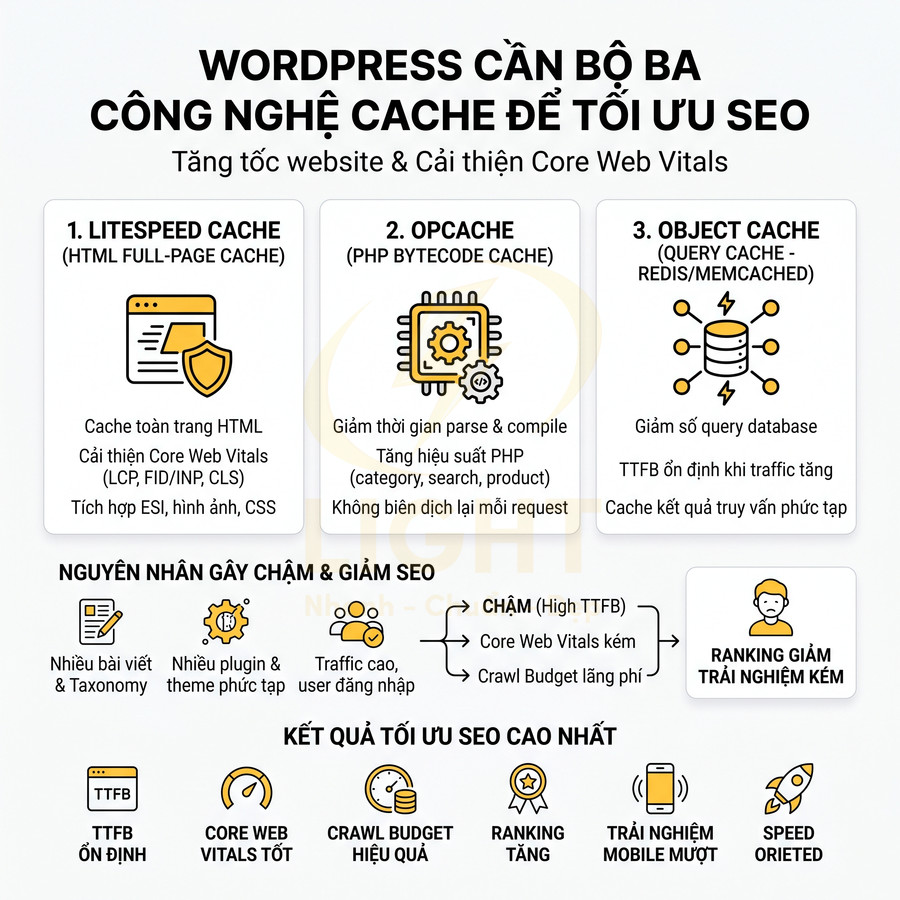

Cache server-side là yếu tố gần như bắt buộc để đạt tốc độ chuẩn SEO, đặc biệt với WordPress, Magento, WooCommerce, Laravel. Thay vì render PHP/Node.js cho mỗi request, server trả lại bản HTML đã cache, giúp:

- Giảm tải CPU/RAM, tăng khả năng chịu tải khi có nhiều user và bot.

- Cải thiện TTFB, đặc biệt cho người dùng lần đầu truy cập.

- Ổn định hiệu năng khi Googlebot crawl hàng loạt URL trong thời gian ngắn.

Các lớp cache quan trọng:

- Full-page cache: Lưu toàn bộ HTML đã render, phù hợp trang nội dung tĩnh, blog, landing page.

- Object cache: Lưu kết quả query database, cấu hình, session trong bộ nhớ (Redis/Memcached).

- Opcode cache (OPcache): Lưu bytecode PHP đã compile, giảm thời gian parse và compile script.

Hosting không hỗ trợ hoặc giới hạn cache server-side khiến mọi tối ưu frontend (nén ảnh, minify, lazy load) chỉ mang lại hiệu quả một phần, vì “nút cổ chai” nằm ở backend và database. Với website chuẩn SEO, lựa chọn web server nên gắn với stack tổng thể:

- WordPress: thường hưởng lợi lớn từ LiteSpeed + LiteSpeed Cache hoặc Nginx + cache plugin + Redis.

- Next.js, Laravel, headless CMS: phù hợp với Nginx hoặc Nginx + Node.js/PHP-FPM, kết hợp reverse proxy và cache tại layer Nginx/CDN.

- Hệ thống cũ hoặc phụ thuộc .htaccess: có thể dùng Apache, nhưng nên đặt sau Nginx reverse proxy để tối ưu hiệu năng.

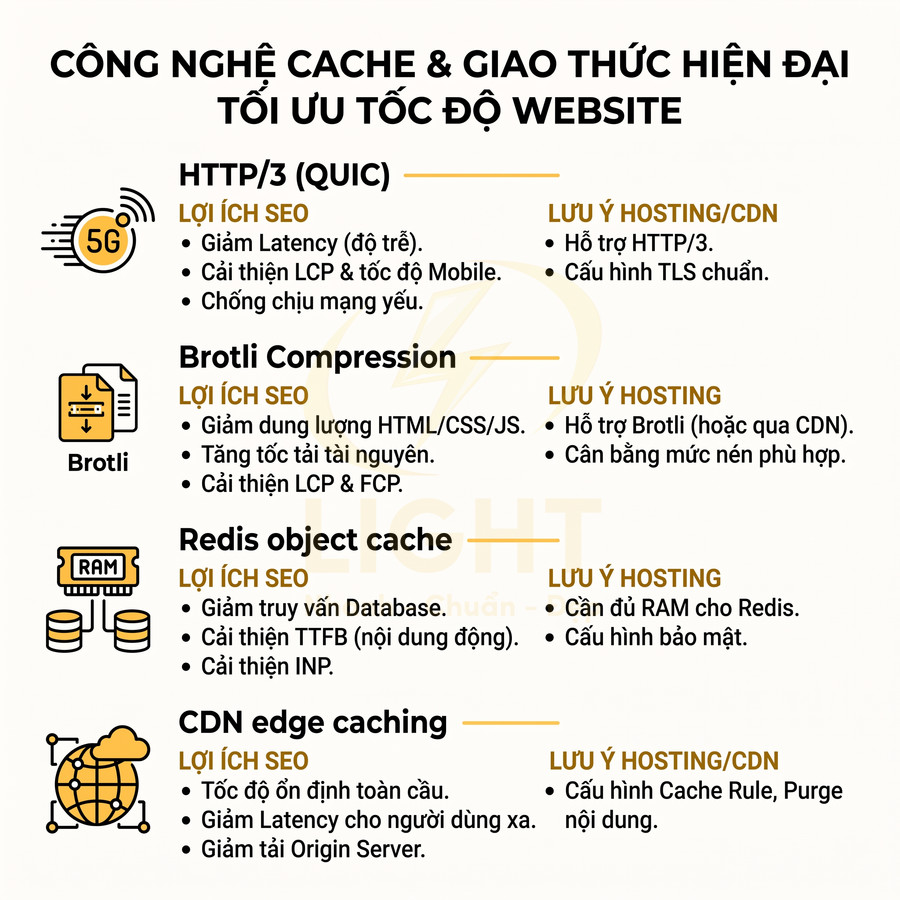

Hỗ trợ HTTP/3, Brotli, Redis object cache và CDN edge caching

Các công nghệ giao thức và cache nâng cao giúp website đạt tốc độ tối ưu trong bối cảnh người dùng truy cập từ nhiều thiết bị, mạng di động và khu vực địa lý khác nhau. Những yếu tố này không chỉ cải thiện Core Web Vitals mà còn giúp website ổn định khi mở rộng thị trường quốc tế.

HTTP/3 (dựa trên QUIC) sử dụng UDP thay vì TCP truyền thống, cho phép:

- Thiết lập kết nối nhanh hơn, giảm round-trip time.

- Chống chịu tốt hơn trên mạng không ổn định, packet loss cao (3G/4G/5G yếu, WiFi công cộng).

- Giảm độ trễ khi tải nhiều tài nguyên song song, cải thiện LCP và tốc độ tải trên mobile.

Hosting hoặc CDN cần hỗ trợ HTTP/3 và cấu hình TLS chuẩn (TLS 1.2/1.3, cipher suite an toàn). Với SEO, HTTP/3 đặc biệt hữu ích cho:

- Website có lượng truy cập mobile lớn.

- Người dùng phân bố ở nhiều khu vực có chất lượng mạng khác nhau.

Brotli là thuật toán nén hiện đại do Google phát triển, cho tỷ lệ nén tốt hơn Gzip trong nhiều trường hợp, đặc biệt với HTML, CSS, JS. Lợi ích:

- Giảm dung lượng truyền tải, rút ngắn thời gian tải tài nguyên.

- Cải thiện tốc độ render lần đầu, hỗ trợ tốt cho LCP và FCP.

Khi chọn hosting, cần lưu ý:

- Hỗ trợ Brotli ở mức server hoặc thông qua CDN.

- Cân bằng mức nén và tài nguyên CPU, tránh đặt mức nén quá cao trên server yếu.

Redis object cache lưu trữ các object database (kết quả query, session, cấu hình) trong bộ nhớ RAM, giảm số lần truy vấn database. Điều này đặc biệt hiệu quả với:

- WordPress dùng nhiều plugin, page builder, WooCommerce.

- Laravel, Symfony, Magento, các CMS có nhiều query động.

Lợi ích cho SEO:

- Giảm tải database, hạn chế tình trạng lock table, slow query.

- Cải thiện TTFB, đặc biệt với trang có nhiều block động.

- Cải thiện INP khi người dùng tương tác (lọc sản phẩm, tìm kiếm, phân trang).

Khi dùng Redis, cần:

- Đảm bảo RAM đủ cho Redis và các dịch vụ khác.

- Cấu hình bảo mật (password, bind address, firewall) để tránh lộ dữ liệu.

CDN edge caching phân phối nội dung tĩnh (CSS, JS, hình ảnh, font, video tĩnh) và trong nhiều trường hợp cả HTML động đã cache đến các node gần người dùng nhất. Khi kết hợp hosting tốt với CDN như Cloudflare, Fastly hoặc Akamai, website có thể:

- Giảm latency cho người dùng ở xa datacenter chính.

- Giảm tải trực tiếp lên origin server, tăng khả năng chịu tải khi có chiến dịch lớn.

- Giữ tốc độ ổn định giữa các khu vực địa lý, giảm chênh lệch Core Web Vitals.

CDN nên được giải thích như một lớp hạ tầng phân phối, không đơn thuần là “công cụ tăng tốc”. Pathan, Buyya và Vakali (2008) mô tả CDN gồm các máy chủ biên có nhiệm vụ lưu trữ, quản lý và phân phối nội dung từ vị trí gần người dùng hơn, đồng thời hỗ trợ cache, giám sát hiệu năng, báo cáo truy cập và khả năng mở rộng. Trong SEO, lợi ích chính của CDN là giảm độ trễ theo địa lý, giảm tải cho server gốc và giữ tốc độ ổn định khi traffic tăng đột biến. Tuy nhiên, CDN phải được cấu hình đúng cache rule, purge nội dung và bypass trang động để tránh hiển thị dữ liệu sai cho người dùng.

| Công nghệ | Lợi ích SEO | Lưu ý khi chọn hosting |

|---|---|---|

| HTTP/3 (QUIC) | Giảm latency, cải thiện tốc độ trên mạng di động | Hosting hoặc CDN cần hỗ trợ, cấu hình TLS chuẩn |

| Brotli | Giảm dung lượng HTML/CSS/JS, tăng tốc tải | Ưu tiên mức nén phù hợp, tránh CPU quá tải |

| Redis object cache | Giảm truy vấn DB, cải thiện TTFB và INP | Cần RAM đủ, cấu hình bảo mật, tránh lộ dữ liệu |

| CDN edge caching | Tốc độ ổn định toàn cầu, giảm tải hosting gốc | Cần cấu hình cache rule, purge khi cập nhật nội dung |

Khi đánh giá hosting chuẩn SEO, nên ưu tiên nhà cung cấp hỗ trợ sẵn HTTP/3, Brotli, Redis và tích hợp CDN dễ dàng. Điều này giúp giảm chi phí triển khai, hạn chế phải tự cấu hình phức tạp, đồng thời đảm bảo hạ tầng sẵn sàng cho các yêu cầu tốc độ và trải nghiệm ngày càng khắt khe của Google.

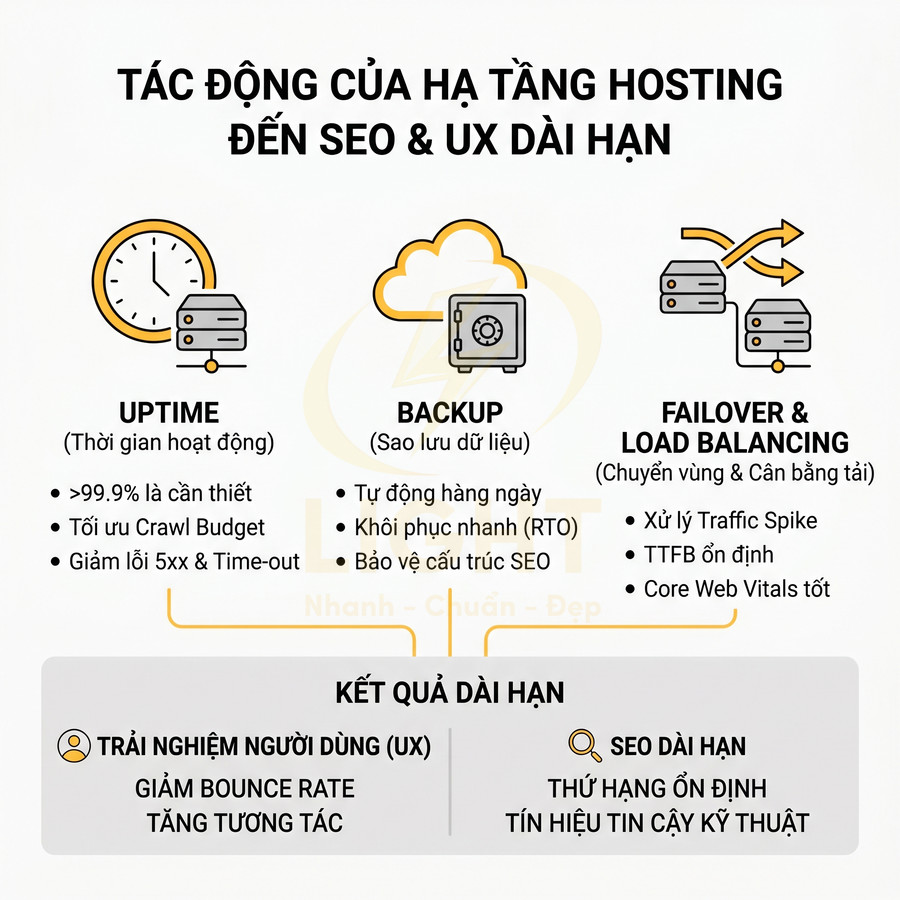

Uptime, failover và backup hosting ảnh hưởng trải nghiệm người dùng và SEO dài hạn ra sao

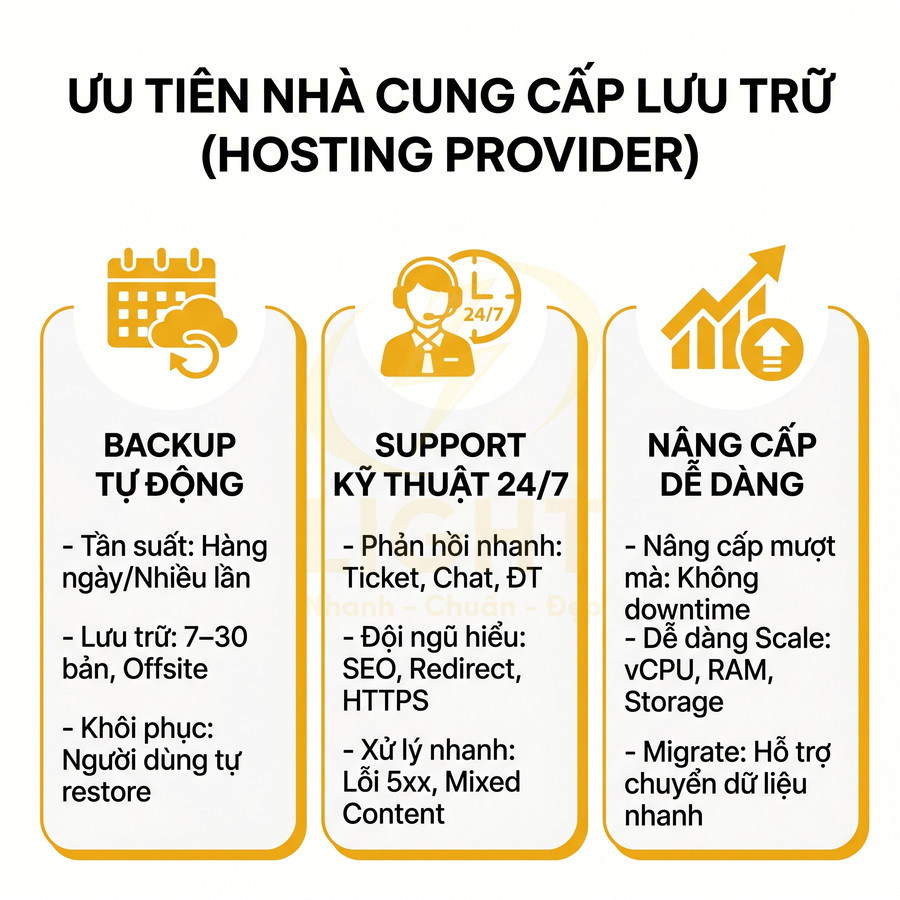

Hạ tầng hosting ổn định là nền tảng cho cả trải nghiệm người dùng lẫn SEO dài hạn. Uptime cao giúp Googlebot khai thác hiệu quả crawl budget, hạn chế lỗi 5xx, time-out và giữ nhịp cập nhật index ổn định. Khi downtime hoặc bán-downtime xảy ra thường xuyên, người dùng tăng thoát trang, giảm CTR, còn Google giảm tần suất crawl và có thể tạm loại bỏ URL khỏi index.

Bên cạnh đó, cơ chế auto backup, snapshot và kế hoạch disaster recovery đảm bảo có thể khôi phục nguyên vẹn cấu trúc SEO, money page và tín hiệu tích lũy khi gặp sự cố. Ở tầng cao hơn, cloud failover và load balancing giúp website chịu được spike traffic từ chiến dịch SEO, giữ TTFB và Core Web Vitals ổn định, củng cố tín hiệu tin cậy kỹ thuật trong mắt Google và người dùng.

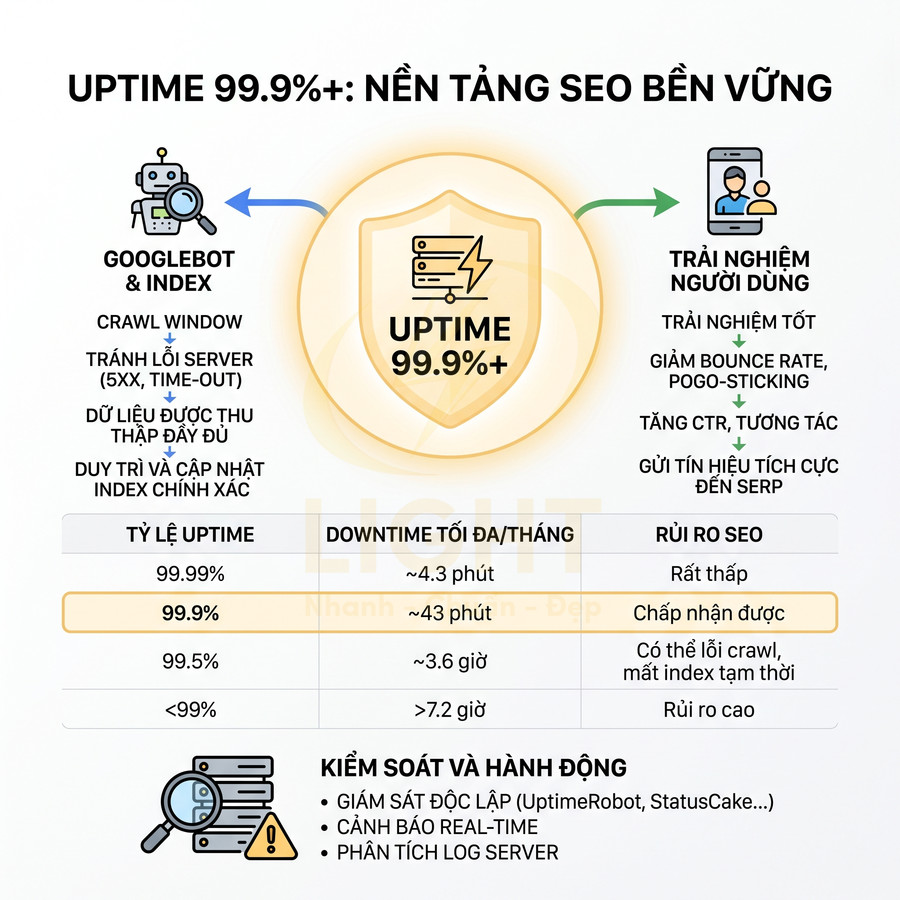

Uptime 99.9% trở lên để tránh mất crawl window và lỗi index

Uptime trong bối cảnh SEO cần được hiểu ở mức kỹ thuật sâu hơn là “site có lên hay không”. Về bản chất, uptime là tỷ lệ thời gian mà toàn bộ stack phục vụ web (web server, database, network, DNS, SSL, firewall, CDN…) hoạt động ổn định và trả về mã phản hồi hợp lệ (2xx, 3xx) với thời gian phản hồi chấp nhận được. Một site “sống” nhưng phản hồi 5–10 giây, trả 500 ngắt quãng hoặc time-out cũng có thể bị Google đánh giá như một site không ổn định.

Với SEO, uptime gắn trực tiếp với hai khái niệm quan trọng: crawl budget và crawl window. Googlebot không crawl site 24/7 với cường độ tối đa, mà phân bổ ngân sách crawl theo:

- Độ uy tín và độ quan trọng của domain.

- Số lượng URL có thể index.

- Khả năng chịu tải của server (crawl rate limit).

- Lịch sử lỗi server (5xx, time-out, connection reset…).

Mỗi khi Googlebot truy cập, nó “mở” một crawl window – khoảng thời gian và số request nhất định để thu thập dữ liệu. Nếu trong khoảng này site bị downtime, trả lỗi 5xx hoặc phản hồi quá chậm, Googlebot sẽ:

- Giảm tốc độ crawl để tránh gây tải cho server.

- Giảm tần suất quay lại, đặc biệt với các URL thường xuyên lỗi.

- Đánh dấu site là kém ổn định, ảnh hưởng đến việc cập nhật index.

Vì vậy, uptime 99.9% không chỉ là con số marketing. Ở mức 99.9%, downtime ~43 phút/tháng thường được phân tán thành các đợt bảo trì ngắn, ít khả năng trùng với các phiên crawl quan trọng. Trong khi đó, uptime 99.5% với ~3.6 giờ downtime/tháng có thể tạo ra:

- Nhiều “cửa sổ lỗi” trùng với thời điểm Googlebot crawl mạnh (sau khi bạn publish nội dung mới, chỉnh sửa cấu trúc, hoặc sau các đợt core update).

- Chuỗi lỗi 5xx lặp lại khiến Google tạm thời loại bỏ một số URL khỏi index hoặc giảm tần suất crawl toàn site.

- Giảm độ tin cậy của site trong các mô hình đánh giá chất lượng hạ tầng (site reliability signals).

| Uptime | Downtime tối đa/tháng | Rủi ro SEO |

|---|---|---|

| 99.99% | ~4.3 phút | Rất thấp, phù hợp site quan trọng, money site |

| 99.9% | ~43 phút | Chấp nhận được cho đa số website SEO |

| 99.5% | ~3.6 giờ | Có thể gây lỗi crawl, mất index tạm thời |

| < 99% | > 7.2 giờ | Rủi ro cao, không phù hợp website SEO nghiêm túc |

Ở góc độ trải nghiệm người dùng, downtime hoặc bán-downtime (site rất chậm, trả lỗi ngắt quãng) làm tăng mạnh:

- Bounce rate: người dùng thoát ngay khi không truy cập được hoặc chờ quá lâu.

- Pogo-sticking: người dùng quay lại SERP và click sang đối thủ, gửi tín hiệu tiêu cực về mức độ hài lòng.

- Giảm CTR dài hạn: nếu người dùng nhiều lần gặp lỗi với một domain, họ có xu hướng ít click vào domain đó trong tương lai, dù vẫn đang ở top.

Về mặt kỹ thuật, không nên chỉ dựa vào SLA mà nhà cung cấp công bố. SLA 99.9% trên giấy không đảm bảo uptime thực tế nếu:

- Downtime được “che” bằng các maintenance window không tính vào SLA.

- Nhà cung cấp chỉ đo uptime ở mức network, không đo ở mức ứng dụng (HTTP status, TTFB).

- Không có cam kết về thời gian phản hồi (response time SLA).

Để kiểm soát, nên triển khai monitoring độc lập:

- UptimeRobot, StatusCake, Pingdom để check HTTP/HTTPS, DNS, SSL, và ghi log chi tiết thời điểm downtime.

- Thiết lập cảnh báo real-time qua email, Telegram, Slack để xử lý nhanh khi có sự cố.

- Phân tích pattern downtime: có lặp lại vào giờ cao điểm, khi backup, khi deploy code, hay khi Googlebot crawl mạnh (dựa trên log server)?

Nếu ghi nhận:

- Downtime lặp lại theo chu kỳ (ví dụ mỗi đêm khi backup, CPU I/O bị nghẽn).

- Spike 5xx khi traffic tăng nhẹ (chưa đến mức viral).

- Thời gian TTFB tăng đột biến khi Googlebot crawl nhiều URL.

cần cân nhắc nâng cấp gói, chuyển sang VPS/dedicated hoặc đổi nhà cung cấp hosting. Với các dự án SEO dài hạn, đặc biệt là money site, mục tiêu thực tế nên hướng tới 99.95%–99.99% uptime thực đo, không chỉ dựa trên cam kết.

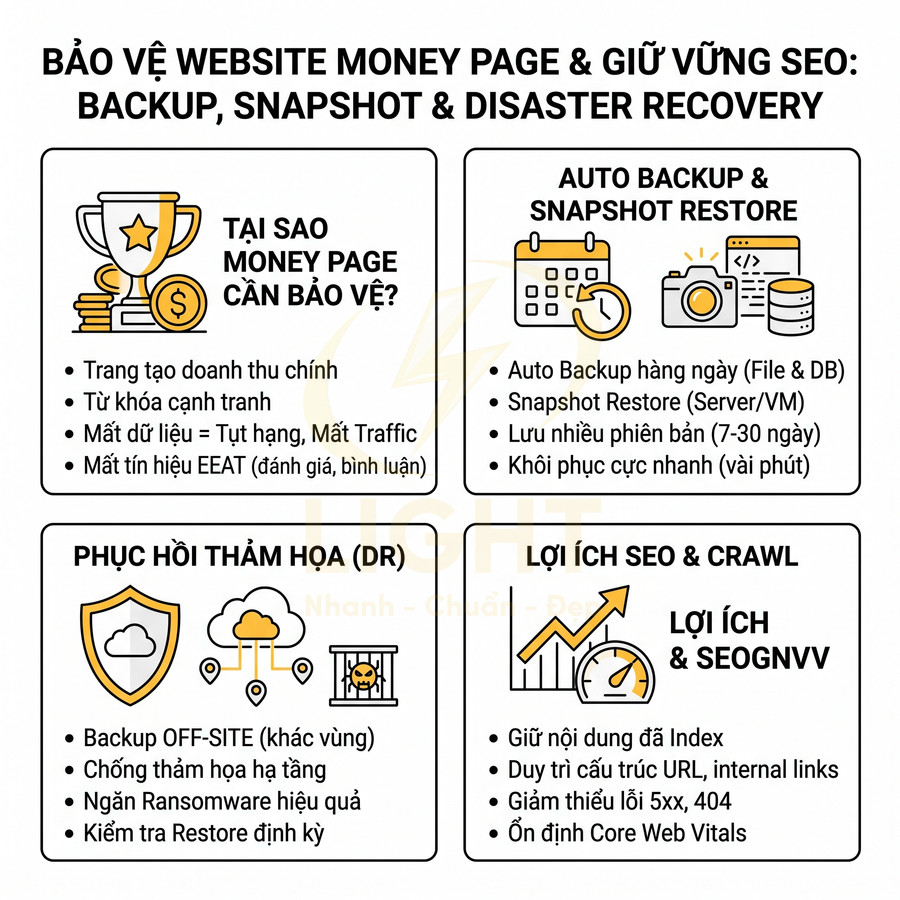

Auto backup, snapshot restore và disaster recovery cho website money page

Backup trong bối cảnh SEO không chỉ là “có bản sao dữ liệu” mà là khả năng khôi phục chính xác trạng thái SEO của site tại một thời điểm: nội dung, cấu trúc URL, internal link, redirect, schema, meta data, robots.txt, .htaccess, cấu hình cache/CDN… Một sai sót nhỏ như mất file .htaccess hoặc plugin SEO cũng có thể:

- Xóa sạch redirect 301, làm mất toàn bộ equity từ các URL cũ.

- Mở index cho các trang mỏng nội dung, tag, search result nội bộ.

- Thay đổi canonical, meta robots, gây deindex hàng loạt.

Với các money page (trang mang lại doanh thu trực tiếp, lead chất lượng, hoặc là landing chính cho keyword cạnh tranh), rủi ro mất dữ liệu hoặc mất cấu trúc SEO có thể dẫn đến:

- Tụt hạng đột ngột cho các từ khóa chính, mất traffic organic trong thời gian dài.

- Mất toàn bộ lịch sử tương tác người dùng (comment, review, rating) – những yếu tố hỗ trợ E-E-A-T.

- Phải re-crawl, re-index và re-evaluate từ đầu, mất nhiều tháng để phục hồi.

Hosting chuẩn SEO cần đáp ứng tối thiểu:

- Auto backup hàng ngày (hoặc hàng giờ với site thay đổi liên tục), bao gồm file + database.

- Lưu trữ nhiều phiên bản backup (7–30 phiên bản) để có thể quay lại trước khi lỗi xảy ra mà vẫn không mất quá nhiều dữ liệu mới.

- Snapshot restore ở cấp độ server/VM/container, cho phép khôi phục toàn bộ stack trong vài phút.

- Backup offsite (khác datacenter, khác region) để phòng trường hợp sự cố hạ tầng diện rộng.

Auto backup giúp:

- Rollback nhanh khi deploy plugin/theme mới gây xung đột, làm hỏng cấu trúc HTML, schema hoặc gây lỗi 5xx hàng loạt.

- Khôi phục nội dung bị xóa nhầm, đặc biệt là các bài viết đã có nhiều backlink, social signal.

- Giảm thời gian site ở trạng thái lỗi (5xx, 404 hàng loạt), hạn chế tín hiệu tiêu cực gửi tới Google.

Snapshot restore ở cấp độ hạ tầng có lợi thế:

- Khôi phục đồng bộ file, database, cấu hình web server, PHP, cache, firewall… tránh tình trạng “khôi phục nửa vời” gây lỗi khó đoán.

- Rút ngắn RTO (Recovery Time Objective) – thời gian cần để hệ thống hoạt động lại, từ hàng giờ xuống vài phút.

- Giữ nguyên fingerprint kỹ thuật (header, TLS, IP, cấu trúc response) giúp Google không phải đánh giá lại như một môi trường mới hoàn toàn.

Disaster recovery (DR) là lớp bảo vệ cao hơn, tập trung vào các kịch bản xấu nhất:

- Hỏng toàn bộ datacenter, mất điện, cháy nổ, thiên tai.

- Tấn công ransomware mã hóa dữ liệu, xóa backup nội bộ.

- Lỗi cấu hình diện rộng từ phía nhà cung cấp (misconfiguration network, storage, hypervisor).

Một kế hoạch DR tốt cho SEO thường bao gồm:

- Backup định kỳ ra storage độc lập (S3, object storage, external backup provider).

- Kiểm tra định kỳ khả năng restore (test restore) để đảm bảo backup không bị corrupt.

- Tài liệu hóa quy trình khôi phục: ai làm, làm gì, trong bao lâu, ưu tiên khôi phục money page và các section quan trọng trước.

Với SEO, khả năng khôi phục nhanh và chính xác giúp:

- Tránh mất nội dung đã index do xóa nhầm, lỗi deploy hoặc hack, giữ nguyên lịch sử tín hiệu on-page và off-page.

- Giữ nguyên cấu trúc URL, internal link, schema, breadcrumb, giúp Google không phải re-evaluate toàn bộ site và hạn chế biến động thứ hạng.

- Giảm thời gian website ở trạng thái lỗi, giữ cho các chỉ số crawl, index, Core Web Vitals và tín hiệu hành vi ổn định.

Hosting chỉ backup thủ công hoặc yêu cầu gửi ticket để restore thường không đáp ứng được yêu cầu của các dự án SEO nghiêm túc. Khi đánh giá nhà cung cấp, cần làm rõ:

- Tần suất backup (daily, hourly, incremental hay full).

- Số phiên bản backup được giữ lại và thời gian lưu trữ (retention policy).

- Khả năng tự restore qua control panel hay phải chờ support (ảnh hưởng trực tiếp đến RTO).

- Backup lưu cùng server, cùng rack, cùng datacenter hay ở datacenter khác (offsite, cross-region).

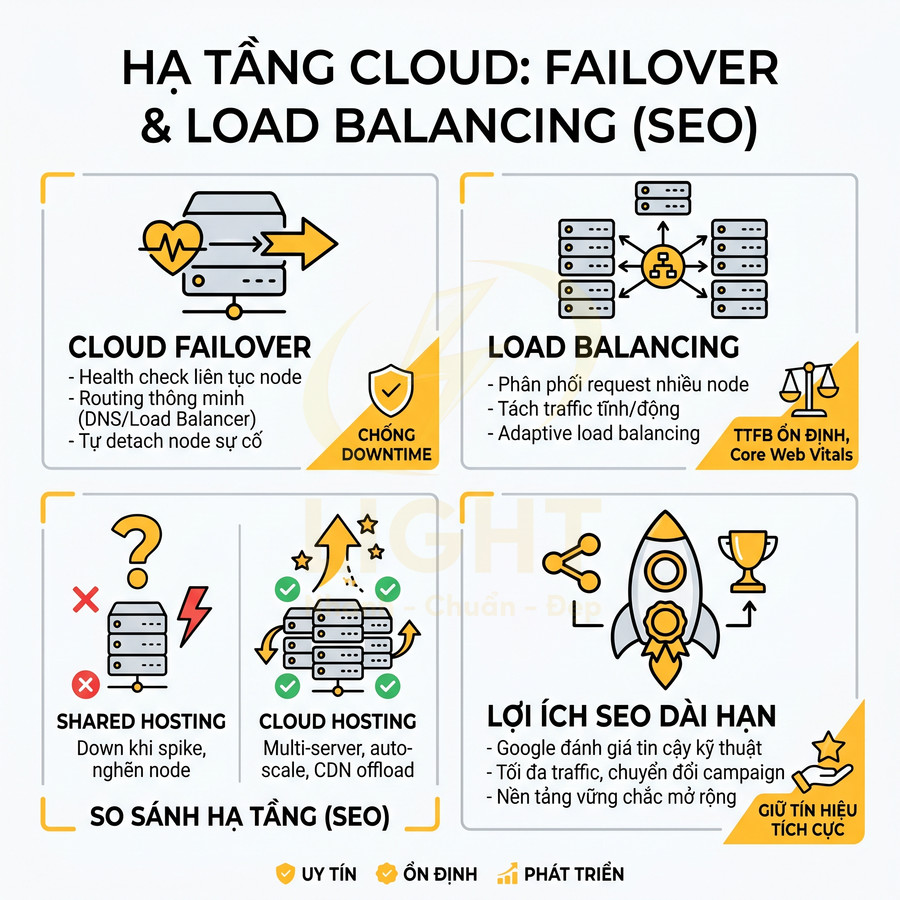

Cloud failover và load balancing khi traffic tăng đột biến từ chiến dịch SEO

Khi chiến dịch SEO thành công, traffic thường không tăng tuyến tính mà tăng theo dạng “spike”: một bài viết lên top, được share mạnh, được báo lớn nhắc đến, hoặc một landing page ecommerce được đẩy mạnh qua nhiều kênh cùng lúc. Nếu hạ tầng hosting không được thiết kế để hấp thụ các spike này, hệ quả thường thấy:

- CPU, RAM, I/O bị bão hòa, dẫn đến TTFB tăng vọt, request time-out.

- Web server (Apache, Nginx, LiteSpeed) hết worker/process, trả lỗi 502/503.

- Database bị lock, query chậm, gây hiệu ứng domino lên toàn bộ site.

Cloud failover và load balancing là hai cơ chế then chốt để duy trì hiệu năng và độ ổn định trong các kịch bản này. Có thể bổ sung rằng failover và load balancing là các cơ chế quan trọng để giảm rủi ro “điểm lỗi duy nhất” trong hạ tầng SEO. Trong kiến trúc CDN và hệ thống phân phối nội dung, khả năng mở rộng, độ tin cậy, bảo mật, khả năng đáp ứng và hiệu năng được xem là các mục tiêu kinh doanh cốt lõi của hạ tầng phân phối (Pathan et al., 2008). Khi áp dụng vào hosting SEO, load balancing giúp phân tán request giữa nhiều node, còn failover giúp chuyển traffic khỏi node lỗi. Nhờ đó, website có thể duy trì TTFB ổn định, giảm lỗi 5xx và bảo vệ crawl budget trong các đợt tăng traffic từ chiến dịch nội dung hoặc bán hàng.

Failover trong môi trường cloud thường hoạt động dựa trên:

- Health check liên tục tới các node (HTTP status, latency, error rate).

- Routing thông minh (DNS-based failover, anycast, hoặc load balancer layer 4/7) để chuyển traffic khỏi node lỗi sang node dự phòng.

- Khả năng tự động “detach” node gặp sự cố khỏi pool, tránh gửi thêm request vào một server đã quá tải hoặc đang down.

Với SEO, failover giúp:

- Giảm tối đa downtime thực tế khi một server gặp sự cố phần cứng, lỗi hệ điều hành, hoặc lỗi cấu hình.

- Giữ cho Googlebot luôn nhận được phản hồi ổn định, tránh chuỗi lỗi 5xx trên diện rộng.

- Đảm bảo trải nghiệm người dùng nhất quán trong các chiến dịch traffic lớn, duy trì các tín hiệu hành vi tích cực.

Load balancing phân phối request giữa nhiều backend server, có thể theo:

- Round-robin, least connections, IP hash, hoặc dựa trên hiệu năng thực tế (adaptive load balancing).

- Phân tách traffic tĩnh/động, mobile/desktop, hoặc theo khu vực địa lý.

Lợi ích trực tiếp cho SEO:

- Giữ TTFB ổn định ngay cả khi traffic tăng gấp nhiều lần, hỗ trợ Core Web Vitals (LCP, FID/INP, CLS).

- Giảm nguy cơ “nghẽn cổ chai” tại một node duy nhất, tránh tình trạng một server quá tải kéo cả site xuống.

- Cho phép scale-out (thêm node mới) khi cần, thay vì chỉ scale-up (tăng cấu hình một server) với giới hạn phần cứng.

Hosting truyền thống, đặc biệt là shared hosting, thường có các hạn chế:

- Không có failover thực sự: nếu server vật lý gặp sự cố, toàn bộ site trên đó đều down cho đến khi được khắc phục.

- Không có load balancing: tất cả traffic dồn vào một instance, dễ quá tải khi có spike.

- Giới hạn tài nguyên cứng (CPU, RAM, I/O, concurrent connection) cho mỗi account, dễ bị throttling khi traffic tăng.

Ngược lại, cloud hosting hoặc kiến trúc multi-server cho phép:

- Triển khai nhiều web node phía sau load balancer, có thể auto-scale dựa trên CPU, request per second, hoặc latency.

- Tách database sang cluster riêng (master/replica), giảm tải cho web node và tăng khả năng chịu tải đọc/ghi.

- Kết hợp với CDN để offload traffic tĩnh (image, CSS, JS), giảm áp lực lên origin server.

Điều này đặc biệt quan trọng cho:

- Website tin tức, blog lớn thường xuyên có bài viral, cần đảm bảo không sập khi được báo lớn, mạng xã hội hoặc aggregator trỏ link.

- Ecommerce chạy campaign SEO kết hợp quảng cáo, affiliate, email marketing, remarketing – traffic có thể tăng đột biến trong các khung giờ vàng.

- SaaS, landing page B2B nhận traffic từ nhiều kênh cùng lúc (SEO, PPC, social, referral), nơi mỗi phiên truy cập có giá trị cao và downtime đồng nghĩa với mất lead.

Ở góc độ SEO dài hạn, việc đầu tư vào hạ tầng có failover và load balancing không chỉ để “chống sập” mà còn để:

- Giữ cho các chỉ số hiệu năng ổn định trong mọi kịch bản, giúp Google đánh giá site là đáng tin cậy về mặt kỹ thuật.

- Đảm bảo rằng mỗi chiến dịch SEO thành công đều được chuyển hóa tối đa thành traffic, chuyển đổi và tín hiệu hành vi tích cực, thay vì bị triệt tiêu bởi sự cố hạ tầng.

- Tạo nền tảng vững chắc để mở rộng nội dung, mở rộng thị trường mà không phải lo lắng về giới hạn của một server đơn lẻ.

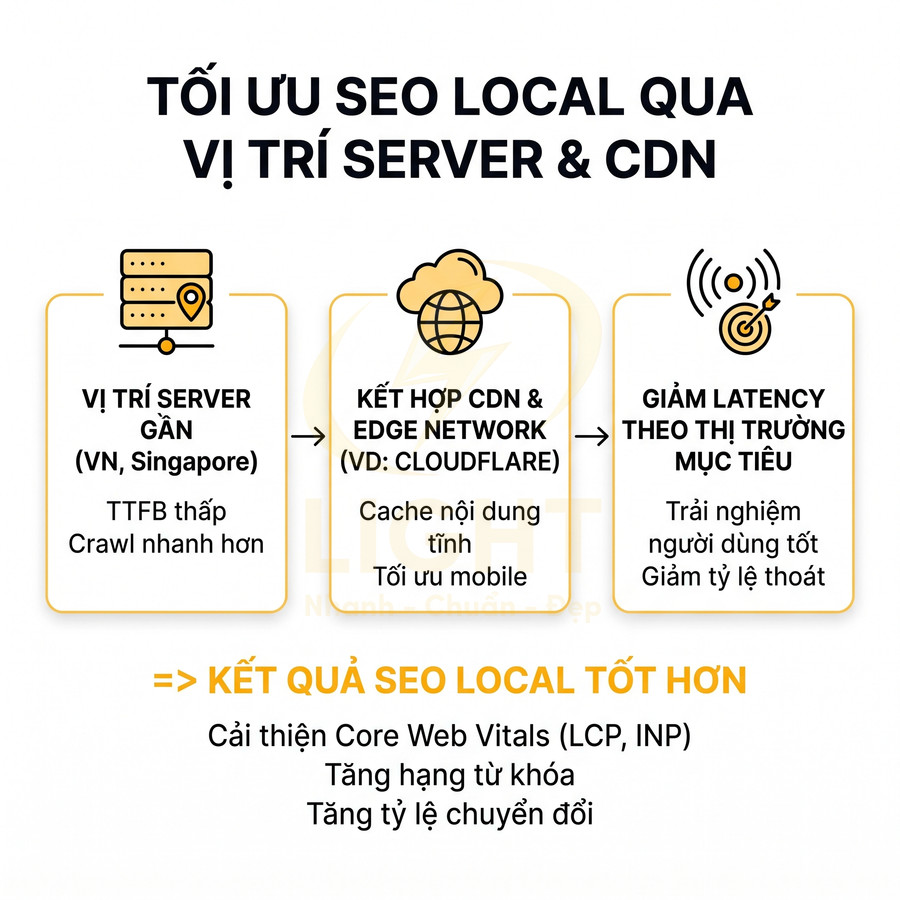

Vị trí server, CDN và latency theo thị trường mục tiêu giúp SEO local tốt hơn như thế nào

Vị trí server và cách triển khai CDN quyết định trực tiếp đến latency, từ đó chi phối TTFB, Core Web Vitals và khả năng crawl – những yếu tố nền tảng cho SEO local. Khi datacenter đặt gần thị trường mục tiêu (Việt Nam, Singapore, US/EU), khoảng cách mạng rút ngắn, độ trễ giảm, giúp trang phản hồi nhanh hơn đối thủ nội địa và giữ ổn định trải nghiệm trên mobile. Kết hợp CDN/edge network như Cloudflare cho phép cache nội dung tĩnh (thậm chí HTML ít thay đổi) tại các PoP gần người dùng, giảm tải server gốc và hạn chế downtime, đồng thời bổ sung lớp bảo mật (WAF, DDoS). Với ecommerce đa vùng và website đa ngôn ngữ, tối ưu geo latency qua lựa chọn datacenter trung tâm, CDN nhiều PoP, Anycast DNS và cấu trúc URL rõ ràng giúp tăng chuyển đổi, giảm bỏ giỏ và củng cố tín hiệu chất lượng cho từng khu vực.

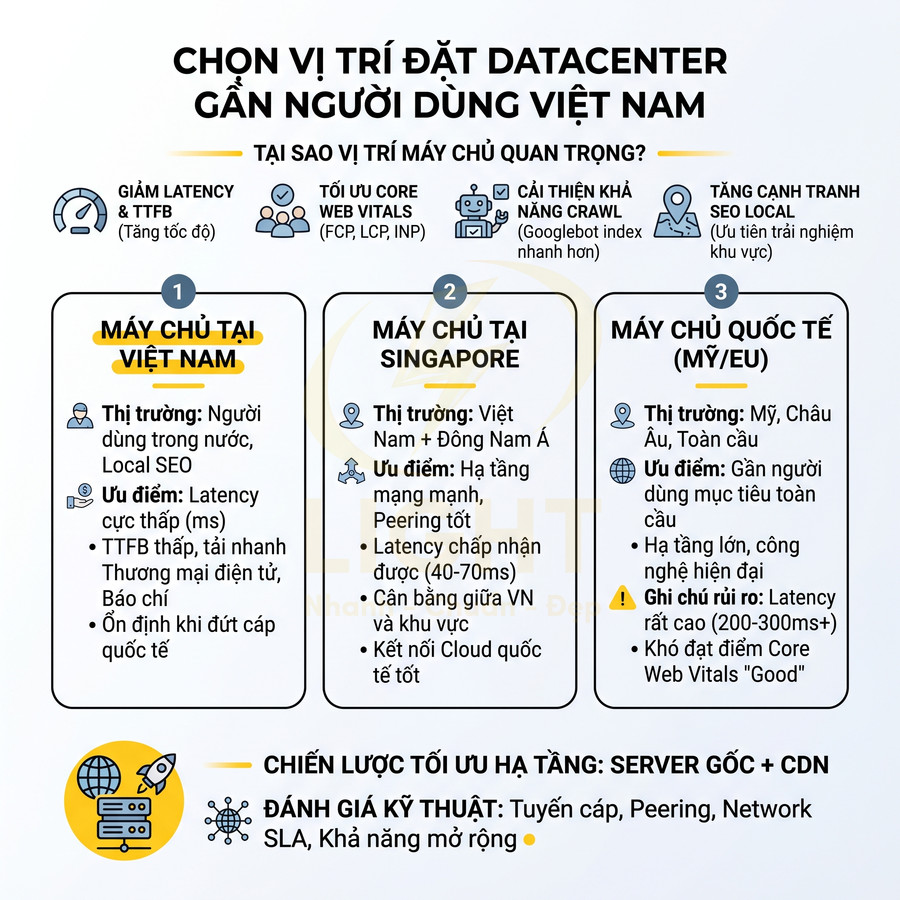

Chọn datacenter gần người dùng Việt Nam, Singapore hoặc thị trường quốc tế

Vị trí datacenter không chỉ ảnh hưởng đến latency mà còn tác động trực tiếp đến nhiều chỉ số kỹ thuật quan trọng cho SEO như TTFB (Time To First Byte), FCP (First Contentful Paint), LCP (Largest Contentful Paint) và mức độ ổn định của kết nối. Về bản chất, latency là độ trễ mạng phát sinh từ khoảng cách vật lý, số hop router trung gian, chất lượng tuyến cáp và khả năng peering giữa nhà mạng người dùng với datacenter. Khi latency cao, TTFB tăng, kéo theo toàn bộ chuỗi render phía trình duyệt bị chậm, đặc biệt với các trang có nhiều request đến server gốc. Vị trí datacenter nên được đánh giá bằng độ trễ mạng thực tế, không chỉ bằng tên quốc gia đặt máy chủ. Arapakis, Park và Pielot (2021) cho thấy độ trễ phản hồi ảnh hưởng rõ đến trải nghiệm tìm kiếm trên di động; khi độ trễ vượt một ngưỡng nhất định, người dùng báo cáo cảm giác khó chịu, chậm chạp và mệt mỏi hơn. Điều này đặc biệt quan trọng với SEO local vì người dùng thường truy cập bằng điện thoại và mạng di động. Vì vậy, server gần thị trường mục tiêu, kết hợp CDN và DNS nhanh, sẽ giúp giảm TTFB, cải thiện LCP và tăng khả năng cạnh tranh với các website nội địa.

Trong bối cảnh SEO local, Google ngày càng ưu tiên trải nghiệm người dùng theo khu vực. Một website có nội dung tốt nhưng tốc độ phản hồi chậm hơn đáng kể so với đối thủ nội địa sẽ bị bất lợi về:

- Tỷ lệ thoát (bounce rate) tăng, thời gian on-site giảm, giảm tín hiệu tương tác tích cực.

- Core Web Vitals kém, đặc biệt là LCP và FID/INP, ảnh hưởng trực tiếp đến đánh giá chất lượng trải nghiệm trang.

- Khả năng crawl của Googlebot bị giới hạn nếu server phản hồi chậm hoặc thường xuyên timeout, làm giảm tần suất cập nhật nội dung trên chỉ mục.

Với thị trường Việt Nam, hai lựa chọn phổ biến là:

- Server tại Việt Nam: latency nội địa thường chỉ vài ms đến vài chục ms, giúp TTFB rất thấp cho user trong nước. Phù hợp cho:

- Website ecommerce có nhiều thao tác giỏ hàng, thanh toán, lọc sản phẩm theo thời gian thực.

- Báo chí, portal, mạng xã hội nội bộ cần tải nhanh cho lượng truy cập lớn trong nước.

- Các hệ thống có nhiều request động, API nội bộ, nơi CDN khó cache toàn bộ nội dung.

- Server tại Singapore: là điểm trung chuyển quốc tế lớn, có hạ tầng datacenter và mạng backbone mạnh, peering tốt với nhiều ISP trong khu vực. Latency từ Việt Nam sang Singapore thường ở mức chấp nhận được cho SEO (thường 40–70ms tùy tuyến). Lựa chọn này phù hợp khi:

- Website phục vụ đồng thời Việt Nam và các nước Đông Nam Á như Thái Lan, Indonesia, Malaysia.

- Cần kết nối ổn định với các dịch vụ cloud quốc tế (RDS, object storage, microservices) đặt tại Singapore.

- Muốn tận dụng hệ sinh thái cloud lớn (AWS, GCP, Azure, DigitalOcean, Linode…) với chi phí và tài nguyên linh hoạt.

Đối với website nhắm thị trường quốc tế (Mỹ, EU, global), việc chọn datacenter nên dựa trên:

- Tỷ lệ phân bổ user theo khu vực (dựa trên Google Analytics, log server, dữ liệu CRM).

- Khoảng cách mạng đến các thị trường chính (dùng công cụ đo latency, traceroute từ nhiều điểm khác nhau).

- Chiến lược mở rộng: ưu tiên đặt server gốc tại khu vực có user cao nhất, sau đó dùng CDN để phủ các vùng còn lại.

Nếu đặt server quá xa thị trường chính, ví dụ server ở Mỹ cho website chỉ phục vụ Việt Nam, các vấn đề thường gặp:

- Latency 200–300ms hoặc hơn, khiến TTFB tăng mạnh, đặc biệt với kết nối di động.

- Core Web Vitals khó đạt ngưỡng “Good” trên PageSpeed Insights cho user thực tế (field data).

- Khả năng cạnh tranh với website đối thủ đặt server gần user bị suy giảm, dù nội dung và backlink tương đương.

| Vị trí server | Thị trường phù hợp | Ưu điểm |

|---|---|---|

| Việt Nam | SEO thị trường Việt Nam, user chủ yếu trong nước | Latency thấp, tốc độ nhanh, phù hợp local SEO |

| Singapore | Việt Nam + Đông Nam Á | Hạ tầng tốt, cân bằng giữa VN và khu vực |

| US/EU | Thị trường Mỹ, châu Âu | Gần user mục tiêu, dễ tích hợp CDN global |

Khi chọn hosting, ngoài vị trí datacenter cần đánh giá sâu hơn các yếu tố kỹ thuật:

- Chất lượng tuyến cáp và peering với ISP địa phương: cùng đặt tại Singapore nhưng nhà cung cấp A có tuyến về Việt Nam tốt hơn nhà cung cấp B, dẫn đến latency và packet loss khác biệt rõ rệt.

- Network SLA, băng thông quốc tế, khả năng chống DDoS ở tầng mạng, ảnh hưởng đến độ ổn định crawl của Googlebot.

- Khả năng mở rộng qua CDN: hỗ trợ HTTP/2, HTTP/3, TLS hiện đại, IP Anycast, dễ tích hợp với Cloudflare, Fastly, Akamai…

Việc tối ưu vị trí server và tuyến mạng giúp website duy trì tốc độ tốt cho cả người dùng hiện tại và các thị trường mở rộng trong tương lai, giảm rủi ro phải di chuyển hạ tầng phức tạp khi đã có nhiều traffic và dữ liệu.

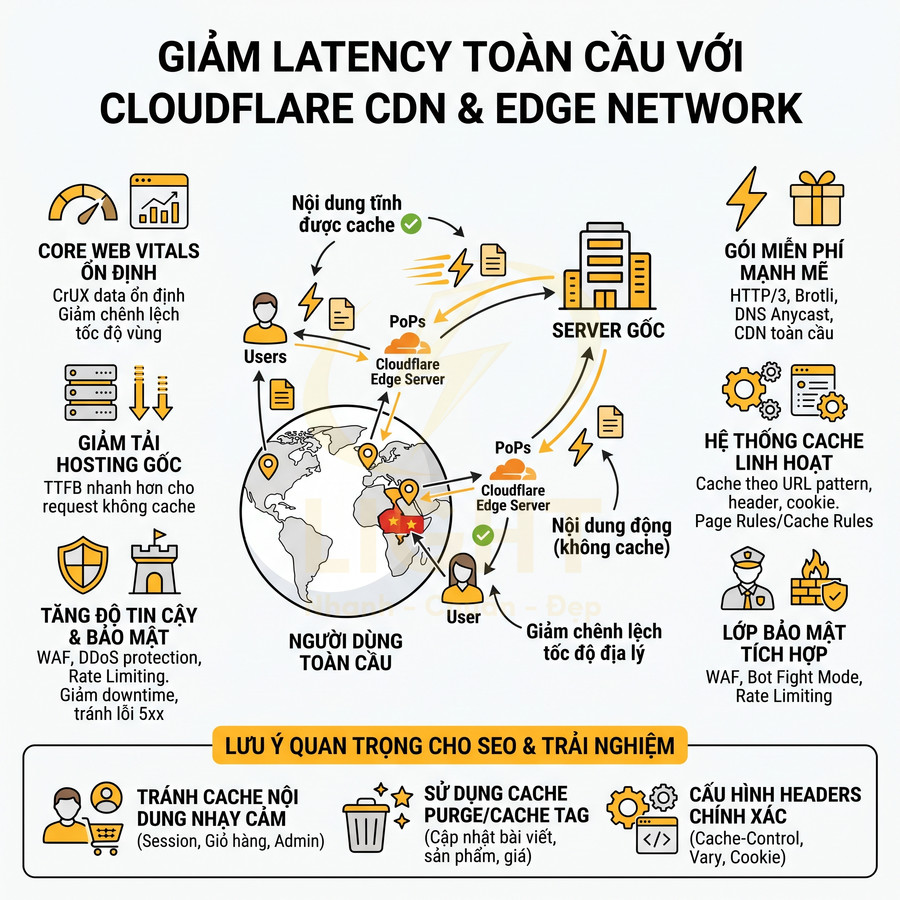

Kết hợp CDN của Cloudflare hoặc edge network để giảm latency toàn cầu

CDN (Content Delivery Network) hoạt động như một lớp phân phối nội dung trung gian giữa người dùng và server gốc. Thay vì mọi request đều phải đi đến datacenter chính, CDN sẽ:

- Lưu cache nội dung tĩnh (CSS, JS, hình ảnh, font, video tĩnh, file tải về) tại các edge server gần user.

- Trong một số cấu hình nâng cao, có thể cache cả HTML cho các trang ít thay đổi, hoặc sử dụng full-page caching kết hợp với cơ chế purge thông minh.

- Tối ưu giao thức truyền tải (HTTP/2, HTTP/3/QUIC), nén dữ liệu (Brotli, Gzip), TLS session resumption, giúp giảm thời gian thiết lập kết nối.

Đối với SEO, CDN mang lại nhiều lợi ích gián tiếp nhưng rất quan trọng:

- Giảm chênh lệch tốc độ giữa các khu vực địa lý: user ở Mỹ, EU, Đông Nam Á đều được phục vụ từ PoP gần nhất, giúp Core Web Vitals ổn định hơn trên dữ liệu thực tế (CrUX).

- Giảm tải cho hosting gốc: phần lớn request tĩnh được xử lý ở edge, server gốc tập trung cho nội dung động, truy vấn database, logic ứng dụng. Khi server gốc ít bị quá tải, TTFB cho request không cache cũng được cải thiện.

- Tăng độ tin cậy và bảo mật: nhiều CDN tích hợp WAF, rate limiting, bot management, DDoS protection. Website ít downtime hơn, giảm nguy cơ Googlebot gặp lỗi 5xx, từ đó giữ vững tín hiệu chất lượng.

Cloudflare đặc biệt phổ biến nhờ:

- Gói miễn phí nhưng hỗ trợ HTTP/3, Brotli, CDN toàn cầu, DNS Anycast tốc độ cao.

- Hệ thống cache rule linh hoạt: cache theo URL pattern, header, cookie, kết hợp với Page Rules hoặc Cache Rules nâng cao.

- Các lớp bảo mật như WAF, rate limiting, bot fight mode, giúp giảm traffic xấu, bảo vệ tài nguyên server.

Khi kết hợp hosting tốt với Cloudflare hoặc các edge network tương tự, website có thể đạt TTFB thấp cho người dùng toàn cầu ngay cả khi server gốc chỉ đặt tại một khu vực. Tuy nhiên, để tránh ảnh hưởng xấu đến trải nghiệm và SEO, cần chú ý:

- Không cache nhầm nội dung động liên quan đến session, giỏ hàng, trang tài khoản, trang admin.

- Cấu hình cache bypass cho các URL chứa tham số nhạy cảm (token, session id) hoặc các endpoint API.

- Sử dụng cơ chế cache purge hoặc cache tag để làm mới nội dung khi cập nhật bài viết, sản phẩm, giá.

- Đảm bảo header cache-control, vary, cookie được thiết kế đúng để CDN hiểu rõ nội dung nào có thể cache an toàn.

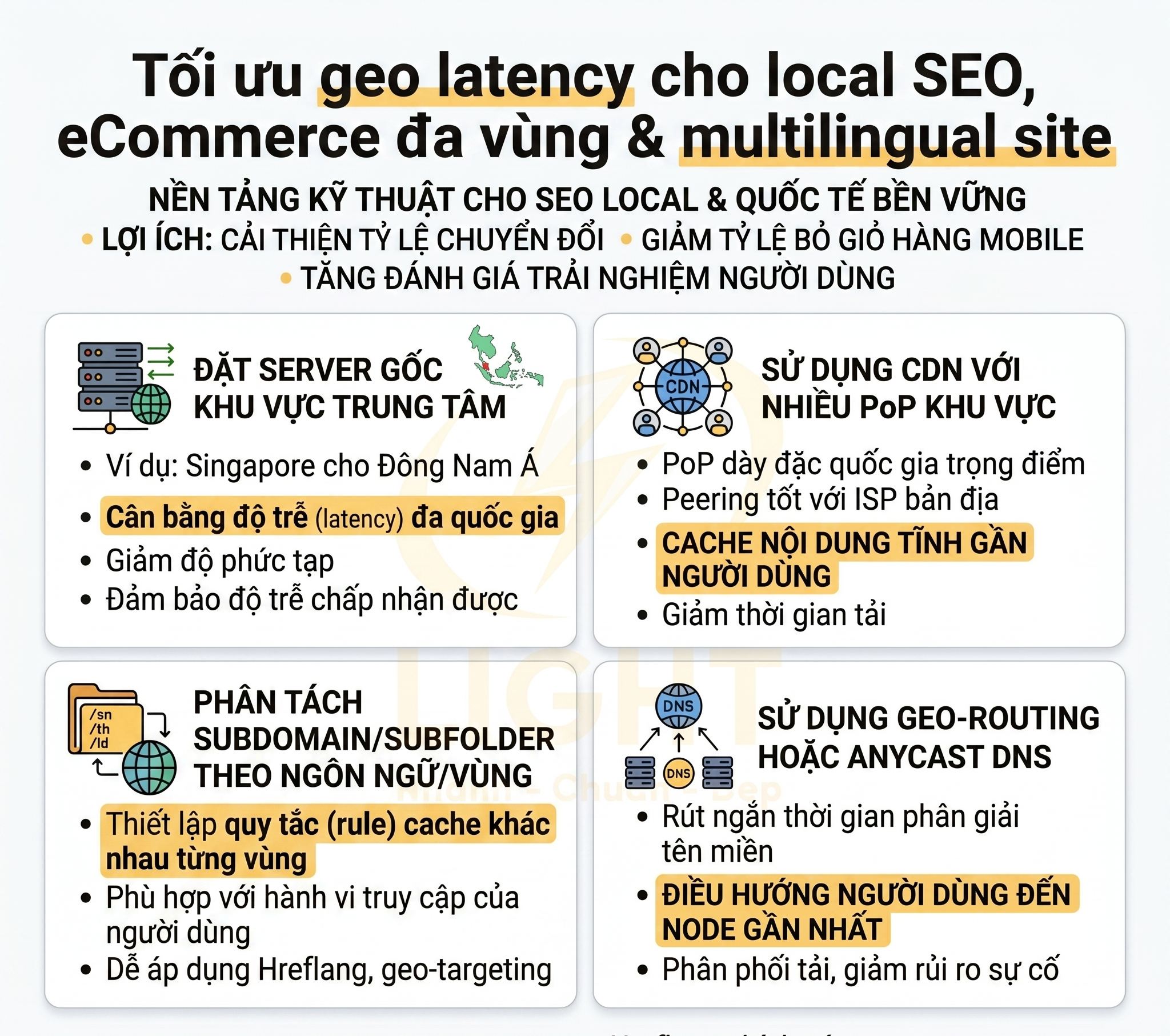

Tối ưu geo latency cho local SEO, ecommerce đa vùng và multilingual site

Đối với local SEO, ecommerce đa vùng hoặc website đa ngôn ngữ, tối ưu geo latency là nền tảng kỹ thuật để mọi nỗ lực nội dung và onpage phát huy tối đa. Khi mỗi nhóm user ở từng quốc gia đều có tốc độ tải trang tương đương hoặc tốt hơn đối thủ nội địa, website sẽ:

- Cải thiện tỷ lệ chuyển đổi (conversion rate) trên từng thị trường.

- Giảm tỷ lệ bỏ giỏ hàng trên mobile, đặc biệt với các bước thanh toán nhiều bước.

- Tăng khả năng được Google đánh giá cao về trải nghiệm người dùng tại từng khu vực.

Các chiến lược tối ưu geo latency bao gồm:

- Đặt server gốc tại khu vực trung tâm (ví dụ Singapore cho Đông Nam Á) để cân bằng latency giữa nhiều quốc gia. Cách này giúp giảm độ phức tạp so với việc triển khai nhiều server gốc riêng lẻ, đồng thời vẫn đảm bảo latency ở mức chấp nhận được khi kết hợp CDN.

- Sử dụng CDN với nhiều PoP trong khu vực mục tiêu: ưu tiên nhà cung cấp có số lượng PoP dày đặc tại các quốc gia trọng điểm, có peering tốt với ISP bản địa. Điều này giúp nội dung tĩnh được cache gần người dùng, giảm đáng kể thời gian tải tài nguyên nặng như hình ảnh, video, JS bundle.

- Phân tách subdomain hoặc subfolder theo ngôn ngữ/vùng (ví dụ /vn, /th, /id) và cấu hình cache riêng:

- Thiết lập rule cache khác nhau cho từng vùng, phù hợp với hành vi truy cập và tần suất cập nhật nội dung.

- Dễ dàng áp dụng hreflang, geo-targeting trong Google Search Console cho từng thư mục hoặc subdomain.

- Sử dụng geo-routing hoặc Anycast DNS để điều hướng người dùng đến node gần nhất:

- Anycast DNS giúp rút ngắn thời gian phân giải tên miền, đặc biệt quan trọng khi website có nhiều request đến domain chính và subdomain tĩnh.

- Geo-routing có thể kết hợp với multi-CDN hoặc multi-origin để phân phối tải theo khu vực, giảm rủi ro khi một tuyến mạng gặp sự cố.

Đối với multilingual site, tối ưu geo latency cần đi kèm với các yếu tố SEO quốc tế khác:

- Hreflang chính xác cho từng phiên bản ngôn ngữ/quốc gia, giúp Google phục vụ đúng phiên bản cho user ở từng thị trường.

- Cấu trúc URL rõ ràng (subfolder hoặc subdomain) để dễ quản lý cache, log, phân tích hiệu suất theo vùng.

- Nội dung bản địa hóa (localization) thay vì chỉ dịch ngôn ngữ, kết hợp với tốc độ tải nhanh để tăng mức độ phù hợp và tương tác.

Hosting và CDN trong bối cảnh này đóng vai trò như lớp hạ tầng chiến lược: nếu geo latency không được tối ưu, mọi nỗ lực về content, internal link, schema, backlink… đều bị “kìm hãm” bởi trải nghiệm tải trang kém ở một hoặc nhiều khu vực mục tiêu. Ngược lại, khi latency được kiểm soát tốt, website có nền tảng kỹ thuật vững chắc để mở rộng SEO local và SEO quốc tế một cách bền vững.

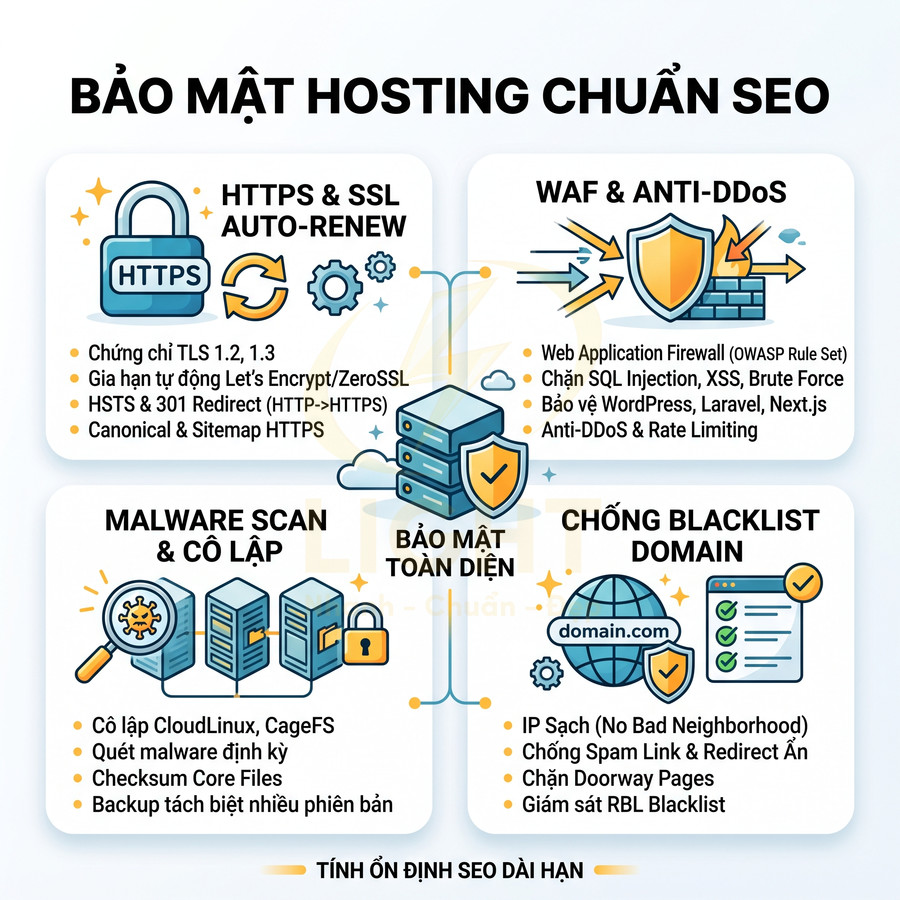

Bảo mật hosting chuẩn SEO: SSL, firewall, malware scan và chống blacklist domain

Bảo mật hosting chuẩn SEO tập trung vào việc bảo vệ website khỏi tấn công, duy trì độ tin cậy với Google và người dùng, đồng thời giữ cho tín hiệu xếp hạng ổn định. Lớp giao thức an toàn với HTTPS, TLS/SSL hiện đại, auto-renew và HSTS giúp tránh gián đoạn truy cập, giảm cảnh báo “Not secure”, hạn chế duplicate HTTP/HTTPS và củng cố tín hiệu E-E-A-T. Ở tầng ứng dụng, WAF, anti-DDoS và malware isolation lọc request độc hại, ngăn brute force, cô lập tài khoản, quét mã độc định kỳ để tránh spam link, redirect ẩn, doorway pages dẫn đến cảnh báo “This site may be hacked” hoặc deindex. Với shared hosting, yếu tố isolation, chống lây nhiễm chéo, IP sạch và backup tách biệt trở thành điều kiện bắt buộc để bảo vệ tài sản SEO dài hạn.

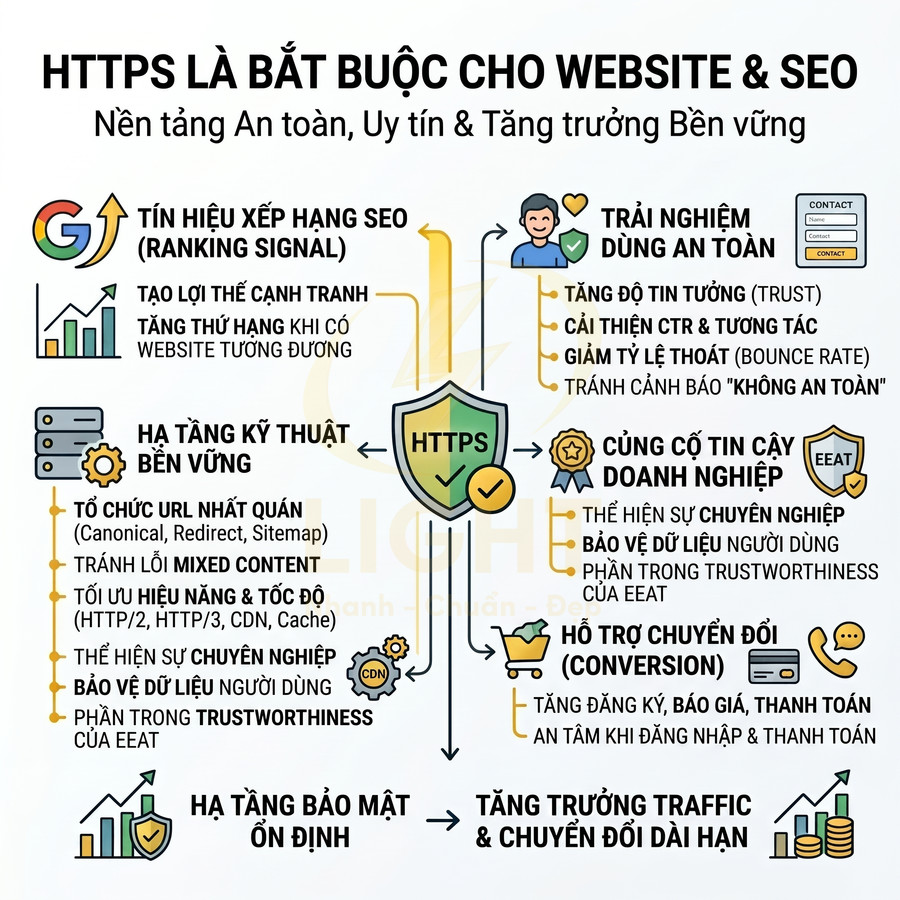

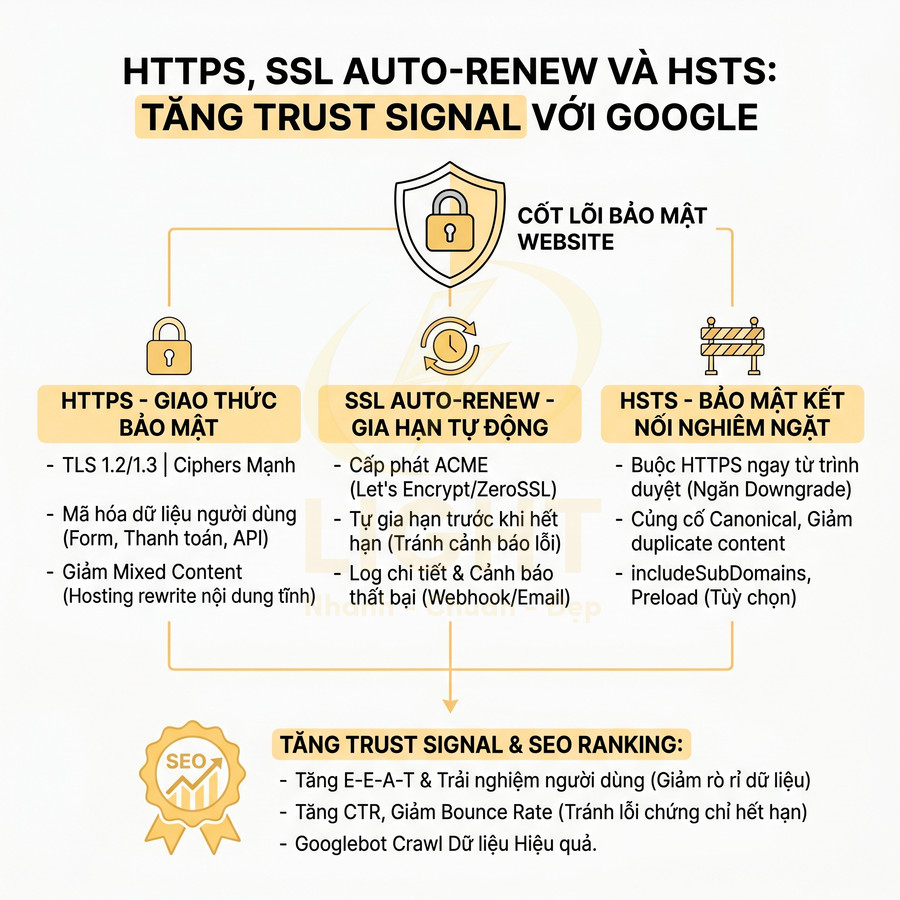

HTTPS, SSL auto-renew và HSTS giúp tăng trust signal với Google

Trong bối cảnh Core Web Vitals, E-E-A-T và trải nghiệm người dùng ngày càng được Google ưu tiên, lớp bảo mật ở tầng giao thức (HTTPS) không chỉ là yêu cầu kỹ thuật mà còn là một phần của chiến lược SEO tổng thể. Một hệ thống hosting chuẩn SEO cần được thiết kế để đảm bảo chuỗi bảo mật TLS/SSL hoạt động ổn định, tự động và hạn chế tối đa rủi ro gián đoạn. Ở phần bảo mật hosting, nên làm rõ rằng HTTPS là điều kiện nền tảng, nhưng quản trị chứng chỉ mới là yếu tố giúp duy trì sự ổn định dài hạn. Nếu chứng chỉ hết hạn hoặc cấu hình TLS sai, trình duyệt có thể hiển thị cảnh báo bảo mật, làm người dùng rời trang và khiến bot gặp khó khăn khi truy cập. NIST khuyến nghị tổ chức cần quản lý vòng đời chứng chỉ TLS bằng cách kiểm kê chứng chỉ, theo dõi ngày hết hạn, bảo vệ khóa riêng, tự động hóa gia hạn và có quy trình xử lý sự cố (National Institute of Standards and Technology, 2020). Vì vậy, SSL auto-renew và cảnh báo hết hạn là yêu cầu vận hành bắt buộc với website SEO nghiêm túc.

Về mặt kỹ thuật, HTTPS hoạt động dựa trên giao thức TLS (thường được gọi nhầm là SSL). Hosting chuẩn SEO nên hỗ trợ:

- SSL miễn phí (Let’s Encrypt, ZeroSSL…) với khả năng cấp phát tự động qua ACME.

- Auto-renew với cron job hoặc daemon chuyên dụng, tránh phụ thuộc thao tác thủ công.

- HSTS (HTTP Strict Transport Security) với thời gian hiệu lực đủ dài (ví dụ 6–12 tháng) và tùy chọn includeSubDomains, preload khi đã kiểm tra kỹ.

Khi chứng chỉ SSL hết hạn, trình duyệt sẽ hiển thị cảnh báo “Your connection is not private”, làm giảm mạnh CTR, tăng bounce rate và có thể khiến Googlebot tạm thời không crawl được một số URL. Điều này tạo ra chuỗi tín hiệu tiêu cực: giảm thời gian on-site, giảm số trang được crawl, tăng tỷ lệ lỗi trong Coverage report của Search Console. Cơ chế auto-renew giúp loại bỏ hoàn toàn rủi ro này bằng cách:

- Tự động kiểm tra hạn chứng chỉ và gia hạn trước khi hết hạn vài ngày.

- Ghi log chi tiết để dev/SEO có thể audit khi có sự cố.

- Gửi email hoặc webhook cảnh báo nếu quá trình renew thất bại.

HSTS đóng vai trò quan trọng trong việc ngăn chặn downgrade attack (tấn công ép người dùng quay về HTTP) và man-in-the-middle trên kết nối không mã hóa. Từ góc độ SEO kỹ thuật, HSTS còn giúp:

- Buộc mọi request chuyển sang HTTPS ngay từ phía trình duyệt, giảm nguy cơ index nhầm phiên bản HTTP.

- Giảm khả năng xuất hiện duplicate content giữa HTTP/HTTPS, hỗ trợ canonicalization rõ ràng hơn.

- Ổn định tín hiệu liên quan đến URL, giúp Google tập trung tín hiệu vào một phiên bản duy nhất.

Một cấu hình SSL chuẩn SEO thường bao gồm:

- Chỉ hỗ trợ các phiên bản TLS hiện đại (TLS 1.2, 1.3), vô hiệu hóa SSLv3, TLS 1.0, 1.1.

- Ưu tiên bộ cipher mạnh, hỗ trợ Perfect Forward Secrecy.

- Redirect 301 từ HTTP sang HTTPS ở tầng web server (Nginx/Apache) thay vì dùng JavaScript.

- Cấu hình canonical, sitemap và hreflang trỏ về phiên bản HTTPS.

Từ góc độ SEO, việc triển khai HTTPS và SSL đúng chuẩn mang lại các lợi ích chuyên sâu:

- Tăng độ tin cậy và tín hiệu E-E-A-T: người dùng có xu hướng tin tưởng hơn, đặc biệt với site thương mại, form lead, membership. Tỷ lệ chuyển đổi và engagement tốt hơn là tín hiệu gián tiếp hỗ trợ ranking.

- Bảo vệ dữ liệu người dùng: form đăng ký, đăng nhập, thanh toán, API endpoint đều được mã hóa, giảm nguy cơ rò rỉ dữ liệu dẫn đến khiếu nại, negative PR, hoặc bị Google gắn nhãn “Not secure”.

- Giảm lỗi mixed content: hosting nên hỗ trợ rewrite nội dung tĩnh (image, CSS, JS) sang HTTPS, hoặc cung cấp công cụ scan mixed content, giúp tránh lỗi render, block resource trên Chrome, từ đó cải thiện Core Web Vitals.

Đối với các stack hiện đại như Next.js, Laravel, WordPress, việc kết hợp HTTPS với reverse proxy (Nginx, Cloudflare) cần được cấu hình chuẩn (x-forwarded-proto, trust proxy) để:

- Đảm bảo canonical URL, sitemap, Open Graph, schema markup đều xuất ra HTTPS.

- Tránh redirect loop khi dùng CDN hoặc load balancer phía trước.

- Đảm bảo cookie bảo mật với flag Secure và HttpOnly, giảm nguy cơ XSS đánh cắp session.

Web Application Firewall, anti-DDoS và malware isolation cho WordPress, Laravel, Next.js

Website có traffic SEO cao là mục tiêu hấp dẫn cho tấn công vì chúng mang lại giá trị lớn khi bị chiếm quyền: có thể bơm link, chuyển hướng traffic, hoặc lợi dụng uy tín domain để đẩy các chiến dịch spam. Một nền tảng hosting chuẩn SEO cần tích hợp bảo mật ở nhiều lớp: từ edge (CDN, anti-DDoS), đến layer 7 (WAF), đến tầng hệ điều hành (isolation, permission) và tầng ứng dụng (scan malware, integrity check).

Web Application Firewall (WAF) hoạt động ở tầng HTTP/HTTPS, phân tích request theo rule set (OWASP Core Rule Set, custom rule) để chặn:

- SQL injection nhắm vào query database (đặc biệt phổ biến với form search, form contact, endpoint API).

- XSS (Cross-Site Scripting) chèn script vào nội dung, có thể dẫn đến chèn link spam hoặc chiếm session admin.

- Brute force login vào /wp-admin, /xmlrpc.php, /login, /admin…

- Path traversal, file inclusion, upload shell thông qua form upload.

WAF cần được trình bày như một lớp giảm rủi ro SEO, không chỉ là lớp bảo mật kỹ thuật. Canali và cộng sự (2013) nghiên cứu vai trò của nhà cung cấp hosting trong việc phát hiện website bị xâm nhập và cho thấy các website bị compromise có thể chứa mã độc, nội dung bị chèn hoặc hành vi độc hại mà chủ website không phát hiện ngay. Với SEO, các cuộc tấn công này thường biểu hiện dưới dạng spam link, redirect ẩn, doorway page hoặc nội dung lạ được index. Do đó, hosting có WAF, quét mã độc, giám sát file và cảnh báo bất thường giúp bảo vệ trực tiếp tài sản SEO, đặc biệt là website WordPress, Laravel và custom CMS.

Đối với WordPress, WAF nên có rule chuyên biệt:

- Giới hạn request đến wp-login.php, xmlrpc.php, REST API.

- Chặn pattern URL thường dùng trong exploit plugin/theme phổ biến.

- Rate limiting theo IP, country, user-agent để giảm brute force.

Với Laravel và Next.js, hosting cần hỗ trợ:

- Ẩn file .env, vô hiệu hóa hiển thị stack trace ở production.

- Chặn truy cập trực tiếp vào thư mục storage, node_modules, vendor.

- Giới hạn method và header bất thường, bảo vệ các route nhạy cảm (admin, API private).

Anti-DDoS ở tầng network và application giúp bảo vệ site khỏi việc bị flood request, làm cạn tài nguyên CPU/RAM, khiến website chậm hoặc down. Khi site SEO bị down thường xuyên, Googlebot sẽ:

- Giảm crawl rate để tránh gây tải thêm, dẫn đến index chậm nội dung mới.

- Tăng tỷ lệ lỗi 5xx trong Search Console, ảnh hưởng đến đánh giá độ ổn định.

- Có thể giảm tần suất xuất hiện trong SERP cho đến khi hệ thống đánh giá site ổn định trở lại.

Malware isolation là lớp bảo vệ quan trọng trên môi trường multi-tenant (shared, cloud). Thay vì để toàn bộ website trên cùng server có thể truy cập lẫn nhau, hosting chuẩn SEO cần:

- Sử dụng công nghệ như CloudLinux, CageFS, chroot để cô lập từng tài khoản.

- Giới hạn permission file/folder (không cho phép 777, hạn chế write ở thư mục nhạy cảm).

- Scan malware định kỳ, so sánh checksum core file (WordPress core, Laravel framework) để phát hiện thay đổi bất thường.

Khi một website bị hack, các hành vi thường gặp ảnh hưởng trực tiếp đến SEO:

- Chèn link spam vào nội dung, footer, widget, hoặc file template PHP/Blade/JS, làm loãng anchor text, giảm chất lượng outbound link.

- Tạo redirect ẩn chỉ kích hoạt với user-agent Googlebot hoặc traffic từ Google, khiến người dùng bị chuyển sang landing page spam, casino, thuốc, adult…

- Tạo doorway pages với hàng nghìn URL chứa từ khóa spam, tận dụng authority domain để đẩy nội dung rác.

Google có thể phát hiện dấu hiệu bị hack thông qua:

- Pattern nội dung bất thường, ngôn ngữ khác với phần còn lại của site.

- Anchor text, outbound link trỏ đến hệ thống site spam.

- Hành vi redirect khác nhau giữa user-agent, IP, referrer.

Khi đó, website có nguy cơ bị gắn nhãn “This site may be hacked”, bị giảm mạnh visibility, thậm chí deindex nhiều URL. Việc khôi phục thứ hạng thường kéo dài vì:

- Cần thời gian để dọn sạch mã độc, vá lỗ hổng, cập nhật plugin/theme/framework.

- Cần gửi yêu cầu xem xét lại (reconsideration request) nếu nhận manual action.

- Google cần thêm thời gian crawl lại, đánh giá lại chất lượng và độ tin cậy.

Do đó, đầu tư vào hosting có WAF, anti-DDoS, malware isolation và công cụ giám sát (log, alert, file integrity monitoring) là cách bảo vệ trực tiếp tài sản SEO, giảm rủi ro mất traffic đột ngột và chi phí khôi phục sau tấn công.

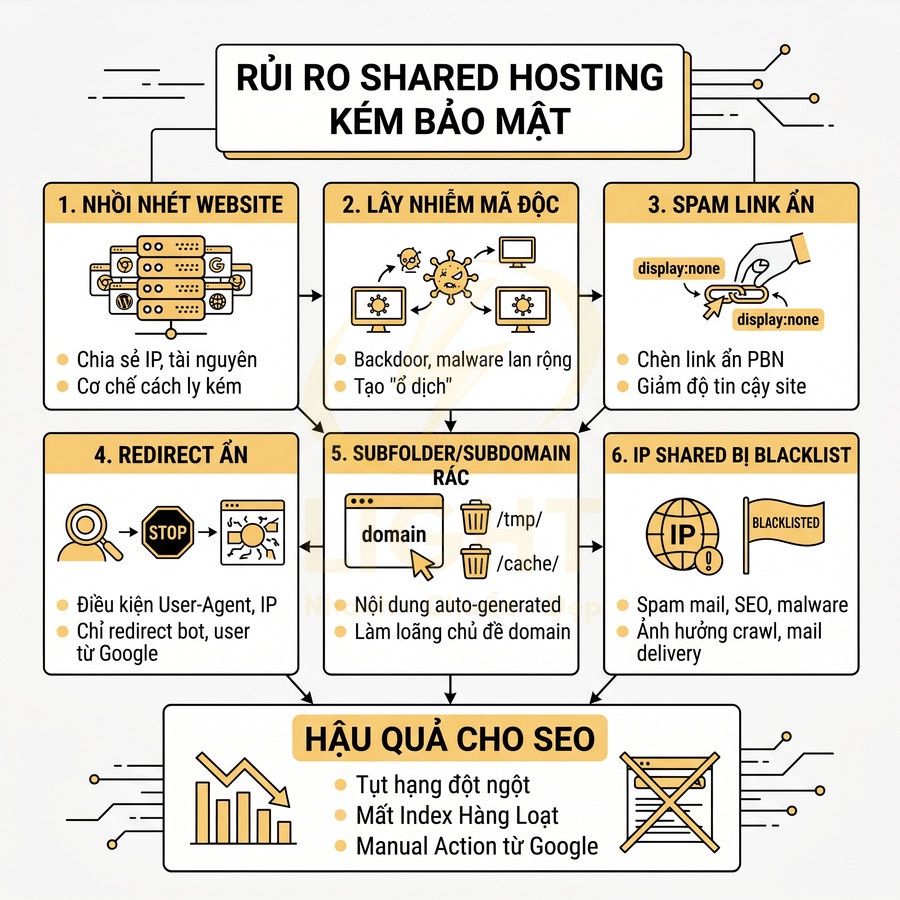

Shared hosting kém bảo mật dễ bị spam link, hack redirect và mất index hàng loạt

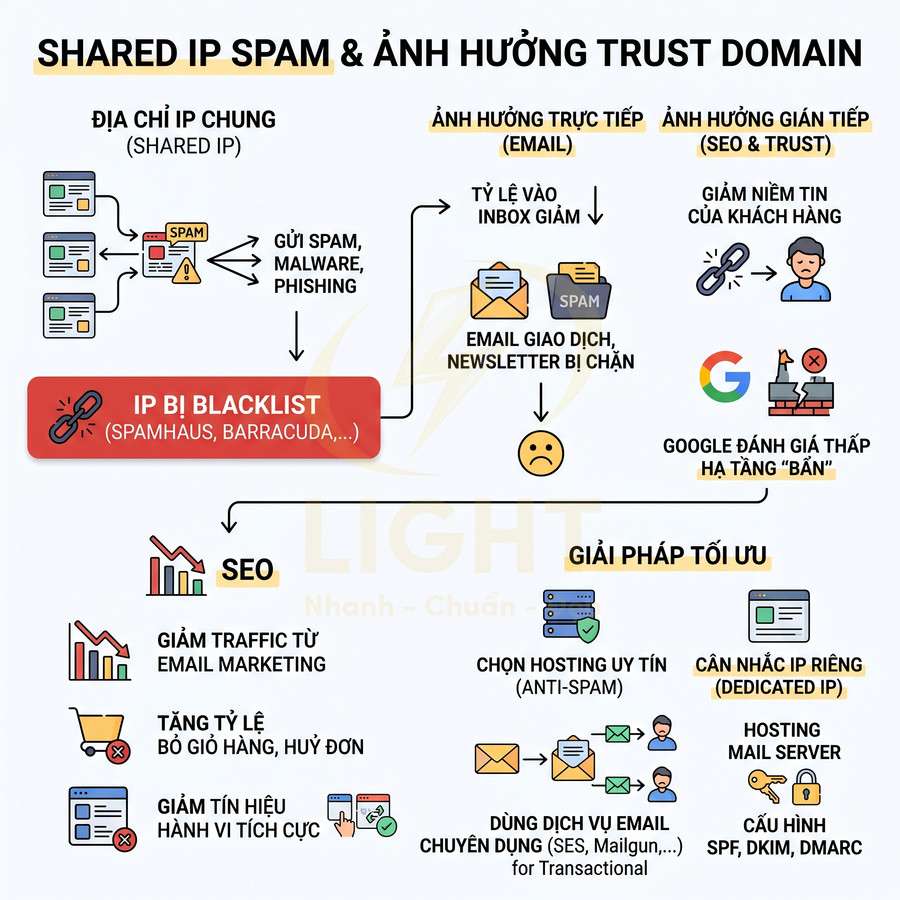

Shared hosting giá rẻ thường tối ưu chi phí bằng cách nhồi nhét rất nhiều website lên cùng một server, chia sẻ cùng IP, tài nguyên và đôi khi cả môi trường thực thi PHP/Node. Khi một website trên server bị xâm nhập, nếu cơ chế cách ly (isolation) không tốt, mã độc có thể quét và lây sang các tài khoản khác, tạo thành “ổ dịch” bảo mật, đặc biệt nguy hiểm với các site đang làm SEO. Rủi ro của shared hosting không chỉ đến từ việc chia sẻ CPU hoặc RAM, mà còn từ mô hình đặt nhiều website trong cùng một môi trường hạ tầng. Nikiforakis và cộng sự (2011) phân tích nguy cơ “abusing locality” trong shared web hosting, cho thấy kẻ tấn công có thể lợi dụng đặc điểm cùng tồn tại của nhiều website trên một máy chủ để mở rộng bề mặt tấn công. Với SEO, điều này làm tăng nguy cơ lây nhiễm chéo, chèn mã độc, spam link hoặc redirect ẩn. Vì vậy, website đã có giá trị organic traffic nên ưu tiên hosting có cô lập tài khoản, phân quyền file chặt chẽ, scan malware và backup tách biệt.

Các rủi ro phổ biến trên shared hosting kém bảo mật:

- Spam link outbound: hacker chèn link ẩn (display:none, font-size:0, position off-screen) hoặc base64 encode trong file theme/plugin, trỏ đến hệ thống PBN, site bán hàng kém chất lượng, làm giảm trust và có thể khiến site bị đánh giá tham gia scheme link.

- Redirect ẩn: sử dụng điều kiện user-agent, referrer, IP để chỉ redirect người dùng đến từ Google hoặc bot tìm kiếm, khiến chủ site khó phát hiện vì truy cập trực tiếp thì vẫn bình thường.

- Tạo subfolder/subdomain rác: ví dụ /tmp/, /cache/, /blog-old/, hoặc subdomain ngẫu nhiên chứa nội dung auto-generated, spin content, nhắm đến từ khóa nhạy cảm. Các URL này có thể được Google index, làm loãng chủ đề (topic) và giảm chất lượng tổng thể của domain.

- IP shared bị blacklist: nếu một site trên cùng IP gửi spam mail, spam SEO, hoặc phát tán malware, IP có thể bị blacklist bởi các RBL, hoặc bị Google đánh giá là “bad neighborhood”. Điều này gián tiếp ảnh hưởng đến khả năng crawl, deliver email transactional, và perception về độ tin cậy.

Khi Google phát hiện hoạt động bất thường trên domain hoặc IP, các hậu quả có thể bao gồm:

- Tụt hạng đột ngột trên nhiều từ khóa, đặc biệt là từ khóa thương hiệu.

- Mất index hàng loạt URL, chỉ còn lại một phần nhỏ trang được hiển thị.

- Nhận manual action liên quan đến hacked content, spammy content hoặc unnatural outbound links.

Chủ site thường chỉ nhận ra vấn đề khi:

- Traffic từ organic giảm mạnh trong Analytics.

- Search Console gửi thông báo về hacked content, spam, hoặc tăng đột biến lỗi coverage.

- Người dùng phản ánh bị redirect sang site lạ, popup, landing page không liên quan.

Quy trình xử lý trong trường hợp này thường phức tạp và tốn thời gian:

- Scan toàn bộ file và database để tìm mã độc, backdoor, shell.

- So sánh với bản sạch (backup, core file gốc) để phát hiện file bị chỉnh sửa.

- Kiểm tra .htaccess, web.config, file cấu hình server để loại bỏ redirect ẩn.

- Xóa subfolder/subdomain rác, gửi yêu cầu xóa URL (Remove URLs) nếu cần.

- Gửi reconsideration request nếu bị manual action, kèm mô tả chi tiết các bước đã khắc phục.

Để giảm thiểu rủi ro ngay từ đầu, nên:

- Chọn shared hosting có cách ly tài khoản tốt (CloudLinux, CageFS, mỗi user một UID/GID riêng, không share home directory).

- Ưu tiên hosting có scan malware tự động, cảnh báo sớm khi phát hiện file lạ, pattern mã độc, hoặc outbound link bất thường.

- Có cơ chế backup nhiều phiên bản (daily/weekly), lưu trên storage tách biệt, giúp rollback nhanh khi phát hiện tấn công.

- Cân nhắc nâng lên VPS hoặc cloud khi website bắt đầu có giá trị SEO đáng kể, để kiểm soát tốt hơn về cấu hình bảo mật, firewall, update hệ thống.

Với các dự án SEO dài hạn, việc đánh giá hosting không chỉ dừng ở CPU, RAM, disk, mà cần xem xét sâu các yếu tố bảo mật: mô hình isolation, chính sách update, log, WAF, anti-DDoS, cơ chế xử lý sự cố. Một nền tảng hosting được thiết kế tốt sẽ giảm đáng kể xác suất bị hack, spam, blacklist, từ đó bảo vệ ổn định thứ hạng và tài sản organic traffic.

Chọn loại hosting nào không sai cho từng giai đoạn SEO website

Ở giai đoạn đầu, hosting nên ưu tiên shared để tiết kiệm chi phí nhưng vẫn đảm bảo tốc độ, uptime và crawlability chấp nhận được cho site < 10.000 visit/tháng. Cần theo dõi kỹ giới hạn CPU, RAM, I/O, concurrent process và rủi ro “noisy neighbor” để không làm chậm quá trình Google xây dựng trust cho domain. Khi website bắt đầu tăng trưởng, nhiều plugin, database lớn và có chiến dịch traffic đều đặn, VPS là bước nâng cấp hợp lý, cho phép tối ưu chủ động web server, PHP, database, cache và log phục vụ SEO. Với ecommerce, SaaS hoặc hệ thống landing page lớn, cloud hosting giúp auto scale, đa vùng, tích hợp CDN, database managed, đảm bảo hiệu năng ổn định trong mọi đợt bùng nổ traffic. Ở cấp độ enterprise, dedicated server mang lại tài nguyên riêng, hiệu năng cao và khả năng xử lý log, crawl, big data SEO toàn hệ thống.

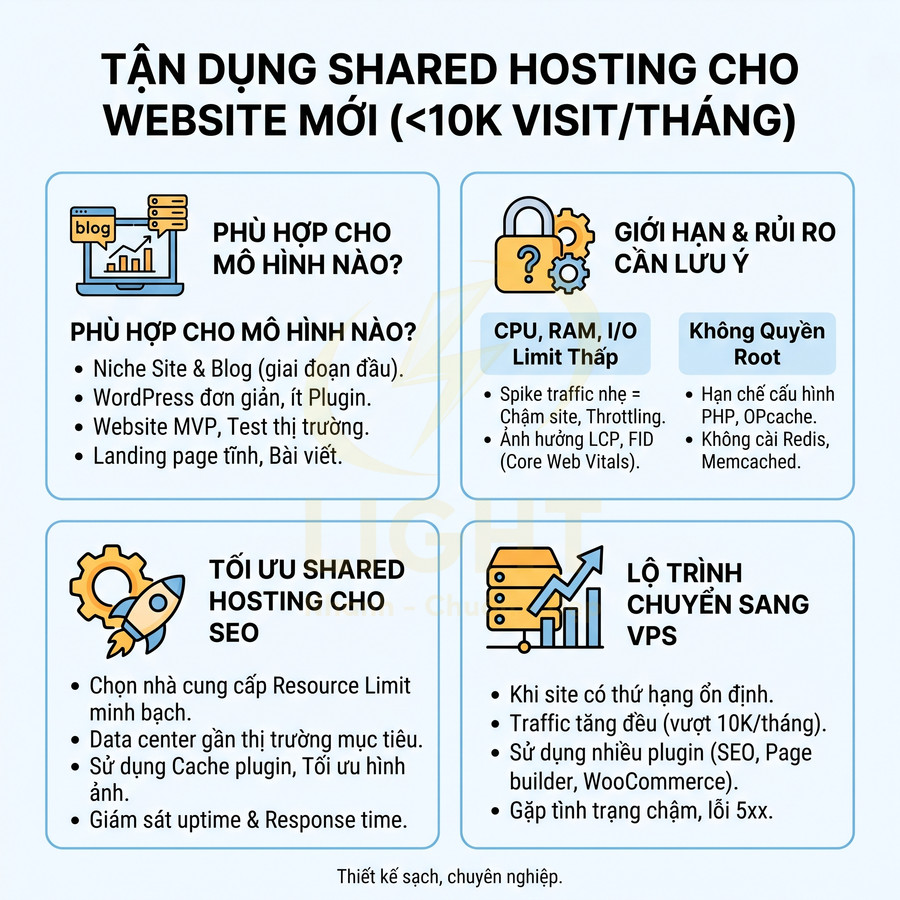

Shared hosting cho site mới dưới 10.000 visit/tháng và giới hạn cần lưu ý

Ở giai đoạn khởi động SEO, shared hosting không chỉ là bài toán chi phí mà còn là bài toán rủi ro về hiệu năng và ổn định. Với website mới (< 10.000 visit/tháng), Google chưa thu thập dữ liệu nhiều, nên bất kỳ vấn đề về tốc độ, downtime, hay lỗi 5xx lặp lại đều có thể làm chậm quá trình “trust building” của domain. Shared hosting vẫn phù hợp nếu được chọn và cấu hình đúng, đặc biệt cho các mô hình:

- Blog, niche site, authority site giai đoạn đầu, chủ yếu là bài viết, landing page tĩnh.

- Website WordPress dùng ít plugin, không có page builder quá nặng, không dùng WooCommerce.

- Site không có tính năng real-time (chat, streaming), không có API phức tạp hay webhook dày đặc.

- Dự án SEO test thị trường, MVP nội dung, cần triển khai nhanh, chi phí thấp.

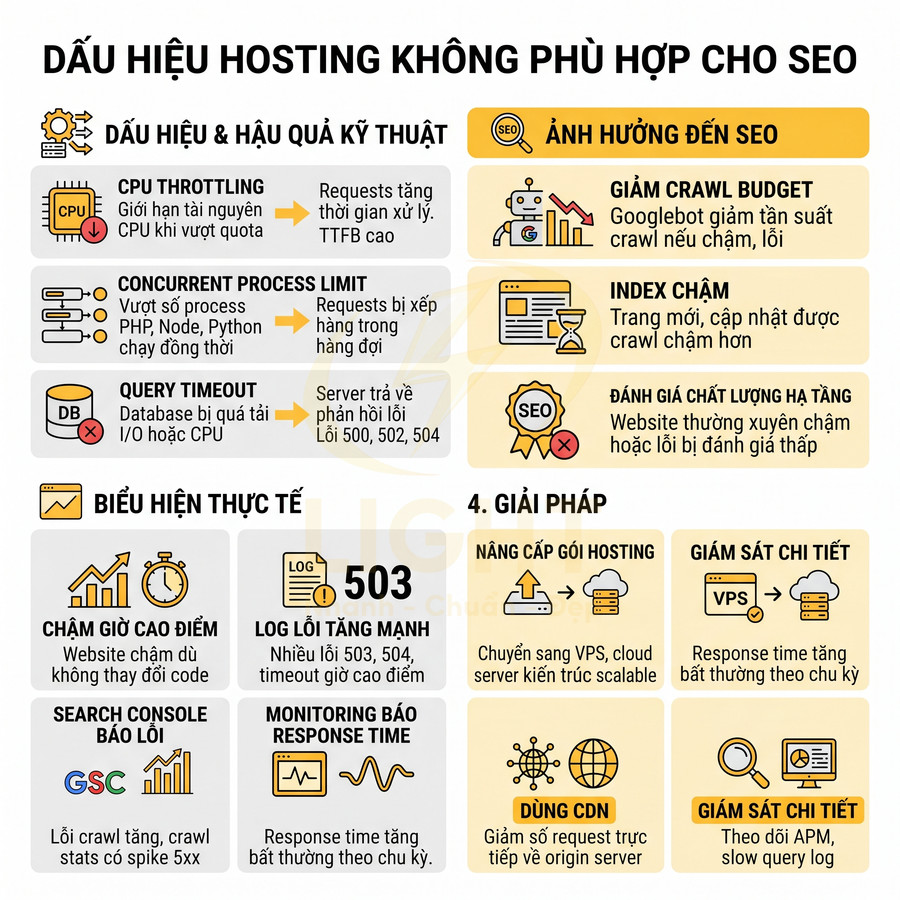

Tuy nhiên, shared hosting thường bị giới hạn tài nguyên ở mức “ẩn” (không ghi rõ trong quảng cáo), ảnh hưởng trực tiếp đến SEO thông qua tốc độ tải trang, độ ổn định và khả năng crawl của bot. Các giới hạn quan trọng cần phân tích kỹ:

- CPU, RAM, I/O limit thấp:

- Khi có spike traffic nhẹ (ví dụ từ 50 lên 200 visit/giờ do một bài viết lên top), host có thể kích hoạt throttling, làm chậm toàn bộ site.

- I/O disk thấp khiến việc đọc/ghi database, load file PHP, CSS, JS chậm, đặc biệt với WordPress nhiều plugin.

- Về SEO, điều này làm tăng Largest Contentful Paint (LCP), First Input Delay (FID) và Interaction to Next Paint (INP), ảnh hưởng Core Web Vitals.

- Giới hạn concurrent process / concurrent connections:

- Mỗi request PHP, mỗi kết nối tới MySQL đều tiêu tốn process; khi chạm limit, request bị queue hoặc trả lỗi 5xx.

- TTFB (Time To First Byte) tăng mạnh khi nhiều request phải chờ, Googlebot cũng bị ảnh hưởng, giảm crawl rate.

- Trong giờ cao điểm (chạy quảng cáo, share social), người dùng có thể gặp tình trạng “đơ” site, tăng bounce rate.

- Không có quyền root, hạn chế cấu hình sâu:

- Khó tinh chỉnh phiên bản PHP, OPcache, limit PHP-FPM, cấu hình Nginx/Apache tối ưu cho SEO.

- Không cài được các service hỗ trợ như Redis, Memcached, Elasticsearch, queue worker.

- Khó can thiệp vào cấu hình HTTP/2, HTTP/3, TLS, HSTS, ảnh hưởng đến performance và security.

- Rủi ro bảo mật và “noisy neighbor”:

- Nếu nhà cung cấp không cách ly tốt, một site bị hack hoặc spam có thể khiến IP bị blacklist, ảnh hưởng email deliverability, thậm chí ảnh hưởng trust của IP trong mắt Google.

- Website khác trên cùng server có thể chiếm dụng tài nguyên (CPU burst, I/O burst), làm site của bạn chậm bất thường.

Để shared hosting không trở thành “nút thắt cổ chai” SEO, nên:

- Ưu tiên nhà cung cấp có resource limit minh bạch (CPU core, RAM, I/O, entry process).

- Chọn data center gần thị trường mục tiêu để giảm latency, kết hợp CDN cho traffic quốc tế.

- Sử dụng cache plugin (page cache, object cache file-based), tối ưu hình ảnh, hạn chế plugin nặng.

- Giám sát uptime, response time bằng các công cụ monitoring để biết khi nào cần nâng cấp.

Shared hosting phù hợp cho giai đoạn xây nền nội dung, thử nghiệm keyword, cấu trúc silo. Khi site bắt đầu có thứ hạng ổn định, traffic tăng đều, hoặc bắt đầu dùng nhiều plugin (SEO suite, schema, page builder, security, backup), nên chuẩn bị lộ trình chuyển sang VPS trước khi gặp tình trạng chậm, lỗi 5xx, hoặc bị giới hạn crawl budget.

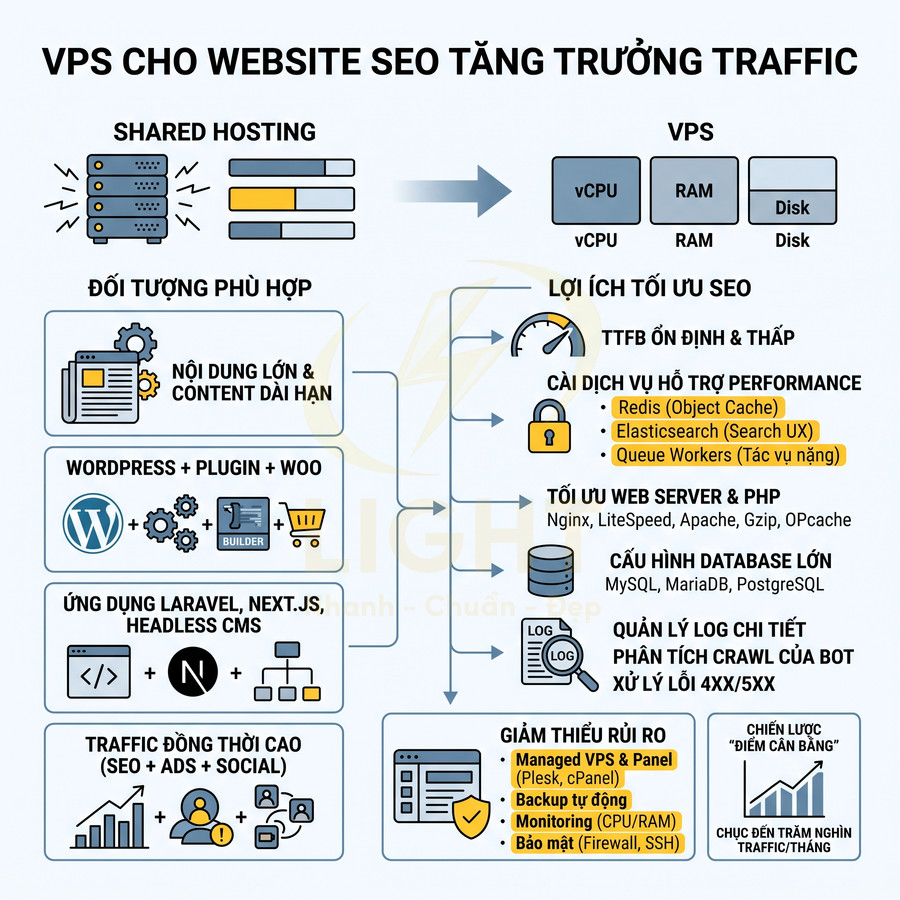

VPS cho website SEO tăng trưởng traffic, nhiều plugin và database lớn

VPS (Virtual Private Server) là bước chuyển từ “môi trường chia sẻ” sang “môi trường kiểm soát được”. Về bản chất, VPS vẫn chạy trên hạ tầng vật lý chia sẻ, nhưng tài nguyên (vCPU, RAM, disk) được phân vùng riêng, giảm đáng kể ảnh hưởng từ website khác. Với SEO, đây là giai đoạn website đã qua mức thử nghiệm, bắt đầu tối ưu sâu về tốc độ, crawlability, log, và trải nghiệm người dùng.

VPS đặc biệt phù hợp cho:

- Website nội dung trung bình đến lớn (hàng trăm đến hàng nghìn bài viết), có chiến lược content dài hạn.

- WordPress dùng nhiều plugin (SEO, cache, security, schema, multilingual), page builder (Elementor, Divi, Bricks), hoặc WooCommerce với nhiều sản phẩm.

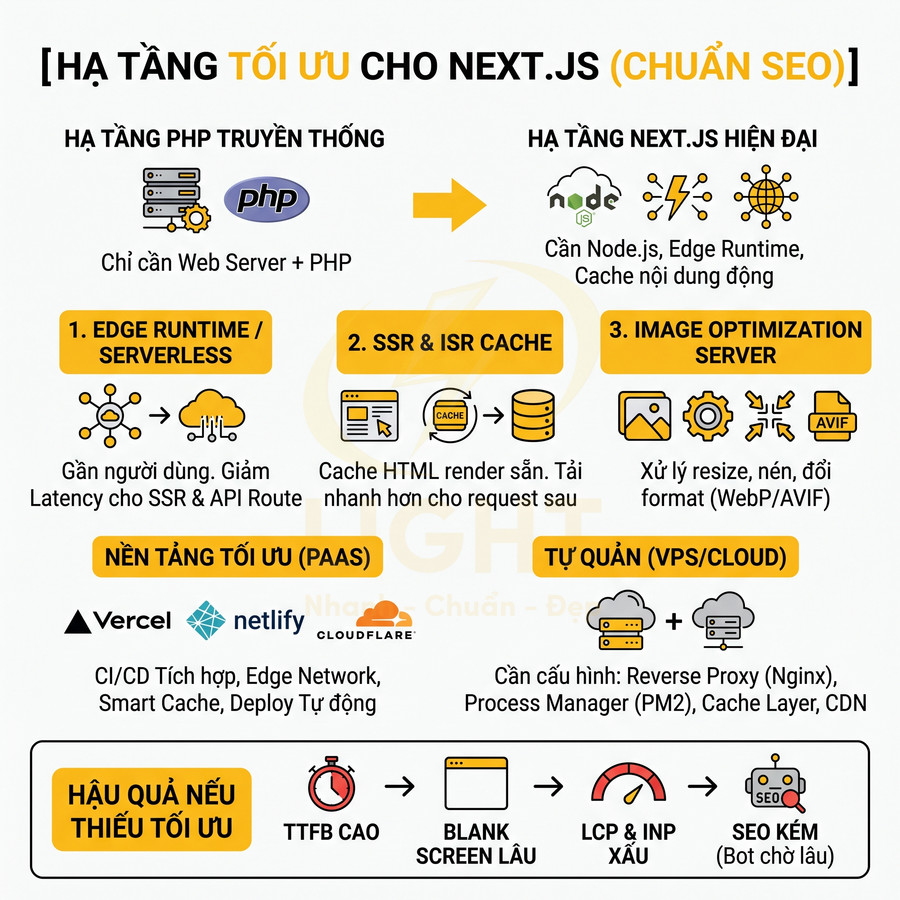

- Ứng dụng Laravel, Next.js, Nuxt, headless CMS cần cấu hình runtime riêng, build process, background job.

- Site cần xử lý nhiều request đồng thời từ SEO + quảng cáo (Google Ads, Facebook Ads) + social.

Lợi ích SEO khi chuyển sang VPS không chỉ là “mạnh hơn” mà là khả năng tối ưu có chủ đích cho SEO:

- TTFB ổn định và thấp hơn:

- Có thể cấu hình PHP-FPM, worker process, keep-alive, HTTP/2/3 để giảm latency.

- Giảm tình trạng spike TTFB khi Googlebot crawl mạnh hoặc khi có chiến dịch traffic lớn.

- Cài đặt các service hỗ trợ SEO & performance:

- Cài Redis cho object cache, session cache, giảm truy vấn database.

- Cài Elasticsearch / OpenSearch cho search nội bộ, filter sản phẩm, giúp UX tốt hơn, tăng time on site.

- Thiết lập queue worker (RabbitMQ, Redis queue, SQS client) để xử lý tác vụ nặng (gửi email, sync dữ liệu, generate sitemap lớn) ở background, giảm thời gian phản hồi cho user.

- Kiểm soát cấu hình web server và PHP:

- Tối ưu Nginx/Apache/LiteSpeed cho static file, gzip/brotli, cache header, HTTP security header.

- Tinh chỉnh memorylimit, maxexecution_time, opcache để xử lý các trang lớn, sitemap lớn, export/import dữ liệu.

- Tối ưu cấu hình database (MySQL/MariaDB/PostgreSQL) cho workload đọc nhiều, index phù hợp, giảm query chậm.

- Quản lý log chi tiết:

- Lưu và phân tích access log, error log để phát hiện lỗi 4xx/5xx, redirect loop, bot spam.

- Kết hợp với công cụ phân tích log SEO để hiểu hành vi crawl của Googlebot, từ đó tối ưu internal link, sitemap, robots.txt.

Nhược điểm chính của VPS là yêu cầu kỹ năng quản trị server (bảo mật, backup, update, hardening). Để giảm rủi ro:

- Có thể dùng managed VPS hoặc panel (Plesk, cPanel, CyberPanel, RunCloud, CloudPanel) để đơn giản hóa vận hành.

- Thiết lập backup tự động (file + database), snapshot định kỳ, và monitoring (CPU, RAM, disk, load, HTTP status).

- Cấu hình firewall, fail2ban, SSH key, update bảo mật thường xuyên để tránh bị khai thác lỗ hổng.

Về chiến lược SEO dài hạn, VPS là “điểm cân bằng” giữa chi phí và khả năng mở rộng. Khi site đạt từ vài chục nghìn đến vài trăm nghìn visit/tháng, nhiều plugin, database lớn (nhiều bảng, nhiều bản ghi), VPS được tối ưu tốt vẫn có thể đáp ứng rất ổn trước khi cần nghĩ đến kiến trúc cloud phức tạp hơn.

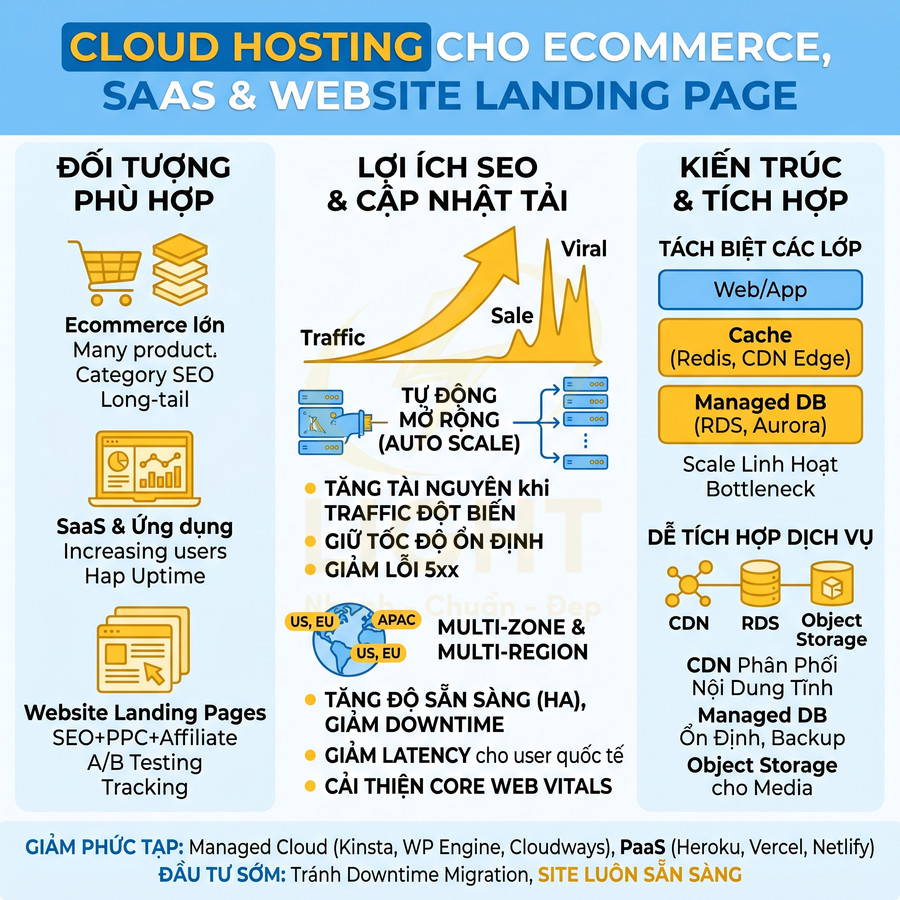

Cloud hosting cho ecommerce, SaaS và website nhiều landing page cần auto scale

Cloud hosting dựa trên hạ tầng cloud (AWS, GCP, Azure, DigitalOcean, v.v.) cho phép thiết kế kiến trúc linh hoạt, tách biệt các lớp ứng dụng, database, cache, storage. Với SEO, cloud đặc biệt quan trọng khi traffic không chỉ tăng đều mà còn có những đợt bùng nổ (campaign, sale, viral) mà shared hosting hoặc VPS đơn lẻ khó “gánh” an toàn.

Cloud hosting phù hợp cho:

- Ecommerce lớn, nhiều danh mục, hàng nghìn – hàng chục nghìn sản phẩm, nhiều chiến dịch SEO song song theo category, brand, long-tail.

- SaaS, ứng dụng web có lượng user tăng dần, nhiều phiên đăng nhập đồng thời, cần uptime cao.

- Website nhiều landing page (SEO + PPC + affiliate), chạy A/B testing, personalisation, tracking phức tạp.

Lợi ích SEO của cloud hosting nằm ở khả năng duy trì trải nghiệm ổn định trong mọi kịch bản tải:

- Auto scale:

- Tự động tăng số lượng instance hoặc tài nguyên khi traffic tăng đột biến (sale, flash deal, viral content).

- Giữ tốc độ phản hồi ổn định, tránh tình trạng site chậm hoặc sập đúng lúc chiến dịch SEO/Ads đang hiệu quả nhất.

- Giảm nguy cơ Googlebot gặp lỗi 5xx hàng loạt trong giai đoạn crawl mạnh.

- Multi-zone, multi-region:

- Triển khai ứng dụng ở nhiều availability zone, thậm chí nhiều region gần user mục tiêu (US, EU, APAC).

- Tăng độ sẵn sàng (high availability), giảm downtime do sự cố phần cứng hoặc data center.

- Giảm latency cho user quốc tế, cải thiện Core Web Vitals cho nhiều thị trường khác nhau.

- Dễ tích hợp dịch vụ bổ trợ:

- CDN (CloudFront, Cloudflare, Fastly, v.v.) để phân phối nội dung tĩnh, giảm tải server gốc.

- Database managed (RDS, Cloud SQL, Aurora) giúp hiệu năng ổn định, backup, replication, giảm rủi ro mất dữ liệu.

- Search engine managed, message queue, object storage (S3, GCS) cho media, log, backup.

Về mặt kiến trúc SEO, cloud cho phép tách:

- Lớp web/app (chạy code, xử lý request).

- Lớp cache (Redis, CDN edge cache).

- Lớp database (OLTP) và có thể thêm lớp data warehouse cho phân tích SEO nâng cao.

Điều này giúp khi cần scale, chỉ scale đúng lớp đang là bottleneck, tránh phải “nâng cả cục” như VPS/dedicated. Tuy nhiên, cloud hosting đòi hỏi kiến thức về kiến trúc hệ thống, networking, bảo mật, cost optimization. Để giảm độ phức tạp, có thể dùng:

- Nền tảng managed cloud (Kinsta, WP Engine, Cloudways, v.v.) cho WordPress và PHP app.

- Platform-as-a-Service (PaaS) như Heroku, Vercel, Netlify (cho frontend), kết hợp backend riêng.

Với các dự án SEO có tiềm năng lớn, việc đầu tư cloud từ sớm giúp tránh phải di chuyển hạ tầng nhiều lần, giảm rủi ro downtime khi migrate, và đảm bảo site luôn sẵn sàng cho các chiến dịch tăng trưởng mạnh, đặc biệt trong các mùa cao điểm (Black Friday, Tết, sale lớn).

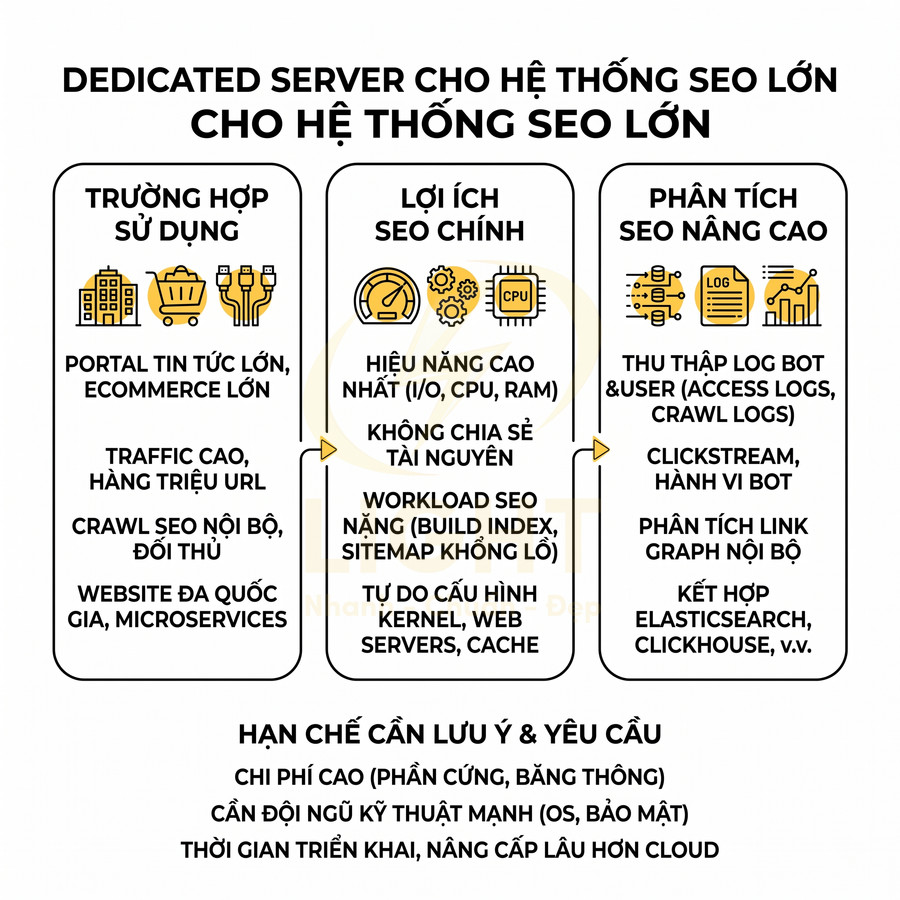

Dedicated server cho hệ thống lớn, crawl nặng và xử lý log SEO toàn site

Dedicated server là cấp độ “kim loại trần” (bare metal), nơi toàn bộ tài nguyên phần cứng thuộc về một khách hàng. Không còn lớp ảo hóa chia sẻ với người khác, hiệu năng I/O, CPU, RAM ổn định và có thể dự đoán hơn. Với SEO, dedicated phù hợp cho các hệ thống đã trưởng thành, nơi hạ tầng không chỉ phục vụ traffic người dùng mà còn phục vụ các tác vụ crawl, phân tích log, machine learning nội bộ.

Các trường hợp nên cân nhắc dedicated server: